- 「会社でChatGPTが導入されたけど『機密情報は入力禁止』で使い物にならない」

- 「なぜ日本の大企業は、便利なクラウドAIを警戒しているの?」

- 「AIの『地産地消』や『ソブリンAI』という言葉の意味と背景が知りたい」

- 日本企業が直面している「クラウドAIのジレンマ」の正体

- データを社外に出さない「ローカルAI(地産地消)」が選ばれる3つの理由

- この構造変化が、投資家やIT技術者に与える巨大なビジネスチャンス

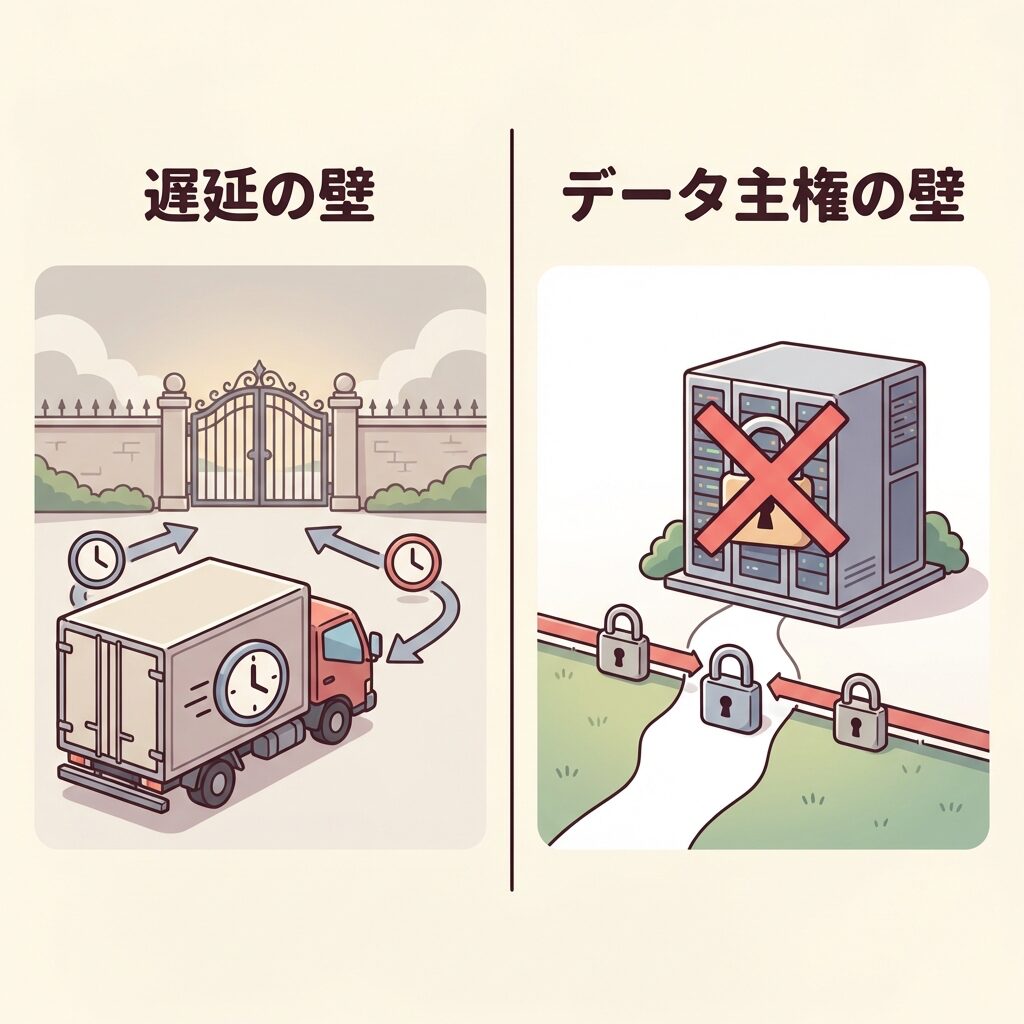

日本企業がローカルAIを急ぐ理由は、「データ主権(セキュリティ)」と「従量課金コストの回避」です。他国の巨大サーバーに自社の生命線であるデータを預けるリスクに気づいた企業たちは今、自社専用の小さなAIを社内に抱え込む「AIの地産地消」へと舵を切っています。

「AIの地産地消」とは何か?

「地産地消」といえば農業の言葉ですが、AIの世界でも全く同じ現象が起きています。海外の巨大IT企業(メガクラウド)が作った万能AIに頼るのではなく、「自分たちのデータを使って、自分たちの手元でAIを動かす」という考え方です。

Sovereign(主権)を持つAI。国家や企業が、自分たちのデータや文化を他国に依存せず、国内のインフラで自立して管理・運用するAIのことです。

【完全図解】エッジAI・SLMとは?知能が「手元」に降りてくる産業構造の激変 →

なぜ日本企業はクラウドAIを「怖い」と感じるのか?

経営層がChatGPTなどの万能AIの全社導入をためらうのには、明確で合理的な理由があります。

クラウドAIに社外秘を入力するのは、「会社の極秘会議の議事録を、見ず知らずの優秀な外部コンサルタントにLINEで送って『要約して』と頼む」ようなものです。便利ですが、経営者としては絶対に止めたい行為です。

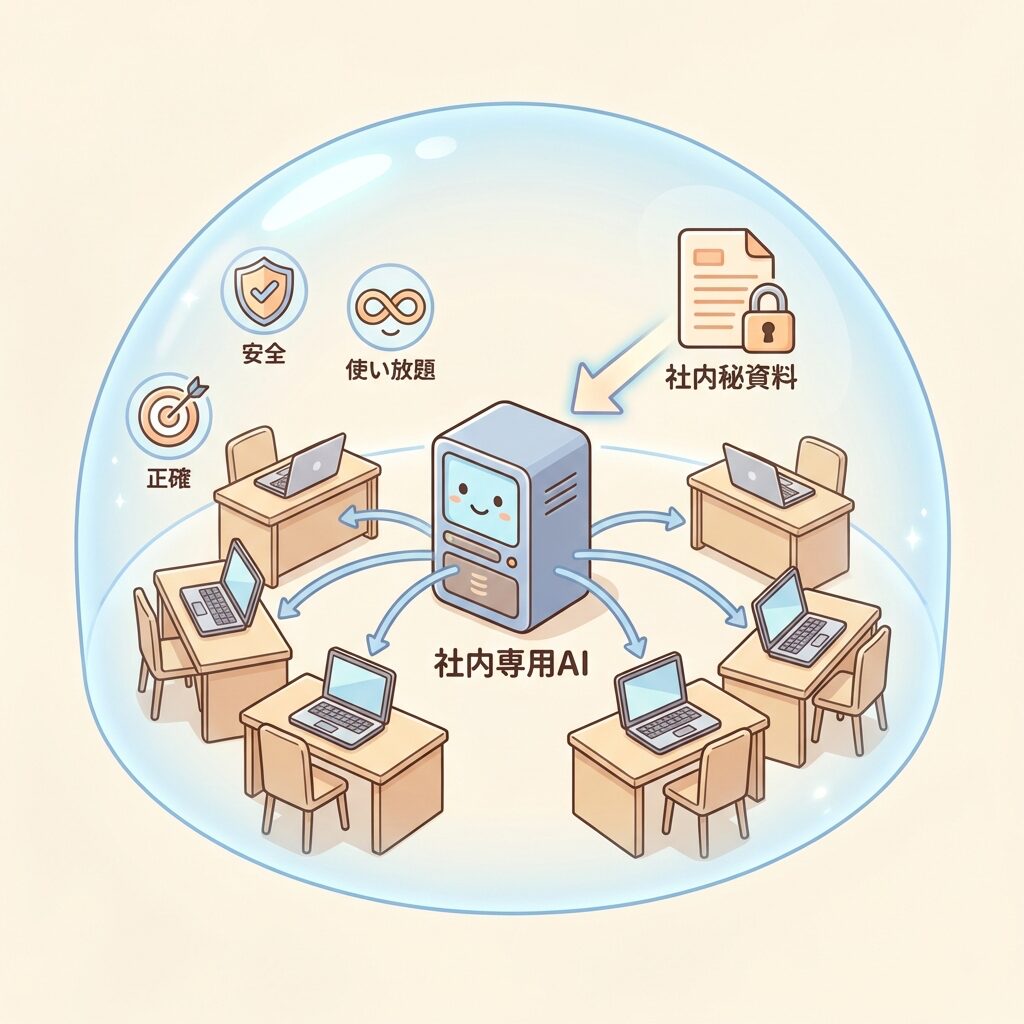

「ローカルAI(社内専用AI)」がすべてを解決する

そこで日本企業が目を付けたのが、データセンターへの通信を遮断し、自社のネットワーク内(オンプレミス)だけで動くローカルAIの構築です。

| 課題 | ローカルAI(地産地消)による解決 |

|---|---|

| データ流出 | 物理的に外と繋がっていないため、極秘の図面や個人情報を読み込ませても100%安全。 |

| コスト問題 | API利用料は不要。自社サーバーの電気代のみで使い放題(固定費化)。 |

| 業務の専門性 | 社内のマニュアルや過去のデータだけを学習させることで、正確な回答を実現。 |

【完全図解】AIデータセンターはなぜ電気を食うのか?電力需要の構造をやさしく整理 →

このトレンド、あなたはどう活かすべきか?

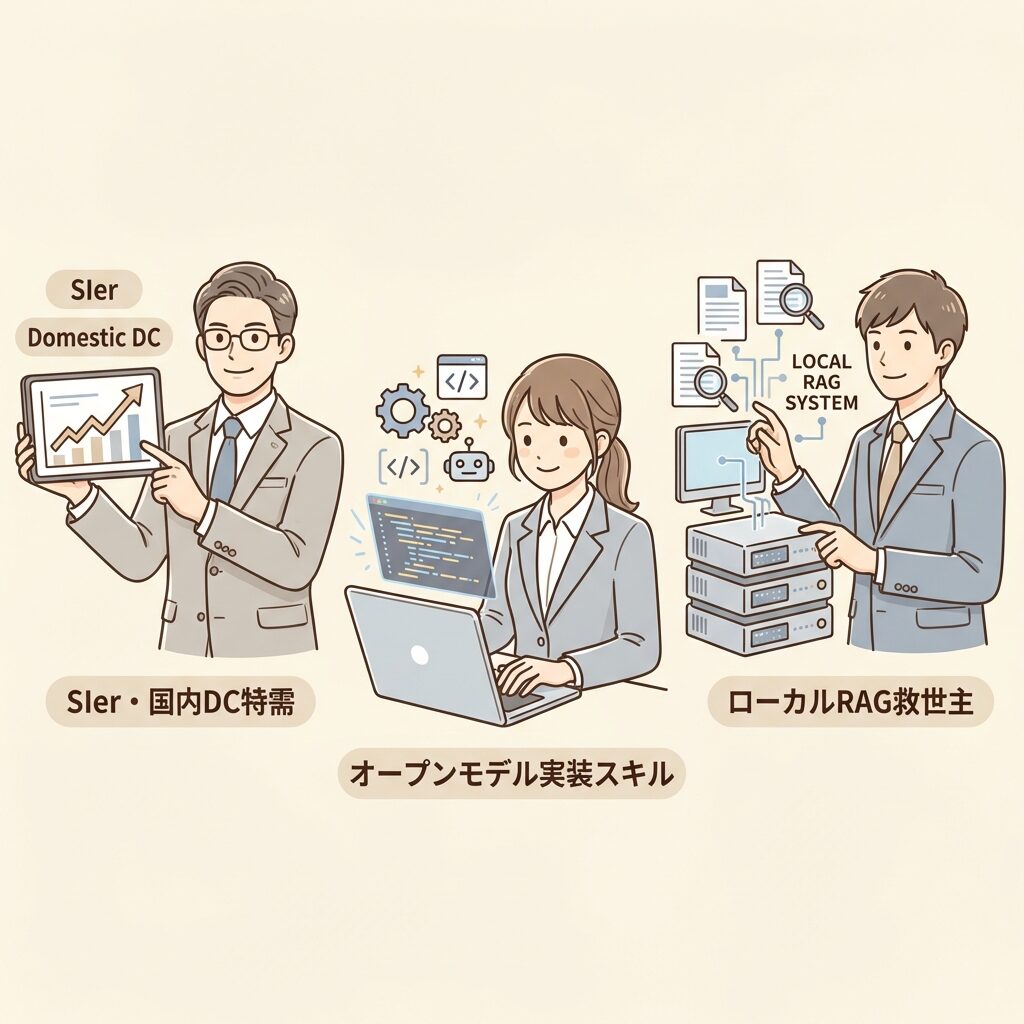

日本企業が「自社専用AI」を持ちたがる流れは、新たなビジネスチャンスを生んでいます。

投資家:クラウド企業だけでなく、国内で「オンプレミス(自社設置型)AI環境」を構築するシステムインテグレーター(SIer)や、国内データセンター事業者に巨大な特需が生まれています。

学生:「ChatGPTを使える」だけでは評価されません。オープンソースのAIをダウンロードし、閉じた環境でシステムに組み込む技術が圧倒的に重宝されます。

技術者:「社内情報を安全に検索できるAI」を構築・提案できれば、会社のセキュリティ問題を一掃する救世主になれます。

【完全図解】AIデータセンターの中身とは?5つの構成要素を地図で理解する →

よくある誤解:「自前でAIを作るなんて、日本はガラパゴス化するのでは?」

「世界の最先端はクラウドの巨大AIなのに、日本だけ自社内にこもって遅れてしまうのでは?」という懸念がありますが、これは大きな誤解です。

日本企業が、膨大な資金を投じてGPT-4のような巨大な基礎モデルをイチから作り直そうとしている。

GoogleやMetaが無料で公開している「優秀な小型AI(オープンモデル)」を自社にダウンロードし、自社の知識だけを追加学習(微調整)させて使っている。

日本企業のAI導入シナリオ(タイムライン)

日本企業におけるAIの活用は、以下のようなステップで「手元」に近づいていくと予想されます。

ChatGPT等を導入するが「機密情報入力禁止」のルールにより、一般的な文章作成や翻訳に用途が限定される。

クローズドな環境にオープンモデルを設置。社内規程や過去の議事録を読み込ませ、安全な「社内専用アシスタント」を構築する。

NPU搭載の「AI PC」が社員に配備される。社内サーバーすら経由せず、個人のPC上で直接AIがデータ処理を行う究極の分散化が実現。

【完全図解】AI PCとは?NPUの役割と「普通のPC」との決定的な違い →

❓ よくある質問(FAQ)

- 日本企業は「データ流出」「コスト」「嘘」を恐れ、クラウドAI導入に慎重になっている

- 解決策として、自社内で完結する「ローカルAI(地産地消)」への回帰が進んでいる

- ゼロから作るのではなく、優秀なオープンモデルを自社専用に調整するのが主流

- この流れは、国内SIerやAI PC市場に巨大な投資・ビジネスチャンスを生んでいる

📖 【完全図解】エッジAI・SLMとは?知能が「手元」に降りてくる産業構造の激変 →

この記事は上記ロードマップの一部です。AIがクラウドから手元に降りてくる全体像から学びたい方はこちらからどうぞ。

コメント