- ニュースで「液冷(水冷)」という言葉を見るが、従来の空冷と何が違うのかピンとこない

- なぜ急にAIデータセンターで冷却技術が注目されているのか、構造がわからない

- 投資や学習の前に、技術的なボトルネックを正しく理解しておきたい

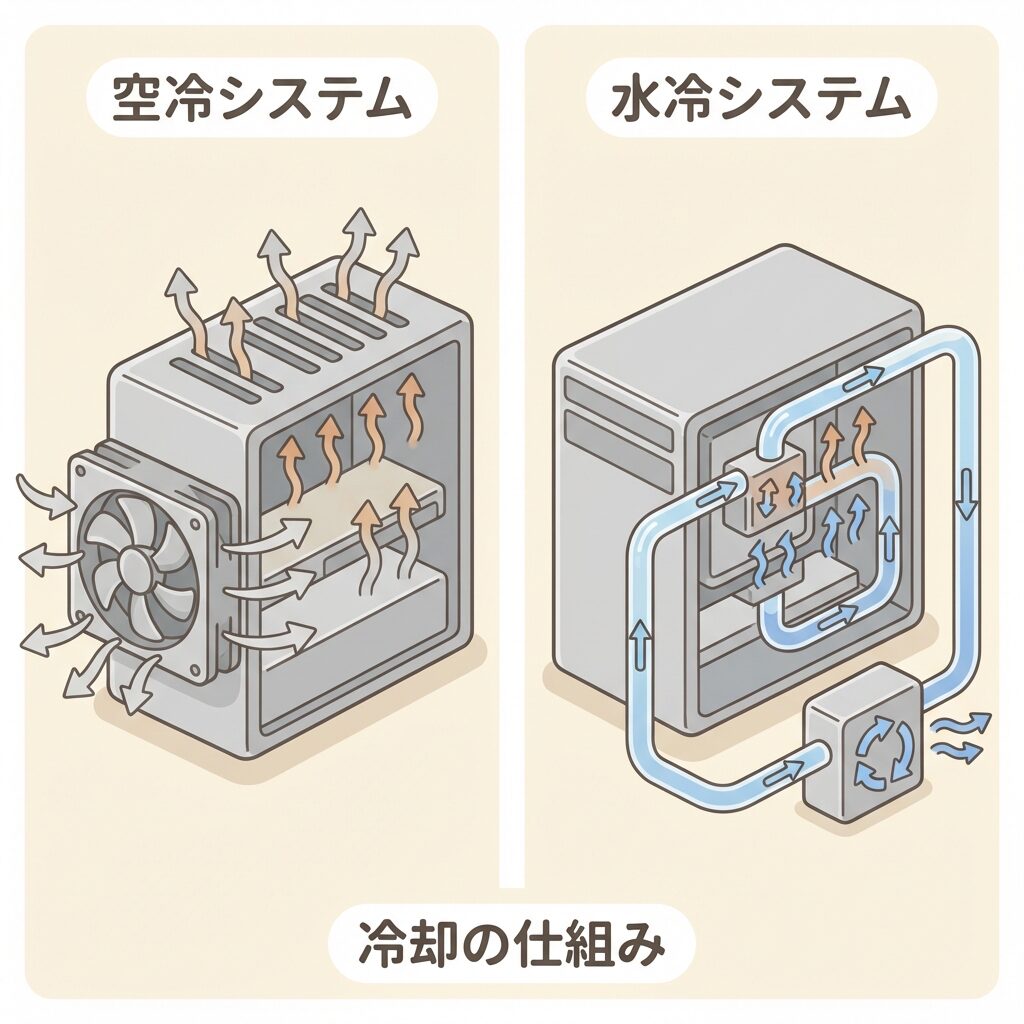

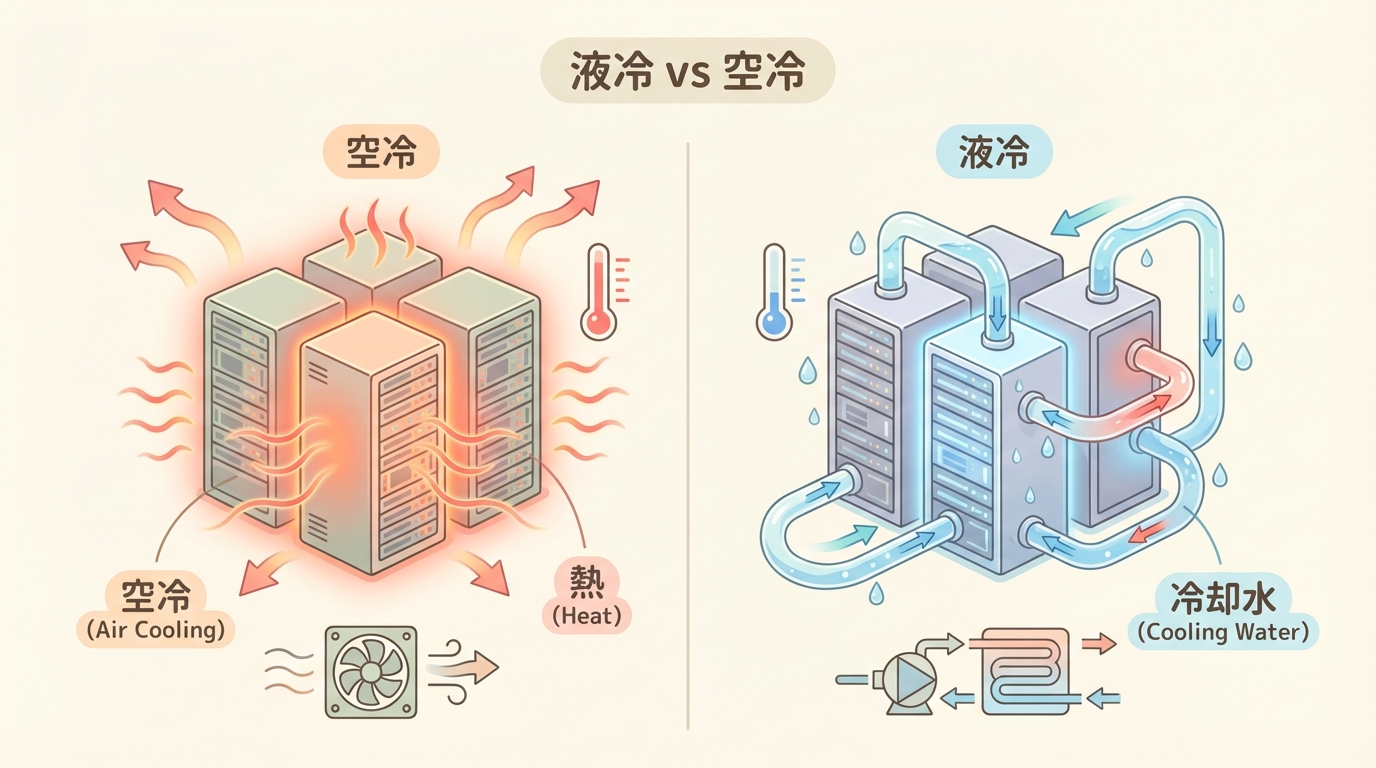

- 空冷と液冷の決定的な違いと、それぞれの仕組み

- 「ラックあたりの電力密度」という、AIインフラ最大の壁

- 投資家・学生・技術者が今注目すべき、今後の冷却ロードマップ

データセンターの冷却技術。これまで裏方だったこの領域が、AIの爆発的な普及とともに産業の主役に躍り出ました。「GPUの性能が上がればAIは進化する」と思われがちですが、実は「発生する熱をどう逃がすか」が、現在のAI進化における最大の足かせ(ボトルネック)になっています。

従来の「空冷(エアコンで冷やす)」では、最新のAI用GPUが発する超高熱を物理的に冷やしきれなくなりました。そのため、空気の数千倍の熱を運べる水などの液体を使った「液冷」への移行が、避けて通れないインフラの構造転換として急速に進んでいます。

1. なぜ今「冷却」なのか?AIインフラの全体像

まずは、冷却技術がAI産業全体の中でどのような位置づけにあるのか、地図を確認しましょう。

AI半導体(GPU)は、膨大な電力を消費して計算を行います。物理の法則として、消費した電力は最終的にすべて「熱」に変わります。つまり、AIが賢くなるほど、半導体は目玉焼きが焼ける以上の超高温になります。

F1カーのエンジンと同じです。どれだけ強力なエンジン(GPU)を積んでも、ラジエーター(冷却)が追いつかなければ、オーバーヒートして速度を落とすか、最悪エンジンが壊れてしまいます。冷却はAIの「スピードリミッター」なのです。

2. なぜ「空冷」ではダメなのか?

これまで、世界中のデータセンターの95%以上は「空冷」を採用していました。巨大なエアコンで冷たい風を作り、サーバーに吹き付ける方式です。

立ちはだかる「ラックあたり30kWの壁」

サーバーラックとは、コンピュータを何段も積み重ねる巨大な棚のこと。「ラックあたりの電力(kW)」が大きいほど、その棚が強烈な熱を発していることを意味します。

空冷の物理的な限界は、一般的にラック1基あたり20kW〜30kW程度と言われています。風をどれだけ強くしても、空気は「熱を吸収して運ぶ能力」が低いため、これ以上は冷えません。

(GB200 NVL72等)

最新のAIサーバーラックは、空冷の限界をはるかに突破しています。物理的に「風」では熱を奪いきれない領域に突入したため、液体が必要になったのです。[出典: NVIDIA Blackwell アーキテクチャ]

3. 【比較表】空冷と液冷の決定的な違い

ここで、空冷と液冷の構造を明確に比較してみましょう。液体(水など)は、空気に比べて熱伝導率が約24倍、熱容量(熱をため込む力)が約3000倍もあります。

空冷(Air Cooling)

- 熱の運び手: 空気

- 仕組み: エアコンで冷風を送り、ファンで熱風を排出

- メリット: 導入コストが安く、漏水のリスクがない

- 限界: 30kW/ラック程度。ファン自体の消費電力が莫大になる

液冷(Liquid Cooling)

- 熱の運び手: 冷却液(純水や特殊溶剤)

- 仕組み: 熱源に直接液体を循環させ、熱を外部へ逃がす

- メリット: 100kW以上の超高密度ラックに対応。ファン不要で静音・省電力

- 課題: 初期設備投資が高い。配管の運用技術が必要

液冷を導入すると、サーバーを冷やすための電力(ファンの回転や巨大エアコン)を劇的に減らせるため、データセンター全体の省エネ化に直結します。

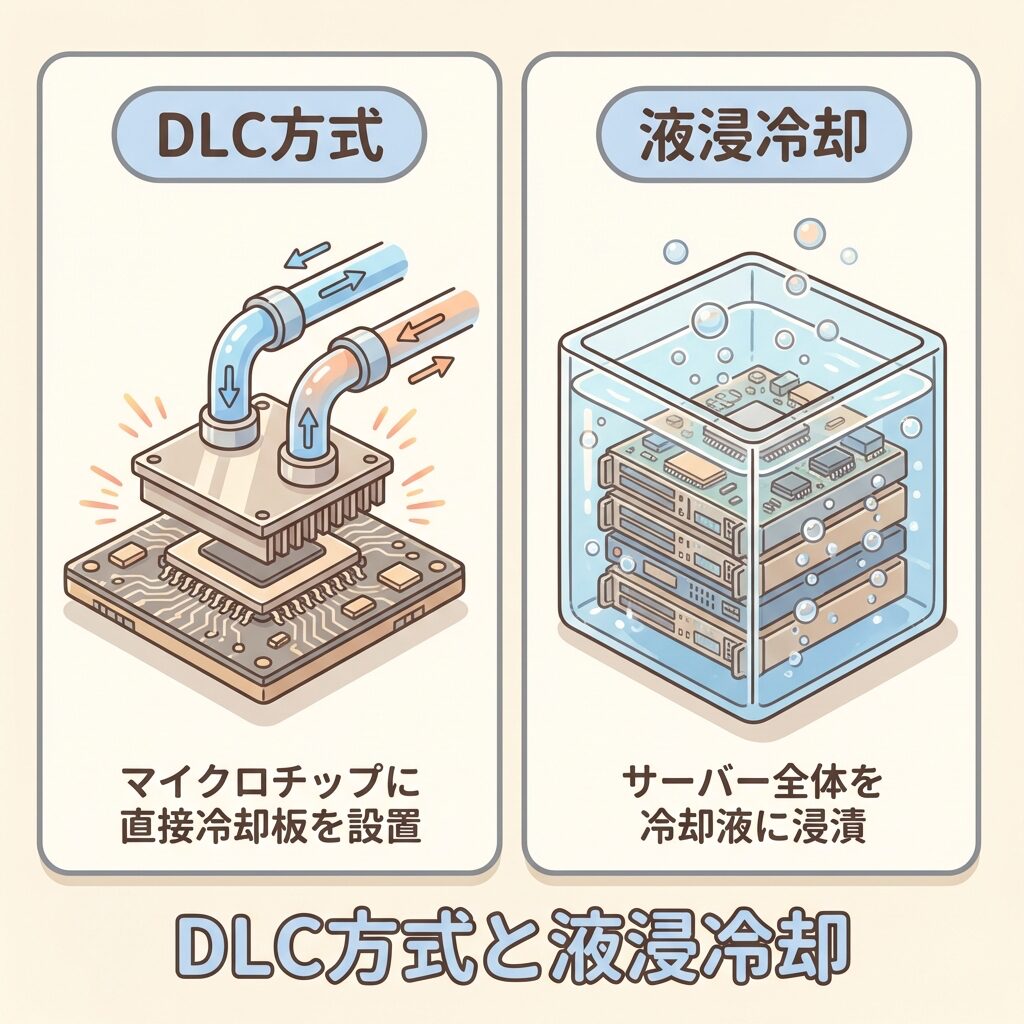

4. 液冷の2つの主要な仕組み

「液冷」と一口に言っても、液体をどう使うかで大きく2つの方式に分かれます。現在主流になりつつあるのは「DLC方式」です。

※NVIDIAの最新サーバー群はこの方式を前提としています。

※究極の冷却法ですが、メンテナンスが特殊なため普及はこれからです。

GPUの熱を金属板内部の液体が吸収

熱くなった液体を集め、ラックの外へポンプで送り出す

建物の外で熱を大気中に逃がし、冷えた液体を再びサーバーへ戻す

5. なぜこの構造変化が重要なのか?

「たかが冷却」ではありません。AIの主戦場が「チップの性能競争」から「電力と冷却インフラの確保」へシフトしている今、それぞれの視点で押さえるべきポイントを整理します。

NVIDIAのチップ単体ではなく、それを支えるCDU(冷却水分配装置)、配管部品、冷媒メーカーなど、周辺のサプライチェーン(サーマルマネジメント市場)に莫大な設備投資が流れています。空冷から液冷へのリプレイス需要は数年にわたる特需です。

🎓 学生の視点:

AI時代=情報工学だけではありません。熱力学、流体力学、機械工学、材料工学の知識が「AIインフラを止めないための必須スキル」として強烈に求められるようになっています。

🔧 技術者の視点:

データセンターの運用において、これまでの「電気・空調工事」から「配管・液漏れ対策・水質管理」へと求められる実務が劇的に変化します。ファシリティ技術のアップデートが急務です。

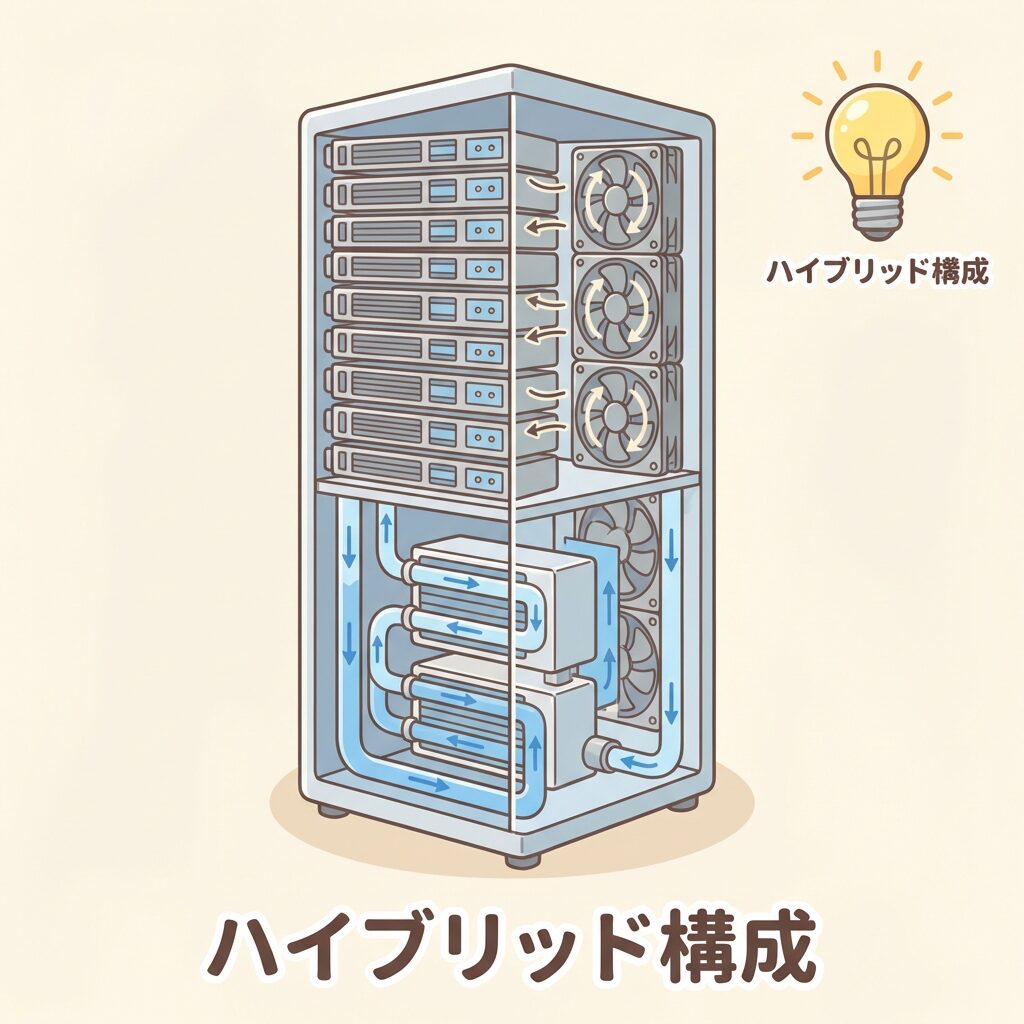

6. よくある誤解:空冷はすべて消滅するのか?

ニュースを見ていると「これからは全て液冷になる」と錯覚しがちですが、それは少し極端です。

AIの学習用のような「超高負荷」なラックは液冷が必須ですが、一般的なウェブサーバーやストレージ、ネットワーク機器などの稼働には、依然として空冷がコスト面で最適です。

実際には、同じデータセンター内で「CPUやGPUは液冷で冷やし、周辺機器やラック全体は空冷で冷やす」というハイブリッド冷却が当面の標準になります。

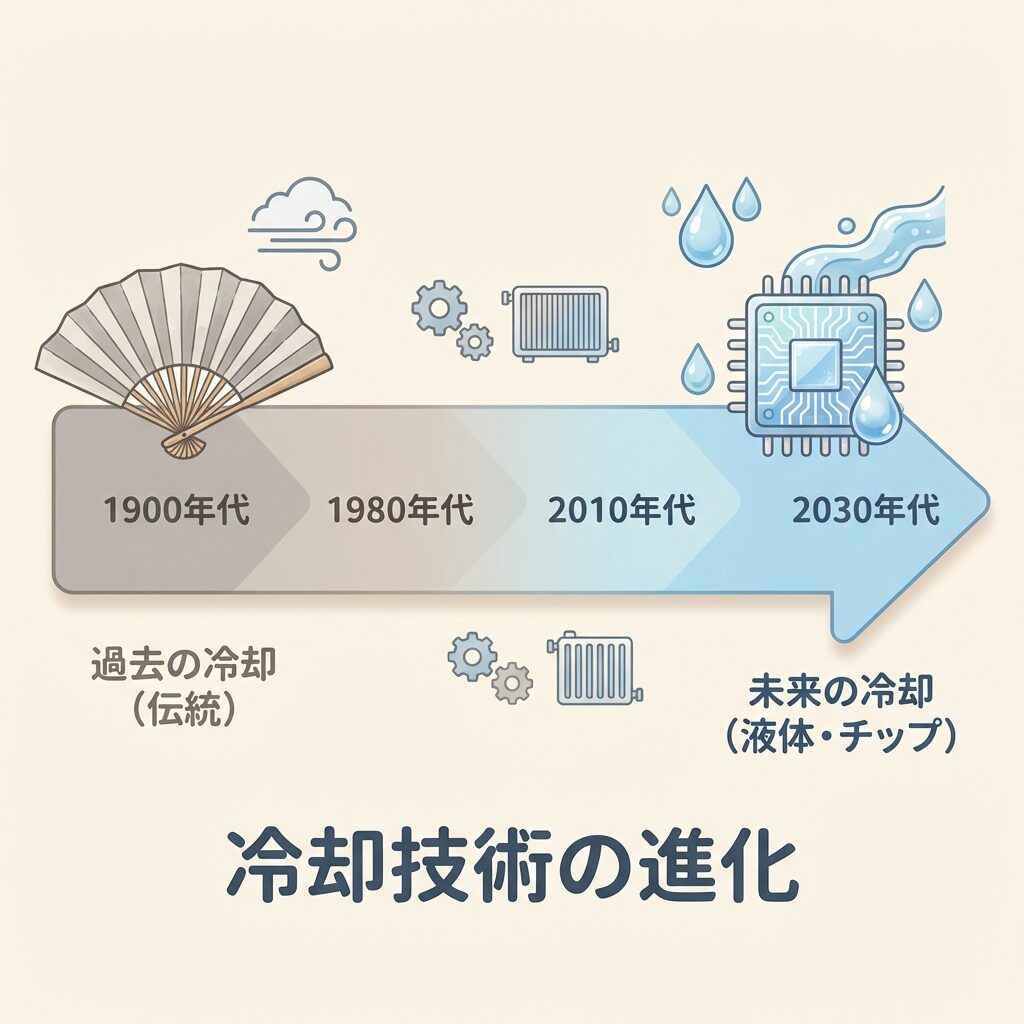

7. 冷却技術のロードマップとまとめ

技術の移行は段階的に進んでいます。最後に、今後の見通しをタイムラインで整理しましょう。

汎用データセンターの主流。しかしAIブームにより、一部で熱による性能低下が顕在化。

NVIDIAの大規模AIサーバー出荷に伴い、新規データセンターでDLC方式の導入が標準化。

ラック密度がさらに上昇し、より効率的な二相式液浸冷却や、背面熱交換ドアなどの新技術がハイエンド環境で普及開始。

空気では最新GPUの熱を奪いきれず、ファンが莫大な電力を消費して非効率に。

熱輸送力の高い「液体」を使うことで、高密度なAI計算と省エネ(PUE改善)を両立。

❓ よくある質問(FAQ)

📖 【完全図解】AIデータセンターとは?従来型との違いと構造を解説 →

この記事は上記ロードマップの一部です。AIインフラ全体の構造から学びたい方はこちらからどうぞ。

📚 次に読むべき記事

冷却の次に問題となる「電力をどうやってデータセンターまで引っ張ってくるか」という送電網の課題を解説します。

コメント