「DLC」──AIデータセンターの冷却技術として、今もっとも頻繁に登場するこの3文字。でもこんなふうに感じていませんか?

- DLCって何の略? 「液冷」と何が違うの?

- コールドプレート、CDU、マニフォールド──部品の名前は聞くけど全体像がつかめない

- NVIDIA GB200 NVL72が「液冷前提」と聞くけど、具体的にどう冷やしているの?

- 液浸冷却との違いは? どっちが優れているの?

- 導入するとき何を考えればいいの? コストは? 配管工事は大変?

- DLCの定義と「3つの構成要素」を図解で理解

- 冷却液がチップから熱を奪う一連の流れをステップで追体験

- NVIDIA GB200 NVL72での実装構成と数字

- DLCの「70:30問題」──なぜ空冷も併用するのか

- 液浸冷却との6項目比較と使い分けの判断基準

- 導入を検討するときの5つのチェックポイント

DLC(Direct Liquid Cooling:直接液冷)とは、GPUやCPUのチップ表面に「コールドプレート」と呼ばれる金属板を取り付け、その内部に冷却液を流してチップの熱を直接吸収する冷却方式です。空冷がサーバー室全体を冷やす「部屋のエアコン」なら、DLCは熱源に冷却水パイプを直接当てる「ピンポイント冷却」。NVIDIAの最新GPUラックGB200 NVL72(120kW)は完全液冷設計であり、DLCなしには動かせません。現在のAIデータセンターで最も普及している液冷方式です。ただし、DLCで冷やせるのはチップ部分だけ──メモリやネットワーク機器などの残りの熱は空冷で処理する「ハイブリッド構成」が標準です(液冷約70%:空冷約30%)。この記事では、DLCの仕組みを部品レベルから理解し、「なぜDLCが主流なのか」を構造で解説します。

📖 【完全図解】液冷とは?DLC・液浸冷却・水冷の違いを初心者向けに整理 →

リアドア水冷・DLC・液浸冷却の3方式を比較した全体像の記事。DLCの位置づけを先に把握すると、この記事がより深く読めます。

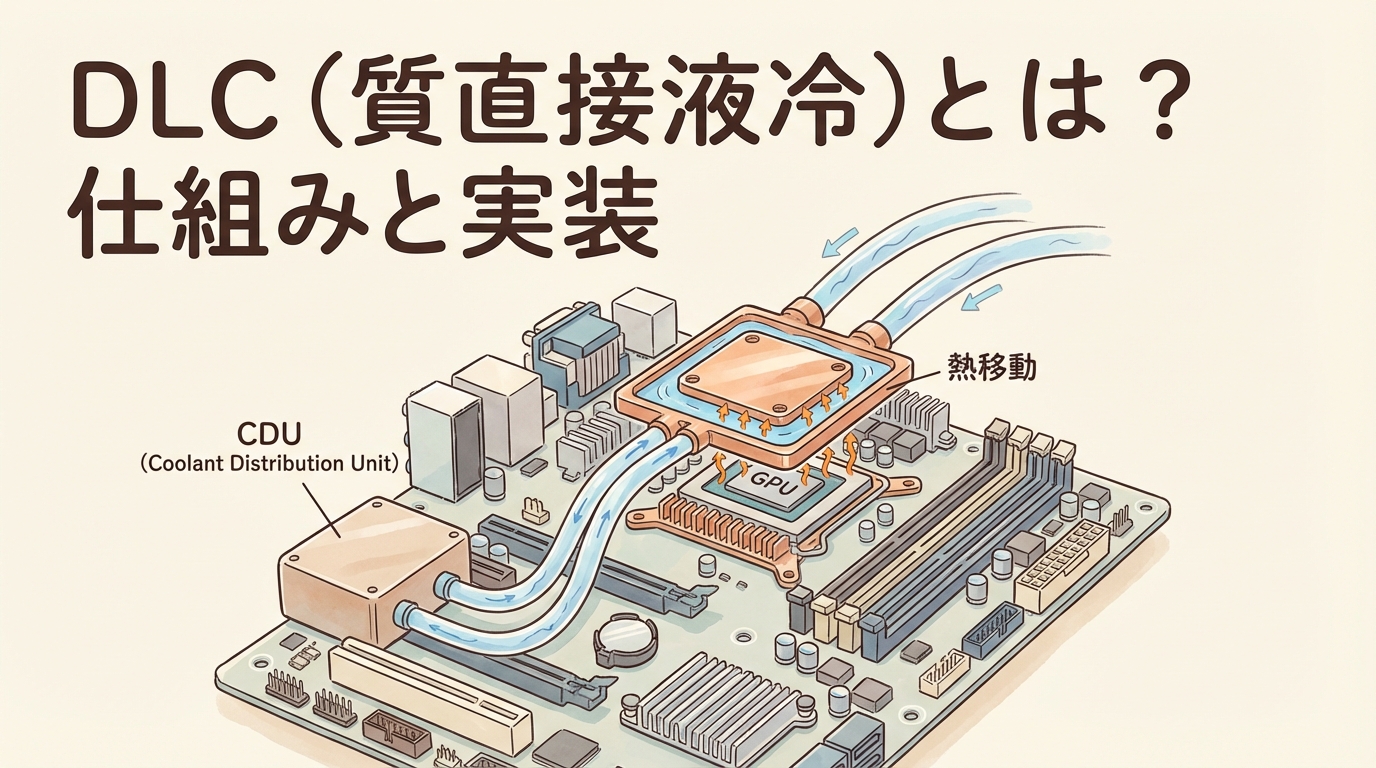

DLCとは?──3つの構成要素で「仕組みの全体像」をつかむ

🔧 DLC = Direct Liquid Cooling(チップを液体で直接冷やす)

DLC(Direct Liquid Cooling)とは、GPUやCPUのチップ表面に「コールドプレート」を密着させ、その内部に冷却液を流してチップの熱を直接吸収する冷却方式です。「Direct=直接」の名の通り、空気を介さずに液体がチップに触れて熱を奪うのが最大の特徴です。

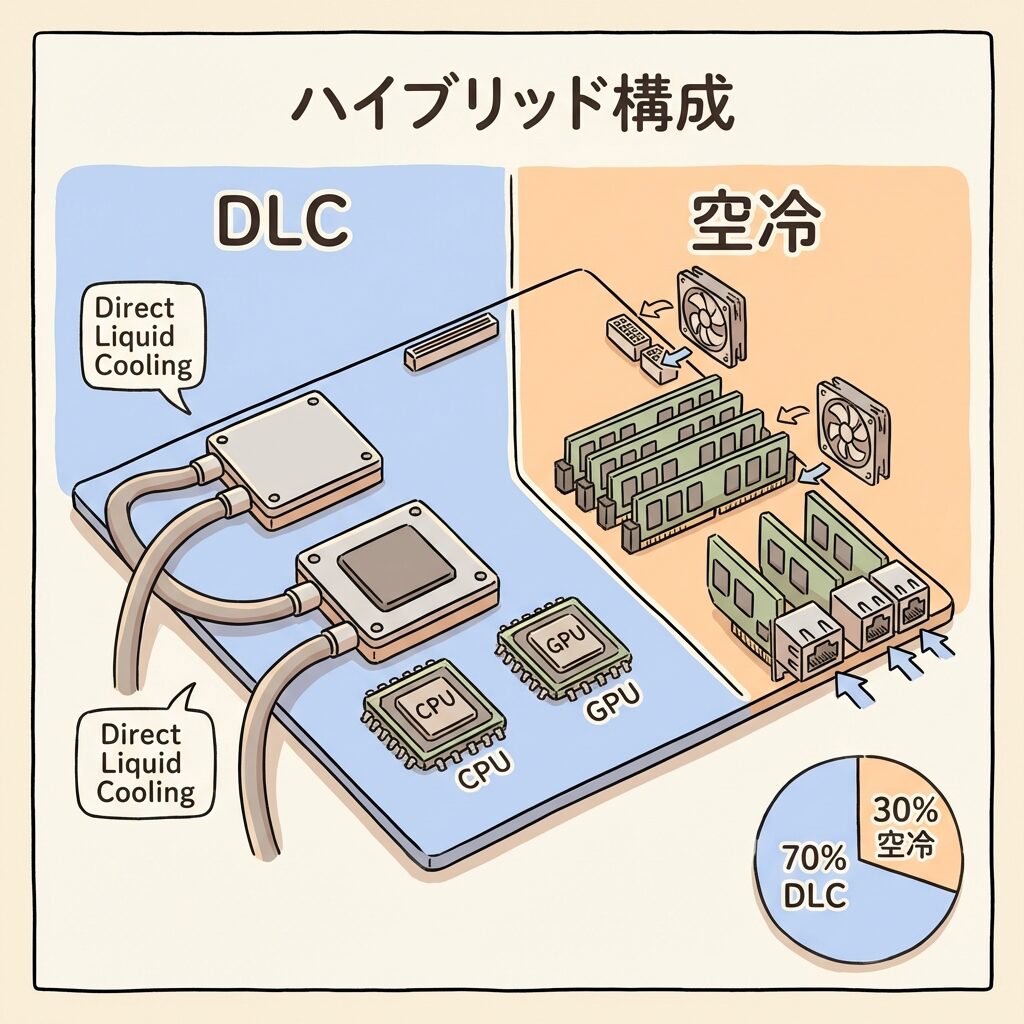

空冷が「扇風機で部屋全体を冷やす」なら、DLCは「氷水のパイプを熱いフライパンに直接押し当てる」方式です。熱源に直接触れるので、空気を介するより圧倒的に効率がいい。ただし、フライパン(チップ)以外の場所──テーブル(メモリ)や壁(ネットワーク機器)──は冷やせないので、そこは扇風機(空冷)も併用する。これが「ハイブリッド構成」です。

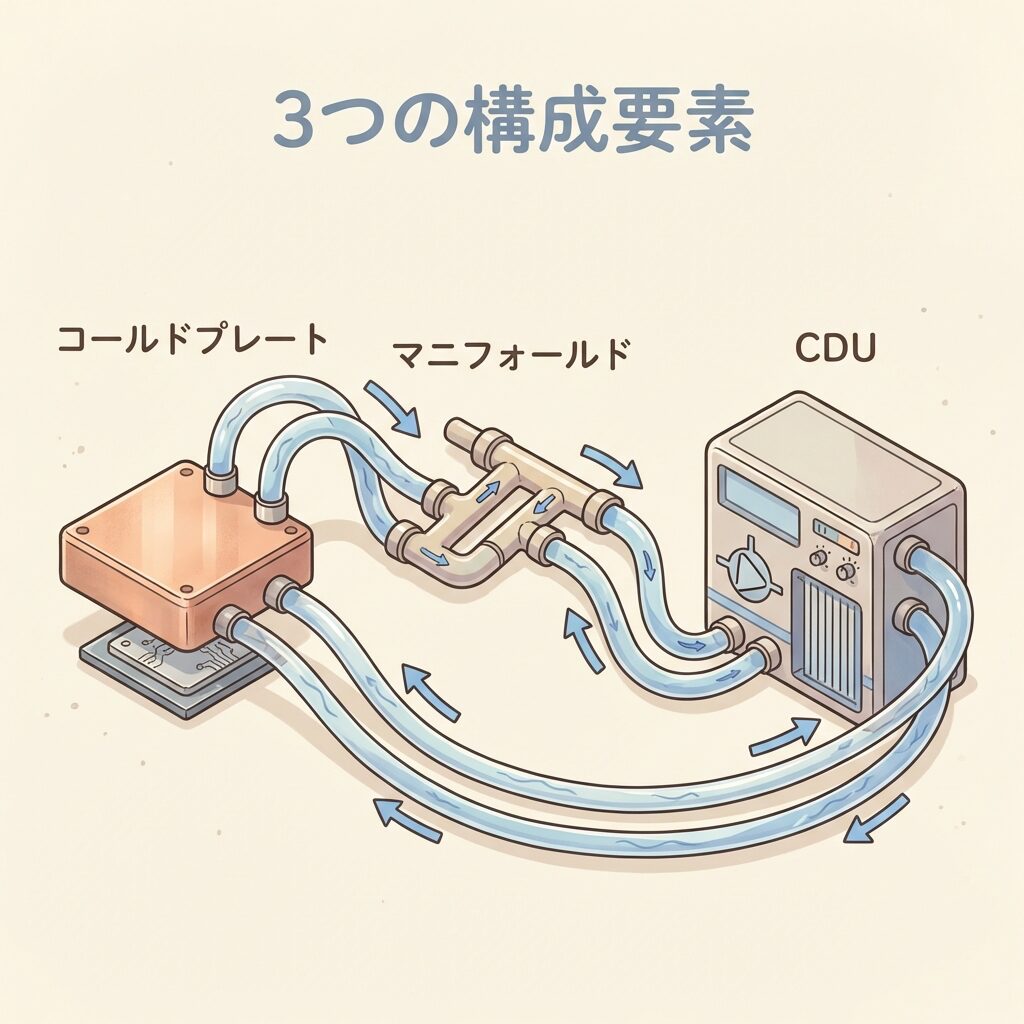

🧩 DLCシステムの「3つの構成要素」

DLCのシステムは、コールドプレート・マニフォールド・CDUの3つで構成されます。この3つが連携することで、チップの熱を液体に移し、液体の熱を施設外に排出するサイクルが完成します。

内部を冷却液が流れ、

チップの熱を「吸い取る」接点

CDUから来た冷却液を

各サーバーのコールドプレートに分配

冷却液の温度・流量を制御する

「液冷システムの心臓部」

GPUやCPUの上に直接取り付ける銅やアルミ製の金属板。内部に冷却液が流れる微細な通路(マイクロチャネル)があり、チップの熱を液体に受け渡す「冷やす接点」。1枚のコールドプレートで最大4,000W以上の発熱を処理できる製品もある。

冷却液の温度・流量・圧力を制御し、各サーバーに分配する装置。「一次側」(施設のチラーからの冷水)と「二次側」(サーバー側の冷却液)の間で熱交換を行う。DLCシステムの中核であり、1台で複数ラックをカバーするものもある。

冷却液の流れ──5ステップで「チップの熱が消える」まで

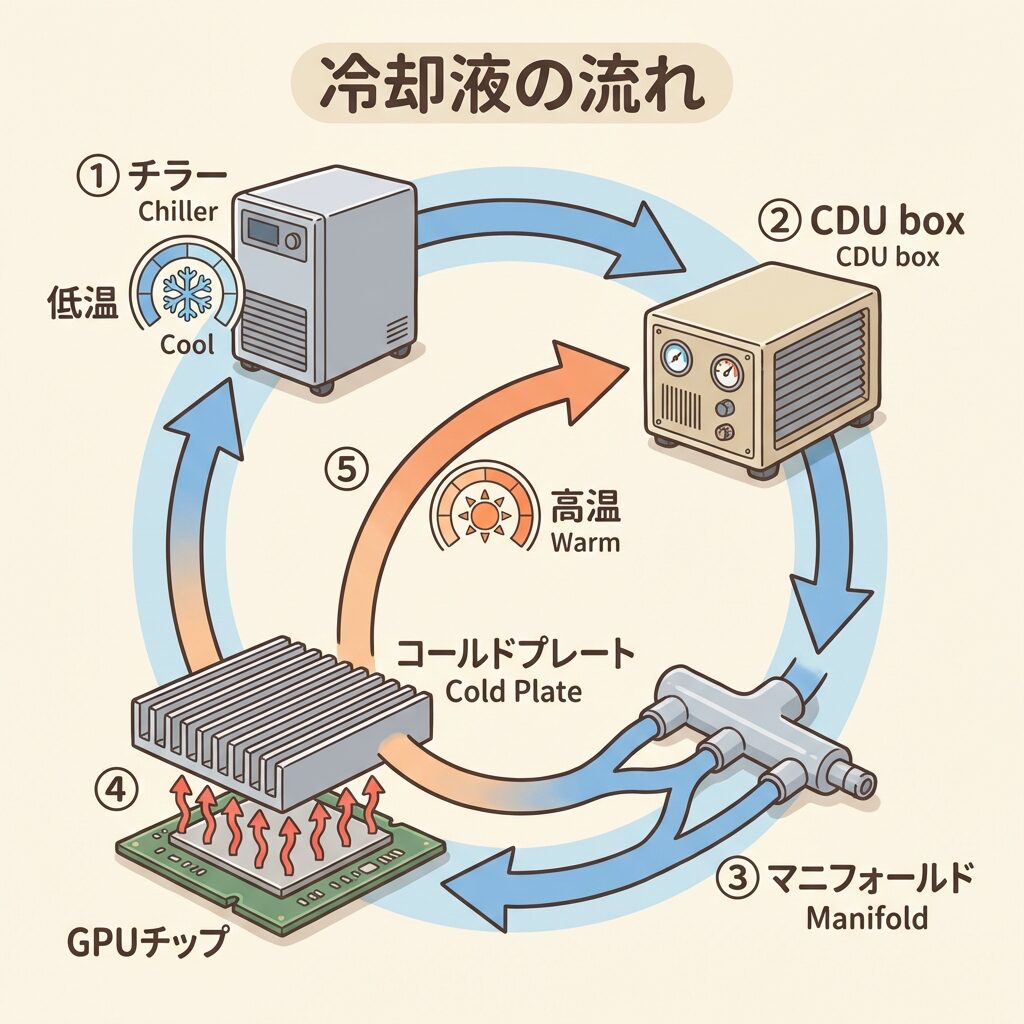

🔄 チラー → CDU → マニフォールド → コールドプレート → 戻る

DLCで冷却液がどう流れるのか、5ステップで追ってみましょう。一度この流れを頭に入れると、「DLCの仕組み」が丸ごと理解できます。

チラー(冷凍機)や冷却塔で冷たい水(一次冷水)を作る。温度は約15〜25℃程度。この水はCDUまで配管で送られる。

CDU内の熱交換器で、一次冷水と二次冷却液(PG25など)が熱交換。二次冷却液が冷やされ、サーバー側に送られる。一次側と二次側は水が混じらない構造。

ラック内のマニフォールド(分配パイプ)を通じて、冷却液が各サーバーのコールドプレートに分配される。OCP規格のUQDカプラー(ワンタッチ着脱・漏水防止機構付き)で接続。

コールドプレートがGPU/CPUの表面に密着し、チップの熱を冷却液に直接受け渡す。冷却液が温まる。1枚のGPUで1,000W超の発熱を処理。

温まった冷却液が配管を通ってCDUに戻り、再び冷やされて循環する。この閉じたループが24時間365日回り続ける。

プロピレングリコールを約25%含む水溶液。DLCの二次側(サーバー側)で最も広く使われる冷却液。防錆・防食性が高く、サーバー機器に対する安全性が確保されている。水と違って凍結しにくく、腐食のリスクも低い(出典:IIJ)。

Universal Quick Disconnect。OCP(Open Compute Project)が定めた液冷配管の着脱規格。ワンタッチで接続・切断ができ、着脱時の漏水防止機構が組み込まれている。サーバーの保守時に「配管を外す→液漏れする」という問題を解決する業界標準部品。

CDUの一次側(施設冷水)と二次側(サーバー冷却液)が分離されている理由は2つあります。①施設の水道水がサーバー内部に入るのを防ぐ(水質管理の分離)。②万が一サーバー側で漏水しても、施設全体の冷却インフラに影響しない(リスクの隔離)。この設計は、自動車のエンジン冷却と暖房がラジエーターで分離されているのと同じ発想です。

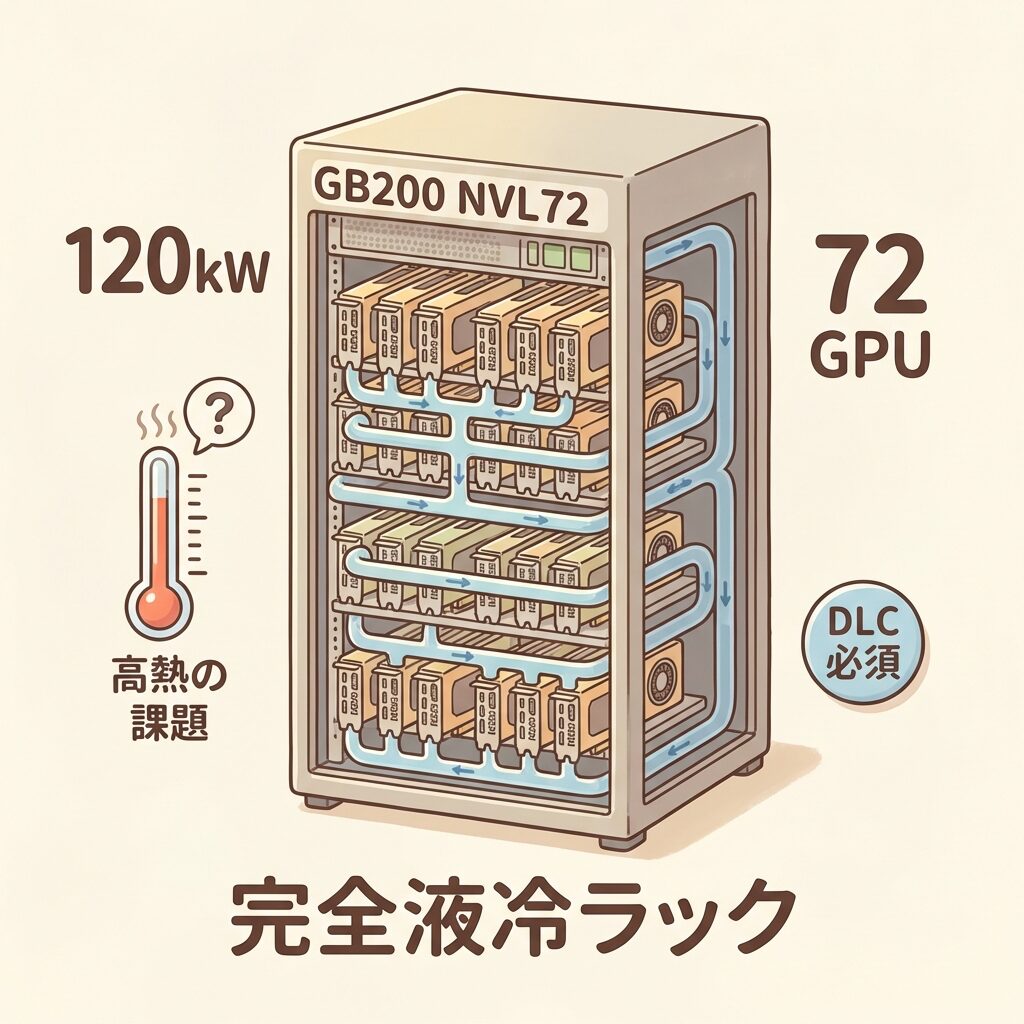

NVIDIA GB200 NVL72での実装──「完全液冷ラック」の中身

🖥️ 120kWのラックを冷やす──空冷では不可能な領域

DLCが「理論的な技術」ではなく「今そこにある現実」であることを最もよく示しているのが、NVIDIAのGB200 NVL72です。このラックスケールシステムは、72基のBlackwell GPUと36基のGrace CPUを1つのラックに搭載し、消費電力は約120kW。空冷の限界(約20kW)の6倍を超える発熱を処理するため、完全液冷(DLC)設計が採用されています(出典:NVIDIA公式)。

Supermicroによれば、最新のDLC技術はサーバーコンポーネント(CPU、GPU、PCIeスイッチ、DIMM、VRM、PSU)が発する熱の最大92%をDLCで処理でき、空冷と比較して最大40%の電力コスト削減を実現するとしています(出典:Supermicro公式)。

GB200 NVL72は「超高層マンション1棟分の電気を使う工場が、1つのラック(約2m×0.6mの棚)に収まっている」状態です。このラックが出す熱は電気ストーブ120台分。エアコン(空冷)で冷やそうとすれば台風レベルの風が必要──だから液体で直接冷やすDLCが「必須」なのです。

【完全図解】GPUラックとは?「高密度化」でデータセンターが変わる理由 →

GB200 NVL72の1.36トン・120kWの衝撃を詳しく解説。なぜDLCが必須になったか、ラック視点で理解できます。

DLCの「70:30問題」──なぜ空冷も併用するのか

🔀 チップ以外の部品は「液冷では冷やせない」

DLCはGPUやCPUの冷却には絶大な効果を発揮しますが、サーバー内にはコールドプレートが取り付けられない部品もあります。メモリ(DIMM)、ネットワーク機器、ストレージドライブなどです。

IIJの解説によれば、DLCで冷却できるのは全発熱の約70%(チップ部分)であり、残り約30%はネットワーク機器やメモリなどの空冷で処理する「ハイブリッド構成」が現実的な標準です(出典:IIJ)。

・GPU(最大の発熱源)

・CPU

・PCIeスイッチ

・VRM(電圧レギュレーター)

→ コールドプレートが取り付けられる高発熱部品

・メモリ(DIMM)

・ネットワークカード(NIC)

・ストレージドライブ

・その他の基板上コンポーネント

→ コールドプレートが物理的に付けられない小型部品

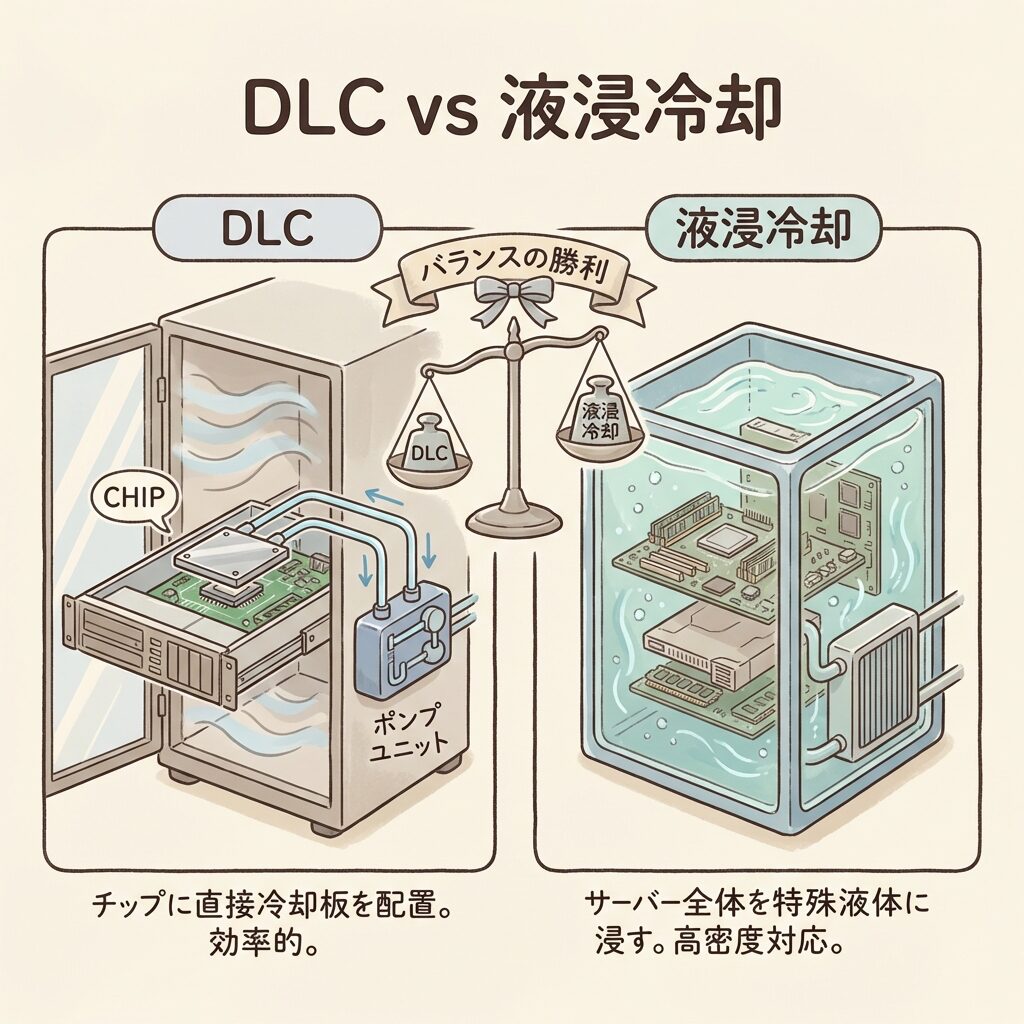

DLC vs 液浸冷却──6項目で比較

「DLCと液浸冷却、どっちが優れているの?」──答えは「用途による」です。以下の比較表で、両者のトレードオフを整理しましょう。

| 比較項目 | 🔧 DLC(直接液冷) | 🛁 液浸冷却 |

|---|---|---|

| 冷やし方 | チップ上のコールドプレートで局所冷却 | 基板ごと冷却液に沈めて全面冷却 |

| PUE目安 | 1.03〜1.15 | 1.01〜1.05 |

| 空冷の併用 | 必要(液冷~70%:空冷~30%) | 基本不要 |

| メンテナンス性 | 比較的容易(UQDで着脱) | 引き上げ・乾燥が必要 |

| サーバーの保証 | NVIDIA GPUラックがDLC前提設計。保証問題が小さい | 多くのOEMが保証対象外。専用サーバーが必要 |

| 現在の主流度 | AI DCの主流 ★ | 実証〜一部導入 |

DLCが主流である理由は「冷却効率が最高だから」ではなく、「冷却効率×運用のしやすさ×保証の安定性」のバランスが最も良いからです。液浸冷却はPUEで勝りますが、メンテナンス・保証・冷却液の壁がある。DLCはPUEでは若干劣るものの、NVIDIAの主力GPUラックがDLC前提で設計されているため、エコシステム全体が整っているのです。

DLC導入を検討するときの5つのチェックポイント

投資家:DLCは今のAI DCの「主流の冷却技術」です。DLC市場は2025年の約22.8億ドルから2030年に56.2億ドル(CAGR 19.7%)に成長する見通し(出典:Grand View Research)。CDUメーカー(ニデック・カンネツ等)、配管部品(三桜工業・CEJN)、DLC対応サーバー(Supermicro・HPE・Dell)がサプライチェーンの注目銘柄。

学生:DLCの設計には配管工学、流体力学、熱伝達、金属加工の知識が必要。「AI=情報系」ではないことがDLCの構造を見れば明白。機械系・材料系の学生にとって、AIインフラへのキャリアパスを開くテーマ。

技術者:配管施工、冷却液の水質管理、CDU運用保守、漏水対策──DLCの運用を支えるのは設備系・機械系の実務スキル。空冷DCの運用経験に加えて液冷の専門知識を持つ技術者は、業界で最も不足している人材。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「DLCを入れれば空冷は不要」 | DLCで冷やせるのは全発熱の約70%(チップ部分)。メモリやNICなどの残り~30%には空冷が必要。ハイブリッド構成が標準。ただしHPEの100%ファンレスDLCのような次世代技術も登場。 |

| 「DLCは水漏れが怖い」 | OCP規格のUQDカプラー(ワンタッチ着脱・漏水防止機構付き)の普及でリスクは大幅に低減。漏水検知センサーの設置も標準化が進んでいる。リスクはゼロではないが、管理可能なレベル。 |

| 「DLCは新しい技術でまだ不安定」 | スーパーコンピューターの世界では何十年もの水冷運用実績がある。富士通は40年のスパコン水冷経験を持つ。AI DCでの大規模採用は2022年以降だが、技術自体は十分に成熟している。 |

| 「既存の空冷DCにDLCを後付けすればいい」 | 配管インフラ(給排水・CDU設置・防水処理)が必要で、既存空冷DCへの後付けは大規模改修になる。IIJの白井DC3期棟のように「水冷Ready設計」で新築するほうが現実的。 |

| 「液浸冷却のほうがDLCより優れている」 | PUEでは液浸冷却が上だが、メンテナンス性・保証・冷却液供給ではDLCが大幅に有利。NVIDIAの主力GPUラックがDLC前提で設計されており、エコシステム全体の成熟度でDLCが圧倒的にリード。 |

まとめ:DLC(直接液冷)の全体像

① DLCとは:GPU/CPUのチップ表面にコールドプレートを密着させ、冷却液で熱を直接吸収する方式。AIデータセンターで現在最も普及している液冷技術。

② 3つの構成要素:コールドプレート(チップの熱を吸い取る接点)、マニフォールド(ラック内の分配パイプ)、CDU(冷却液の温度・流量を制御する心臓部)。

③ 冷却液の流れ:チラー→CDU(一次側と二次側で熱交換)→マニフォールド→コールドプレート(チップの熱を吸収)→CDUに戻る、の循環。

④ NVIDIA GB200での実装:120kWのラックを完全液冷で処理。最新技術では発熱の最大92%をDLCで処理可能。空冷では物理的に不可能な領域。

⑤ 70:30問題:DLCで冷やせるのはチップ部分(~70%)のみ。残り~30%はメモリ・NIC等で空冷が必要。ハイブリッド構成が標準。ただし100%ファンレスDLCも登場。

⑥ 液浸冷却との比較:PUEでは液浸冷却が上だが、メンテナンス性・保証・エコシステムの成熟度でDLCが圧倒的優位。「現時点のベストバランス」がDLC。

⑦ 導入の5つのチェック:配管インフラ、CDU設置、ハイブリッド設計、漏水対策、運用チームの専門性。

結局こういうことです。DLCは「冷却効率の世界チャンピオン」ではありません。それは液浸冷却です。しかしDLCは「冷却効率×運用のしやすさ×サーバーメーカーの保証×NVIDIAエコシステムとの整合性」のバランスが最も良い。だからAIデータセンターの主流になった。技術の「最高性能」ではなく「最高のバランス」が産業の標準を決める──これがDLCから学べる構造です。

❓ よくある質問(FAQ)

📚 次に読むべき記事

DLCの「ライバル」液浸冷却を深掘り。PUE 1.05の威力と普及を阻む壁を理解する。

DLCの「前提知識」として。リアドア・DLC・液浸冷却の3方式を俯瞰する全体像の記事。

「そもそもなぜ空冷ではダメなのか」を理解する。DLCが必要になった背景がわかる。

GB200 NVL72の120kWの衝撃。DLCが必須になった「ラック視点」の理由を理解する。

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント