「液冷」「DLC」「液浸冷却」「水冷」──AIデータセンターの記事を読んでいると、似たような言葉がたくさん出てきて混乱しませんか?

- 「液冷」と「水冷」って同じもの? 違うもの?

- DLC(Direct Liquid Cooling)って何の略? 何をする技術?

- 「液浸冷却」ってサーバーを液体に沈めるの? 壊れないの?

- リアドア方式・DLC方式・液浸冷却、結局どう違うの?

- 自分が読むべき記事がどれかわからない──まず液冷の全体像が欲しい

- 「液冷」の意味と全体像──液冷は「総称」である

- 液冷の3つの主要方式(リアドア・DLC・液浸冷却)の仕組みを図解

- DLCと液浸冷却の決定的な違いを7項目で比較

- 「水冷」と「液冷」と「液浸」の用語の関係を整理

- ラック電力密度別の冷却方式の選択マップ

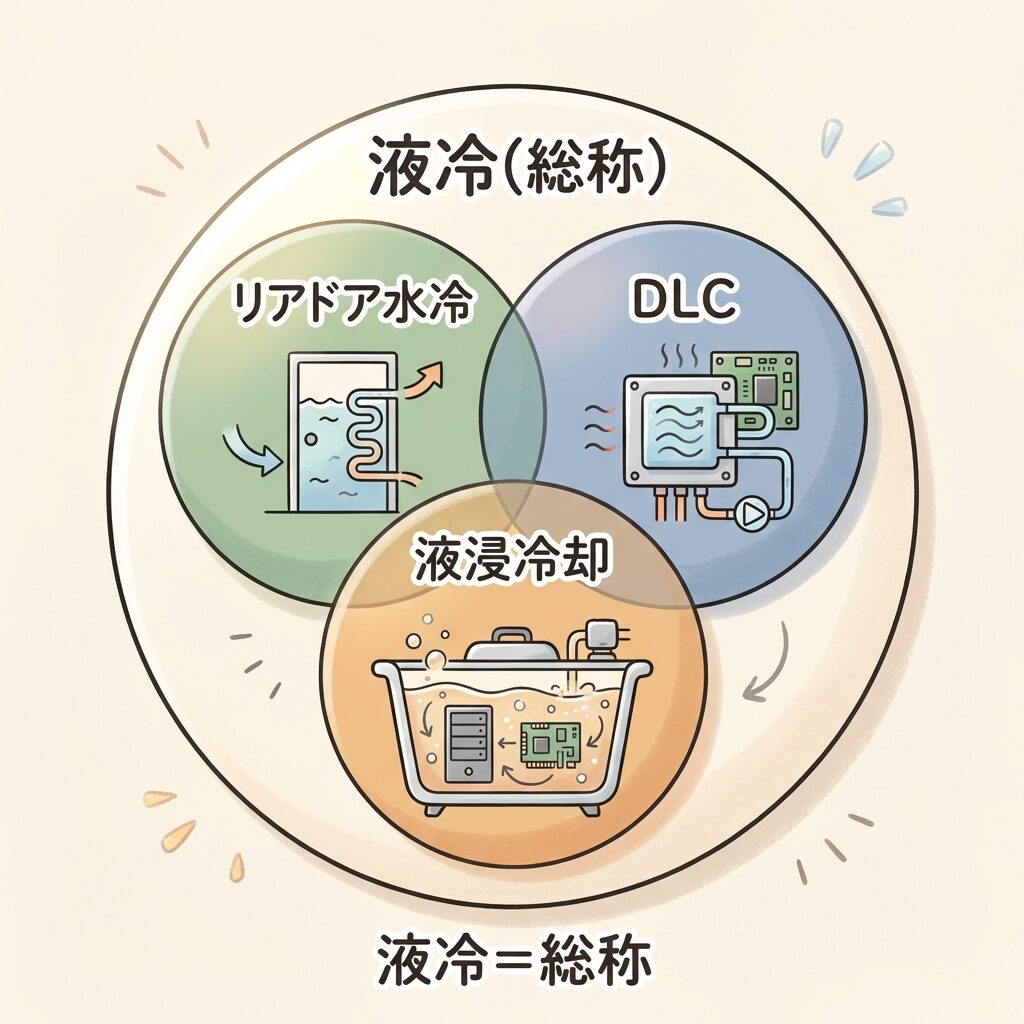

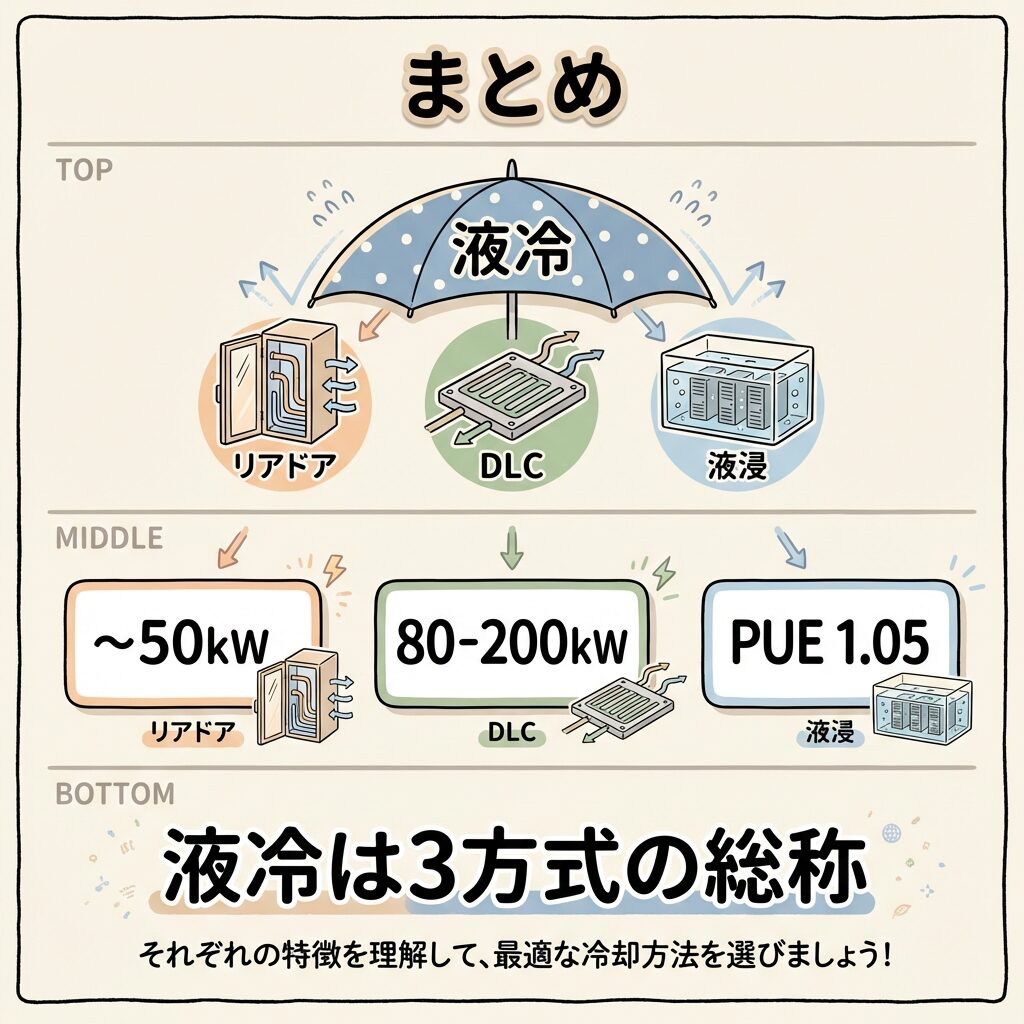

「液冷」とは、液体を使ってサーバーの熱を冷やす技術の総称です。その中に「リアドア水冷」「DLC(直接液冷)」「液浸冷却」の3つの方式があります。それぞれ冷却能力が異なり、リアドアは最大約50kW、DLCは80〜200kW以上、液浸冷却はさらに高密度に対応します(出典:日経クロステック)。「水冷」は日本でよく使われる呼び方で、液冷とほぼ同義です。この記事を読めば、「液冷」という大きな傘の下にある3つの方式の違いが整理でき、次にどの記事を読めばいいかがはっきりわかります。

前回の記事(空冷と液冷の違いとは?)では、空冷の限界と液冷が必要になった理由を解説しました。この記事はその続きとして、液冷の「中身」を深掘りします。「液冷って結局いくつ種類があるの?」という疑問に、図解と比較表で答えていきます。

液冷とは?──まず「液冷=総称」を理解する

💧 液冷は「1つの技術」ではなく「方式の総称」

最初に、最も大事なポイントを押さえましょう。「液冷」は1つの具体的な技術を指す言葉ではなく、液体を使う冷却方式の総称です。

「液冷」は「乗り物」のような言葉です。「乗り物」と言っても自転車、自動車、電車がありますよね。同じように「液冷」と言っても、中にリアドア水冷、DLC、液浸冷却という別々の方式がある。それぞれ仕組みも冷却能力もまったく違います。

IIJの解説によれば、液冷方式には大きく「Direct Liquid Cooling(DLC)」と「液浸冷却(Immersion Cooling)」の2つがあります(出典:IIJ)。これにリアドア水冷を加えた3方式が、現在のデータセンターで使われる液冷の主な形です。

🗂️ 液冷方式の系統図──全体像を先に見せる

間接的に冷却

最大 ~50kW

直接冷却

80~200kW以上

全面冷却

超高密度対応

冷却能力の目安は 日経クロステック を参考に構成

📖 「水冷」「液冷」「液浸」──用語の関係を整理

ニュースを読んでいると「水冷」「液冷」「液浸」が入り混じって使われますが、その関係は以下のように整理できます。

水冷:日本でよく使われる呼び方。液冷とほぼ同義。ただし冷却液は「水」とは限らない場合も。

DLC(Direct Liquid Cooling):チップに冷却板を取り付けて液体で冷やす方式。液冷の一種。

液浸冷却(Immersion Cooling):基板ごと冷却液に沈める方式。液冷の一種。

リアドア水冷:ラック背面に水冷パネルを付ける方式。間接的な液冷。

方式① リアドア水冷──最も手軽に導入できる液冷

🚪 サーバーラックの背面に「水冷パネル」を取り付ける方式

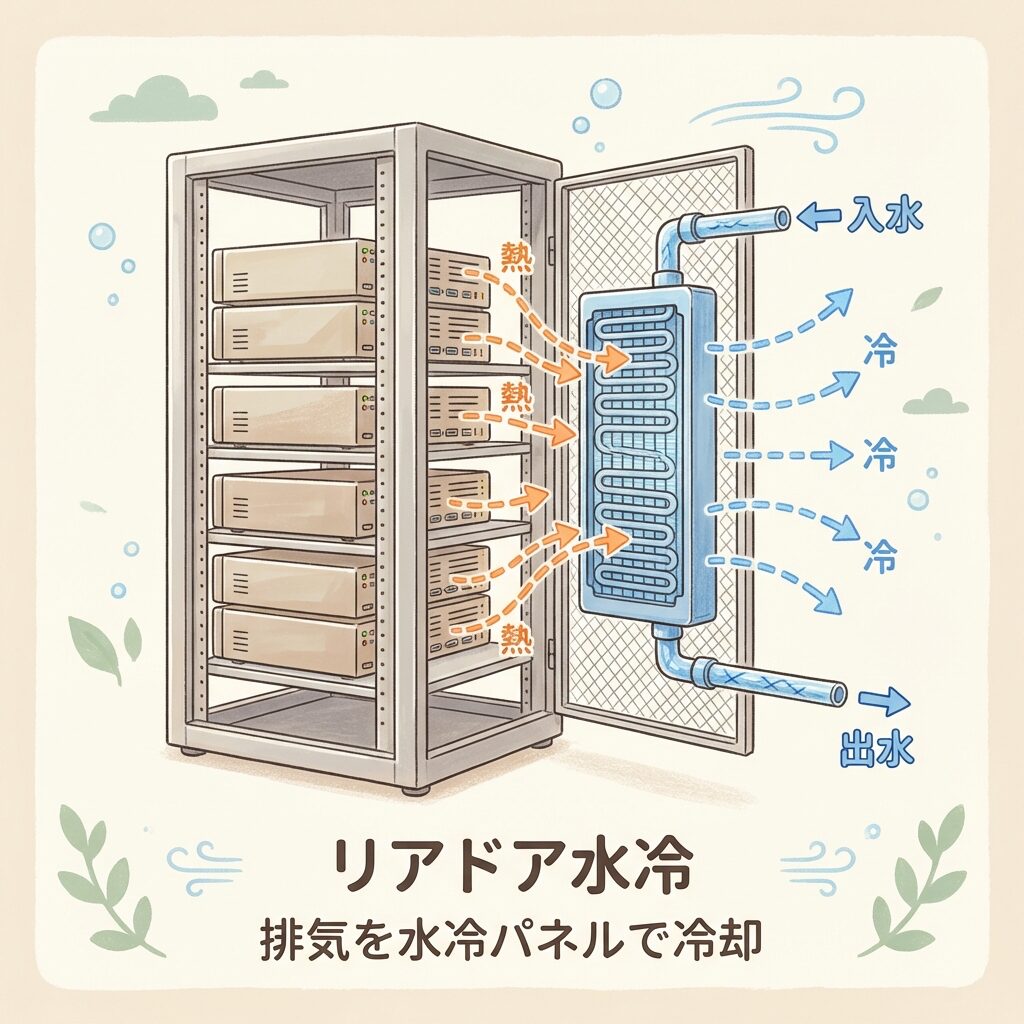

リアドア水冷(Rear Door Heat Exchanger:RDHX)は、サーバーラックの背面ドアに水冷の熱交換器を取り付けて、排気される温かい空気を冷やす方式です。サーバーそのものには手を加えず、ラックの「ドア」を交換するだけで導入できます。

リアドア水冷は「扇風機の前に濡れタオルを掛ける」イメージです。風(排気)が濡れタオル(水冷パネル)を通過するときに冷やされる。サーバー自体はそのまま使えるので、最も手軽な液冷の入口です。

改造不要

から排出

熱交換器

or排出

サーバー自体は空冷のまま。排気が水冷パネルを通過するときに冷やされる「間接的な液冷」。

サーバーラックの背面に取り付ける水冷式の熱交換器。冷水を流すことで排気の熱を吸収し、室内に戻す空気の温度を下げます。NTTファシリティーズの「CyberAir® リアドア型」などが代表的な製品です。

✅ メリット

・サーバー改造不要(空冷サーバーをそのまま使える)

・既存ラックへの後付けが可能

・工期が短く、段階導入しやすい

・導入コストが他の液冷方式より低い

⚠️ デメリット

・冷却能力は最大約50kW/ラックが上限

・チップを直接冷やすわけではないので効率に限界

・GB200 NVL72(120kW)などの最新GPUラックには非対応

・空調電力の削減効果はDLCほど大きくない

方式② DLC(直接液冷)──AI時代に最も普及が進む方式

🔧 チップの上にコールドプレートを付けて「直接」冷やす

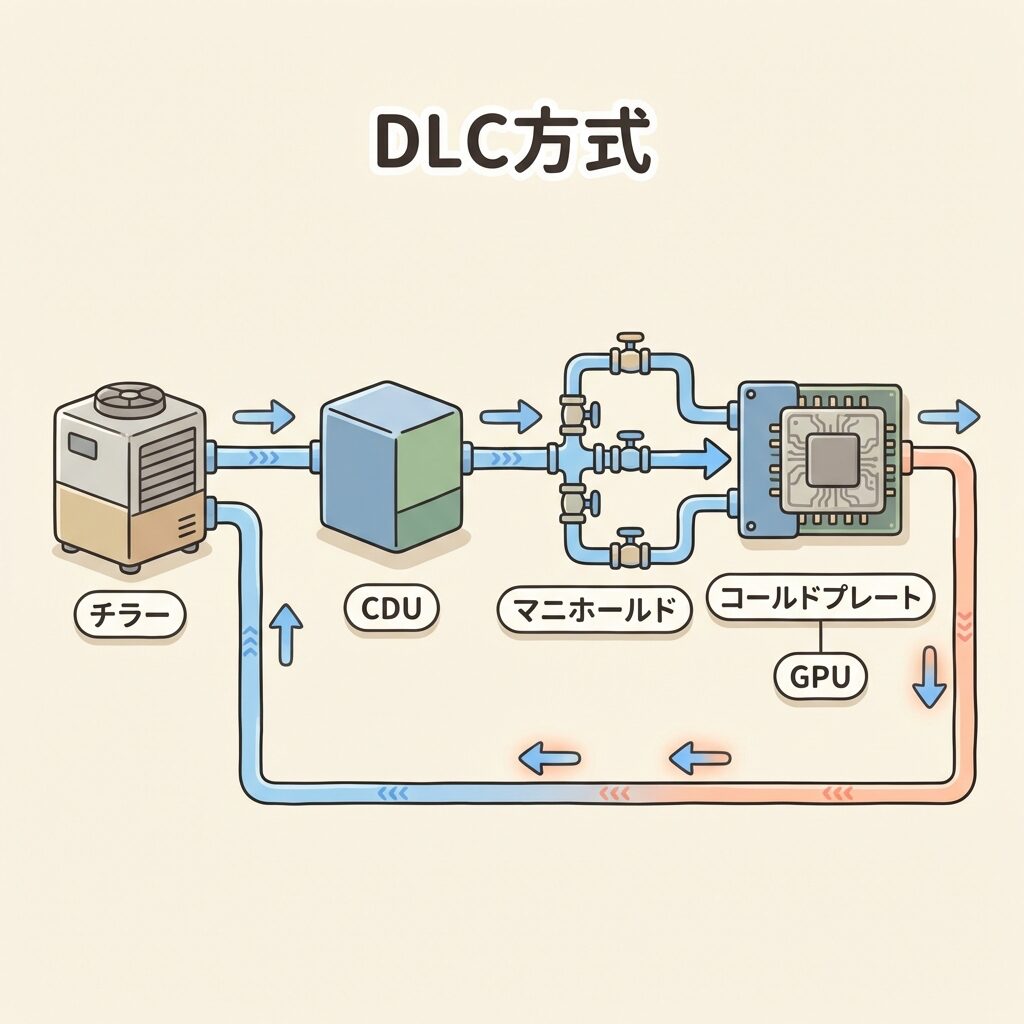

DLC(Direct Liquid Cooling:直接液冷)は、GPUやCPUのチップ上に「コールドプレート」と呼ばれる冷却板を取り付け、その内部に冷却液を流してチップの熱を直接吸収する方式です。NVIDIAのGB200 NVL72をはじめとする最新のGPUラックは、このDLC方式を前提に設計されています。

DLCは「熱い鉄板の上に氷水の入ったパイプを直接くっつける」イメージです。リアドアが「部屋の排気を冷やす」間接的な方式だったのに対し、DLCは熱源に直接触れて冷やす。だから冷却効率が段違いに高いのです。

🔄 DLCの冷却液が流れる経路を図解

熱源機器(チラー等)で冷たい液体を生成。温度は約15〜25℃程度。

水配管を通ってCDU(冷却液分配ユニット)に供給。CDUが温度・流量を制御。

CDUからラック内のマニフォールドを経由して、各サーバーのコールドプレートに液体が到達。

コールドプレートがGPU/CPUの熱を吸収。液体が温まる。

温まった液体が逆の経路で熱源機器に戻り、再び冷やされて循環。

ラック内に設置される「分配パイプ」。CDUから送られた冷却液を、各サーバーのコールドプレートに分配します。OCP規格のUQDカプラー(ワンタッチ着脱・漏水防止機構付き)が標準的に使われています。

DLCのCDU二次側(サーバー側)で多く使われる冷却液。プロピレングリコールを約25%含む水溶液で、防錆・防食性が高く、サーバー機器に対する安全性が確保されています。

DLCはGPU/CPUチップを液冷で冷やしますが、サーバー内のメモリやネットワーク機器など液冷対応していない部品は空冷で冷やす必要があります。IIJの実証では、液冷と空冷の比率は7:3がハイブリッド構成の目安です(出典:IIJ)。

方式③ 液浸冷却──サーバーを丸ごと冷却液に沈める

🛁 基板ごと冷却液に浸す「最も冷却効率が高い方式」

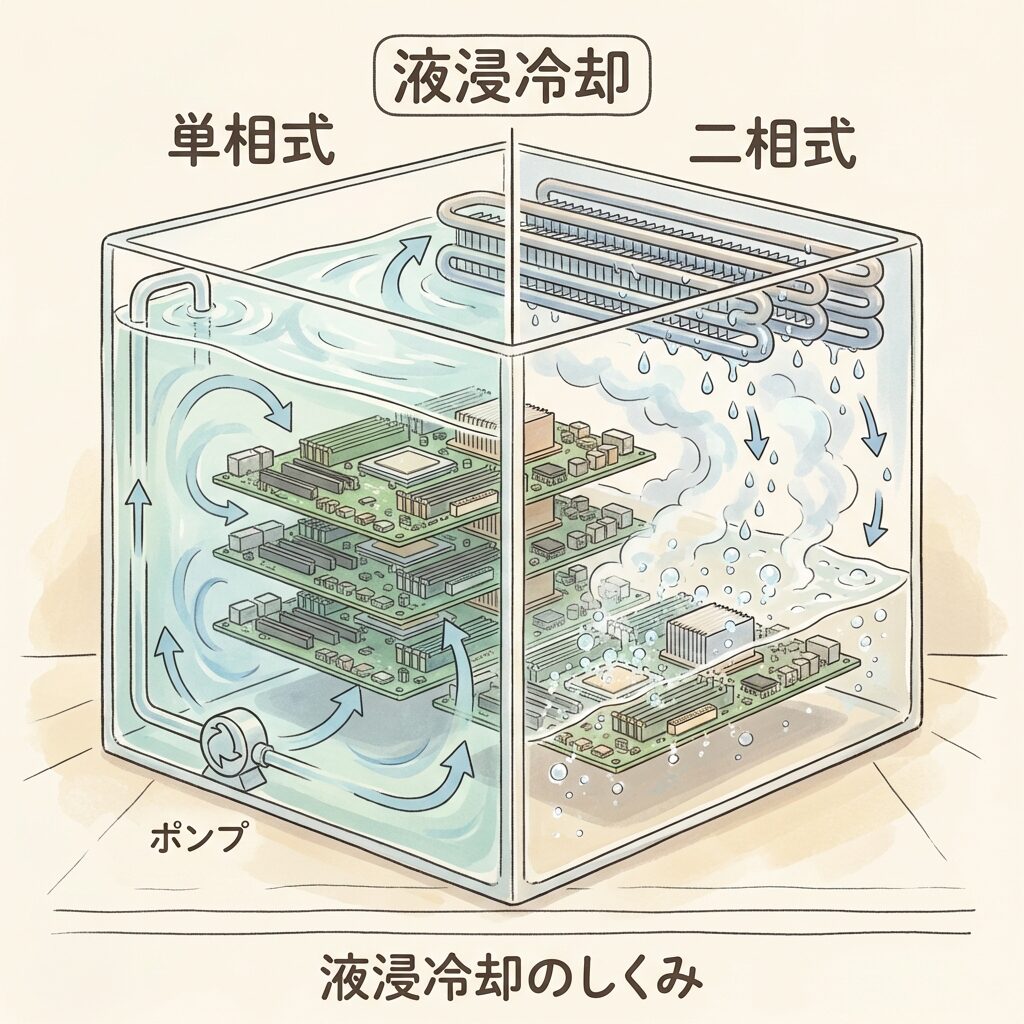

液浸冷却(Immersion Cooling)は、サーバーの基板を絶縁性の冷却液に丸ごと沈めて冷やす方式です。チップだけでなく、基板上のすべての部品が液体に触れるため、冷却効率は液冷方式の中で最も高くなります。KDDIの実証実験ではPUE 1.05を達成し、冷却電力を94%削減しています。

液浸冷却は「熱い機械を冷たいお風呂に丸ごと入れる」イメージです。「壊れないの?」と思いますよね。使われるのは電気を通さない特殊な冷却液なので、基板が浸かっていてもショートしません。ENEOSが開発した「ENEOS IXシリーズ」はその代表例です。

🔄 液浸冷却の仕組み──単相式と二相式

液浸冷却には「単相式」と「二相式」の2タイプがあります。

単相式

冷却液が常に液体のまま循環。サーバーの熱で温まった冷却液をCDUで冷やして戻す。

メリット:構造がシンプル、管理しやすい

冷却液例:ENEOS IXシリーズ(植物由来オイル)

二相式

冷却液がチップの熱で沸騰→蒸気→冷却コイルで凝縮→液体に戻るサイクル。相変化の潜熱を利用するため冷却効率が最高。

メリット:冷却能力が最も高い

課題:冷却液が高価、システムが複雑

⚠️ 液浸冷却の課題

冷却効率は最高ですが、液浸冷却にはDLCにはない独自の課題があります。

・専用の液浸装置が必要:従来のサーバーラックは使えない

・メンテナンス性:保守時にサーバーを液体から引き上げる必要がある(冷却液が落ちきるまで待機)

・専用サーバーが必要:液浸に対応したサーバー設計が求められる

・ケーブルの制約:液浸装置内では一般的な光ケーブルが使えない場合がある

・搭載密度:同じ床面積ではサーバーラックより搭載台数が少なくなりがち

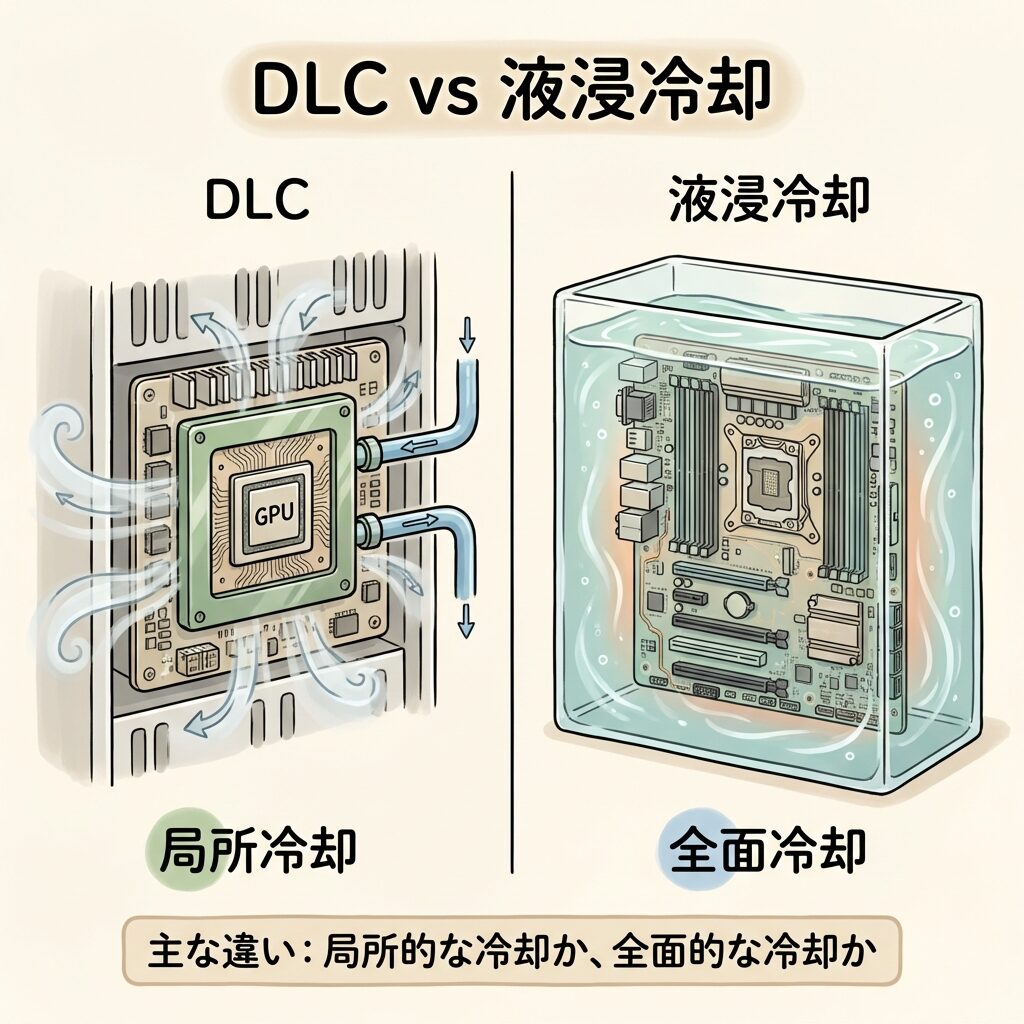

DLC vs 液浸冷却 ── 7項目の比較で違いを整理

DLCと液浸冷却は「どちらが優れているか」ではなく、用途と条件に応じて選ぶものです。以下の比較表で、両者の違いを7つの観点から整理しましょう。

| 比較項目 | 🔧 DLC(直接液冷) | 🛁 液浸冷却 |

|---|---|---|

| 冷やし方 | チップ上のコールドプレートに冷却液を流して局所的に冷却 | 基板ごと冷却液に沈めて全面を冷却 |

| 冷却能力 | 80〜200kW以上/ラック | 超高密度対応(理論上はDLC以上) |

| PUE目安 | 1.03〜1.15 | 1.01〜1.05(最高効率) |

| 空冷との併用 | 必要(液冷7:空冷3が目安) | 基本不要(全面が液体に浸かるため) |

| サーバーの互換性 | 既存ラックに導入可能(コールドプレート対応サーバーが必要) | 専用設備・専用サーバーが必要 |

| メンテナンス | 配管・CDU・冷却液の管理が必要。サーバーへのアクセスは比較的容易 | 保守時にサーバーを液体から引き上げる必要あり。冷却液付着の乾燥待ちも発生 |

| 現在の普及度 | 最も普及が進んでいる。NVIDIAの主要GPUラックはDLC前提 | 実証〜一部導入段階。次世代の超高密度対応として注目 |

PUE目安は各冷却方式の実績値および PUE分析レポート を参考に構成。冷却能力は 日経クロステック を参考。

現在のAIデータセンターの「主流」はDLCです。GB200 NVL72など最新GPUラックはDLC方式で設計されており、実運用の実績も増えています。液浸冷却はPUE効率で最高ですが、メンテナンス性やサーバー互換性の課題があり、現時点では「次の一手」として研究開発が進んでいる段階です。NVIDIAはDLCと液浸冷却を融合させたGPUサーバーの開発も進めています(出典:IIJ)。

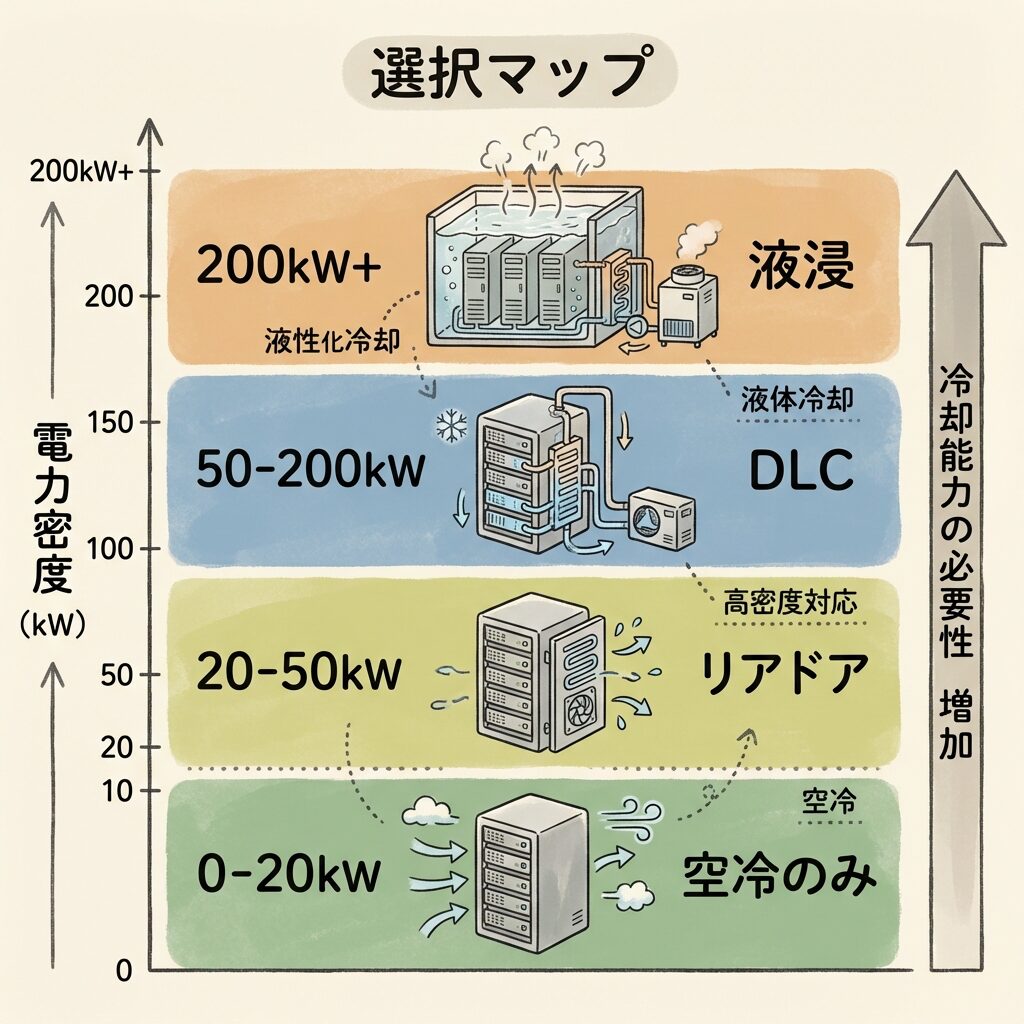

3方式を一覧比較+冷却方式の選択マップ

📊 リアドア・DLC・液浸冷却の一覧比較

| 比較項目 | 🚪 リアドア水冷 | 🔧 DLC | 🛁 液浸冷却 |

|---|---|---|---|

| 冷やし方 | 排気を水冷パネルで間接冷却 | チップにコールドプレートで直接冷却 | 基板ごと冷却液に浸漬 |

| 冷却能力 | 最大 ~50kW | 80〜200kW以上 | 超高密度対応 |

| サーバー改造 | 不要 | コールドプレート対応が必要 | 液浸専用サーバーが必要 |

| 導入コスト | 低い | 中〜高い | 高い |

| PUE目安 | 1.2〜1.4 | 1.03〜1.15 | 1.01〜1.05 |

| 向いている場面 | 既存DCの段階的なアップグレード | AI対応の新設DC(現在の主流) | 次世代の超高密度AI基盤 |

🗺️ 冷却方式の選択マップ──ラック電力密度で選ぶ

冷却方式の選択は「最も高性能なものを選ぶ」のではなく、ラック電力密度・導入コスト・運用体制のバランスで決まるものです。50kW以下ならリアドアで十分、50kW超ならDLC、次世代の超高密度なら液浸冷却──という段階的なアプローチが現実的です。

あなたにとっての意味 ── 投資家・学生・技術者の視点

投資家:液冷の3方式それぞれに異なる企業が関わっています。リアドア(NTTファシリティーズ)、DLC用CDU(ニデック、カンネツ)、DLC用配管(三桜工業)、液浸冷却液(ENEOS)。GPU世代が進むたびに上位方式への移行が起き、冷却関連企業への需要は構造的に拡大します。

学生:DLCには配管・流体力学・熱交換の知識が、液浸冷却には材料科学・化学の知識が必要です。「AI=情報系」ではない──液冷技術の3方式を知ることで、機械・化学・材料系がAI産業にどう直結するかが見えてきます。

技術者:CDUの運用管理、配管施工、冷却液の水質管理、漏水対策──これらはソフトウェアエンジニアには担えない仕事です。3方式の違いを理解すれば、あなたの専門がどの方式で最も活きるかがわかります。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「液冷=1つの技術」 | 液冷は総称。中にリアドア水冷・DLC・液浸冷却の3方式がある。冷却能力も導入難易度もまったく異なる。 |

| 「DLCと液浸冷却は同じようなもの」 | DLCはチップにコールドプレートを付けて局所冷却、液浸は基板ごと冷却液に沈めて全面冷却。仕組みも設備要件もまったく違う。 |

| 「液浸冷却が最強だから全部液浸にすべき」 | 液浸冷却はPUE効率で最高だが、専用サーバー・メンテナンス性・コストの課題がある。現時点の主流はDLC。用途に応じた使い分けが正解。 |

| 「水冷と液冷は違う技術」 | 日本では「水冷」と「液冷」はほぼ同義で使われる。ただし液浸冷却ではフッ素系の冷却液を使うため、厳密には「水」冷ではない場合もある。 |

| 「液冷を入れればサーバー室に空冷は不要」 | DLCの場合、液冷で冷やせるのは全発熱の約70%。ネットワーク機器等は空冷が引き続き必要。ハイブリッド構成が現実解。 |

まとめ:液冷方式の全体像

① 液冷=総称:液体を使う冷却技術の総称。「水冷」はほぼ同義の日本語表現。

② 3つの方式:リアドア水冷(間接冷却・~50kW)、DLC(直接冷却・80〜200kW超)、液浸冷却(全面冷却・超高密度対応)。

③ DLCの仕組み:コールドプレートをチップに取り付け、冷却液で直接熱を吸収。CDUで温度・流量を制御。液冷7:空冷3のハイブリッドが標準。

④ 液浸冷却の仕組み:基板ごと冷却液に沈める。単相式(液体のまま循環)と二相式(沸騰→凝縮サイクル)の2タイプ。PUE 1.05を達成した実績あり。

⑤ 現在の主流はDLC:NVIDIAの最新GPUラックはDLC前提。液浸冷却は次世代の選択肢として研究開発が進行中。

⑥ 選び方はラック電力密度で決まる:20kW以下=空冷、20〜50kW=リアドア、50〜200kW=DLC、200kW超=液浸冷却。

⑦ 日本企業の存在感:CDU(ニデック)、配管(三桜工業)、冷却装置(カンネツ)、冷却液(ENEOS)、空調(ダイキン)が各方式で活躍。

結局こういうことです。「液冷」は1つの技術ではなく、冷却能力の異なる3つの方式の総称です。リアドアは手軽な入口、DLCはAI時代の主流、液浸冷却は次世代の最高効率。GPUの消費電力が世代ごとに増え続ける以上、冷却方式もこの階段を登り続けることになります。液冷の全体像を知ることは、AIインフラの「次の一手」を読むことなのです。

❓ よくある質問(FAQ)

📚 次に読むべき記事

液冷の「前提知識」として。空冷の限界と液冷が必須になった理由を理解できます。

液冷方式ごとのPUEの違いを理解するための基礎知識。冷却効率の「物差し」がわかります。

なぜ液冷が必要なのか──その原因であるGPUラックの120kWという発熱を理解できます。

冷却が電力消費の第2層を占める構造。液冷方式の選択がPUE=電力コストに直結する理由がわかります。

🗺️ 学習ロードマップ上の位置づけ

液冷とは?DLC・液浸冷却の違い(この記事)

HBM(高帯域幅メモリ)とは?── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント