「GPUラック」「高密度データセンター」──AIインフラのニュースで急に目にするようになったこの言葉、こんなふうに感じていませんか?

- そもそも「ラック」って何? サーバーとラックは何が違うの?

- GPUラックが「重い」「熱い」と聞くけど、具体的にどれくらい?

- 「1ラック120kW」と言われても、それが何を意味するのかわからない

- なぜ昔のデータセンターではGPUラックに対応できないの?

- サーバー → ノード → ラックという「入れ子構造」の全体像

- 従来ラックとGPUラックの電力・発熱・重量の比較

- 「1ラックあたり電力容量」が意味すること

- なぜ既存のデータセンターではGPUラックを置けないのか

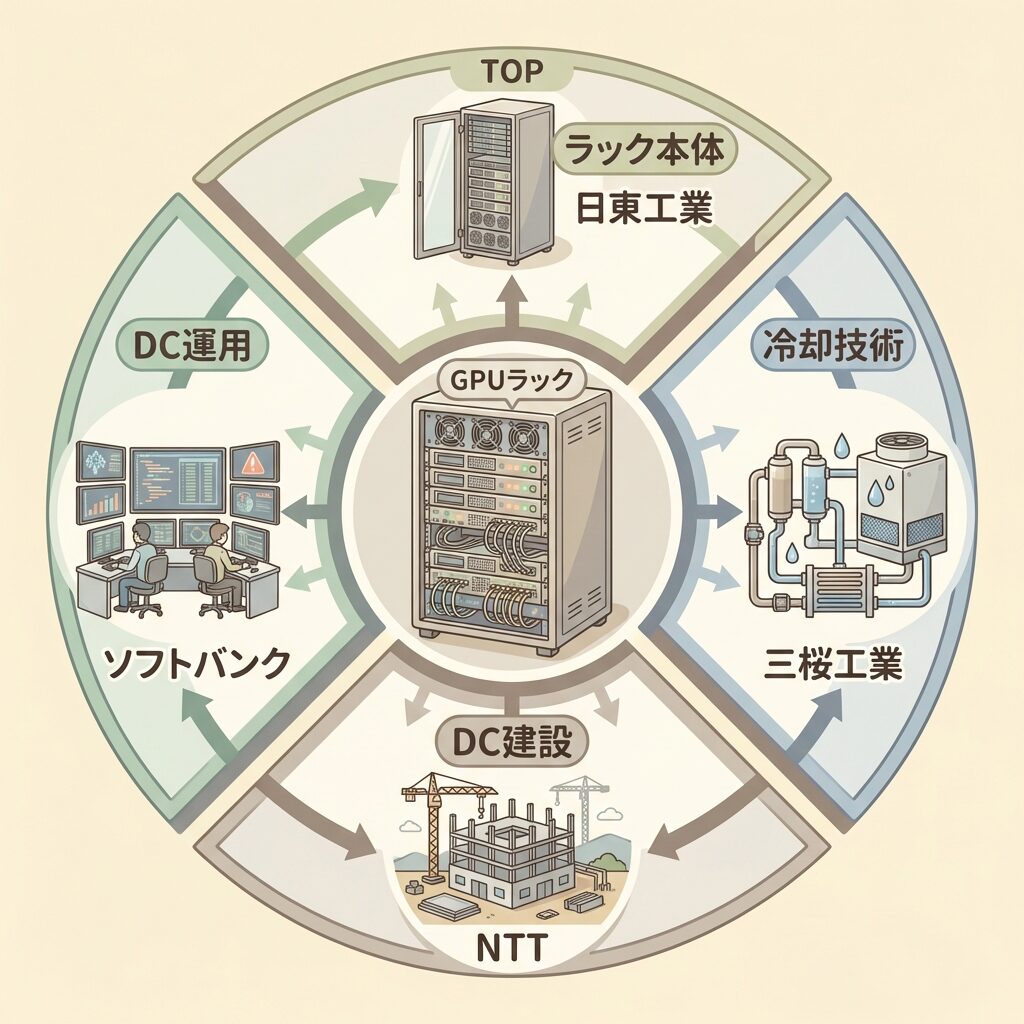

- この変化に関わる日本企業の具体名

GPUラックとは、GPUサーバーを複数台収容するために設計された、高電力・高耐荷重の専用ラックのことです。従来のサーバーラックが1本あたり2〜8kWの電力で済んでいたのに対し、GPUラックは50〜120kW、次世代では600kW超に達します。電力だけではありません。重量は約1.3トン(軽自動車1台分)、発熱は電気ストーブ数十台分。この「桁違い」がデータセンターの冷却・電力設備・床構造・立地すべてを変えてしまうのです。AIの進化のボトルネックは、アルゴリズムではなく「ラック1本をどう置くか」という物理の問題になっています。

多くの解説記事は「GPUサーバー」の話で止まりますが、実際にデータセンターの現場を変えているのは「ラック単位の高密度化」です。この記事では、サーバーラックの基本から始めて、GPUラックが従来と何がどう違うのかを、具体的な数字と図解で解説します。

サーバーラックとは?── まず「入れ子構造」を理解する

🏗️ ラックは「サーバーを収める棚」

AIデータセンターの話に入る前に、まず「ラック」とは何かを押さえましょう。意外とここが曖昧なまま先に進んでしまう方が多いですが、ここを理解するかどうかで、この先の話の通り具合がまったく変わります。

サーバーラック(19インチラック)とは、サーバーやネットワーク機器を縦に積み上げて収納するための専用の棚です。見た目は背の高い金属製のキャビネットで、高さは約2メートル。ここにサーバーを「本棚に本を差し込む」ように、上から下へ順番に積んでいきます。

ラックのサイズには「U(ユニット)」という単位が使われます。1Uは高さ約4.4cm。標準的なラックは42U(約185cm)で、1Uのサーバーなら最大42台まで収容可能です。このラックが、データセンターの床にずらりと数百〜数千本並んでいるわけです。

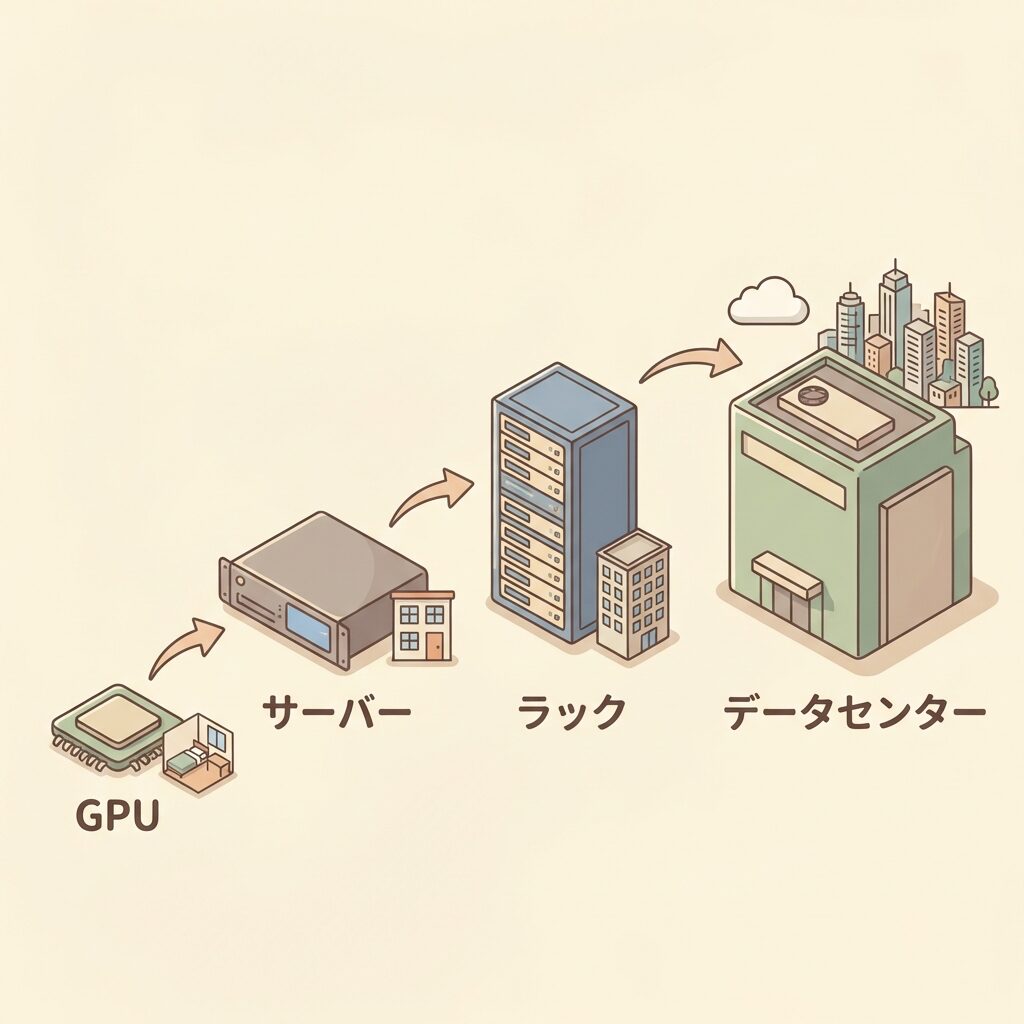

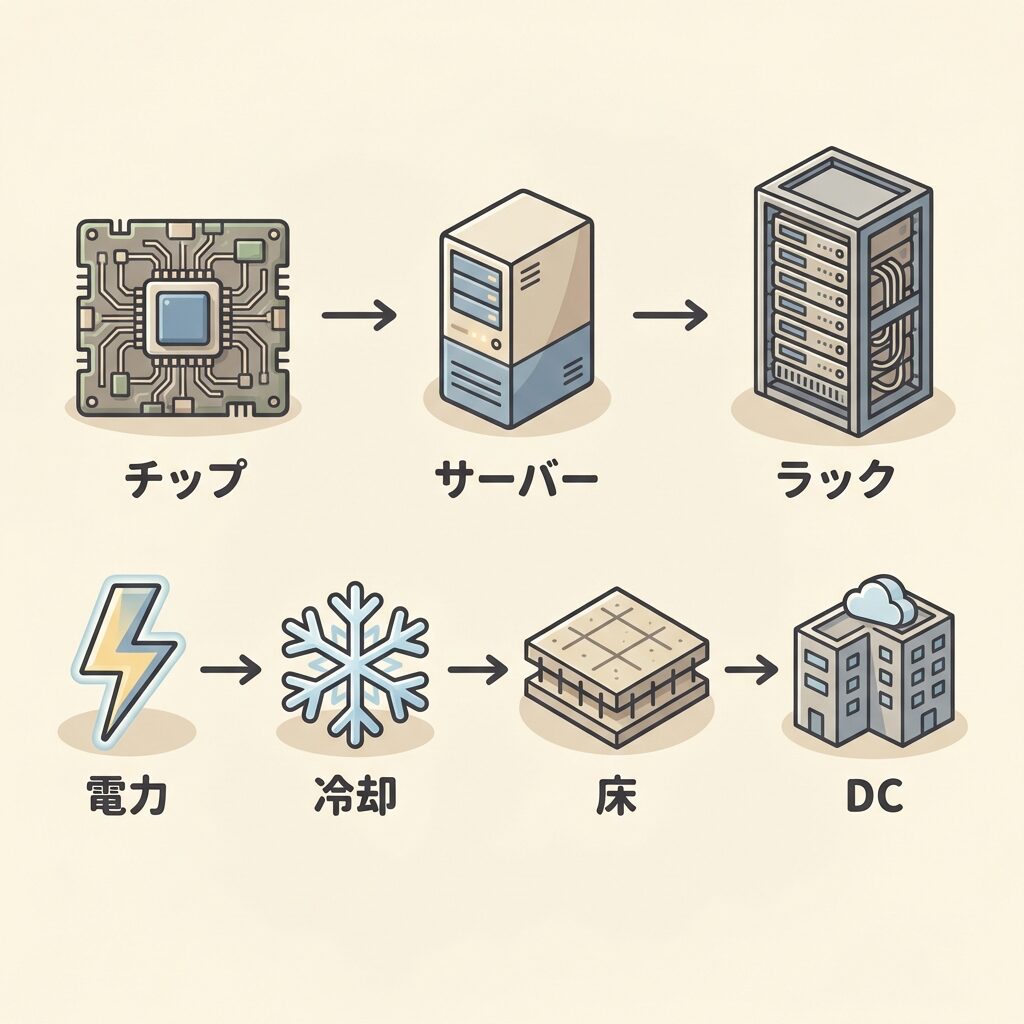

📦 サーバー → ノード → ラック → データセンターの入れ子構造

AIデータセンターの話を理解するうえで最も大切なのは、「サーバー1台」と「データセンター全体」の間にある入れ子構造を把握することです。マンションに例えるとわかりやすいでしょう。

GPUという「住人」がサーバーという「部屋」に入り、そのサーバーがラックという「1棟のマンション」に積み上げられ、ラックが何百本も並んだものがデータセンターという「団地全体」です。

ここで重要なのは、「住人」が変われば「部屋」も「マンション」も「団地」も設計し直す必要があるということ。従来のCPUという「おとなしい住人」から、GPUという「電気を大量に使い、猛烈に暖房を焚く住人」に入れ替わったことで、ラック=マンションの電力配線も、空調も、床の耐荷重も、すべてが足りなくなっているのです。

データセンターの変化は「サーバー1台」の話ではなく、「ラック単位」で起きています。サーバー1台の消費電力が10kWでも、それがラック1本に数台積まれれば50〜120kW。この「集積」こそが、AIデータセンターの設計をすべて変える起点なのです。

GPUラックとは?── 「桁違いの住人」を収めるための専用マンション

🗄️ 一言でいうと「GPUサーバー専用の高電力ラック」

GPUラックとは、GPUサーバーを複数台収容するために、電力供給・冷却・耐荷重をすべて強化した専用のサーバーラックのことです。

見た目は従来のサーバーラックと似た金属製のキャビネットですが、中身はまったくの別物です。先ほどのマンションの例えを使えば、従来のラックが「一般家庭向けマンション」だとすると、GPUラックは「工場用の産業設備を収めるための特殊ビル」です。電気の引き込み量も、空調も、床の強度も、ケーブルの本数も、すべてが桁違いになります。

📐 代表例:NVIDIA GB200 NVL72 ── 「軽自動車1台分のラック」

GPUラックの代表例が、NVIDIAのGB200 NVL72です。これは72基のBlackwell GPUと36基のGrace CPUを、1つのラックに液冷で詰め込んだシステムです。

このラックのスペックを見ると、GPUラックが「従来の延長線上」にないことが一目でわかります。

| 項目 | GB200 NVL72 のスペック |

|---|---|

| 搭載GPU数 | 72基(Blackwell GPU)+ 36基(Grace CPU) |

| 消費電力 | 約120kW(一般家庭 約40世帯分) |

| 重量 | 約1.36トン(軽自動車1台分に匹敵) |

| 冷却方式 | 完全液冷(空冷では対処不能) |

| 価格 | 約300万ドル(約4.5億円) |

出典:NVIDIA GB200 NVL72公式、FiberMall技術解説、Innovatopia

1本のラックで120kW、重さ1.36トン。これが数百〜数千本並ぶのがAIデータセンターです。「なぜデータセンターの設計が根本から変わるのか」──この数字を見れば、答えは明らかですよね。

NVIDIAの次世代GPU「Vera Rubin」(2027年予定)では、1ラックあたりの消費電力が600kWに達するとされています。さらにその拡張版「Rubin Ultra」では1,000kW(1MW)超──つまり大型マンション1棟分の電力を、ラック1本で消費する時代が来ようとしています(出典:日経クロステック)。

従来ラックとGPUラックは何がどう違うのか?

📊 6つの観点で一気に比較する

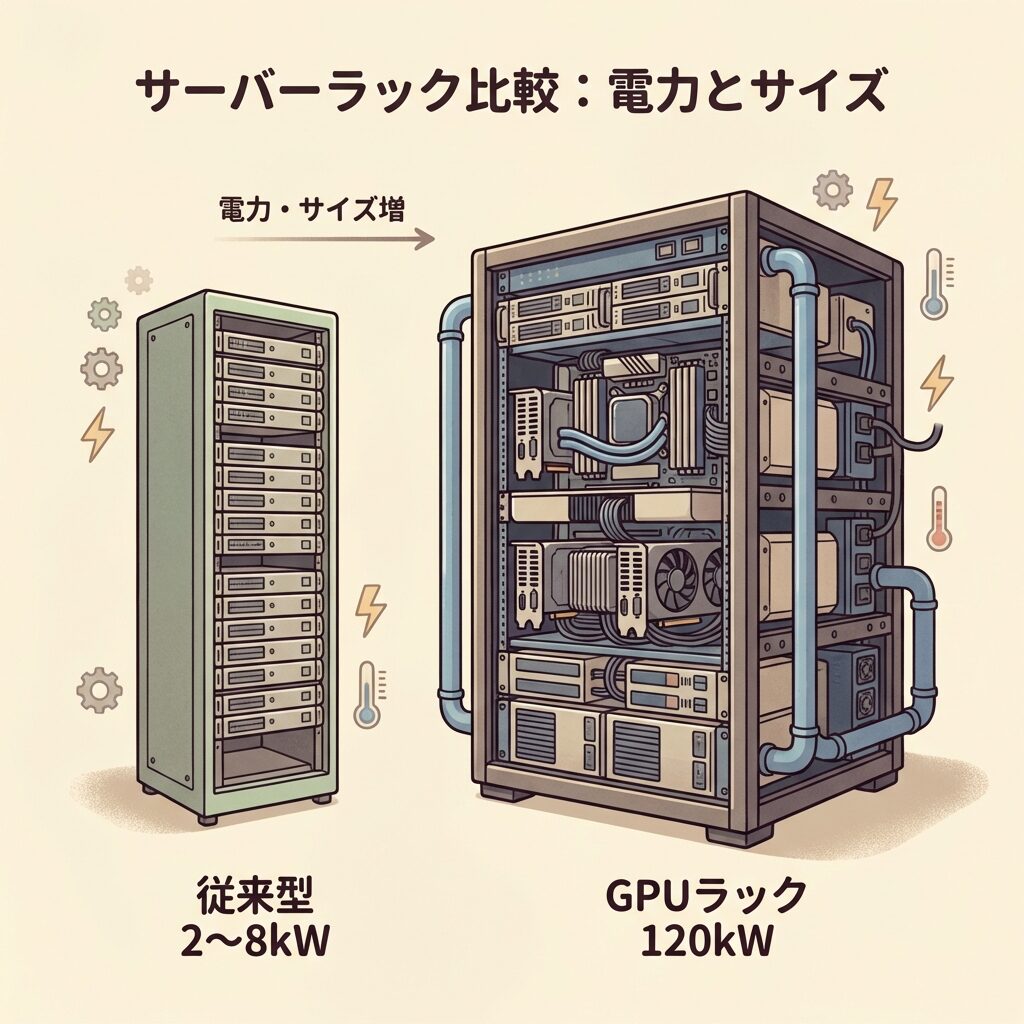

まず全体像をつかむために、従来型のCPUサーバーラックとGPUラックを6つの観点で比較しましょう。NTTPCコミュニケーションズの公開資料を基に、最新のGPUラックスペックを加えて整理しました。

| 比較項目 | 従来型ラック(CPUサーバー) | GPUラック |

|---|---|---|

| 1ラックあたり電力 | 2〜8kVA | 20〜120kW(10〜60倍) |

| ラック重量 | 200〜500kg | 1,000〜1,500kg(軽自動車級) |

| 冷却方式 | 空冷(エアコン方式) | 液冷が必須(水冷・液浸) |

| ケーブル本数 | 数十本 | 200本以上 |

| 必要な床耐荷重 | 500〜700kg/㎡ | 1,000〜2,000kg/㎡ |

| 主な用途 | Web/メール/DB/クラウド | AI学習・推論・大規模言語モデル |

出典:電力容量は NTTPCコミュニケーションズ、床耐荷重は Burrtec、ケーブル本数は Introl を参考に構成

🏠 身近なもので「差」をイメージする

数字だけだとピンとこないかもしれないので、身近なものに置き換えてみましょう。

従来ラック(2〜8kW)

電力:家庭用エアコン1〜3台分

重さ:大型冷蔵庫2台分

冷却:部屋のエアコンで対処可能

例え:一般家庭のリビング

GPUラック(50〜120kW)

電力:一般家庭 17〜40世帯分

重さ:軽自動車1台分(約1.3トン)

冷却:エアコンでは無理。液冷パイプが必須

例え:24時間フル稼働の小さな工場

同じ「サーバーラック」という名前がついていますが、中身のスケールがまったく違うことがおわかりいただけたと思います。これは「自転車とダンプカーの違い」に近い。どちらも「車輪がついた乗り物」ですが、走れる道も、止まれる場所も、必要な免許もすべて異なります。

「1ラックあたり電力容量」が意味すること

⚡ この数字がデータセンターの「格」を決める

データセンターの世界では、「1ラックあたりの電力容量(kVA / kW)」がその施設の能力を端的に表す指標です。この数字が、「どの世代のサーバーを何台載せられるか」を決めます。

NTTPCコミュニケーションズの解説によれば、一般的なデータセンターの電力容量は1ラックあたり2kVA〜8kVA程度です。一方、GPUサーバーの格納を想定するなら20kVA程度の電力供給が目安になるとしています(出典:NTTPCコミュニケーションズ)。

この「2〜8kVA」と「20kVA」の差を、もう少し噛み砕いて考えてみましょう。

CPUサーバー(消費電力220W程度)を十数台〜数十台搭載できる。Webサーバーやメール、データベースなど従来型のITシステムには十分。

H100 GPU×8基搭載のGPUサーバー(約10kW)を2台搭載可能なライン。現時点のGPUサーバー運用の最低限の条件。

GB200 NVL72(120kW)のようなラックスケールシステムを1本丸ごと収容可能。液冷設備と専用変電設備が前提。

2027年以降のRubin世代に対応。もはや「ラック」という概念自体が再定義される領域。専用変電所レベルの電力供給が必要。

「1ラックあたりの電力容量」は、データセンターの世代と対応能力を一目で判断できる指標です。2〜8kVAなら従来型、20kVAなら最低限のGPU対応、50kW以上なら本格的なAIデータセンター。この数字を見るだけで、その施設が「AI時代に対応できるかどうか」がわかります。

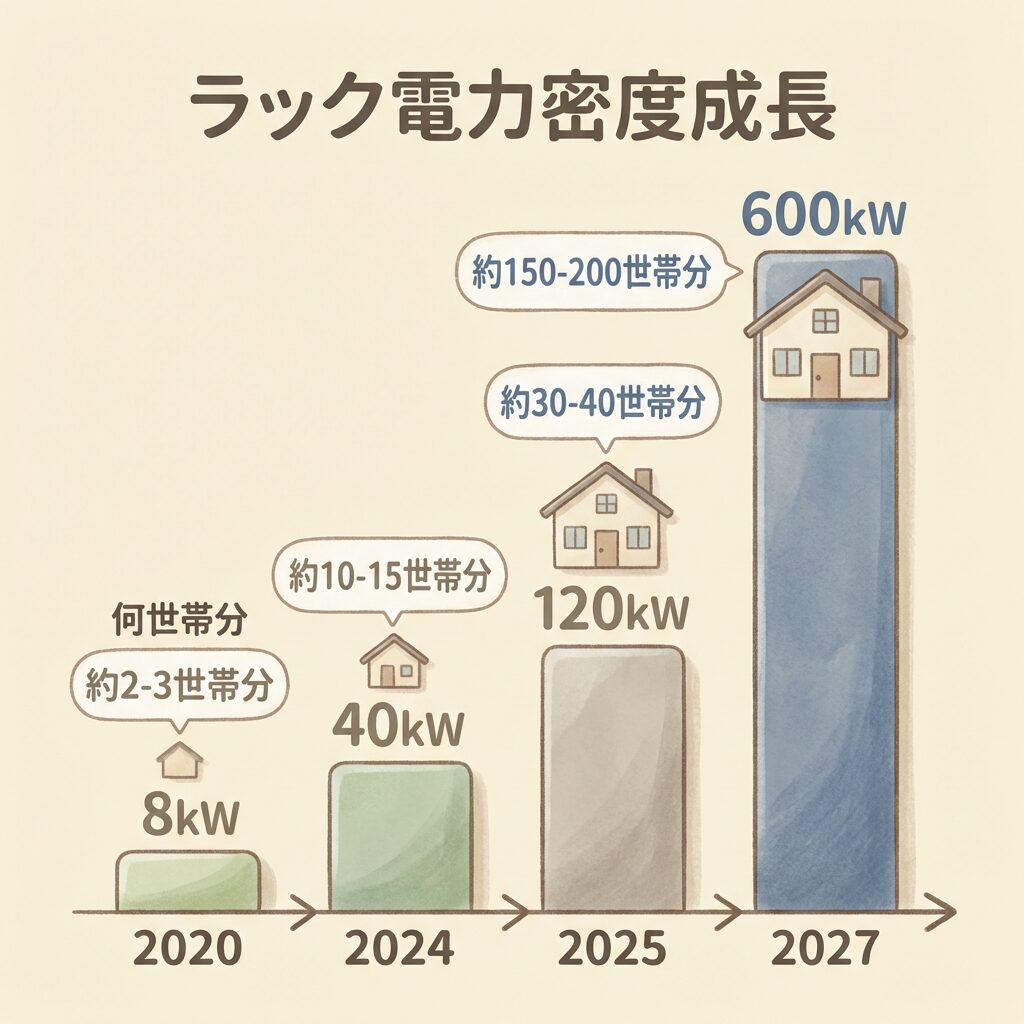

📈 電力密度の推移 ── ラック1本がどこまで「重く」なるか

| 時期 | 代表的なGPU世代 | ラックあたり電力 | 身近な例え |

|---|---|---|---|

| 〜2020年 | 従来型CPU | 2〜8kW | エアコン1〜3台 |

| 2022〜2024年 | H100(空冷) | 20〜40kW | 一般家庭7〜13世帯分 |

| 2025年〜 | GB200(液冷) | 120kW | 一般家庭 40世帯分 |

| 2027年〜 | Vera Rubin | 600kW | 一般家庭 200世帯分 |

出典:各世代の電力は 日経クロステック、NVIDIA公式 を参考に構成

わずか数年で、ラック1本の電力消費が8kW → 120kW → 600kWと、2桁のオーダーで増加しています。この急激な変化こそが、「昔のデータセンターでは対応できない」最大の理由です。

GPUラックは何が「重くて」何が「熱い」のか?

⚖️ 重量の正体 ── GPU本体 + 液冷設備 + ケーブル

GPUラックの重量が約1.3トンに達する理由は、GPU本体だけでは説明できません。重量の内訳を理解すると、「なぜ液冷が必須になると重くなるのか」が見えてきます。

Introl社の技術レポートによれば、最新世代のGPU(1,200W級)は、チップ単体では約5kgですが、冷却用のコールドプレート・マニホールド・冷却液を加えるとGPU1基あたり約15kgになります。これにCPU、メモリ、電源ユニット、ケーブル類が加わり、8GPU搭載サーバー1台でフル装備100kg超に達します(出典:Introl)。

つまり、GPUラックが重い理由は「GPU自体が重い」だけでなく、冷却のための液冷設備と、電力供給のためのケーブルが大量に加わるからです。40GPUを搭載するラックには、電力・ネットワーク・管理用で200本以上のケーブルが必要になるという報告もあります(出典:Introl)。

🌡️ 発熱の正体 ── 消費電力のほぼすべてが熱になる

次に「熱」の問題です。GPUラックが猛烈に発熱する理由は、物理法則としてシンプルです。消費された電力の大部分は「熱」に変わります。

120kWのGPUラックがあるとしましょう。120kWの電力が計算に使われ、その大部分が熱エネルギーとして放出されます。これは電気ストーブ(1,000W)を120台、狭い部屋で同時にフル稼働させているのと同じ状態です。

空冷(エアコン)で対応できるのはラックあたり20kW程度が限界とされています(出典:日経クロステック)。120kWのラックを空冷で冷やそうとすれば、それこそ台風のような風量が必要で、現実的ではありません。だからこそ、水や冷却液をパイプでGPUのすぐ近くまで通して直接熱を奪う「液冷」が不可欠になるのです。

投資家:GPUラックの高密度化が進むほど、「冷却設備」「電源ユニット」「ケーブル・コネクタ」の需要は確実に増加します。GPU本体(NVIDIA)だけでなく、これらの周辺領域が投資テーマとして拡大していきます。

学生:GPUラックの設計には、電気工学(配電)、機械工学(冷却・配管)、材料工学(冷却液・放熱素材)の知識がすべて必要です。「AI=情報系」ではないことが、ラックの構造を見ると実感できます。

技術者:ケーブル200本以上のラックをメンテナンスし、液冷設備を管理し、電力設備を安全に運用する──これはソフトウェアエンジニアには担えない仕事です。あなたの実務スキルが最も必要とされている領域です。

なぜ昔のデータセンターではGPUラックに対応できないのか?

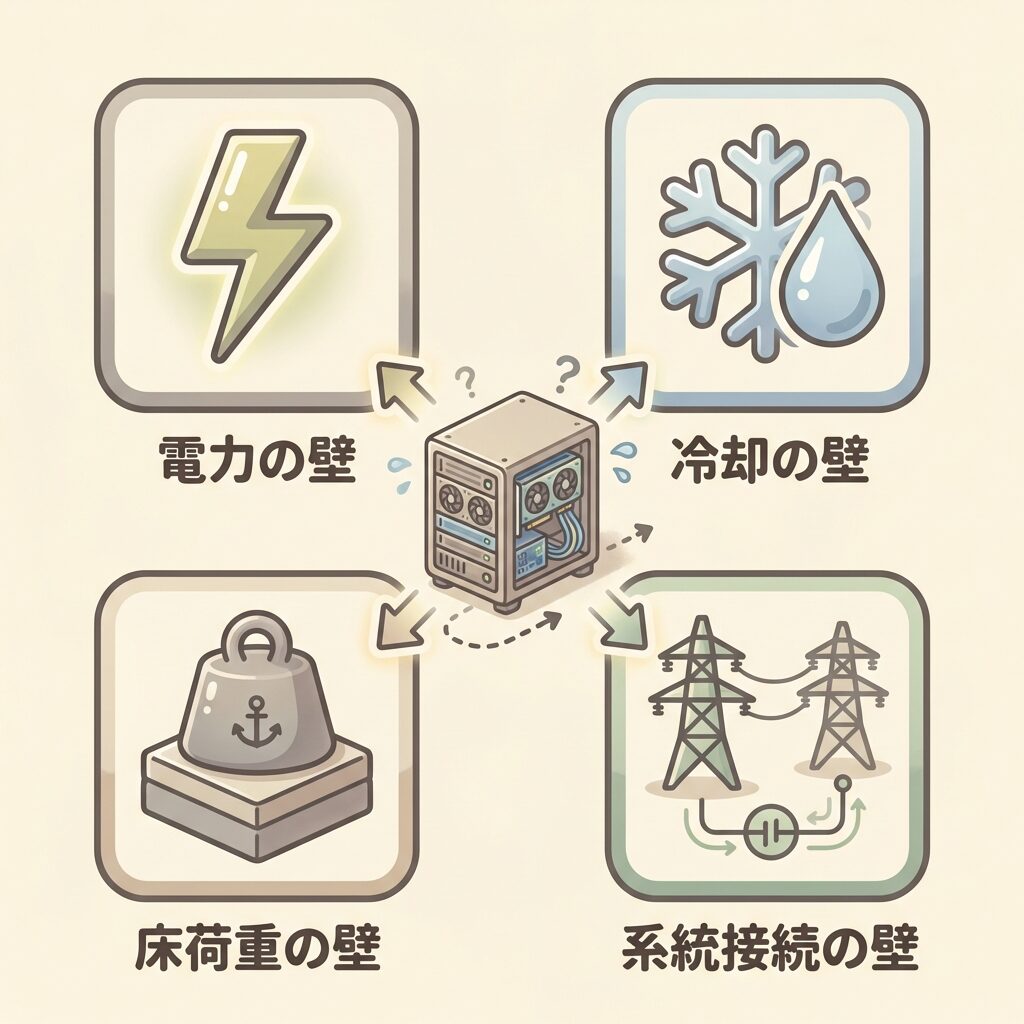

ここが、この記事で最も重要なセクションです。「GPUラックが重い・熱い・電気を食う」ことはわかった。では、なぜ既存のデータセンターを改修するだけでは対応できないのか。4つの壁を見ていきましょう。

🧱 壁①:電力設備の限界

従来のデータセンターは、1ラックあたり2〜8kVAの電力供給を前提に受変電設備が設計されています。ラックが100本あるフロアなら、設備全体で200〜800kVA程度の容量です。

ところが、GPUラックを100本並べると、必要な電力は12,000kW(12MW)。これは従来の15〜60倍です。ブレーカーの容量、電力ケーブルの太さ、変圧器の容量、すべてが足りません。「コンセントを増やす」レベルの話ではなく、建物に引き込む電力インフラそのものを作り替える必要があります。

🧱 壁②:冷却システムの限界

従来のデータセンターの冷却は「空冷」──つまり、床下から冷たい空気を送り込み、ラック前面から吸気して背面から排気する方式です。日本の既存データセンターの9割以上がこの方式です。

しかし空冷で対応できるのはラックあたり約20kWが上限です。GPUラックの50〜120kWは、空冷の能力を完全に超えています。液冷に移行するには、冷却液を循環させる配管設備、サーバールームの防水処理、冷却液分配ユニット(CDU)の設置など、建物構造を根本から変える改修が必要です。

🧱 壁③:床耐荷重の限界

一般のオフィスビルの床耐荷重は300〜500kg/㎡程度です。従来型データセンターでも500〜700kg/㎡程度に設計されています(出典:クラウドWatch)。

ところが、GPUラックは1本で1.3トン超。液冷設備の重量も加わるため、AIデータセンターには1,000〜2,000kg/㎡の床耐荷重が求められます(出典:Burrtec)。既存の建物では床が文字通り「耐えられない」のです。

🧱 壁④:系統接続(送電網との接続)の限界

数百MW〜GW級の電力を必要とするAIデータセンターは、既存の送電網では電力を十分に引き込めないケースが増えています。日本では特に東京圏(千葉県印西市など)で系統接続の制約が深刻で、新規の電力接続に最長10年以上かかるケースも報告されています。

「既存のデータセンターにGPUラックを入れればAI対応できる」と思われがちですが、電力・冷却・床耐荷重・系統接続の4つすべてが足りないのが現実です。改修よりも新築のほうが合理的なケースが多く、だからこそ世界中でAIデータセンターの建設ラッシュが起きているのです。

📖 【完全図解】AIデータセンターとは?従来型との違いと構造を解説 →

この記事は上記ロードマップの一部です。AIデータセンターの全体像から学びたい方はこちらからどうぞ。

GPUラックの高密度化に関わる日本企業

GPUラックの話はNVIDIAなど海外企業の名前ばかり出てきますが、実は日本企業もこの変化の当事者です。投資家・学生それぞれの視点で知っておくべき企業を、役割ごとに整理しました。

🗄️ ラック本体 ── 日東工業・河村電器産業・摂津金属工業

GPUラックの「箱」そのものを作っている日本メーカーが存在します。

日東工業(東証プライム・6651)は、データセンター向けシステムラックの国内大手です。高密度GPUサーバーの搭載に対応したFSシリーズや、ハイパースケールデータセンター向けの52U対応FDシリーズを展開しています(出典:日東工業公式)。さらに、OCP(Open Compute Project)準拠のオープンラックも個別対応で提供しており、DC給電・高効率化の最新トレンドに対応しています。

河村電器産業は、免震データセンター向けのデータセンターラック E-Classシリーズを展開しています(出典:河村電器産業)。また、摂津金属工業はサーバーラック業界でのシェアが高く、データセンター向けラック製造の老舗として知られています。

💧 冷却技術 ── NEC・NTTグループ・三桜工業・カンネツ

GPUラックの高密度化に伴い、液冷技術の需要が急拡大しています。

NECは、神奈川・神戸・印西のデータセンターで水冷対応サーバーの受け入れを開始しています(出典:クラウドWatch)。NTTグループは、NTTコミュニケーションズが海外で170MW規模の液冷データセンターを展開するなど、グループ全体で液冷への転換を本格化させています。NTTPCコミュニケーションズはNVIDIA認定エリートパートナーとして、20kVA対応の高電力ラック提供とGPU運用環境のトータル設計を行っています。

液冷設備のメーカーとしては、三桜工業(東証プライム・6584)が自動車向け配管技術をデータセンター冷却に応用し注目を集めています。カンネツはサーバー冷却装置の専門メーカーとして業界で高いシェアを持っています。

🏗️ データセンター建設・運用 ── NTTファシリティーズ・ソフトバンク・SCSK

NTTファシリティーズは、データセンターの設計・建設・運用を手がける国内大手で、電力設備設計から冷却設計まで一貫した技術力を持ちます。ソフトバンクは北海道苫小牧に大規模AIデータセンターの建設を進めており、2025年末にGB200 NVL72搭載のAI計算基盤を稼働開始しました(出典:ソフトバンク)。SCSKはGPUサーバーやHPCに最適な高負荷ハウジングサービスを提供しています。

GPUラックの高密度化は、「NVIDIA(GPU製造)」だけの話ではありません。ラック本体(日東工業、河村電器)、冷却設備(三桜工業、カンネツ)、電力設備(NTTファシリティーズ)、データセンター運用(NTT Com、ソフトバンク、SCSK)──GPUラック1本を設置・運用するために、これだけの日本企業が関わっているのです。AI時代の産業構造は、ソフトウェアではなく物理インフラの周辺に広がっています。就職を考える学生にとっても、これらの企業はAIインフラの最前線です。

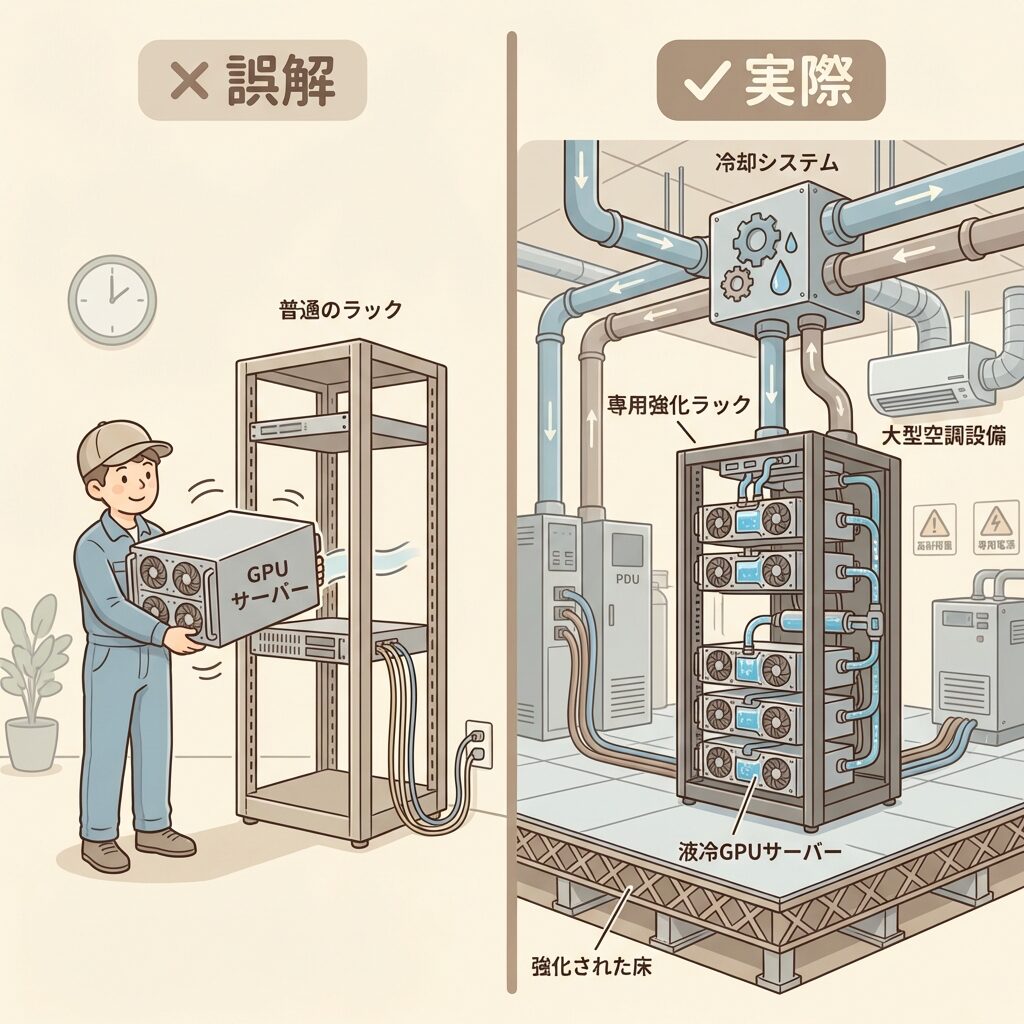

よくある誤解を整理する

❌ 誤解と ✅ 実際

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「GPUラックは普通のラックにGPUサーバーを入れただけ」 | 電力容量・冷却方式・耐荷重・ケーブル設計まですべて専用設計。従来ラックにGPUサーバーを入れても性能は発揮できず、最悪の場合ラック自体が壊れる。 |

| 「既存のデータセンターを改修すればGPUラックを置ける」 | 電力設備・冷却・床耐荷重・系統接続の4つすべてが足りないため、改修より新築の方が合理的なケースが多い。 |

| 「GPUラックが重いのはGPU本体が重いから」 | 重量の大部分は液冷設備(コールドプレート、配管、冷却液)とケーブル類。GPU本体は全体重量の一部に過ぎない。 |

| 「電力の問題はGPUの省電力化で解決する」 | GPU1基あたりの電力効率は改善しているが、ラック全体の電力密度は世代ごとに急増している(120kW→600kW→1MW超)。処理性能の向上が消費電力の削減を上回っている。 |

| 「データセンターの問題はソフトウェアで解決する」 | GPUラックの高密度化が引き起こす課題は、電力・冷却・床荷重・建設・送電網というきわめて物理的な問題。ソフトウェアだけでは解決しない。 |

まとめ:GPUラックの全体像

① ラックとは:サーバーを縦に積み上げて収納する専用の棚。データセンターの「建物の単位」であり、GPU→サーバー→ラック→データセンターという入れ子構造の一部。

② GPUラックとは:GPUサーバーを収容するための、高電力・高耐荷重・液冷対応の専用ラック。代表例のGB200 NVL72は120kW・1.36トン。

③ 従来ラックとの差:電力が10〜60倍(2〜8kVA → 20〜120kW)、重量が3〜6倍、冷却方式が空冷から液冷へ。桁が違う。

④ 「1ラックあたり電力容量」の意味:データセンターの世代と対応能力を一目で判断できる指標。2〜8kVAなら従来型、20kVAなら最低限のGPU対応、50kW以上なら本格AI対応。

⑤ 既存DCが対応できない理由:電力設備・冷却・床耐荷重・系統接続の4つすべてが不足。改修より新築が合理的。

⑥ 次世代の展望:2027年のVera Rubin世代では1ラック600kW。さらにRubin Ultraでは1MW超。ラック1本で大型マンション1棟分の電力を消費する時代が来る。

⑦ 日本企業の関与:日東工業(ラック)、三桜工業・カンネツ(冷却)、NEC・NTTグループ・ソフトバンク(DC建設・運用)など、物理インフラの周辺に広い産業機会がある。

結局こういうことです。AIの進化を「支えている」のは、ラック1本1本の物理的な設計です。GPUの性能がどれほど上がっても、それを収める箱の電力・冷却・耐荷重が追いつかなければ、AIは動かない。GPUラックの高密度化こそが、AIデータセンターのすべての課題の出発点なのです。

❓ よくある質問(FAQ)

📚 次に読むべき記事

GPUラックが大量に並ぶ場所が「AIデータセンター」。因果の連鎖で全体像を理解するピラー記事です。

ラックに積まれる「GPUサーバー1台」の構成と特徴を知りたい方はこちら。CPUとGPUの違いから解説しています。

GPUラックの発熱を解決する冷却技術の違いを深掘りする記事です。

GPUラックの高密度化がもたらす電力危機の構造を解説する記事です。

🗺️ 学習ロードマップ上の位置づけ

GPUラックとは?(この記事)

空冷 vs 液冷(冷却技術の比較)── 公開準備中

AIデータセンターの電力問題 ── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント