「空冷」「液冷」──AIデータセンターの記事を読んでいると必ず出てくるこの2つの言葉、こんなふうに感じていませんか?

- 空冷と液冷、結局なにが違うの?

- 「空冷の限界は20kW」と聞いても、何の数字かピンとこない

- 液冷にもいくつか種類があるらしいけど、違いがわからない

- なぜAIの登場で「急に」冷却が話題になったの?

- 空冷と液冷、どう使い分けるのが正解なの?

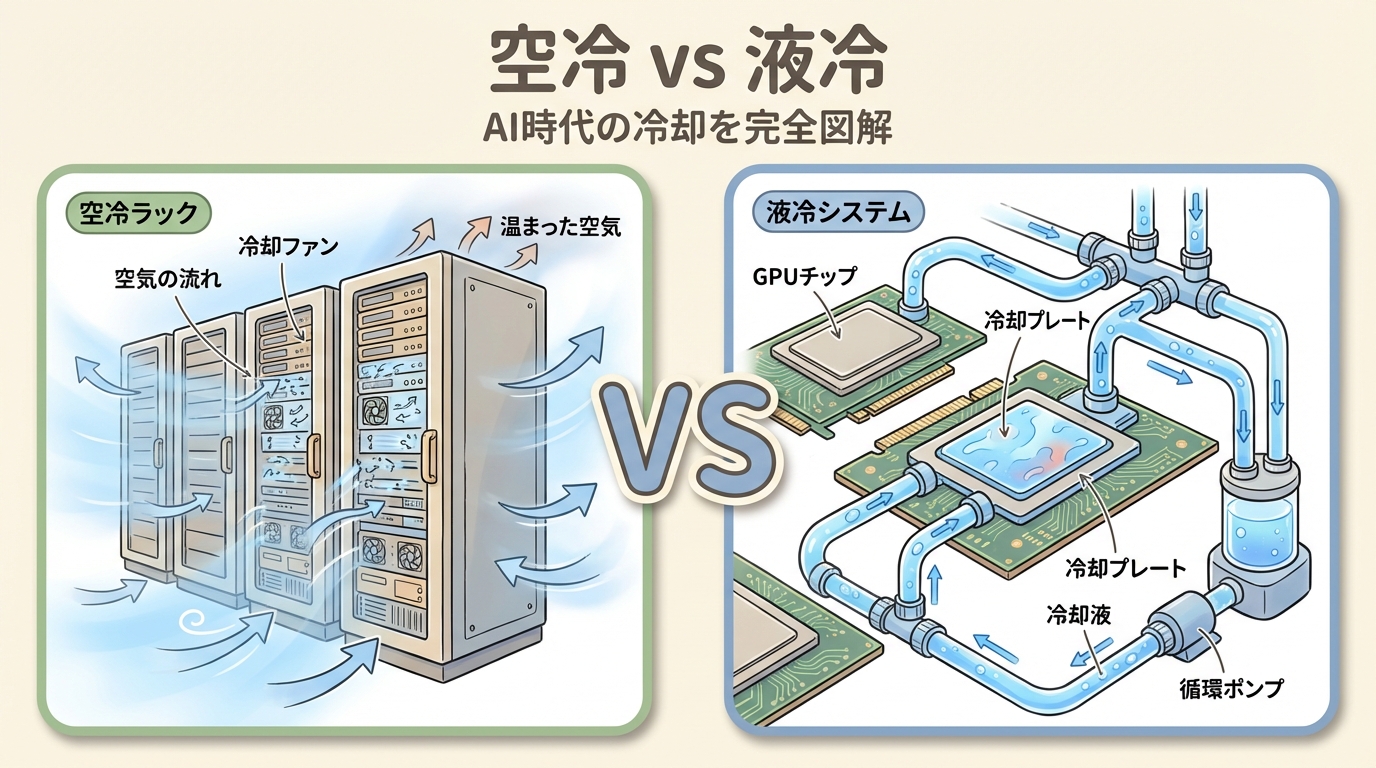

- 空冷・液冷それぞれの仕組みを図解で理解

- メリット・デメリットを7項目の比較表で整理

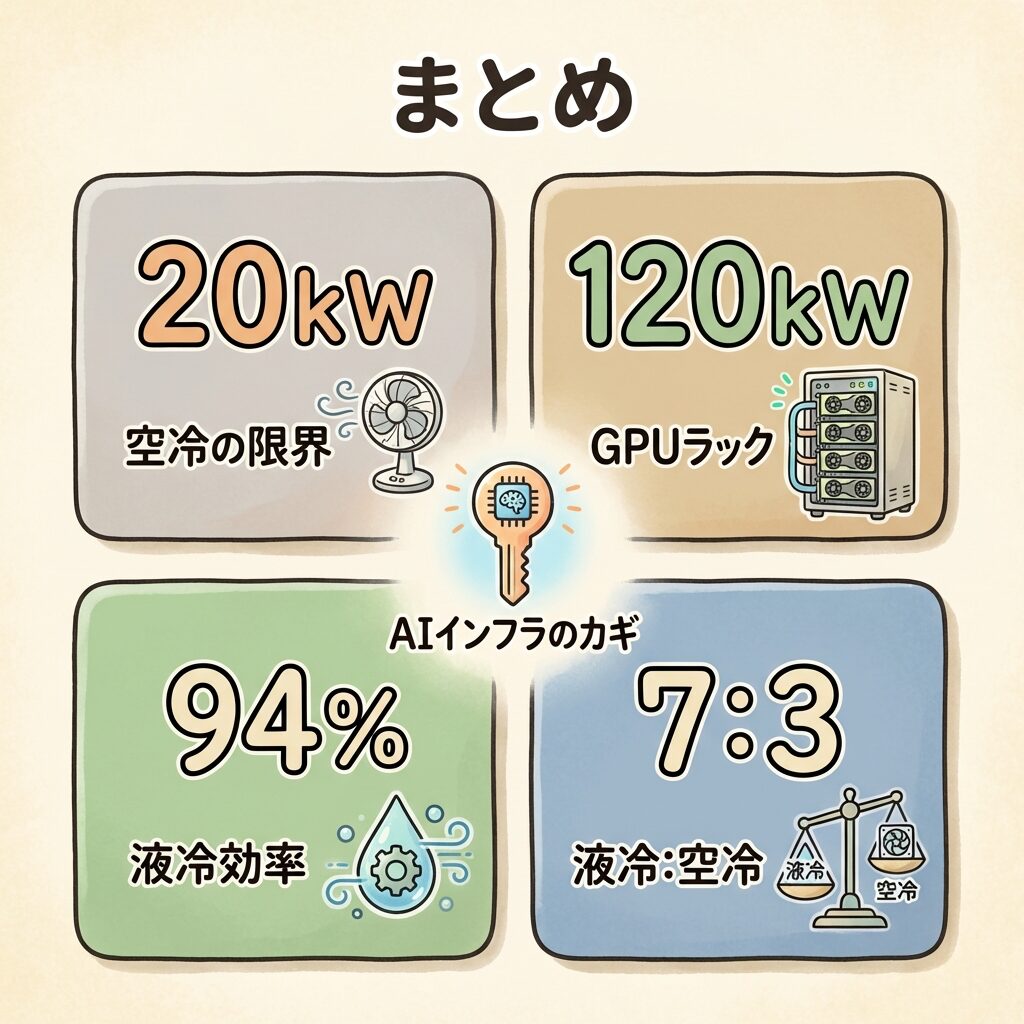

- 「空冷20kW vs GPUラック120kW」の限界ラインを可視化

- 液冷の2方式(DLC・液浸冷却)の違いと特徴

- ラック電力密度別の使い分けマップ

- なぜAI時代に冷却が「主役」になったのか──因果の連鎖

空冷とは「冷たい空気をサーバーに送って熱を逃がす方式」、液冷とは「水や冷却液でチップの熱を直接奪う方式」です。空冷は導入が簡単で安価ですが、ラックあたり約20kWが冷却の限界とされています(出典:IIJ)。一方、AIデータセンターのGPUラックは50〜120kW、次世代では600kW超に達します。空冷の限界を6倍以上も超える発熱を、空気だけで冷やすのは物理的に不可能。だから液冷が「あると便利な選択肢」ではなく、「なければAIが動かせない必須技術」になったのです。

この記事では、空冷と液冷の違いを「図解」と「たとえ話」を中心に、初心者でもすんなり理解できるように解説していきます。比較表と使い分けマップで、「結局どっちをどう使うの?」にも答えます。

空冷とは?──「エアコンで部屋ごと冷やす」方式

🌀 一言でいうと「強力なエアコンでサーバー室全体を冷やす」

空冷(Air Cooling)とは、冷たい空気をサーバー室に送り込み、サーバーが出す熱を空気で運び出す冷却方式です。現在、日本のデータセンターの9割以上がこの空冷方式を採用しています。仕組みは家庭のエアコンを巨大にしたものと考えてOKです。

空冷は「真夏の部屋でエアコンを全力稼働させている」イメージです。部屋中に冷たい風を送り込んで、部屋全体の温度を下げる。シンプルで確実。ただし、部屋の中に電気ストーブが何十台も置いてあったら……エアコンだけでは追いつきませんよね。

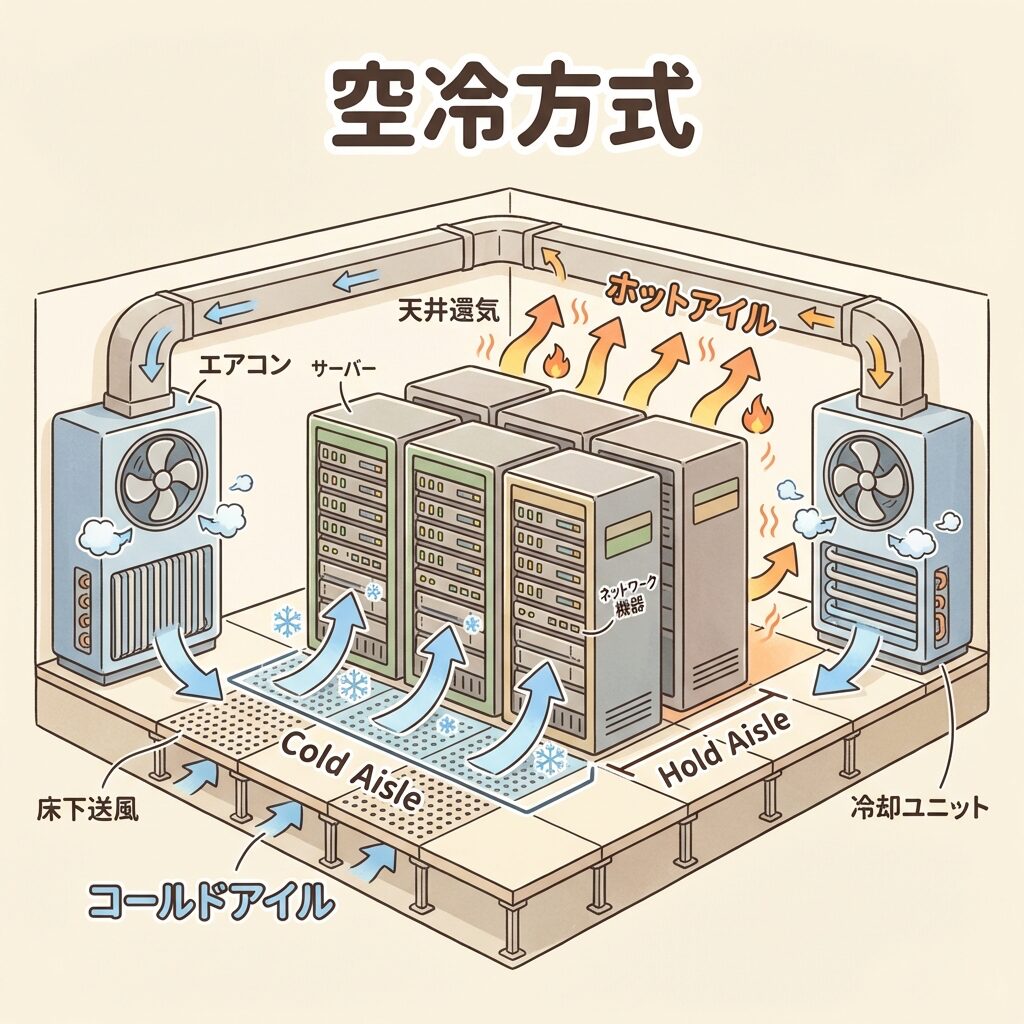

🔄 空冷の熱の流れを図解

空冷方式では、「冷たい空気の通り道」と「温かい空気の通り道」を分ける設計が基本です。これを「ホットアイル/コールドアイル」構造と呼びます。

冷気→サーバー吸気→排熱→空調で冷やして再循環。これが空冷の基本サイクルです。

サーバーラックの列を、冷たい空気が流れる「コールドアイル(冷気の通路)」と、サーバーが排出した温かい空気が流れる「ホットアイル(暖気の通路)」に分ける配置のこと。冷気と暖気が混ざらないようにすることで、冷却効率を高めます。

✅ 空冷のメリットと ⚠️ デメリット

空冷のメリット

・導入コストが安い:空調設備と送風設計だけで済む

・技術が成熟している:数十年の運用実績がある

・メンテナンスが容易:水漏れのリスクがない

・既存施設に適用しやすい:特別な改修が不要

空冷のデメリット

・冷却能力に限界がある:ラックあたり約20kWが上限

・冷却電力が大きい:大量の空気を循環させるためファン電力が増大

・PUEが悪化しやすい:冷却オーバーヘッドが全体の40〜60%

・GPUラックに非対応:50kW超の発熱には物理的に追いつかない

液冷とは?──「水で直接チップを冷やす」方式

💧 一言でいうと「水や冷却液でチップの熱を直接奪う」

液冷(Liquid Cooling)とは、空気の代わりに水や冷却液を使って、サーバー内のチップ(GPUやCPU)から直接熱を奪い取る冷却方式です。液体は空気よりも熱を運ぶ能力がはるかに高いため、空冷では冷やしきれない高密度・高発熱のGPUサーバーにも対応できます。

空冷が「エアコンで部屋ごと冷やす」なら、液冷は「熱を出している鉄板に、冷水パイプを直接くっつけて冷やす」イメージです。クルマのエンジン冷却と同じ原理ですね。熱源に直接触れる分、冷却効率は圧倒的に高くなります。

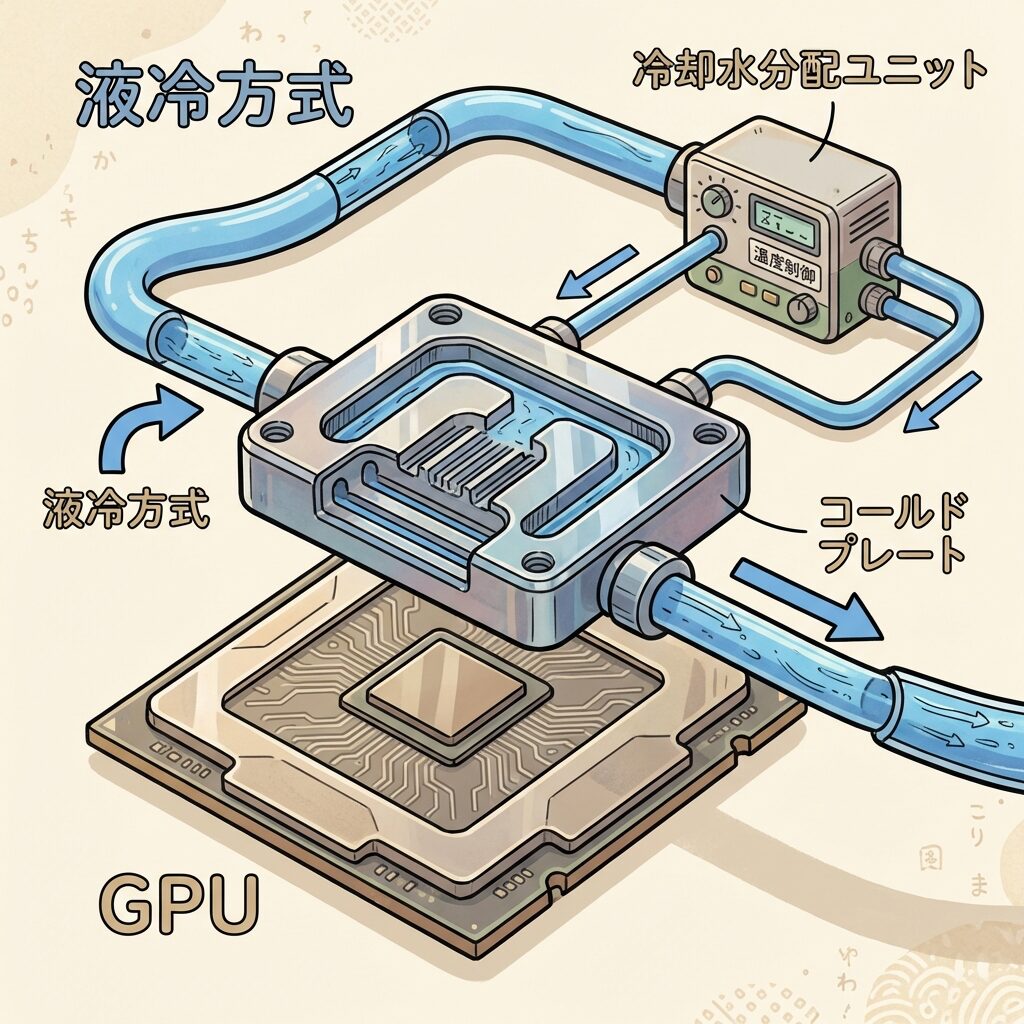

🔄 液冷の熱の流れを図解

冷水生成→CDUで分配→コールドプレートでGPUの熱を吸収→温まった液を戻す。液が直接チップに触れるから高効率。

Coolant Distribution Unit(冷却液分配ユニット)。冷却液の温度や流量を制御し、各サーバーに分配する「液冷の心臓部」です。

GPU/CPUチップの上に直接取り付ける金属板。内部に冷却液が流れる通路があり、チップの熱を液体に受け渡す「冷やす接点」です。

🔀 液冷には2つのタイプがある

液冷と一口に言っても、実は大きく2つの方式があります。それぞれ特徴が異なるので、違いを押さえておきましょう。

DLC(直接液冷)

仕組み:GPUやCPUの上に「コールドプレート」を取り付け、そこに冷却液を流してチップの熱を吸収する。

特徴:既存のサーバーラックに導入しやすい。NVIDIAのGB200 NVL72はこの方式。

例え:パソコンの「水冷クーラー」と同じ原理を、データセンター規模にしたもの。

現在の主流:✅ 最も普及が進んでいる液冷方式

液浸冷却

仕組み:サーバー基板そのものを、絶縁性の冷却液に丸ごと沈めて冷やす。

特徴:冷却効率が最も高い(PUE 1.05達成の事例あり)。ただし専用設備が必要。

例え:電子部品を「冷たいお風呂」にまるごと沈めるイメージ。

現在の位置づけ:🔬 実証段階〜一部導入。次世代の冷却として注目

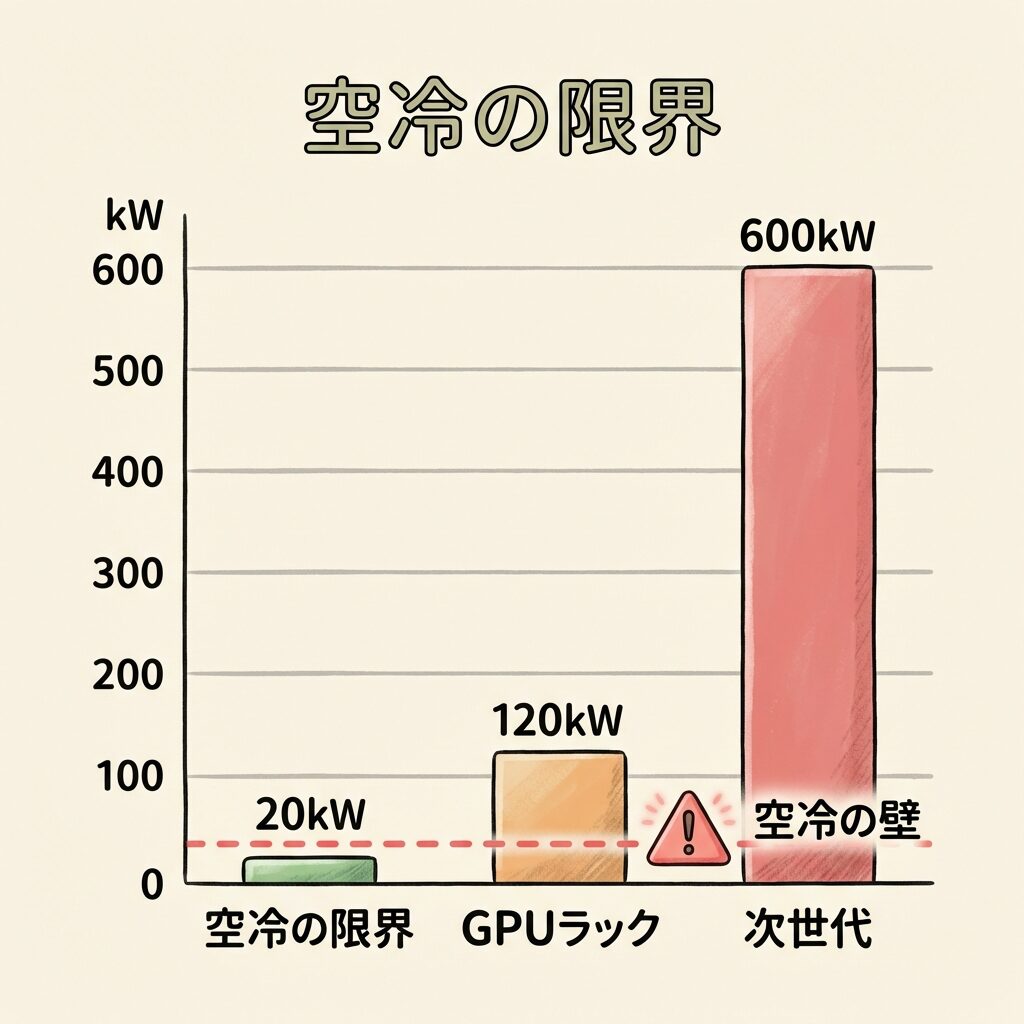

空冷の限界はどこにある? ── 「20kW」という壁

📏 空冷の冷却限界 vs GPUラックの発熱量

IIJは、空冷方式ではラックあたり約20kWが冷却の限界とされる一方、近年の高負荷サーバーではラックあたり約100kW以上の冷却が必要になる場合があると説明しています(出典:IIJ)。

この「20kW vs 100kW超」のギャップが、空冷の限界とAI時代の冷却要件の間にある断崖を示しています。以下の図で、この差を視覚的に見てみましょう。

空冷の限界(約20kW)に対し、最新GPUラックは120kW(6倍)、次世代は600kW(30倍)。

出典:IIJ、NVIDIA、日経クロステック

「空冷を強化すれば対応できるのでは?」と思うかもしれませんが、空冷で20kW以上を冷やすには台風のような風量が必要になり、騒音・送風電力・気流制御の面でまったく現実的ではありません。これは「改善で済む話」ではなく、物理的な壁なのです。

空冷 vs 液冷 ── 7項目の比較表で一目で理解する

空冷と液冷の違いを、最も重要な7項目で比較しましょう。この表を見れば、「何がどう違うのか」が一目でつかめます。

| 比較項目 | 🌀 空冷 | 💧 液冷 |

|---|---|---|

| 冷却の原理 | 冷たい空気を循環させ、サーバー全体から熱を運び出す | 水や冷却液でチップの熱を直接吸収して運び出す |

| 冷却能力 | ラックあたり約20kWが限界 | ラックあたり100kW以上に対応可能 |

| PUE目安 | 1.4〜1.8(冷却オーバーヘッド大) | 1.03〜1.2(冷却電力を大幅削減) |

| 導入コスト | 低い(空調設備のみ) | 高い(配管・CDU・防水・冷却液管理が必要) |

| 運用の難易度 | 低い(実績豊富、水漏れリスクなし) | 高い(漏水対策・冷却液管理・配管保守が必要) |

| 対応できるGPU世代 | A100以前の低〜中密度サーバー | H100以降の高密度GPUサーバー全般 |

| 今後の位置づけ | 従来型DCでは引き続き主流。AI DCでは補助的な役割に移行 | AI DCでは必須技術。DLC+空冷のハイブリッドが標準に |

PUE目安は各冷却方式のPUE分析およびIIJを参考に構成

空冷と液冷は「どちらが優れているか」ではなく、「どの発熱レベルに対してどちらが適切か」の問題です。従来型のWebサーバーやメールサーバーには空冷で十分。しかしGPUサーバーが入った瞬間、空冷だけでは物理的に追いつかなくなる。だから「AI = 液冷が必須」なのです。

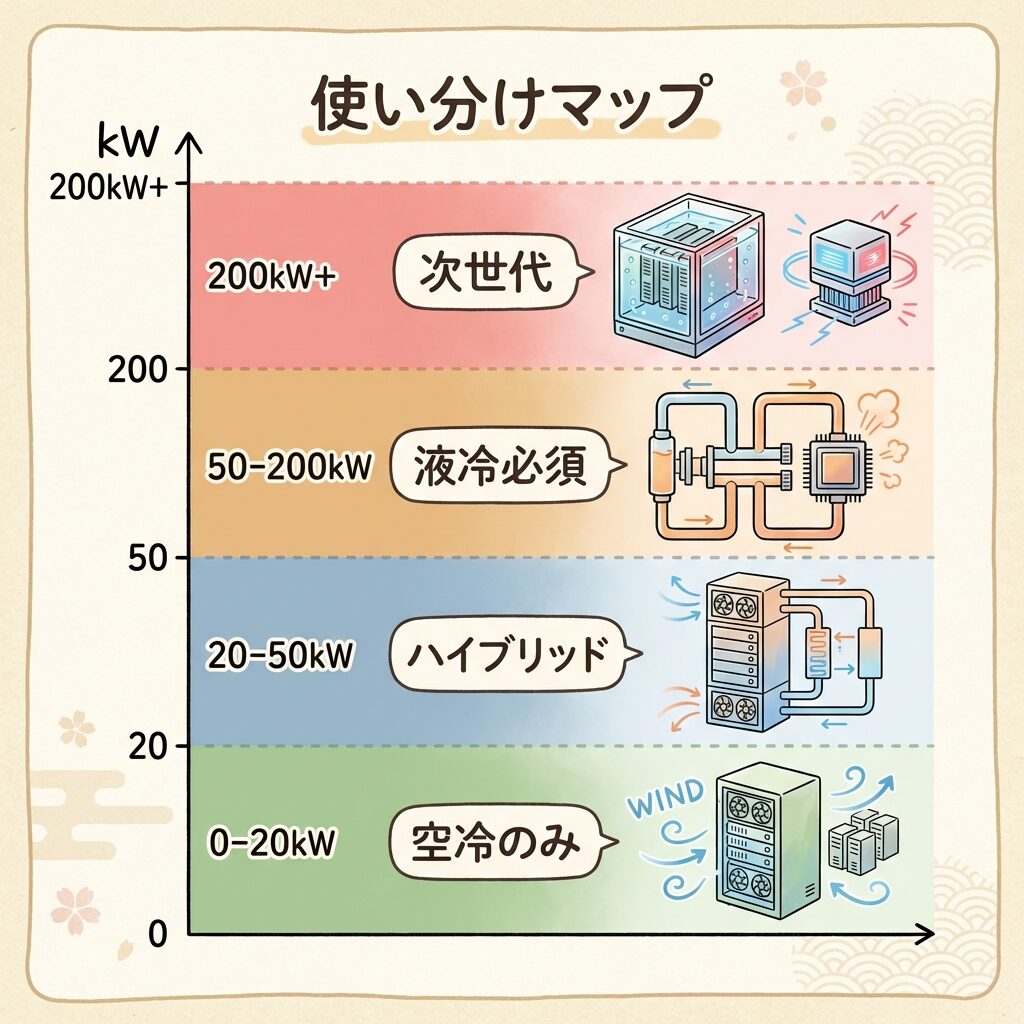

使い分けマップ ── ラック電力密度で冷却方式を選ぶ

「結局、空冷と液冷はどう使い分ければいいの?」──答えはシンプルです。ラックあたりの電力密度(=発熱量)で決まります。以下の使い分けマップを見れば、一目瞭然です。

Web/メール/DB/クラウドなど従来型のCPUサーバー。既存のデータセンターで対応可能。

H100空冷モデルなど中密度GPUサーバー。GPU部分はDLC(液冷)、ネットワーク機器等は空冷。液冷7:空冷3が目安。

GB200 NVL72(120kW)など最新GPUラック。完全液冷+補助空冷のハイブリッド。新築 or 大規模改修が前提。

Vera Rubin(600kW)以降の次世代GPU。DLC+液浸のハイブリッド、または完全液浸が検討される領域。専用変電所レベルの電力設備が前提。

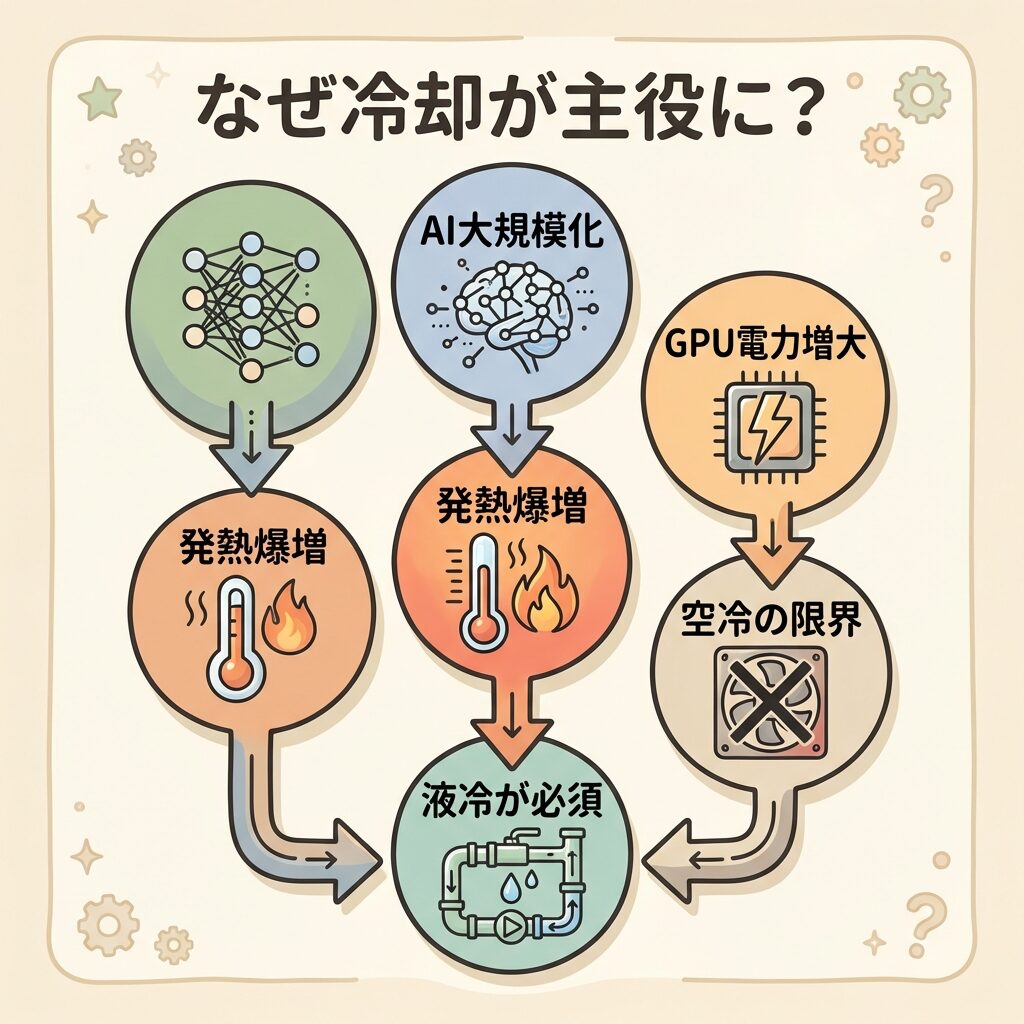

なぜAI時代に冷却が「主役」になったのか?

ここが、この記事の核心です。「冷却」は昔からデータセンターにあったのに、なぜ今になって急に「主役」として注目されるようになったのか。答えは、GPUの消費電力が桁違いに増えたことで、因果の連鎖が一気に動き出したからです。

🔗 因果の連鎖:GPUの進化が冷却を主役にした

GPT-4は推定1兆パラメータ超。モデルが巨大化するほど、計算量が指数的に増加。

A100(400W)→H100(700W)→B200(1,000W)。わずか4年で2.5倍に。

ラック1本が120kW。従来の15〜60倍。空冷の限界(20kW)を大幅に超過。

空冷の限界を6倍以上超えた。液冷への移行は「選択肢」ではなく「物理的必然」。

冷却電力が施設全体の30〜60%を占める。0.1のPUE改善が年間で億単位のコスト差に。

GPUがあっても冷やせなければ動かせない。冷却はAIの進化速度を決める「律速段階」。

冷却は「あって当たり前の裏方設備」。空冷で十分。冷却設計に特別な注目は集まらなかった。

冷却は「AIが動くかどうかを決める主役技術」。液冷の導入がAIインフラ構築の最重要課題に。

富士経済の調査は2025年を「液冷元年」と呼んでいます。GPU1枚あたりの消費電力が1,200Wに達した今、空冷では物理的に対処不能。液冷技術の導入スピードが、AIインフラの建設スピードを左右する時代になったのです。

【完全図解】AIデータセンターはなぜ電気を食うのか?電力需要の構造をやさしく整理 →

GPUの電力消費がデータセンター全体に与える影響を「3層構造」で解説。冷却が電力問題に直結する理由がわかります。

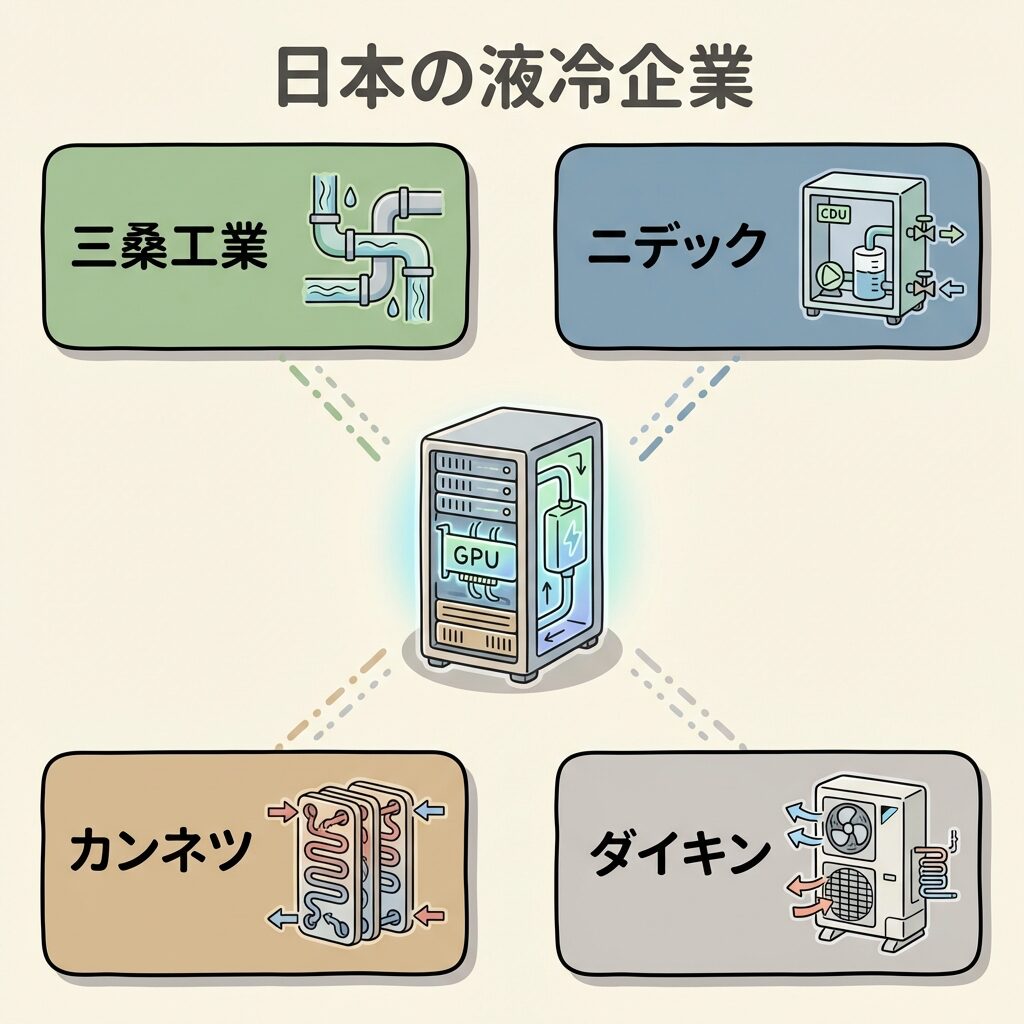

液冷に関わる日本企業と実証事例

「液冷」と聞くと海外技術のイメージがあるかもしれませんが、日本企業も液冷技術の最前線で活躍しています。投資家・学生が知っておくべき企業と実証事例を整理しました。

🏭 主な実証事例 ── PUE 1.05を達成したKDDI

KDDI・三菱重工・NECネッツエスアイの3社は、液浸冷却の実証実験でPUE 1.05を達成。空冷と比べて冷却電力を94%削減するという驚異的な成果を出しました(出典:KDDI)。

IIJは2026年3月、直接水冷方式のモジュール型データセンター「AImod」を公開。水冷と空冷のハイブリッド構成で、高密度AIサーバーに対応する実証を開始しています(出典:IIJ)。

🔧 液冷技術を持つ主要な日本企業

投資家:液冷市場は2025年の約5億ドル→2030年に111億ドル規模へ成長予測(年率約18%)。GPU世代が進むたびに冷却需要が構造的に増える。「GPU銘柄」の先にある投資テーマです。

学生:液冷技術には機械工学(配管・ポンプ)、熱工学(熱交換)、材料工学(冷却液)、電気工学(制御)のすべてが必要。AI時代に最も人材不足の分野です。

技術者:配管施工、漏水対策、冷却液管理、CDUの運用保守──これはソフトウェアエンジニアにはできない仕事。あなたの実務スキルが最も求められています。

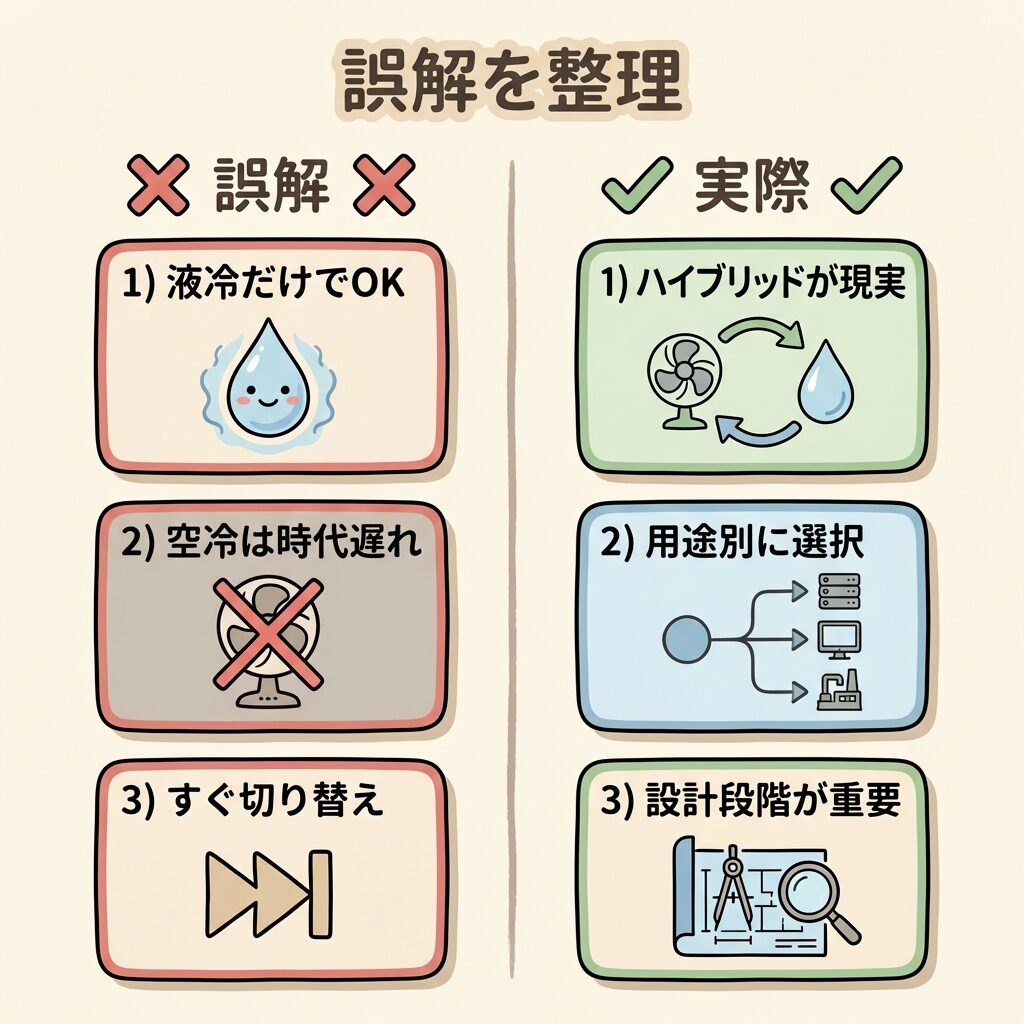

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「液冷にすれば空冷は不要」 | DLCで冷やせるのは全発熱の約70%(GPU/CPU部分)。ネットワーク機器やメモリの冷却には空冷が引き続き必要。ハイブリッド構成が現実的。 |

| 「液冷は水漏れが怖い」 | リスクはゼロではないが、OCP規格のカプラー(ワンタッチ着脱・漏水防止機構付き)の普及で大幅に低減。漏水検知センサーの設置も標準化が進んでいる。 |

| 「液冷=液浸冷却のこと」 | 液冷にはDLC(直接液冷)と液浸冷却の2方式がある。現在主流はDLC。液浸冷却は高効率だが専用設備が必要で、まだ実証〜一部導入の段階。 |

| 「空冷は時代遅れ」 | ラック20kW以下の従来型サーバーには空冷で十分。用途に応じた使い分けが正解であり、空冷が不要になるわけではない。 |

| 「既存のDCに液冷設備を後付けすればOK」 | 液冷には配管設備、CDU設置スペース、防水処理、冷却液管理設備が必要。IIJの白井DC3期棟のように「水冷Ready設計」で新築するケースが増えている。 |

まとめ:空冷と液冷の全体像

① 空冷とは:冷たい空気を循環させてサーバーを冷やす方式。導入コストが安く運用も容易だが、ラックあたり約20kWが冷却の限界。

② 液冷とは:水や冷却液でチップの熱を直接吸収する方式。DLC(直接液冷)と液浸冷却の2種類がある。ラック100kW以上に対応可能。

③ 空冷の壁:IIJの解説によると、空冷はラック約20kW、GPUラックは120kW。6倍の差を空気だけでは埋められない。

④ 液冷は7:空冷は3:DLCでもGPU以外の部品には空冷が必要。ハイブリッド構成が現実解。

⑤ 使い分けの基準:ラック電力密度で決まる。20kW以下=空冷、20〜50kW=ハイブリッド、50kW以上=液冷必須。

⑥ AI時代に冷却が主役に:GPUの消費電力が桁違いに増えたことで、冷却がAIインフラの「律速段階」に。冷やせなければAIは動かない。

⑦ 日本企業の存在感:ニデック・カンネツ・第一実業のアライアンス、三桜工業の配管技術、KDDIのPUE 1.05達成など、物理インフラの周辺に広い産業機会がある。

結局こういうことです。空冷と液冷は「どちらが良い悪い」ではなく、発熱量に応じて使い分けるもの。そしてAI時代にGPUの発熱が桁違いに増えたことで、液冷は「あると便利な技術」から「なければAIが動かない必須技術」に変わりました。冷却を理解することは、AIインフラの全体像を理解することなのです。

❓ よくある質問(FAQ)

📚 次に読むべき記事

空冷→液冷への移行がPUEをどう改善するのか。冷却と電力効率の関係を数字で理解できます。

冷却が電力消費の第2層を占める構造を解説。冷却効率の改善がなぜ経営課題なのかがわかります。

ラック120kWの発熱がデータセンターの設計を根本から変える理由。冷却が必須になった背景が具体的にわかります。

冷却問題の「原因」であるGPUサーバーの構成と消費電力を知りたい方はこちら。

🗺️ 学習ロードマップ上の位置づけ

空冷 vs 液冷(この記事)

HBM(高帯域幅メモリ)とは?── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント