「Blackwellは液冷必須」──NVIDIAのGPU世代交代が冷却業界に衝撃を走らせました。でも、こんな疑問が残っていませんか?

- GB200 NVL72が「液冷必須」って具体的にどんなスペック要件?

- 1ラック120kWの発熱を冷やすのに、施設側は何を準備すべき?

- H100世代と比べて何がどう変わったのか?

- 次世代のVera Rubin(600kW)まで見据えると、今どう設計すべき?

- Blackwellの液冷要件は投資テーマとしてどこに波及するのか?

- GB200 NVL72の冷却仕様(入口温度・流量・圧力損失)を数字で整理

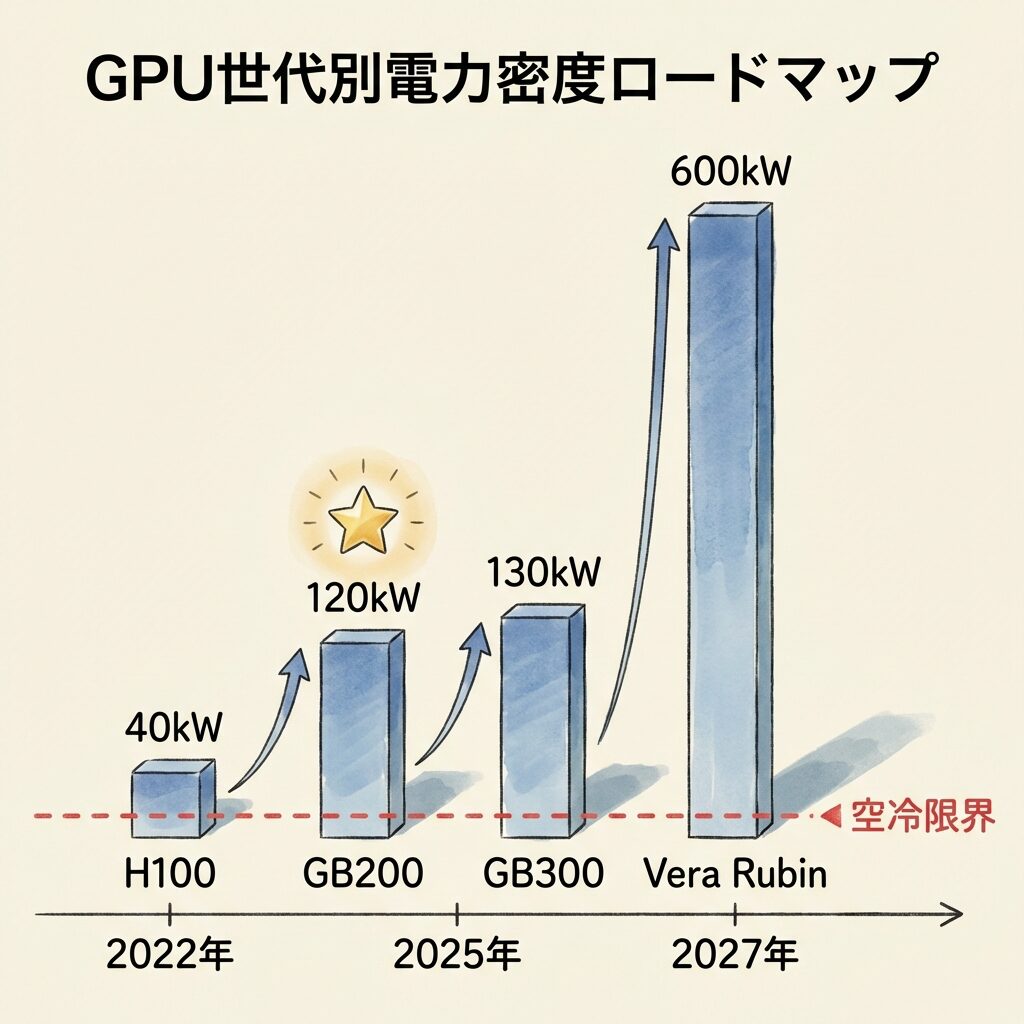

- H100 → GB200 → GB300 → Vera Rubinのラック電力密度ロードマップ

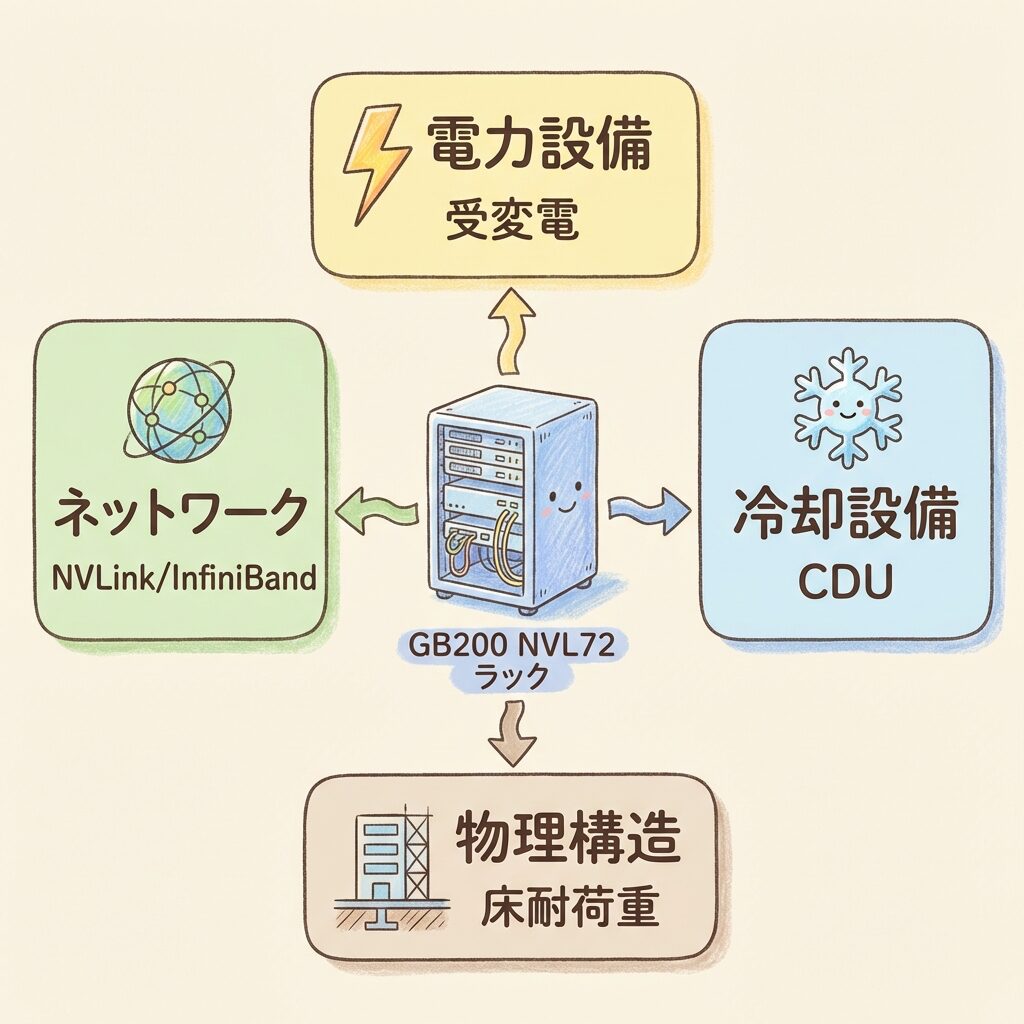

- 液冷必須化が電力・冷却・床構造・CDUの4要素に与えるインパクト

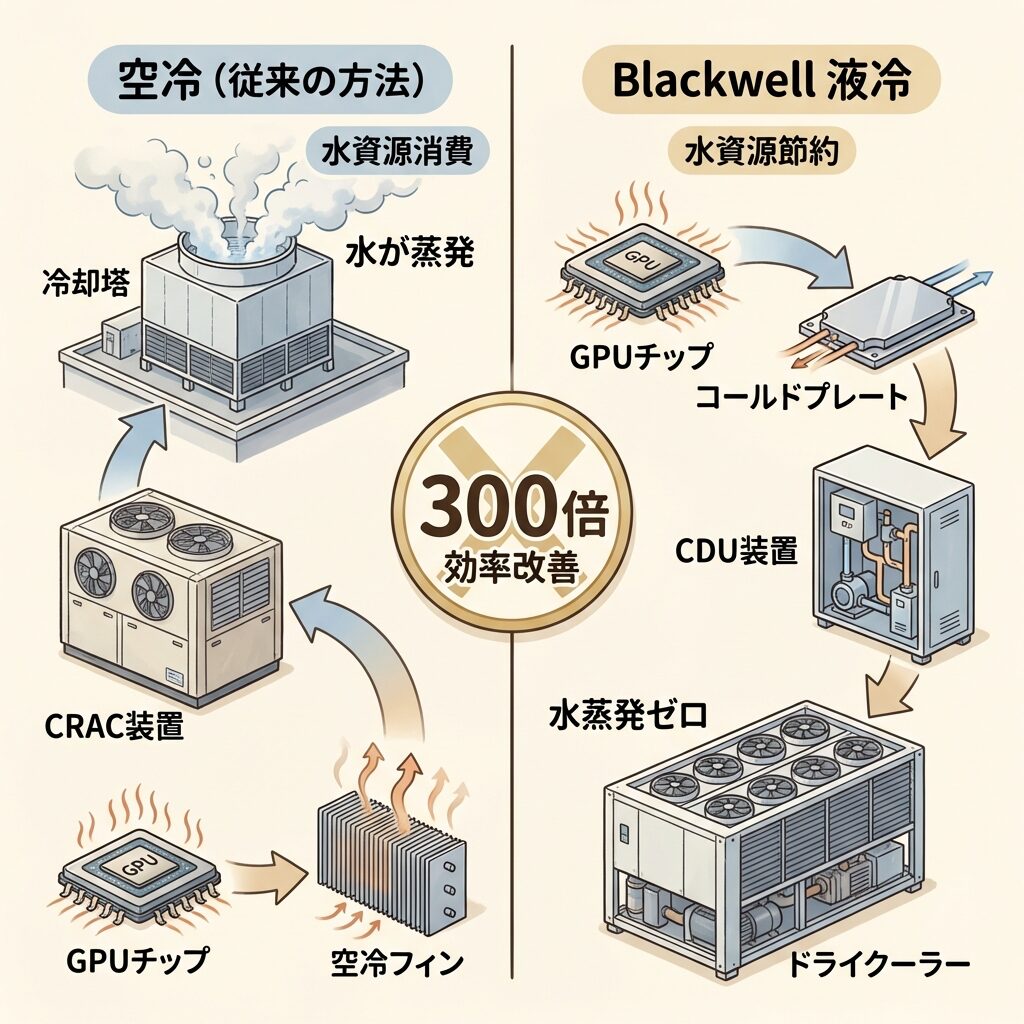

- NVIDIAが発表した「水効率300倍改善」の仕組みと意味

- Blackwell導入が波及する冷却設備サプライチェーンの構造

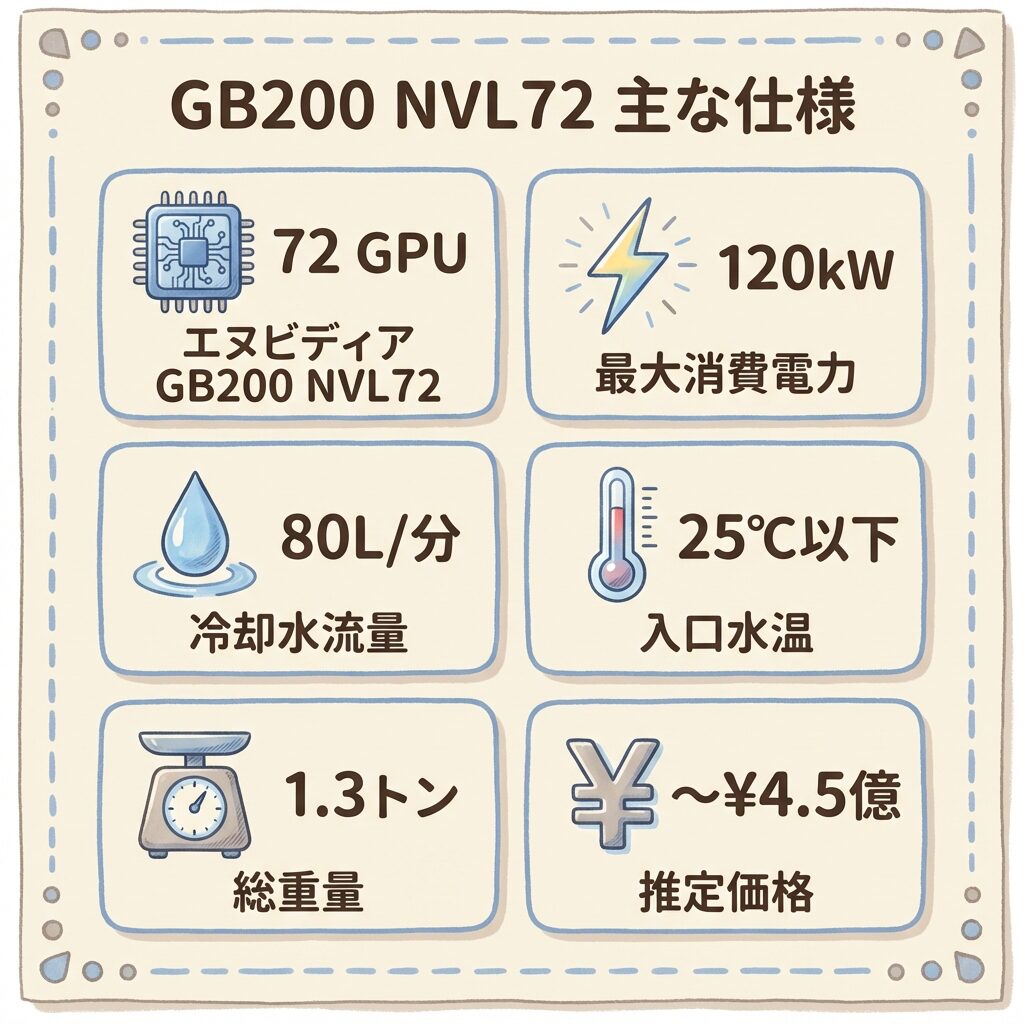

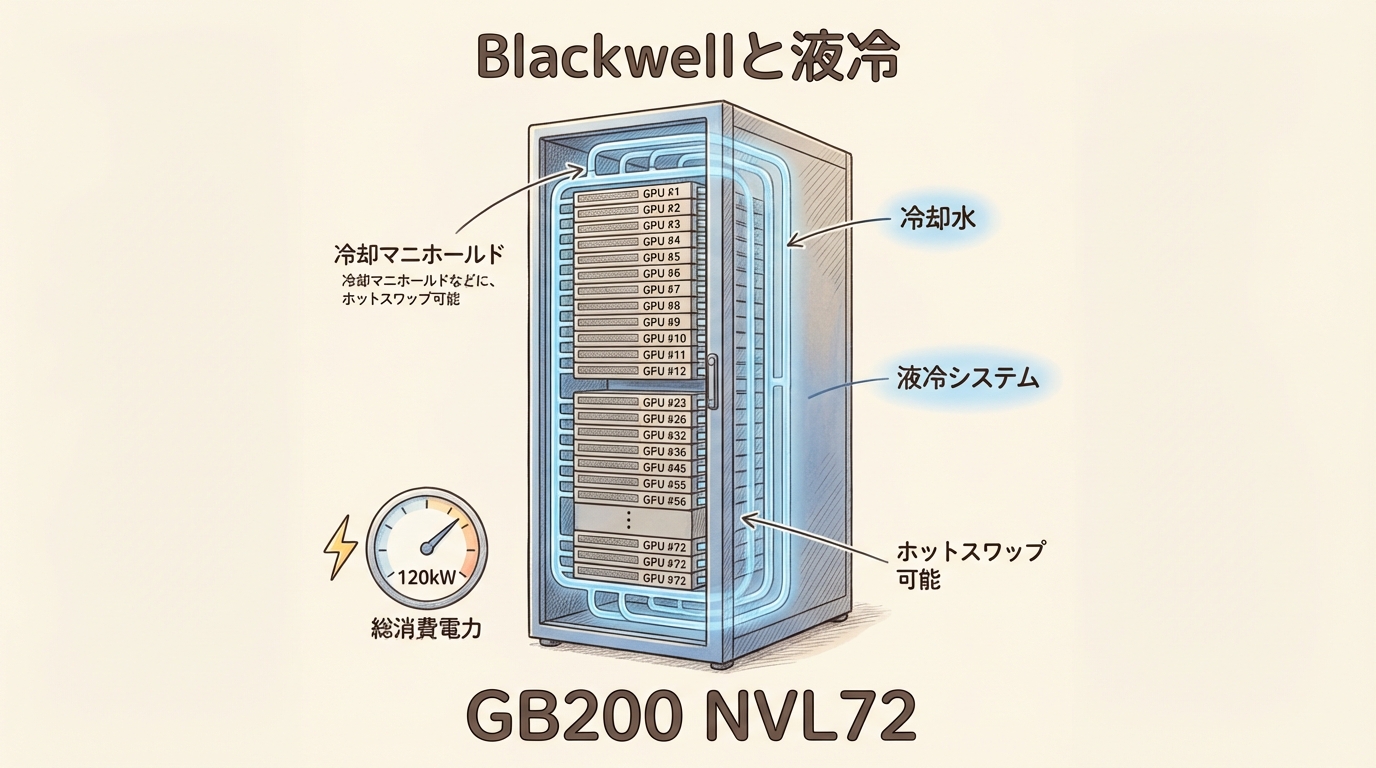

NVIDIA Blackwell GB200 NVL72は、72基のGPUと36基のCPUを1ラックに統合し、消費電力は約120kWに達するラックスケールシステムです。この発熱量は空冷の限界(約20kW)の6倍であり、NVIDIAは直接液冷(DLC)を義務化しています。公式仕様では入口温度20〜25℃、流量80L/分、圧力損失1.5バール以下が要求されます(出典:Introl)。しかしインパクトは冷却だけに留まりません。電力設備の刷新、床耐荷重の強化、CDUの大容量化──Blackwellの導入はデータセンター全体の再設計を強いる「トリガー」なのです。さらにNVIDIAはBlackwell液冷プラットフォームで水使用効率(WUE)を従来比300倍以上改善したと発表しています(出典:NVIDIA公式ブログ)。そして次世代Vera Rubinは600kW/ラック──今の5倍です。Blackwellで起きている変化は、始まりにすぎません。

GB200 NVL72の冷却仕様──数字で押さえる

📐 NVIDIAが「義務化」した液冷スペック

GB200 NVL72は、72基のBlackwell GPUと36基のGrace CPUを1本のラックに統合した「ラックスケールシステム」です。その冷却は空冷では不可能であり、NVIDIAはDLC(直接液冷)を義務化しています。NVIDIA公式およびIntrolの解説(出典)を基に、冷却仕様を整理します。

| 項目 | GB200 NVL72の仕様 |

|---|---|

| 搭載GPU数 | 72基(Blackwell GPU)+ 36基(Grace CPU) |

| ラック消費電力 | 約120kW(一般家庭約40世帯分) |

| GPU1枚あたりTDP | 約1,200W(Superchipあたり) |

| 冷却方式 | DLC(直接液冷)──義務 |

| 冷却液の入口温度 | 20〜25℃(最大45℃まで対応可能との報告あり) |

| 冷却液の流量 | 約80 L/分(ラック全体) |

| 圧力損失 | 1.5バール以下 |

| ラック重量 | 約1.3トン(軽自動車1台分) |

| GPU接合部温度 | 75℃以下を維持 |

| 価格 | 約300万ドル(約4.5億円)/ラック |

GB200 NVL72は「1本のラックに電気ストーブ120台を詰め込んで24時間稼働させる」ようなものです。毎分80リットル──お風呂1杯分の冷却液を毎分5回流し続けないと冷えない。しかもその冷却液は25℃以下で供給する必要がある。エアコンの風では到底無理──だから液冷が「選択肢」ではなく「義務」なのです。

H100からVera Rubinへ──ラック電力密度は3年で5倍になる

📈 NVIDIAのGPUロードマップと冷却要件の因果関係

Blackwellは「点」ではなく「線」の上にあります。NVIDIAのGPU世代交代がラック電力密度をどう押し上げてきたか、そして今後どこに向かうかを一気に見てみましょう。

GPU 1枚 700W。ラック電力約20〜40kW。空冷モデルが主流。液冷は一部。CoWoS-S採用。

Superchip 1,200W。ラック電力約120kW。液冷が義務。CoWoS-L採用。NVIDIAが初めて「空冷では不可」と明言した世代。

GPU 1枚 1,400W。ラック電力約125〜130kW。完全液冷。冷却システム1台で約5万ドル(出典:Tom’s Hardware)。

ラック電力約600kW──一般家庭200世帯分。今のGB200の5倍(出典:Introl)。NVL144構成も登場予定。「ラック」という概念自体が再定義される領域。

ラック電力密度の推移(空冷限界20kWを1とした場合)

GB200の120kWでも空冷の6倍。しかし2027年のVera Rubinは600kW──空冷の30倍。今Blackwell対応で設計するDCが、3年後のVera Rubinに対応できるかどうか──この「将来余地」が、DC設計の最重要判断になっています。

Blackwellの液冷義務化がデータセンターに与える4つのインパクト

🏗️ 冷却だけでは終わらない──DC設計全体が変わる

GB200 NVL72の導入は、「冷却方式をDLCに変える」だけの話ではありません。Introlの分析によれば、一般的なDCがNVL72を1台受け入れるだけで500万〜1,000万ドル(約7.5億〜15億円)の設備改修が必要になるケースがあります(出典:Introl)。影響は4つの領域に波及します。

CDUは冷却の心臓部ですが、それだけでは不十分です。120kWの電力を供給する受変電設備、1.3トンのラックを支える床、200本以上のケーブルを収容するスペース、InfiniBandの超高速ネットワーク──4つの領域すべてがBlackwell水準を満たしていなければ、NVL72は稼働できません。

GPUラックとは?「高密度化」でDCが変わる理由 →

CDU(冷却液分配ユニット)とは? →

「水効率300倍改善」の仕組み──NVIDIAの液冷戦略

💧 「冷やすために水が消える」問題をBlackwellはどう解決するのか

NVIDIAは2025年4月、Blackwell液冷プラットフォームが従来の空冷+冷却塔方式と比較して水使用効率(WUE)を300倍以上改善したと発表しました(出典:NVIDIA公式ブログ)。この改善はどのように実現されているのでしょうか。

GPU → 空冷ファン → サーバールームの空気が温まる → CRAC(空調機)が空気を冷やす → CRACの排熱を冷却塔の蒸発で処理 → 水が大量に消える

GPU → コールドプレートで直接液冷 → CDUで施設冷水に熱交換 → 施設冷水をドライクーラー(水蒸発なし)で外気に排熱 → 水をほぼ使わない

液冷DLC+閉ループ+ドライクーラーの組み合わせで、冷却過程での水蒸発をほぼゼロに。空冷+冷却塔方式と比較してWUEが300倍以上改善。

Vertivのリファレンスアーキテクチャでは、GB200 NVL72サーバー向けの液冷設計で年間エネルギー消費を25%削減、ラックスペースを75%削減できるとしています(出典:NVIDIA公式ブログ)。

液冷は「水を蒸発させて冷やす」のではなく、「閉ループで液体を循環させて熱を運ぶ」仕組みです。CDU内で一次側と二次側は物理的に分離されており、二次側の冷却液(PG25等)は蒸発しません。排熱先をドライクーラーにすれば、一次側の水も蒸発しない。液冷だからこそ水を使わずに済む──これがBlackwellのWUE 300倍改善の構造です。

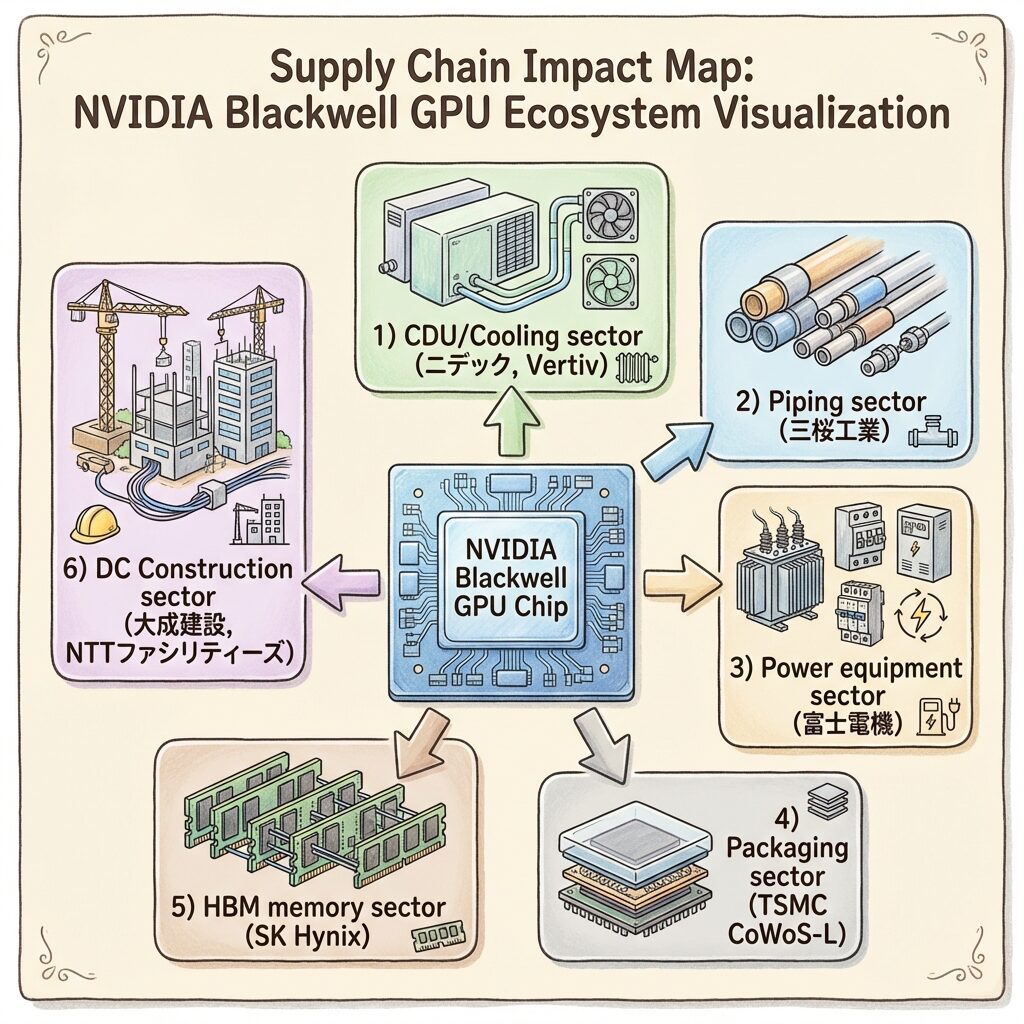

Blackwellが波及するサプライチェーン──誰が恩恵を受けるか

🔗 NVIDIAのGPU1つが動くために、これだけの企業が必要

GB200 NVL72の液冷義務化は、NVIDIAだけの話ではありません。冷却設備・電力設備・パッケージング・配管──物理インフラのサプライチェーン全体に構造的な需要を生みます。

Blackwellの液冷義務化は「NVIDIAの好業績→冷却・電力・パッケージング企業への構造的需要」という因果の連鎖を生みます。GPU世代交代のたびに冷却要件は厳しくなるため、CDU・配管・電力設備への需要は一過性ではなく構造的です。さらにVera Rubin(600kW)の到来は、このサプライチェーン全体への需要をさらに5倍に押し上げる可能性があります。なお個別銘柄の投資推奨ではありません。

GB200 NVL72の導入は、DC側に「入口温度25℃以下・流量80L/分・圧力損失1.5バール以下」を要求します。この数字をもとに配管口径・ポンプ揚程・CDU容量・冷却塔能力を逆算できることが、液冷DCのエンジニアリングの出発点です。空調設備の設計経験がある技術者は、この数字を「設計仕様に翻訳する」スキルがそのまま活きます。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「Blackwellは液冷推奨」 | NVL72は液冷「義務」。空冷モデルは存在しない。B200単体(HGX構成)には空冷オプションがあるが、NVL72/36のラックスケール構成では物理的に空冷不可能。 |

| 「H100用のDCでBlackwellが動く」 | H100ラック(~40kW)とGB200ラック(120kW)では電力密度が3倍異なる。電力・冷却・床耐荷重すべてが足りない。Introlは改修費用を$5〜10Mと試算。 |

| 「液冷を入れると水をたくさん使う」 | DLC液冷は閉ループで水を蒸発させない。排熱先をドライクーラーにすれば水蒸発ゼロ。NVIDIAは空冷+冷却塔方式と比較してWUE 300倍改善を実証。 |

| 「Blackwell対応で設計すれば将来も安心」 | 2027年のVera Rubinは600kW/ラック──Blackwellの5倍。Blackwell対応DCがVera Rubinに耐えられるかは、電力・配管の「拡張余地」次第。設計時に将来世代を見据えることが必須。 |

まとめ:Blackwellと液冷の全体像

① GB200 NVL72の冷却仕様:72 GPU+36 CPU、ラック120kW、入口温度20〜25℃、流量80L/分、圧力損失1.5バール以下。DLC液冷が義務。

② ラック電力密度ロードマップ:H100(~40kW)→ GB200(120kW)→ GB300(~130kW)→ Vera Rubin(600kW)。3年で5倍。空冷限界(20kW)との差は拡大の一途。

③ DC設計への4つのインパクト:電力設備(受変電の大幅増強)、冷却設備(CDU・配管・冷却塔の再設計)、物理構造(床耐荷重1,000〜2,000kg/㎡)、ネットワーク(NVLink 1.8TB/s+InfiniBand)。

④ 水効率300倍改善:DLC+閉ループ+ドライクーラーで蒸発冷却を排除。空冷+冷却塔方式と比較してWUEを300倍以上改善(NVIDIA発表)。

⑤ サプライチェーンへの波及:CDU(ニデック等)、配管(三桜工業)、電力設備(富士電機)、パッケージング(TSMC CoWoS-L)、HBM(SK Hynix)、DC建設──GPU世代交代のたびに構造的需要が発生。

⑥ Blackwellは「始まり」にすぎない。Vera Rubinの600kWを見据えた「拡張余地のある設計」が今の最重要判断。

結局こういうことです。Blackwell GB200 NVL72は、NVIDIAが初めて「空冷では不可能」と明言したGPU世代です。1ラック120kWという数字は、電力・冷却・床構造・ネットワークのすべてをBlackwell水準に引き上げることを要求します。しかし120kWは通過点に過ぎません。2027年のVera Rubinは600kW。「今のDCを液冷対応にする」だけでなく、「3年後の5倍に耐えられる設計にする」──この視野の広さが、Blackwell時代のDC設計に求められる判断力なのです。

❓ よくある質問(FAQ)

📖 【完全図解】液冷とは?DLC・液浸冷却・水冷の違いを初心者向けに整理 →

Blackwellの液冷要件を理解するための前提知識。DLC・リアドア・液浸の全体像から学べます。

📚 次に読むべき記事

NVL72の120kWを処理するCDUの仕組みを図解。

CDUの先にある「排熱の出口」。WUE 300倍改善の背景を構造で理解。

Blackwellが要求する「高密度DC」の4つの壁と選定基準。

GB200がCoWoS-Lを採用した理由と、CoWoS供給がAI産業のボトルネックになっている構造。

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント