ABOUT THIS SITE

AIを支える電力・冷却・半導体を、

技術者の言葉で。

このサイトは、AIの裏側で動いているデータセンター・電力・冷却・半導体・運用を、

できるだけわかりやすく、でも浅くならないように解説するメディアです。

投資家にも、学生にも、現場の技術者にも、「結局なにが起きているのか」が見える教科書を目指しています。

- このサイトが、なぜ「AIインフラ」を扱うのか

- どんな読者に向けて、どんな情報を発信するのか

- 他のAIニュースサイトと何が違うのか

- まずどのカテゴリから読めばいいのか

なぜ、このサイトを作ったのか

いまAIの話題は、毎日のように流れてきます。新しいモデル、新しいサービス、新しい調達額。 でも、そのニュースを少し深く見ていくと、最後は必ず現実の設備にぶつかります。 たとえば、GPUをどこに置くのか。どれだけの電力が必要なのか。なぜ液冷が必要なのか。送電網や受変電設備は追いつくのか。 つまり、AIはソフトウェアの話だけではなく、インフラの話でもあるのです。 世界のデータセンター電力消費は2024年に約415TWh、2030年には約945TWhへ拡大する見通しです。[IEA]

日本でも、AIとデータセンターの拡大は他人事ではありません。経済産業省の資料では、国内のデータセンター電力需要や接続需要の急増が示されており、 電力中央研究所の分析では、2034年度のデータセンター電力需要は44TWh、しかもその62%が東京圏に集中すると見込まれています。 これは「AIが伸びる」だけの話ではなく、電力・設備・地域偏在・制度まで含めて考えるべきテーマだということです。[資源エネルギー庁] [電力中央研究所]

それなのに、日本語の情報はまだまだ分断されています。AIサービス側の記事、半導体側の記事、電力側の記事、液冷側の記事はあっても、 それらをひとつの流れでつないで説明する場所は多くありません。 このサイトは、その「点」を「線」にするために作りました。

このサイトが大切にしていること

① 難しい話を、やさしく。でも雑にしない

電力、冷却、PUE、HBM、先端パッケージ、エージェントAI。 こうした言葉は、初めて触れるとかなりとっつきにくいですよね。 だからこのサイトでは、専門用語をなるべく噛み砕いて説明します。 ただし、わかりやすさのために本質を削りすぎることはしません。 「ざっくりわかった気になる記事」ではなく、あとから自分で一次情報を読める土台が残る記事を目指します。

② ニュースではなく、仕組みを追う

このサイトは、速報メディアではありません。 新製品や資金調達のニュースを追うよりも、その背景にある「なぜそうなるのか」を解説します。 たとえば「なぜGPUラックは高密度化するのか」「なぜ液冷が必要になるのか」「なぜ電力接続がボトルネックになるのか」といった、 時間が経っても価値が落ちにくい構造理解を重視します。

③ 技術・投資・学習をつなぐ

AIインフラの面白さは、ひとつの視点だけでは見えません。 技術者が見れば設計や設備の話になり、投資家が見れば供給制約や設備投資の話になり、 学生が見れば「これから何を学べばいいのか」という話になります。 このサイトでは、その3つを意識して、技術の話を現実の産業とキャリアにつなげて解説します。

このサイトで扱うテーマ

- 産業地図・企業分析:業界マップ、プレイヤー比較、設備投資構造の整理

- 学習ロードマップ・キャリア:学生や若手技術者向けに、学ぶ順番や必要スキルを案内

このサイトが、他のAI系サイトと違うところ

このサイトでよく出てくるキーワード

データセンター全体の消費電力が、IT機器の消費電力に対してどれだけ効率的かを見る指標です。Googleの2024年平均年間PUEは1.09でした。[Google Data Centers]

AI計算を大量にこなすGPUサーバを高密度に搭載したラックのこと。高発熱・高消費電力が大きな特徴です。

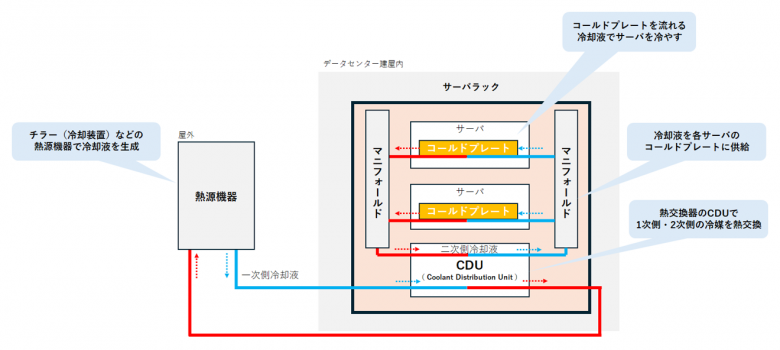

空気ではなく液体を使って熱を逃がす方式。IIJの記事では、従来の空冷は1ラック約20kWが限界とされる一方、高負荷サーバでは約100kW以上が必要な場合があると説明されています。[IIJ]

AI半導体で重要性が高まる高速・高帯域メモリ。GPUや先端パッケージの話と深くつながります。

こんな方に読んでほしいです

- AI関連のニュースを見ても、結局なにが重要かわからない方

- 半導体やデータセンター関連株を調べる前に、まず構造を理解したい投資家の方

- 電気・機械・情報系の学びが、AI時代にどうつながるのか知りたい学生の方

- 電力、設備、熱設計、通信、運用など、自分の仕事とAIの接点を探している技術者の方

編集方針

- できるだけ一次情報をあたり、出典を明記します

- わかりやすさを優先しつつ、誤解を生む単純化は避けます

- 煽り目的の個別株推奨や、過度に断定的な将来予測はしません

- 技術の話を、産業・投資・キャリアとつなげて考えます

- 読んだ後に「次に何を学べばいいか」がわかる導線を意識します

まずはここから読んでください

運営者について

運営者は、メーカーで技術領域に関わってきたブロガーです。 これまで統計学、QC検定、電気、設計といった「一見むずかしいテーマ」を、 できるだけ整理して、わかる言葉で伝える記事を書いてきました。

このサイトでもその姿勢は変わりません。 むずかしいテーマを、むずかしいまま放置しない。 かといって、軽く消費される情報にもしたくない。 読む人の理解が一段深くなるような、静かで骨太なメディアを目指しています。

もし「このテーマを解説してほしい」「このニュースの背景を知りたい」といったご要望があれば、 お問い合わせページやSNSから気軽にお知らせください。

まずは「AIデータセンター入門」から読むのがおすすめです。

全体像がつかめると、電力・冷却・半導体の話が一気につながって見えてきます。