「AIデータセンター」という言葉、最近ニュースやSNSで本当によく見かけるようになりましたよね。でも、こんなふうに感じていませんか?

- AIデータセンターと普通のデータセンター、結局何が違うの?

- GPUが大事なのはわかるけど、「その先」が見えない

- 「電力がヤバい」と聞くけど、なぜ急に問題になったのかピンとこない

- 投資や就職を考える前に、まず全体の地図が欲しい

- AIデータセンターの定義と3つの特徴

- 従来型との違いを7つの観点で比較

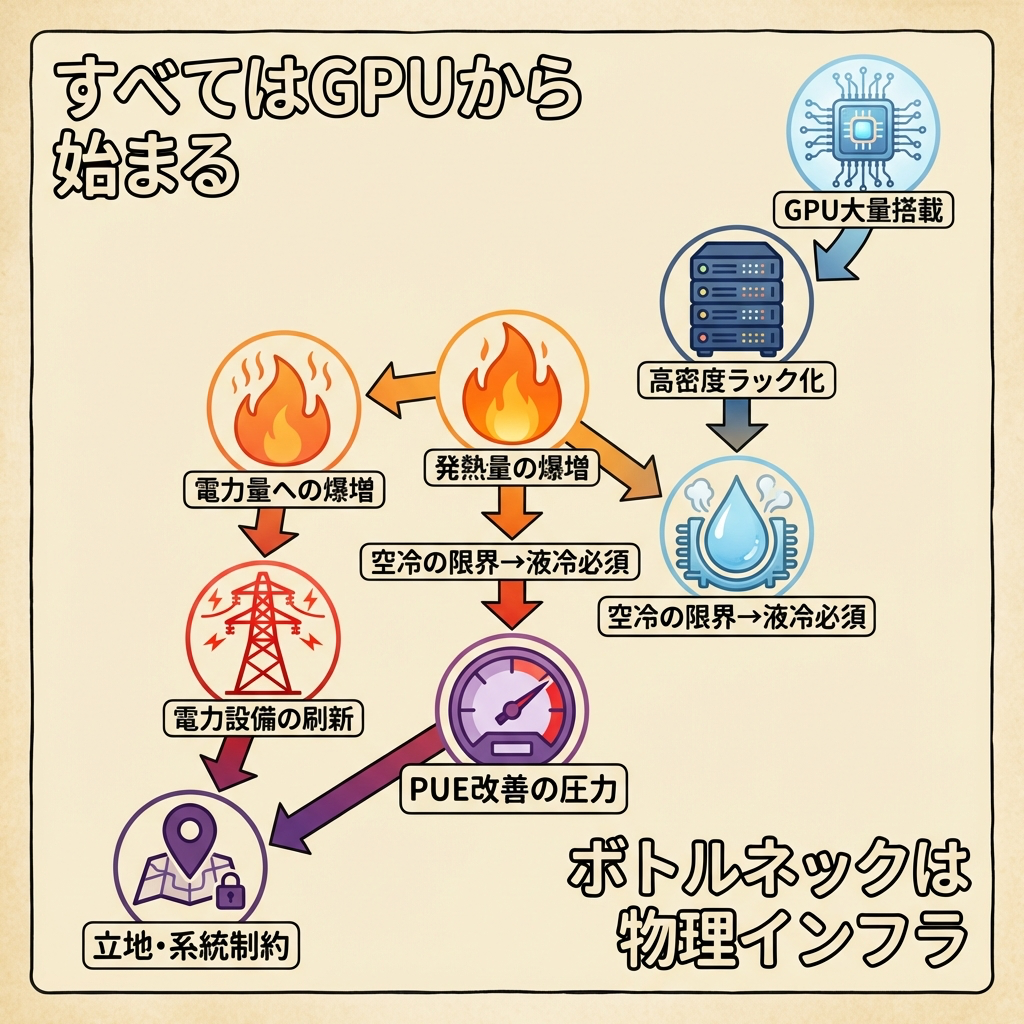

- GPU→発熱→液冷→電力→立地制約という「因果の連鎖」

- 日本が直面する固有の課題

- 投資家・学生・技術者それぞれにとっての意味

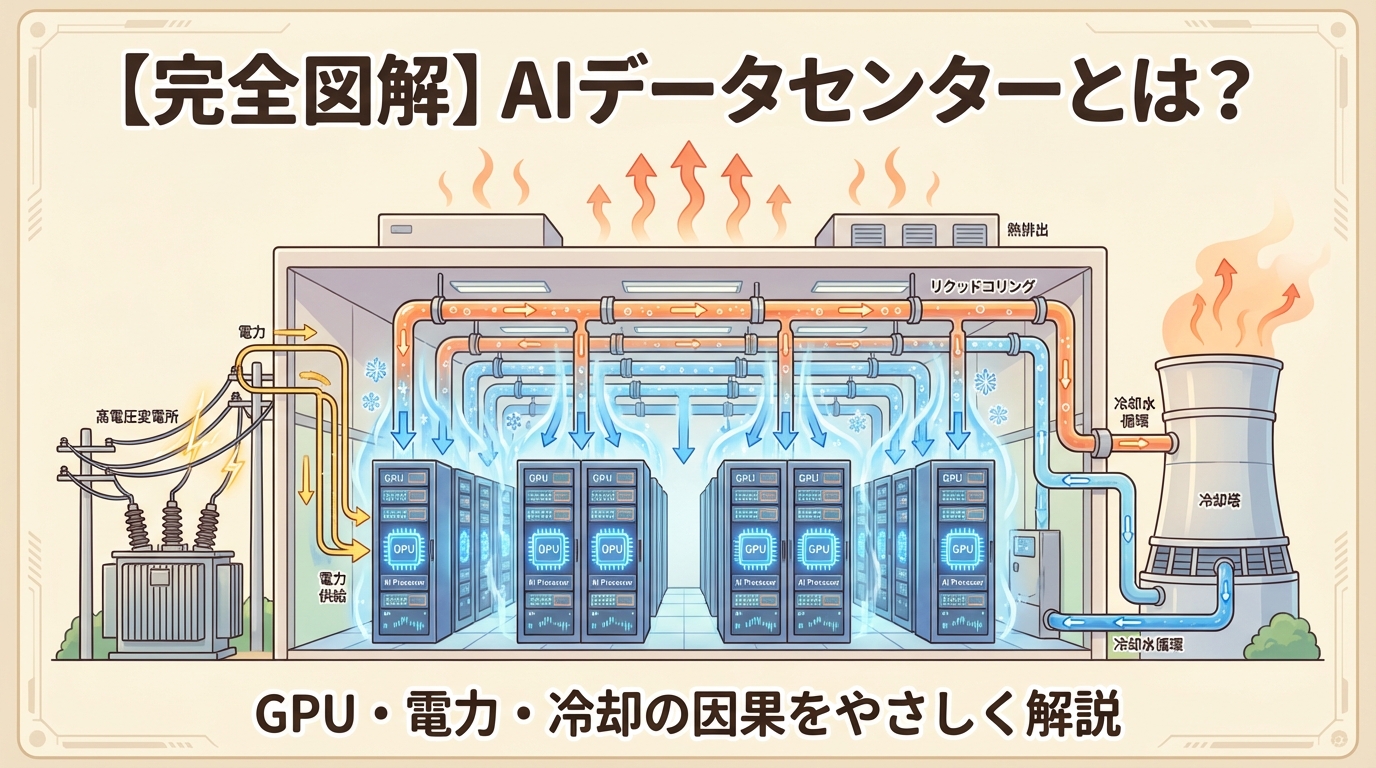

AIデータセンターとは、GPU(画像処理装置)を大量に搭載し、AI計算に特化したデータセンターのことです。従来型との最大の違いは「ラックあたりの電力密度が10倍以上」になること。ここから発熱→液冷→電力設備の刷新→系統接続制約→立地問題という因果の連鎖が生まれます。AIの進化を支えるボトルネックは、ソフトウェアではなく「物理インフラ」にあるのです。

この記事では、AIデータセンターの全体像を「なぜそうなるのか?」という因果関係まで掘り下げて解説します。表面的な話ではなく、構造を理解したい方のための記事です。

AIデータセンターとは? 30秒でわかる定義

🏭 一言でいうと「AI専用の計算工場」

AIデータセンターとは、AIの計算処理やデータ解析に特化したデータセンターのことです。

もう少しかみ砕くと、こうなります。普通のデータセンターが「いろんな荷物を保管・配送する大きな倉庫」だとすると、AIデータセンターは「超精密な製品を24時間フル回転で作り続ける専門工場」です。必要な設備も、求められる電力も、発生する熱も、まったく別次元になります。

ソフトバンクはAIデータセンターを「AI計算処理やデータ解析に特化し、GPU・高速ネットワーク・高度な冷却を備えた施設」と定義しています(出典:ソフトバンク公式)。IBMも同様に「AIワークロードのトレーニング・デプロイメントに必要な特定のITインフラを収容する施設」と説明しています(出典:IBM)。

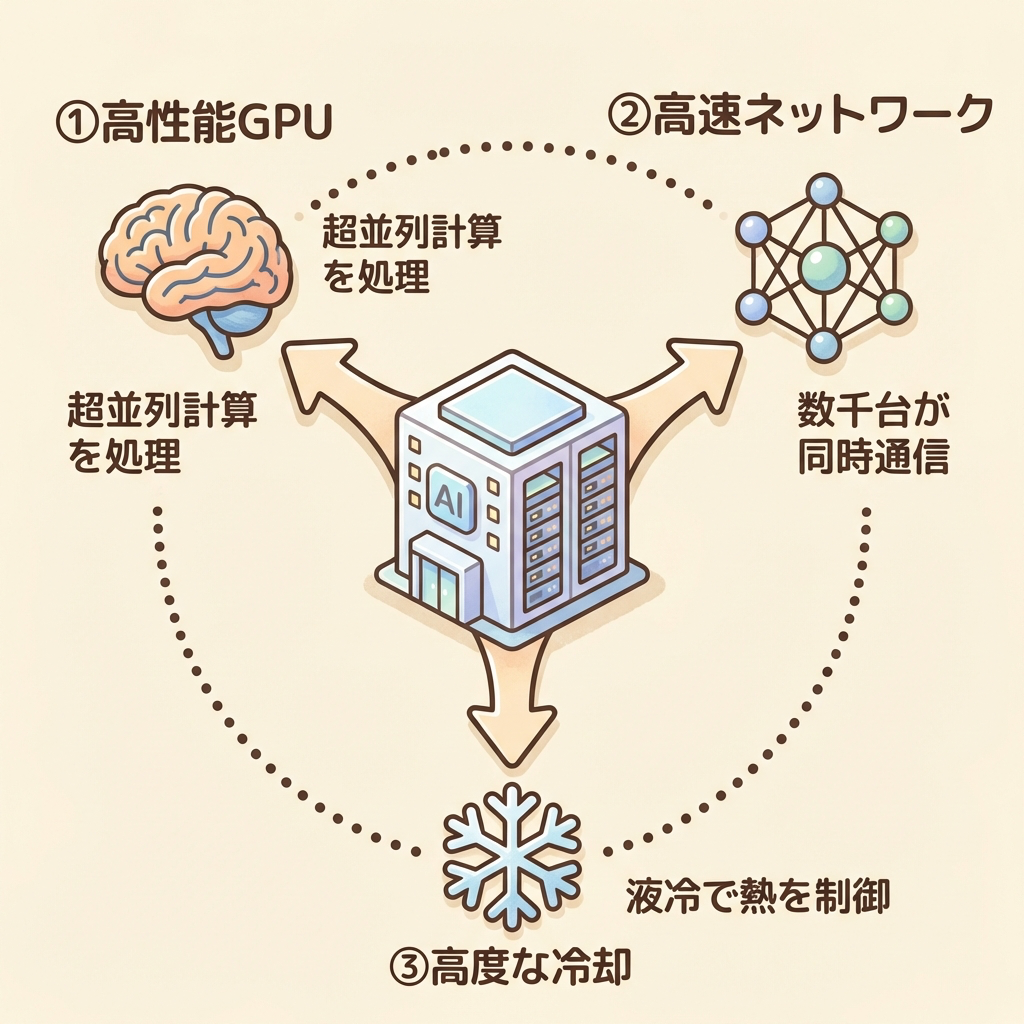

🔑 押さえるべき3つの特徴

AIデータセンターを理解するカギは、次の3つです。

① 高性能GPU

AIの「超並列計算」を処理するための専用チップ。従来のCPUでは処理が追いつかない。

② 高速ネットワーク

数千台のGPUが同時に通信するため、超広帯域・低遅延のネットワークが必須。

③ 高度な冷却システム

GPUの大量搭載による発熱は空冷では対処できず、液冷技術が不可欠に。

この3つは独立した話ではありません。GPUを大量に積むから高速ネットワークが必要になり、GPUが大量の熱を出すから高度な冷却が必要になる。すべてが因果関係でつながっています。この「つながり」を理解することが、AIデータセンターの本質をつかむ最短ルートです。

従来型データセンターとの違いを図解で比較

📊 比較表:7つの観点で見る決定的な差

まず、全体像を一気につかみましょう。以下の表を見れば、「何がどれだけ違うのか」が一目でわかります。

| 比較項目 | 従来型データセンター | AIデータセンター |

|---|---|---|

| 主な処理装置 | CPU(汎用プロセッサ) | GPU(超並列処理専用チップ) |

| 主な用途 | Webサーバー、メール、DB管理、クラウド | AIモデルの学習・推論、大規模言語モデル運用 |

| ラックあたり電力 | 5〜10 kW | 50〜120 kW(10倍以上) |

| 冷却方式 | 空冷(エアコン方式)が主流 | 液冷(水冷・液浸冷却)が必須 |

| ネットワーク | 数Gbps〜数十Gbps | 数百Gbps〜Tbps級(超広帯域) |

| 電力設備 | 一般的な受変電設備 | 特別高圧受電、専用変電所レベル |

| 施設規模 | 数MW〜数十MW | 数百MW〜GW級(大規模火力発電所並み) |

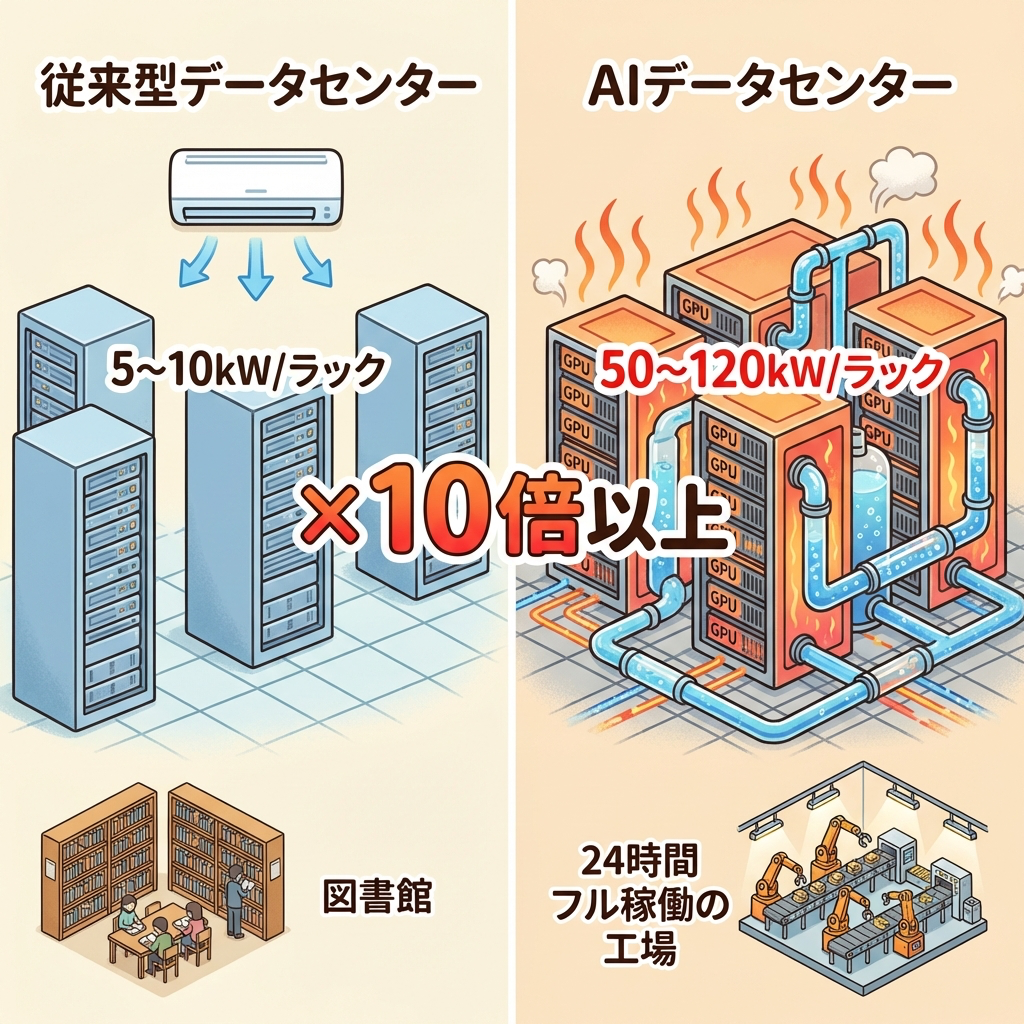

⚡ 最大の違いは「ラックあたりの電力密度」

表のなかで最も注目していただきたいのが、ラックあたりの電力密度です。

従来型データセンターでは、1つのサーバーラック(機器を収める棚のようなもの)の消費電力は5〜10kW程度でした。家庭用エアコン2〜3台分くらいのイメージですね。

ところが、AIデータセンターではこれが50〜120kWにまで跳ね上がります。NVIDIAの最新GPU「GB200 NVL72」を搭載したラックの消費電力は約120kWです(出典:NVIDIA公式)。次世代の「Rubin」世代では、ラックあたり600kWに達するという予測もあります。

ラック1本で120kW。これは一般家庭約40世帯分の電力に相当します。AIデータセンターにはこのラックが数百〜数千本並びます。大規模施設になると、1つのAIデータセンターだけで「大型火力発電所1基分」の電力を消費することも珍しくありません。

この「電力密度の桁違いの差」こそが、AIデータセンターのあらゆる課題の出発点です。ここから冷却・電力設備・立地問題が連鎖的に発生します。

従来型データセンター

- ラック電力:5〜10kW

- 冷却:空冷(エアコン)で対応可能

- 処理内容:Web/メール/クラウド

- 例えるなら:大きな図書館

AIデータセンター

- ラック電力:50〜120kW(10倍以上)

- 冷却:液冷が必須(空冷では限界)

- 処理内容:AIの学習・推論

- 例えるなら:超精密な24時間フル稼働工場

なぜGPUが必要なのか?

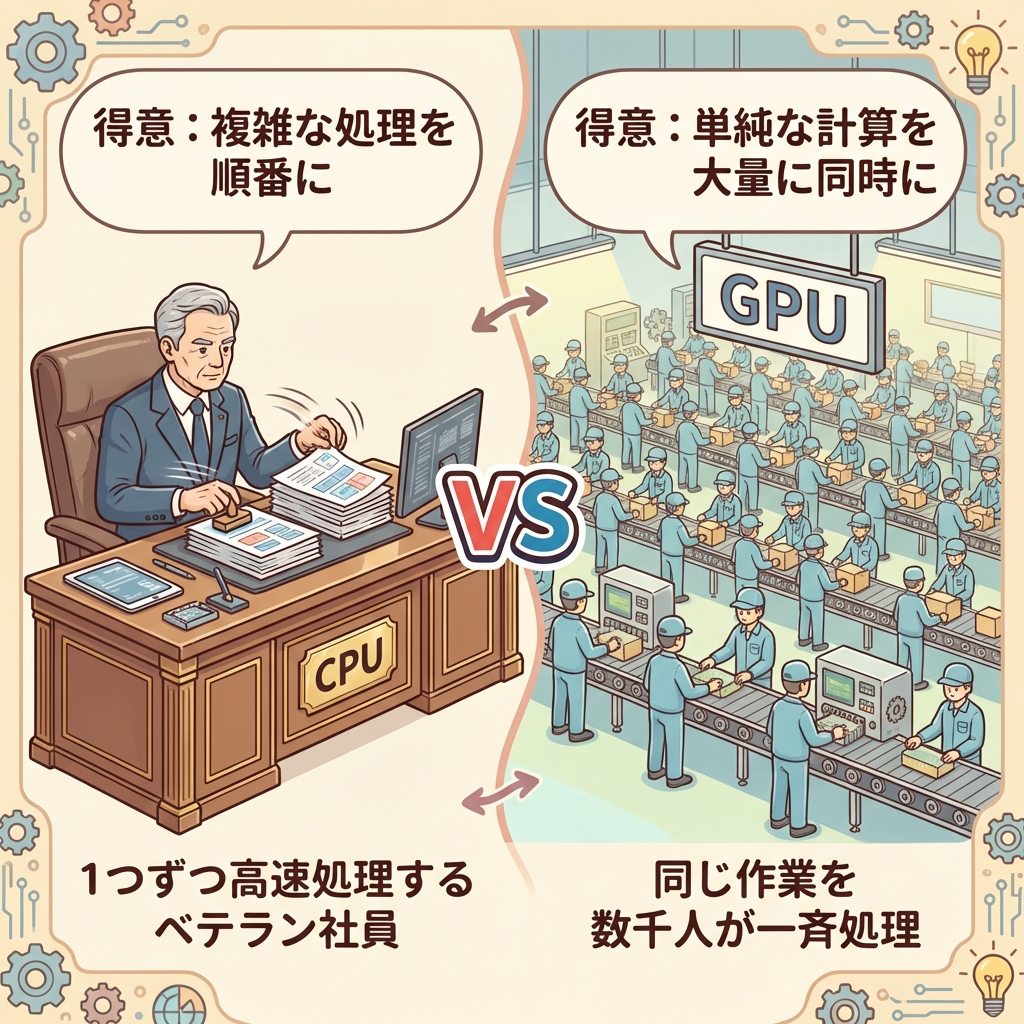

🔧 CPUとGPUの役割の違い

AIデータセンターを理解するうえで、まず「なぜCPUではダメなのか」を押さえておきましょう。

CPU(中央処理装置)は、パソコンの「頭脳」と呼ばれる汎用チップです。1つの処理を高速にこなすのが得意ですが、同時に大量の計算を並列で処理するのは苦手です。例えるなら、「ものすごく仕事が速いベテラン社員が1人で順番に仕事をこなす」イメージです。

一方、GPU(画像処理装置)は、もともとゲームの3D映像を描画するために開発されたチップです。何千もの小さな計算を同時並行で処理するのが得意です。こちらは「作業はシンプルだけど、数千人が一斉に同じ作業をこなす大規模チーム」のようなもの。

CPU

複雑な仕事を1つずつ高速にこなすベテラン社員。汎用的だが、大量の並列処理は苦手。

GPU

シンプルな作業を数千人が一斉に処理する大規模チーム。AI計算に最適化されている。

🧮 AI処理に必要な「超並列計算」とは

AIの学習(トレーニング)では何が起きているかというと、大量のデータに対して「同じような計算」を何兆回も繰り返しています。たとえばChatGPTのような大規模言語モデルの学習では、数兆個のパラメータ(数値の重み)を、膨大なテキストデータを使って少しずつ調整していきます。

この「同じような計算を大量に同時にこなす」という処理が、まさにGPUの得意分野です。NVIDIAのGPUが数万のコアを持ち、それらが並列に動くことで、CPUでは何ヶ月もかかる学習を数日〜数週間に短縮できます。

AIデータセンターにGPUが必要な理由は「AIの学習が超並列計算だから」です。CPUでは並列性が足りず、処理に膨大な時間がかかります。だからGPUを何千台、何万台と並べる必要があり、それがデータセンター全体の設計を根本から変えてしまうのです。

そしてここが重要なのですが、GPUは高い処理能力と引き換えに、大量の電力を消費し、猛烈な熱を発します。NVIDIAの最新GPU「Blackwell B200」の消費電力は1枚あたり約1,000Wです。これは電気ストーブ1台分に相当します。このGPUが1つのラックに数十枚搭載されるわけですから、発熱量は想像を超えるレベルになります。

つまり、「GPUが必要 → 大量のGPUを搭載 → 電力消費と発熱が爆増」。この因果関係が、AIデータセンターの設計をすべて規定しているのです。

なぜ電力と冷却が急に重要になったのか?

ここが、この記事の核心です。多くのニュース記事は「電力が足りない」「冷却が大変」と断片的に伝えますが、なぜそうなるのかの因果関係を見せてくれません。

以下の図を見てください。AIデータセンターで起きていることは、すべて1本の因果の連鎖でつながっています。

🔗 因果の連鎖:GPUから始まるすべての課題

AIの学習・推論に必要な超並列計算のために、1ラックに数十枚のGPUを搭載。

ラックあたりの電力密度が従来の5〜10kWから50〜120kWに急増。

消費電力の大部分が熱に変わる。GPU1枚1,000W級、ラック1本でアイロン数十台分。

空冷(エアコン方式)ではラック20kWが限界。50kW超の熱は液冷(水冷・液浸)でないと冷やせない。

施設全体の電力が数百MW〜GW級に。従来の受変電設備では足りず、専用変電所レベルの整備が必要。

冷却に使うエネルギーが全体の電力を押し上げる。PUEの改善が経営課題に。

電力を確保できる場所が限られる。日本では系統接続(送電網への接続)が最大のボトルネックに。

AIの進化を制約しているのは、モデルの性能やデータの量だけではありません。「GPUを冷やせるか」「電力を確保できるか」「送電網に接続できるか」という、きわめて物理的・インフラ的な制約が、AI産業の成長速度を決めているのです。

🌡️ 空冷の限界と液冷への移行

従来型データセンターの冷却は「空冷」が主流でした。要するに、強力なエアコンでサーバールーム全体を冷やす方式です。日本のデータセンターの9割以上がこの空冷方式を採用しています。

しかし、空冷で対応できるのはラックあたり20kW程度が限界です(出典:日経クロステック)。AIデータセンターのラックは50kW〜120kWですから、空冷ではまったく追いつきません。

そこで登場するのが液冷技術です。液冷とは、空気の代わりに水や特殊な冷却液を使ってチップの熱を直接奪う冷却方式です。液体は空気と比べて熱を奪う能力が格段に高いため、高密度ラックの冷却に対応できます。

KDDIの実証実験では、液浸冷却(サーバーを冷却オイルに丸ごと沈める方式)によりPUE値1.05を達成し、空冷と比べて94%の冷却電力削減に成功しています(出典:経済産業省 METI Journal)。

PUEとは? ── 電力効率を測る世界共通の指標

PUE(Power Usage Effectiveness:電力使用効率)とは、「データセンター全体の消費電力 ÷ IT機器の消費電力」で算出される指標です。値が1.0に近いほど効率的で、冷却や照明などのオーバーヘッドが少ないことを意味します。

| 分類 | PUE目安 | 意味 |

|---|---|---|

| 従来型DC(一般的) | 1.5〜1.8 | IT機器以外に50〜80%の電力が必要 |

| 日本の新しいDC(2014年以降) | 1.47 | 経済産業省の調査による平均値 |

| AI対応DC(優良) | 1.1〜1.3 | 液冷技術を活用した先進的施設 |

| Google(トップクラス) | 1.09 | 世界最高水準。オーバーヘッドわずか9% |

| KDDI液浸冷却(実証) | 1.05 | 冷却電力94%削減を実現 |

PUEが0.1改善するだけで、大規模施設では年間で億単位の電力コスト削減になります。AI時代のデータセンターにとって、PUEの改善は「単なる省エネ」ではなく「事業の存続」にかかわる問題です。

日本のAIデータセンターが直面する課題

ここまでの話は世界共通のテーマです。では、日本にはどんな固有の課題があるのでしょうか?

🗾 東京圏集中と「系統接続の壁」

日本のデータセンターは、約8割が東京圏と大阪圏に集中しています。特に千葉県印西市は「データセンター銀座」とも呼ばれ、国内外の事業者が集中的に建設を進めてきました。

印西市に集まる理由はシンプルです。東京に近くて低遅延の通信が確保できる、地盤が安定していて地震に強い、複数の変電所と通信バックボーンがある、といった好条件が揃っているからです。

しかし、ここに大きな壁が立ちはだかっています。系統接続(送電網への接続)の制約です。

経済産業省の資料によると、千葉県印西・白井エリアでは「供給可能量を超える申込みが集中」しており、新しいデータセンターが電力系統に接続するまでに最長で10年以上かかるケースも出ています(出典:経済産業省 系統設計WG資料(2025年10月))。

「日本のAIデータセンター問題=GPUが足りない」と思われがちですが、現実のボトルネックは「電力系統への接続」です。GPUがあっても、電力を引き込めなければ施設は動かせません。建物ができても電気が来ない──これが日本の最も深刻な課題です。

🌏 地方分散の動き ── 北海道・九州への展開

こうした都市部集中の限界に対し、日本でも地方分散の動きが加速しています。

代表的な例が、ソフトバンクが北海道苫小牧市に建設を進めるAIデータセンターです。冷涼な気候を活かした空調の省エネ化、再生可能エネルギー100%の活用を目指しています(出典:ソフトバンク公式)。

北海道は冷涼な気候による冷却コスト削減、九州は再生可能エネルギー(太陽光・地熱)の豊富さが注目されています。経済産業省も「GX戦略地域」として、電力とデータセンターを一体的に整備する構想を進めています。

ただし、地方展開には「東京からの距離による通信遅延」という課題もあります。AI推論のようにリアルタイム性が求められる処理は都市部の近くに、時間がかかっても良い大規模な学習処理は地方にという、用途に応じた役割分担が現実的な解になるでしょう。

あなたにとっての意味 ── 投資家・学生・技術者の視点

AIデータセンターの構造を理解したところで、「それが自分にとって何を意味するのか」を整理しましょう。

📈 投資家の方へ:

AI関連投資は「GPU銘柄」だけでは不十分です。因果の連鎖を理解すれば、液冷技術・電力設備・受変電・冷却素材など、GPUの「周辺」に膨大な産業機会があることがわかります。ボトルネックの位置が、次の成長領域を示しています。

🎓 学生の方へ:

「AI = 情報系だけ」ではありません。AIデータセンターの因果の連鎖を見れば、電気工学(電力設備・受変電)、機械工学(冷却・熱交換)、材料工学(冷却液・放熱素材)、建築・設備(データセンター設計)がAI産業の最前線に直結していることがわかります。理工系のほぼすべての専門がAI時代に活きるのです。

🔧 技術者の方へ:

受変電設備、空調、配管、制御、品質管理──あなたの実務スキルは、AIデータセンターの建設・運用で最も不足している専門性です。「AIの時代に自分の仕事は時代遅れでは?」と不安に感じる必要はありません。むしろ逆です。AIインフラの物理的なボトルネックを解決できるのは、現場を知る技術者だけです。

よくある誤解を整理する

❌ 誤解と ✅ 実際

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「GPUをたくさん買えばAIは進化する」 | GPUを動かすには電力・冷却・ネットワークが不可欠。物理インフラが律速段階になる。 |

| 「AIデータセンター=普通のDCの強化版」 | 電力密度が10倍以上違うため、冷却方式・電力設備・建物設計すべてが根本的に異なる。 |

| 「日本の問題はGPUの調達」 | 最大のボトルネックは電力系統への接続。GPUがあっても電気が来なければ稼働できない。 |

| 「AIインフラはソフトウェアの話」 | AIインフラの本質は、電力・冷却・設備・建設というきわめて物理的な産業。 |

まとめ:AIデータセンターの全体像

この記事の内容を一枚の地図として整理しましょう。

① AIデータセンターとは:GPU・高速ネットワーク・高度な冷却を備えた、AI計算に特化したデータセンター。

② 従来型との最大の違い:ラックあたりの電力密度が10倍以上(5〜10kW → 50〜120kW)。

③ GPUが必要な理由:AIの学習は「超並列計算」であり、CPUでは処理能力が圧倒的に不足するため。

④ 因果の連鎖:GPU大量搭載 → 高密度ラック → 発熱爆増 → 液冷必須 → 電力設備刷新 → PUE改善 → 立地制約。

⑤ 日本固有の課題:東京圏への集中と電力系統の接続制約。地方分散が加速中。

⑥ ボトルネックはソフトウェアではなく物理インフラ。電力・冷却・設備がAI産業の成長速度を決めている。

結局こういうことです。AIの進化は「賢いアルゴリズム」だけでは実現しません。それを動かすための電力を確保し、発熱を冷やし、送電網に接続するという物理的なインフラが必要です。そして今、その物理インフラが世界的なボトルネックになっている。これがAIデータセンターをめぐる議論の本質です。

❓ よくある質問(FAQ)

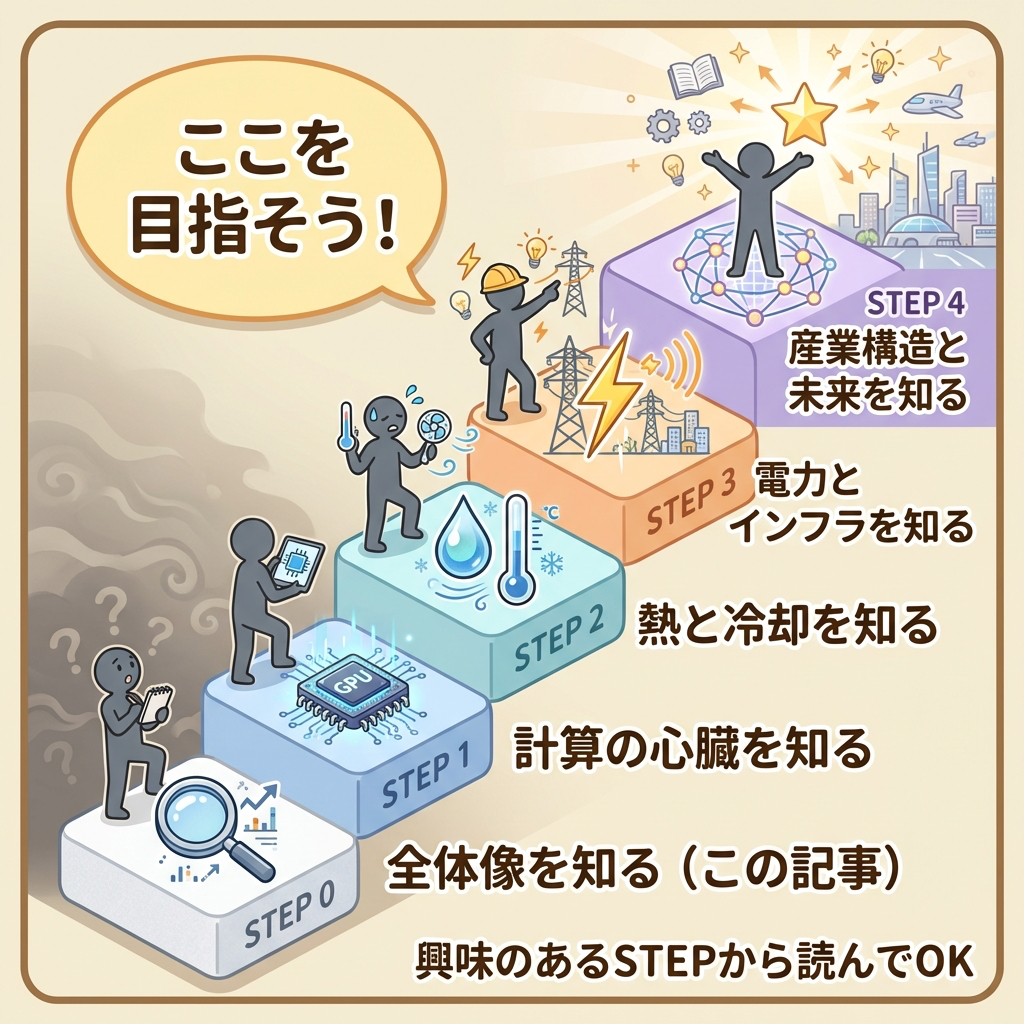

🗺️ 学習ロードマップ ── 次に何を学べばいいか

この記事で全体像をつかんだら、次は個別テーマを深掘りしていきましょう。AIデータセンターを構造的に理解するための学習順序を、ロードマップとしてまとめました。

📖 AIデータセンターとは?(この記事)

全体像と因果の連鎖を理解する入口。

📘 なぜAIにGPUが必要なのか?── CPUとの違い、NVIDIAの独占構造、次世代チップの動向

📘 HBM(高帯域幅メモリ)とは?── GPUの性能を引き出すメモリ技術

📘 空冷 vs 液冷 ── 何が違い、なぜ液冷が必須か

📘 液浸冷却とは?── サーバーを液体に沈める最先端技術

📘 PUEとは?── データセンターの電力効率を測る世界共通指標

📘 AIデータセンターの電力問題── なぜ電力が最大のボトルネックなのか

📘 日本の系統接続制約とは?── 印西問題と地方分散の展望

📘 再生可能エネルギーとデータセンター── 持続可能性と現実的な課題

📘 AIインフラの産業構造マップ── 誰が何を作り、どこがボトルネックか

📘 エッジAIとクラウドAIの違い── すべてをデータセンターで処理する時代は終わるか

📘 AI時代に求められるスキルと専門性── 投資・就職・キャリアの指針

すべてを一度に読む必要はありません。まずはこの記事で全体像をつかみ、興味のあるSTEPから読み進めてください。各記事は独立して読めますが、順番に読むと理解が深まる設計になっています。記事は順次公開予定です。

📚 次に読むべき記事(公開次第リンク追加)

AIデータセンターの心臓部「GPU」を深掘り。なぜNVIDIAが独占的な立場にあるのかも解説します。

なぜ空冷ではダメなのか?水冷・液浸冷却の仕組みと、日本企業の最新動向を解説します。

Goldman Sachsの165%予測の中身、日本の系統接続問題、電力会社の動きまで構造的に解説します。

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント