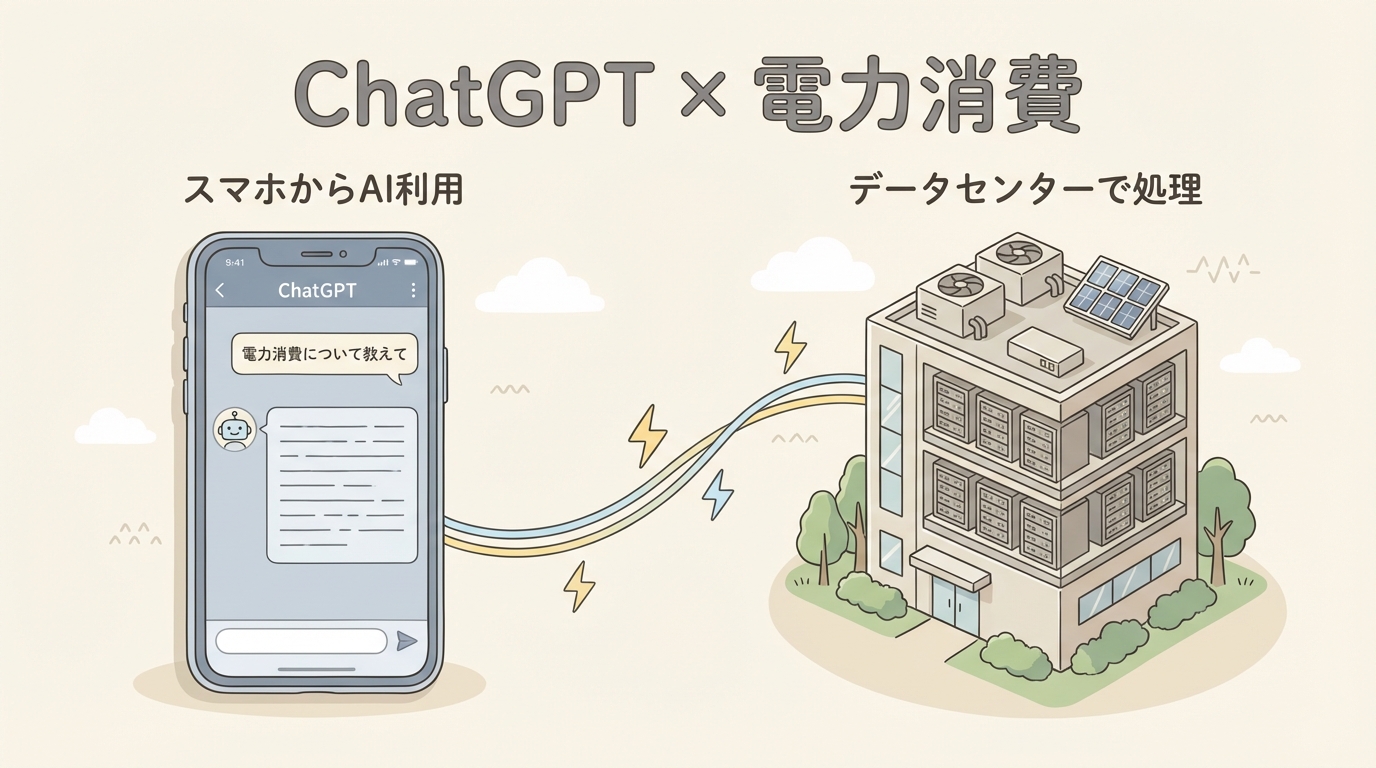

「ChatGPTはGoogle検索の10倍の電力を使う」──SNSやニュースで、こんな話を聞いたことはありませんか?

- 「10倍」って本当なの? どこからきた数字?

- ChatGPTを使うたびに、電気をムダにしてるの?

- AIの学習と普段の利用、どっちが電気を食うの?

- このまま増え続けたら、自分の電気代に影響するの?

- 「10倍」説の出どころと公式発表の食い違い

- ChatGPT・Google検索・Geminiの電力消費を正確に比較

- 「学習」より「推論」が電力消費の本丸である理由

- 1日25億回の質問が積み上がるとどうなるか

- 日本の家庭の電気料金への影響が出始めている構造

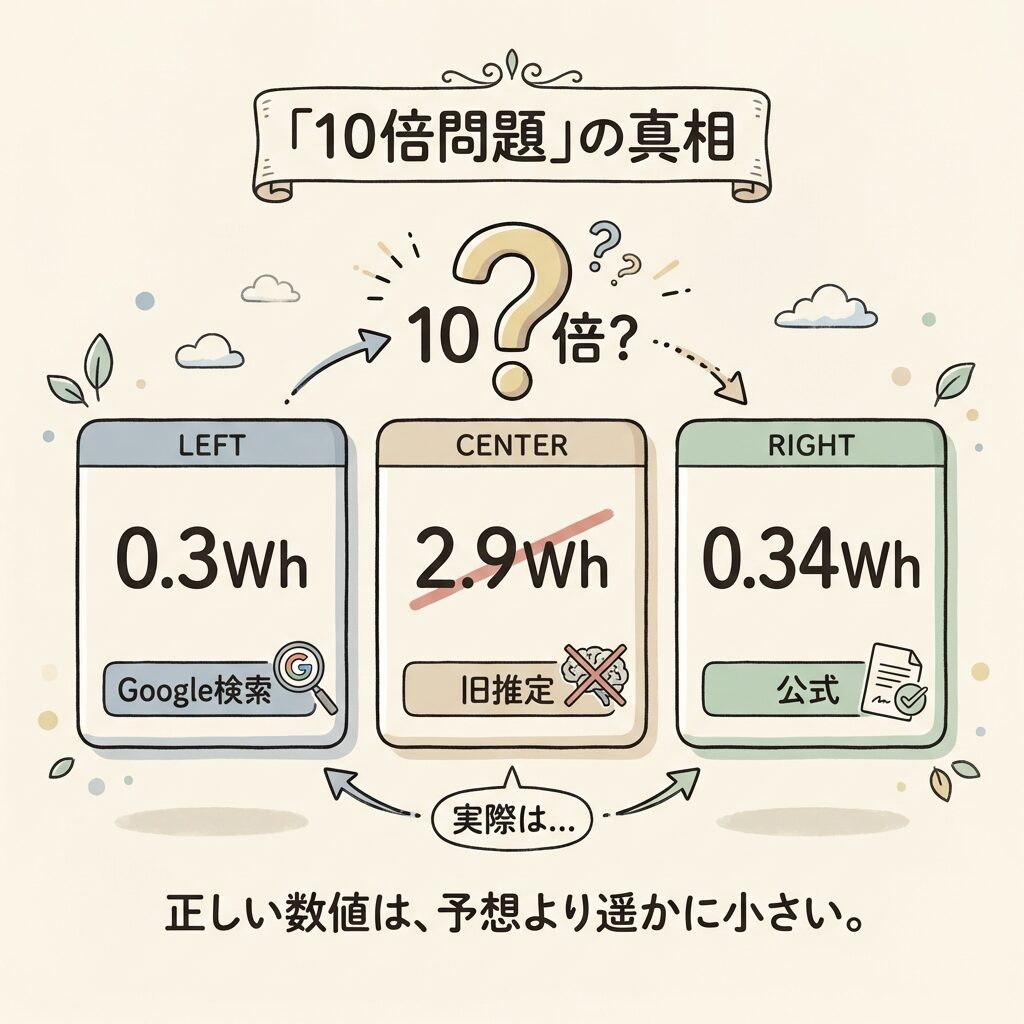

ChatGPT 1回の電力消費は、初期の推計では約2.9Wh(Google検索の約10倍)とされていましたが、2025年6月にOpenAI CEOのSam Altmanが公式に「平均0.34Wh」と発表しました(出典:Data Center Dynamics)。これはGoogle検索(約0.3Wh)とほぼ同水準です。しかし問題の本質は「1回の量」ではなく、ChatGPTだけで1日25億回、世界中のAIが24時間365日処理し続ける「推論」の総量にあります。ミシガン大学の研究では、AIセクターの電力消費の80〜90%は推論が占めます(出典:University of Michigan)。IEAは世界のデータセンター電力消費が2030年に945TWh(日本全体の電力消費を上回る規模)に倍増すると予測しています。「1回は小さくても、積み上がると国1つ分」──これがAIの電力問題の構造です。

「10倍」は本当か? ── 数字の出どころを正確に整理する

🔍 3つの数字を並べてみる

まず、SNSで広まった「10倍」がどこから来たのか、正確に整理しましょう。実は、時期によって数字が大きく変わっています。

「10倍」は、初期の外部推計2.9WhをGoogle検索の0.3Whで割った数字です。しかし2025年6月、OpenAI CEOのSam Altmanが公式に「平均的なクエリは約0.34Wh──オーブンを約1秒動かす程度」と発表しました(出典:The Verge)。

さらに2025年8月、GoogleもGeminiテキストプロンプト1回の電力を0.24Whと公表しています(出典:Google Cloud Blog)。

「ChatGPTは10倍の電力」は、いわば「新しいハイブリッド車は燃費が悪い」と試作車のデータで断言するようなもの。量産モデルで測り直したら、実はガソリン車とほぼ同じだった──というのが今の状況です。

📊 初期推計と公式発表の違い

| 項目 | 初期推計(2024年) | 公式発表(2025年) |

|---|---|---|

| ChatGPT 1回 | 約2.9Wh | 約0.34Wh |

| 対Google検索比 | 約10倍 | ほぼ同水準 |

| データの出どころ | 外部研究者の間接推計 | OpenAI CEO(実運用データ) |

| 差が出た理由 | 旧モデル(GPT-3.5ベース)の非効率な推計 | GPT-4o世代の効率化が反映 |

0.34Whは「平均的なテキスト質問」の値です。画像生成、コード生成、推論モデル(o3等)など複雑な処理はもっと電力を消費します。また、OpenAI自身の発表であるため、第三者による検証が十分とは言えないという指摘もあります(出典:Towards Data Science)。数字はあくまで「目安」として捉えてください。

1回は小さい。でも1日25億回が積み上がると?

📱 ChatGPTだけで1日25億回

2025年7月、OpenAIは「ChatGPTは1日あたり25億件以上のプロンプトを処理している」と発表しました。半年前の10億件から2.5倍に急増しています(出典:TechCrunch)。

ユーザーがAIに送る質問や指示のこと。「ChatGPTに1回質問する」=「1プロンプトを送る」と同じ意味です。

この数字を使って、ChatGPT「だけ」の1日の電力消費を計算してみましょう。

1日のクエリ数:25億回

1回あたりの消費電力:0.34Wh(公式発表値)

1日の合計:25億 × 0.34Wh = 約85万kWh/日

年間に換算:85万kWh × 365日 = 約3.1億kWh/年

年間約3.1億kWhとは、どのくらいの規模でしょうか?

1回0.34Whは「ほぼ無視できる量」。しかしそれが1日25億回 × 365日繰り返されると小都市1つ分の電力に。しかもこれはChatGPTだけの話。世界中のAIサービスを合わせれば桁がさらに上がります。「1回は小さいが、積み上がると巨大」──これがAI電力問題の本質です。

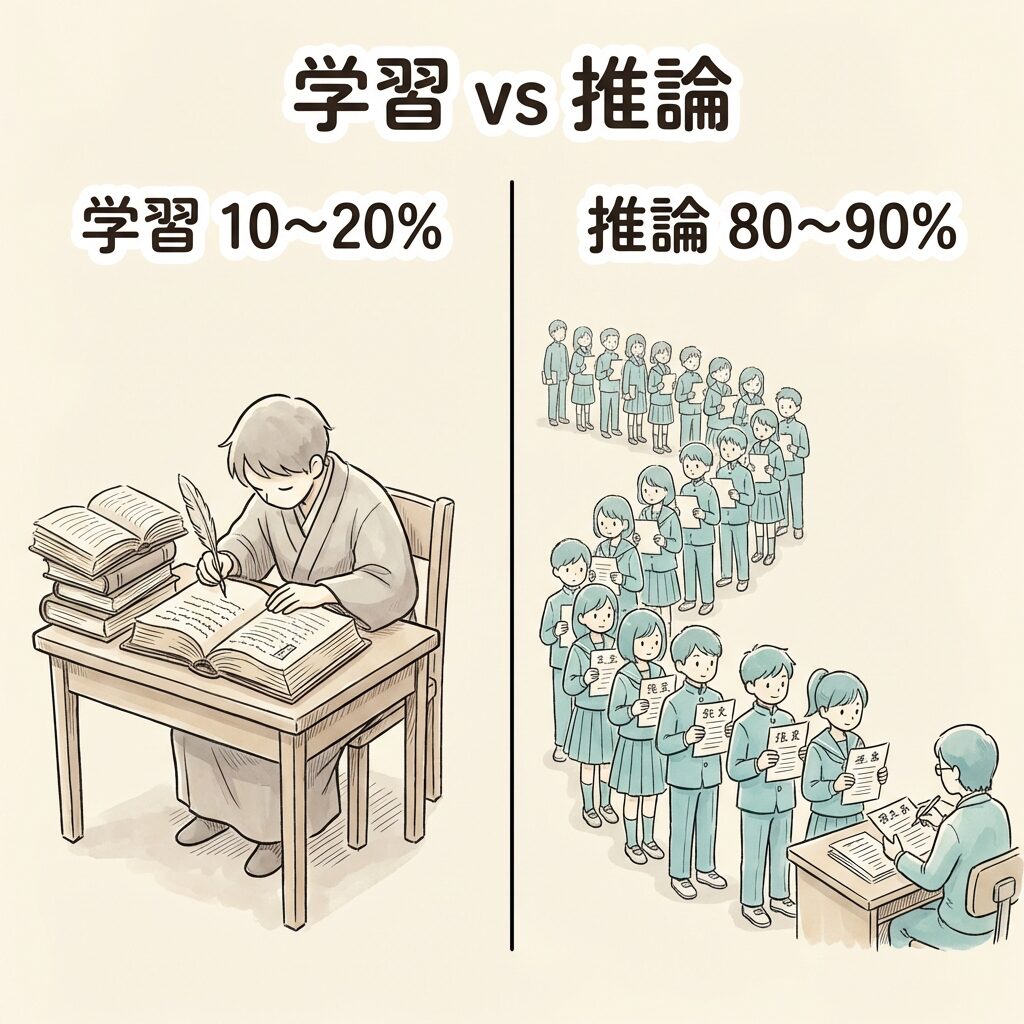

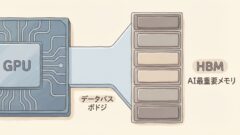

「学習」より「推論」が電力消費の本丸 ── 90%は日常利用から

📚 学習と推論 ── どちらが電力を食うのか?

AI処理には「学習(トレーニング)」と「推論(インファレンス)」の2種類があります。多くの方が「AIの電力問題=学習コスト」だと思いがちですが、実は逆です。

学習(トレーニング)

大量のデータを使ってAIに「知識」を教え込む作業。1回の学習で膨大な電力を消費するが、やるのは「1回(またはモデル更新時)」だけ。

例え:何百冊の教科書を読んで知識を身につける段階。

推論(インファレンス)

学習済みモデルでユーザーの質問に答える作業。1回の消費は小さいが、24時間365日、世界中で膨大な回数実行される。

例え:身につけた知識で毎日テストに答え続ける段階。

📊 電力消費の「総量」は推論が圧倒的

ミシガン大学の研究(2026年2月)によれば、AIセクターの電力消費の80〜90%は推論(日常利用)が占めるとされています(出典:University of Michigan)。

10〜20%

出典:ミシガン大学研究(2026年2月)の推計を基に構成

学習は「教科書を一度だけ書く」作業で大変だけど1回限り。推論は「その教科書を使って世界中の生徒のテストを毎日採点し続ける」作業。テスト1枚は軽いけど、生徒が25億人いて毎日提出してくるとしたら──電力消費の大部分が推論側になるのは当然ですよね。

「AIの電力問題=学習コストの問題」と思われがちですが、本当のインパクトは推論にあります。ChatGPTを使う人が増えるほど、画像生成AIが普及するほど、推論の電力消費は加速度的に増えていきます。

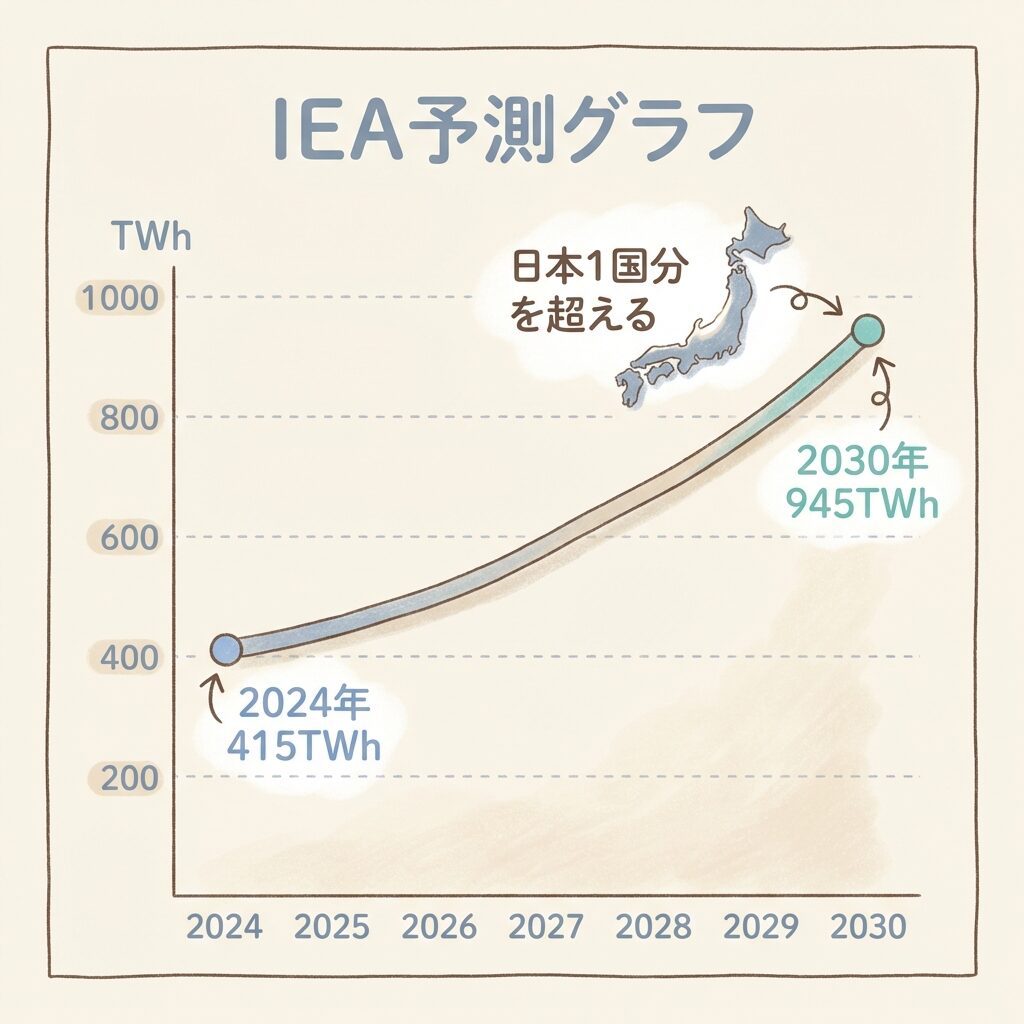

世界全体ではどれくらい増えるのか ── IEA予測:2030年に倍増

🌍 データセンターの電力消費は「日本1国分」を超える

ChatGPTは世界中のAIの一部にすぎません。世界全体のデータセンターの電力消費はどうなっているのでしょうか。IEA(国際エネルギー機関)が2025年4月に公表した報告書「Energy and AI」の予測を見てみましょう。

| 年 | 世界のDC電力消費 | 身近な比較 |

|---|---|---|

| 2024年 | 約415TWh | フランスの年間電力消費量に匹敵 |

| 2030年 | 約945TWh | 日本全体の年間電力消費量を上回る |

出典:IEA「Energy and AI」(2025年4月)

2030年の予測値である945TWhは、現在の日本の年間電力消費量(約860〜900TWh)をわずかに上回る規模です。つまり世界中のデータセンターが「もう1つの日本」分の電力を使う時代が来るのです。

年率15%の成長は、世界全体の電力需要成長率の4倍以上のペースです(出典:IEA)。AIの電力問題は「大きいか小さいか」ではなく、「増加の速度」が他のすべてを上回っていることが本質です。

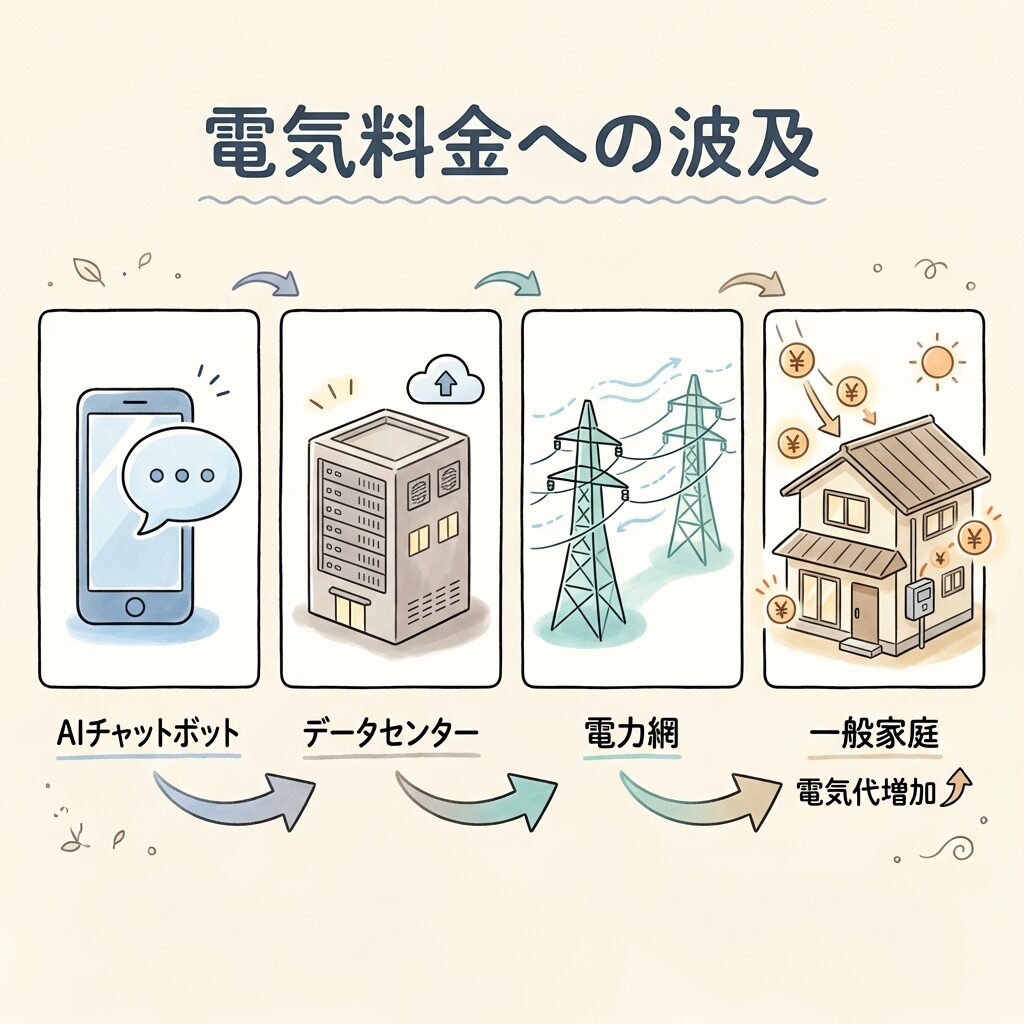

あなたの電気代に影響するの? ── 日本への波及が始まっている

🇺🇸 アメリカではすでに家庭の電気代に影響

「AIの電力消費が増えると、自分の電気代も上がるの?」──これは多くの方が感じる素朴な疑問です。結論から言えば、アメリカではすでに影響が出始めています。

日本経済新聞の報道(2025年9月)によると、米国では電力大手による値上げ申請が相次いでおり、データセンター需要の増加に伴う送配電投資の増加が、家庭向け電気料金の2割上昇につながるケースも出ています(出典:日本経済新聞)。

🇯🇵 日本はどうなるのか

日本でも、データセンターの電力需要は急拡大しています。資源エネルギー庁の推計では、国内のデータセンター容量は2030年に約4〜5GWと現在の約2倍に達する見通しです(出典:資源エネルギー庁)。

現時点で日本の家庭向け電気料金への直接的な転嫁は限定的ですが、RIETI(経済産業研究所)のレポートは「データセンターへの電力供給に必要な新たな電力インフラの費用は、全消費者に転嫁される」と指摘しています(出典:RIETI)。

日本では今すぐ「AIのせいで電気代が上がった」という状況ではありませんが、送電網の増強コストや電力需給の逼迫は、中長期的に料金に反映される構造になっています。特に千葉県印西市のように系統接続が逼迫しているエリアでは、電力インフラの増強投資が進んでおり、そのコストは最終的に電気料金に反映されることになります。

あなたにとっての意味 ── 投資家・学生・技術者の視点

AIの電力消費が増えるほど、電力インフラ全体のサプライチェーンに構造的な需要が生まれます。GPU銘柄だけでなく、電力設備(富士電機)、冷却(ニデック、ダイキン)、送電ケーブル(フジクラ、古河電工)、データセンター建設(大成建設、NTTファシリティーズ)まで──「推論の電力消費が80〜90%」という構造を知れば、見るべき銘柄の幅が広がります。

「AIの電力問題」は、情報系だけでは解決できません。電力工学、熱工学、材料科学、都市計画──理工系のほぼすべての分野がAIの電力問題に接続しています。「AI=情報系の仕事」という思い込みを壊す最も強い根拠が、この電力問題です。

受変電設備、冷却、配管、施工管理──あなたの専門こそが、AIの電力問題を物理的に解決できる唯一のスキルです。データセンターの電力需要が2倍になるということは、あなたの専門性への需要も2倍になるということ。「AIに仕事を奪われる」どころか、AIインフラを支える最前線にいるのがあなたです。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「ChatGPTはGoogle検索の10倍電力を使う」 | 初期推計(2.9Wh)に基づく数字。公式発表は0.34Whで、Google検索(0.3Wh)とほぼ同水準。ただし複雑な処理ではもっと消費する。 |

| 「1回が小さいなら問題ない」 | ChatGPTだけで1日25億回。世界中のAIを合わせた「推論の総量」が問題。年間で小都市1つ分以上の電力を消費。 |

| 「AIの電力問題=学習コスト」 | AIの生涯電力消費の80〜90%は推論(日常利用)。学習は1回限りだが、推論は止まらない。 |

| 「日本の電気代には関係ない」 | 米国ではDC需要増が電気料金2割上昇の要因に。日本でも送電網の増強コストは中長期的に全消費者に転嫁される構造。 |

| 「技術が進歩すれば解決する」 | GPU 1基の効率は改善しているが、AIモデルの大規模化と利用者の増加が効率改善を上回るペース。総消費電力は増え続けている。 |

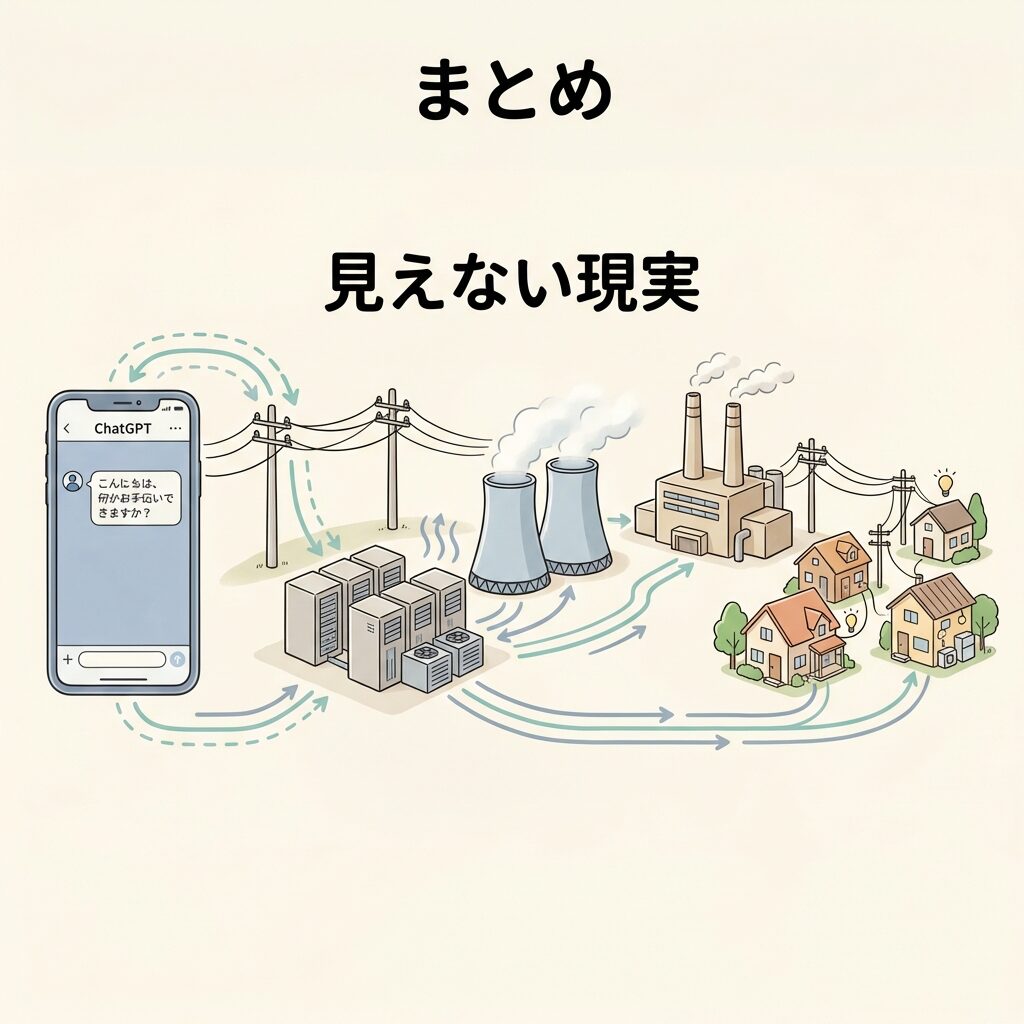

まとめ:AIの電力消費の全体像

① 「10倍」の真相:初期推計2.9Whは旧モデルベース。公式発表は0.34Whで、Google検索(0.3Wh)とほぼ同水準。ただし複雑な処理はもっと消費する。

② 問題の本質は「積み上がり」:ChatGPTだけで1日25億回 × 365日。年間約3.1億kWh(小都市1つ分)。世界中のAIの合計はさらに桁違い。

③ 推論が80〜90%:AIの電力消費の大部分は「学習」ではなく「推論(日常利用)」。利用者が増えるほど加速する構造。

④ 世界で倍増:IEA予測で2030年にDC電力消費は945TWh(日本全体を上回る規模)。年率15%成長。

⑤ 電気料金への波及:米国ではDC需要増が電気代2割上昇の一因に。日本でも中長期的に送電インフラのコストが全消費者に転嫁される構造。

⑥ 1回は小さくても、積み上がると国1つ分。これがAI電力問題の構造です。

結局こういうことです。ChatGPT 1回の電力消費は「オーブンを1秒動かす程度」で、個人が罪悪感を感じるレベルではありません。しかしそれが1日25億回、世界中で止まることなく繰り返されると、国1つ分の電力を飲み込む巨大な需要になります。そしてその需要を支えるのは、発電所・送電線・変電設備・冷却装置というきわめて物理的なインフラです。AIの電力問題は、スマホの向こう側にある「見えない現実」なのです。

❓ よくある質問(FAQ)

📖 【完全図解】AIデータセンターはなぜ電気を食うのか?電力需要の構造をやさしく整理 →

GPUの電力消費→冷却→施設全体の3層構造を詳しく解説。この記事の「続き」にあたる内容です。

📚 次に読むべき記事

「1回の質問」の先にある、データセンター全体の電力構造を理解する。この記事の直接の続き。

GPU→発熱→液冷→電力→立地制約という因果の連鎖の全体像を理解するピラー記事。

電力を「効率よく使えているか」を測る指標。冷却電力の問題がわかります。

日本のDC建設ラッシュの背景と、系統接続の壁、地方分散の動き。

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント