「PUE」という言葉、AIデータセンターの記事を読んでいると頻繁に出てきますよね。でも、こんなふうに感じていませんか?

- PUEって何の略? 計算式を見てもピンとこない

- 「PUE 1.09」「PUE 1.56」と言われても、何がどう良いのかわからない

- AIデータセンターの文脈でなぜPUEが重要なのか、つながりが見えない

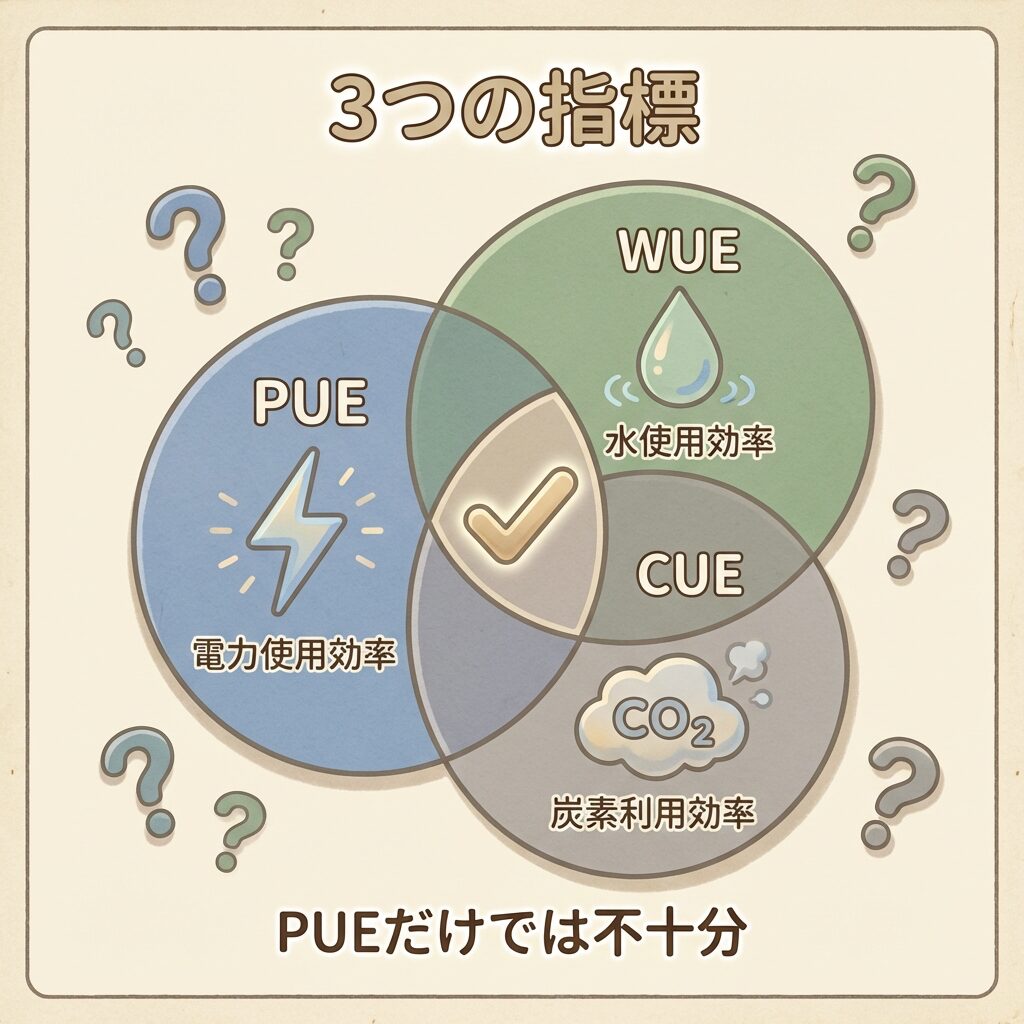

- PUEだけ見ればいいの? 他に気にすべき指標はないの?

- PUEの意味・計算式・読み方を図解で完全理解

- 「1.0に近いほど良い」理由をお金のたとえで直感的に理解

- Google(1.09)と業界平均(1.56)の差が生まれる構造

- PUEだけでは語れない理由と補完指標(WUE・CUE)

- AI時代にPUEが再注目される理由と日本の制度動向

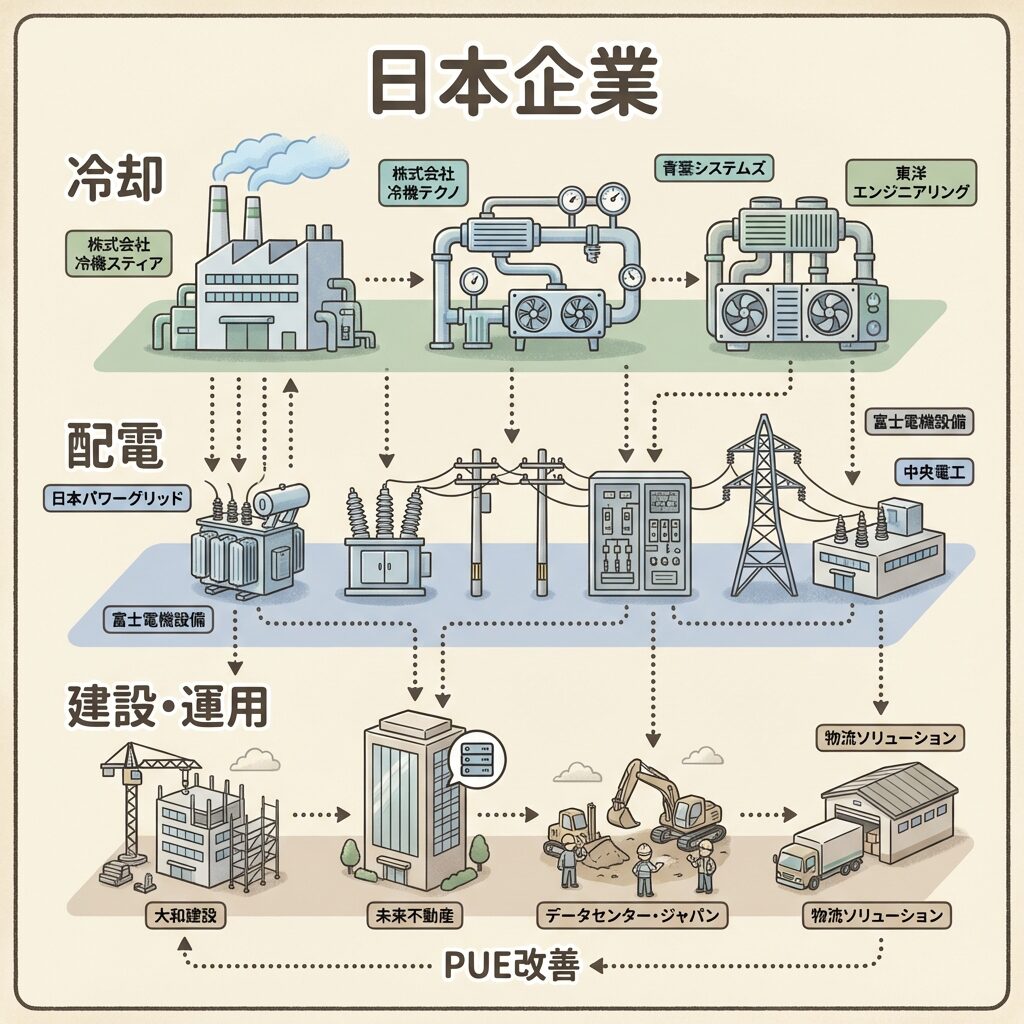

- PUE改善に関わる日本企業の具体名

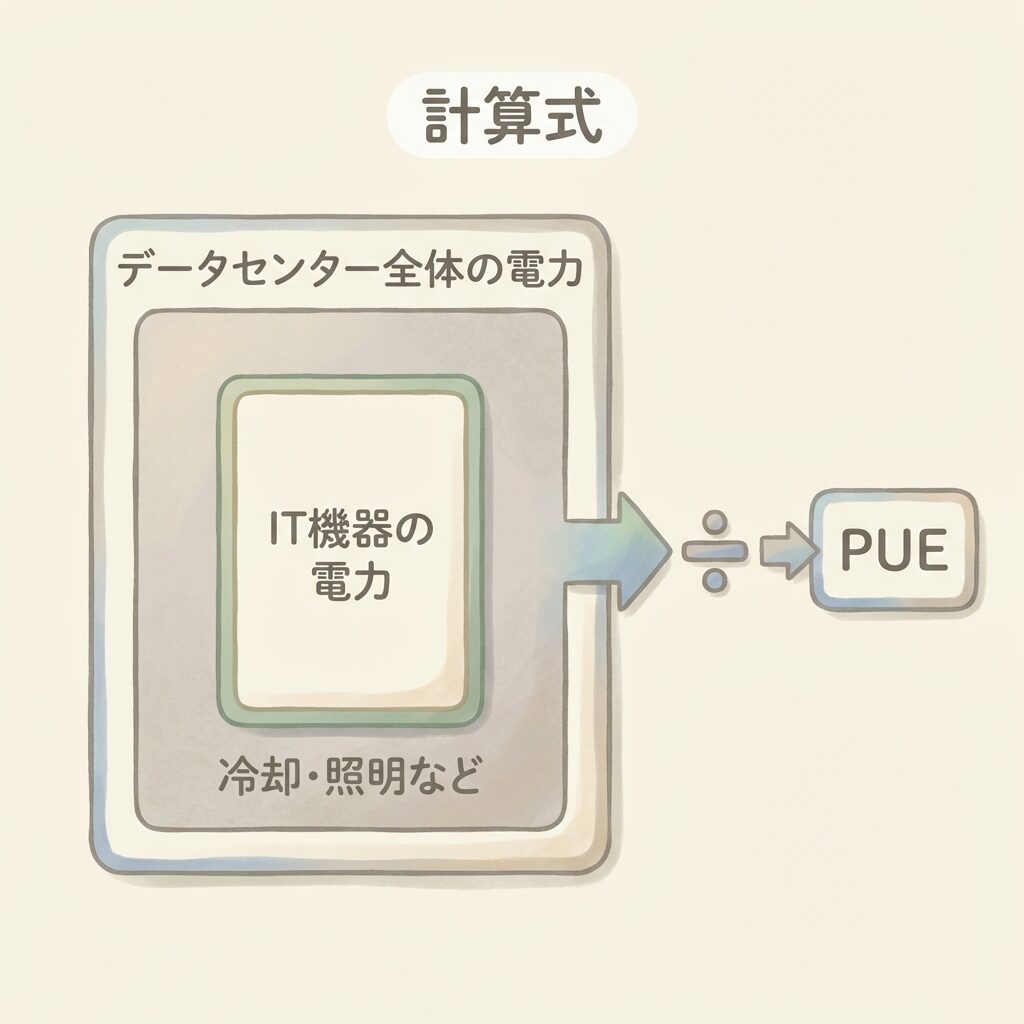

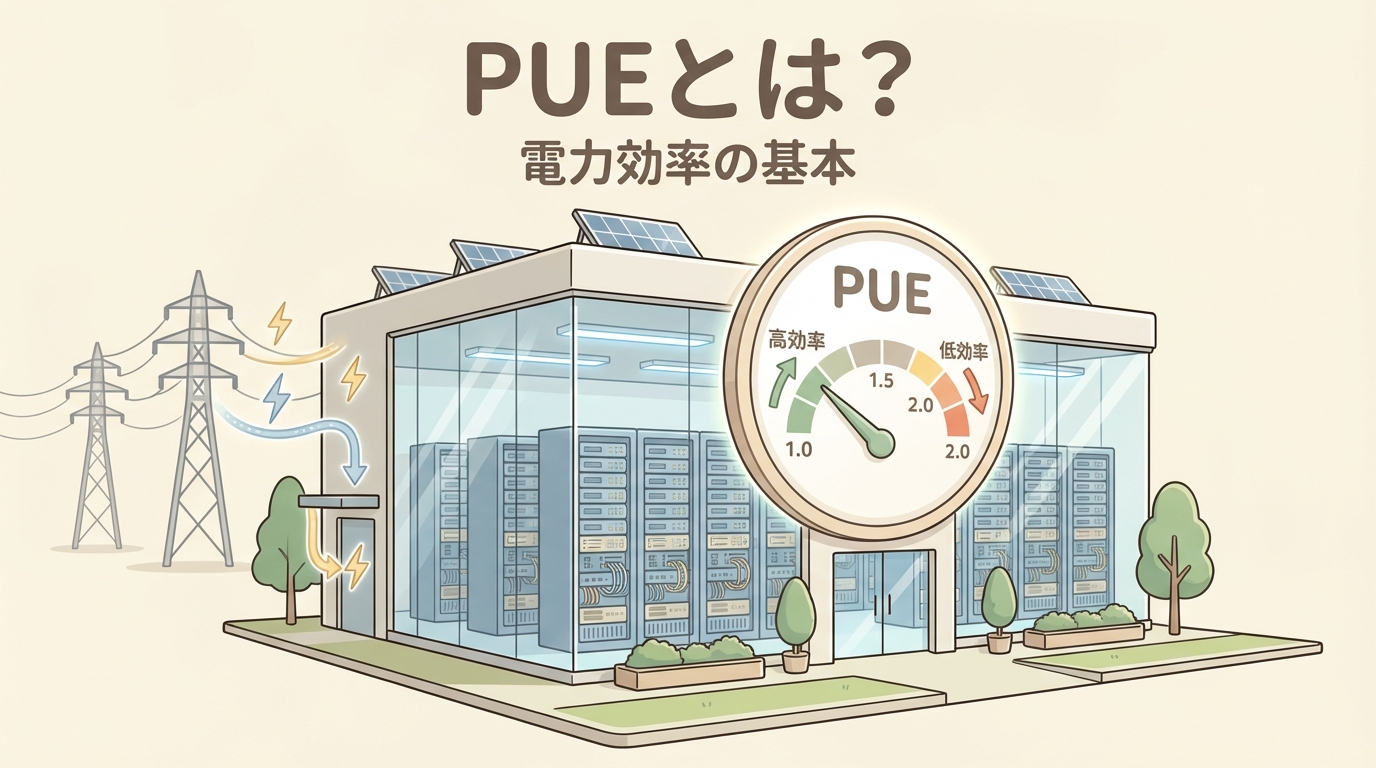

PUE(Power Usage Effectiveness)とは、「データセンター全体の消費電力 ÷ IT機器の消費電力」で算出される、電力効率の世界共通指標です。値は必ず1.0以上になり、1.0に近いほど「IT機器以外(冷却・照明など)の電力ロスが少なく、効率的」であることを示します。業界平均は1.56、Googleは1.09。この差は「年間で億単位の電力コスト」の違いに直結します。AI時代にGPUの消費電力が爆増したことで、PUE改善は「単なる省エネ指標」から「AIデータセンターの事業存続に関わる経営指標」へと格上げされています。

この記事では、PUEを「聞いたことはあるけど、ちゃんと説明できない」レベルから、「人に教えられる」レベルまで引き上げます。計算式の暗記ではなく、なぜこの指標が重要なのかを構造から理解することを目指します。

PUEとは? ── 意味と計算式を30秒で理解する

📐 一言でいうと「データセンターの電力の使い方を測る指標」

PUE(Power Usage Effectiveness:電力使用効率)とは、データセンターがどれだけ効率的に電力を使えているかを示す世界共通の指標です。2007年にThe Green Gridという業界団体が提唱し、現在ではISO/IEC 30134-2として国際標準化されています。

計算式は驚くほどシンプルです。

ここで「データセンター全体の消費電力」には、サーバーなどのIT機器に加えて、冷却装置(空調・液冷)、照明、セキュリティシステム、UPS(無停電電源装置)のロスなど、施設を運営するためのすべての電力が含まれます。一方、「IT機器の消費電力」は、サーバー・ストレージ・ネットワーク機器など、実際にデータ処理を行っている機器だけの電力です。

💰 「お金」のたとえで直感的に理解する

計算式だけだとピンとこないかもしれないので、お金に例えてみましょう。

あなたが会社に100万円の予算を渡したとします。この100万円が「データセンター全体の消費電力」に相当します。このうち、実際に「仕事」に使われた金額がIT機器の消費電力です。残りは家賃、光熱費、事務費などの「間接コスト」──データセンターで言えば冷却や照明の電力です。

PUE 2.0 の場合

100万円渡して、仕事に使われたのは50万円だけ。残り50万円は冷却や照明など「オーバーヘッド」に消えた。つまり半分が間接コスト。

PUE 1.09 の場合

100万円渡して、仕事に使われたのは約92万円。間接コストはわずか8万円。電力のほとんどが「本来の計算処理」に使われている。

PUEが1.0に近いほど「本来の仕事(IT処理)」に電力が使われている=効率的。PUEが高いほど、冷却や照明など「仕事以外」に電力が浪費されている=非効率。これがPUEの本質です。

「IT電力」と「施設電力」── PUEの分子と分母を図解する

🔌 データセンターの電力は2つに分かれる

PUEを正しく理解するには、データセンターの電力が「IT機器の電力」と「施設オーバーヘッドの電力」の2つに大別されることを押さえましょう。

IT機器の消費電力(PUEの分母)

・サーバー(CPU・GPU)

・ストレージ(SSD・HDD)

・ネットワーク機器(スイッチ・ルーター)

・関連する補助機器

施設オーバーヘッドの電力

・冷却設備(空調・液冷・チラー)

・UPS(無停電電源装置)の変換ロス

・照明・セキュリティ

・配電設備の損失

PUE =(IT電力 + オーバーヘッド電力)÷ IT電力。

オーバーヘッドが小さいほどPUEは1.0に近づく。

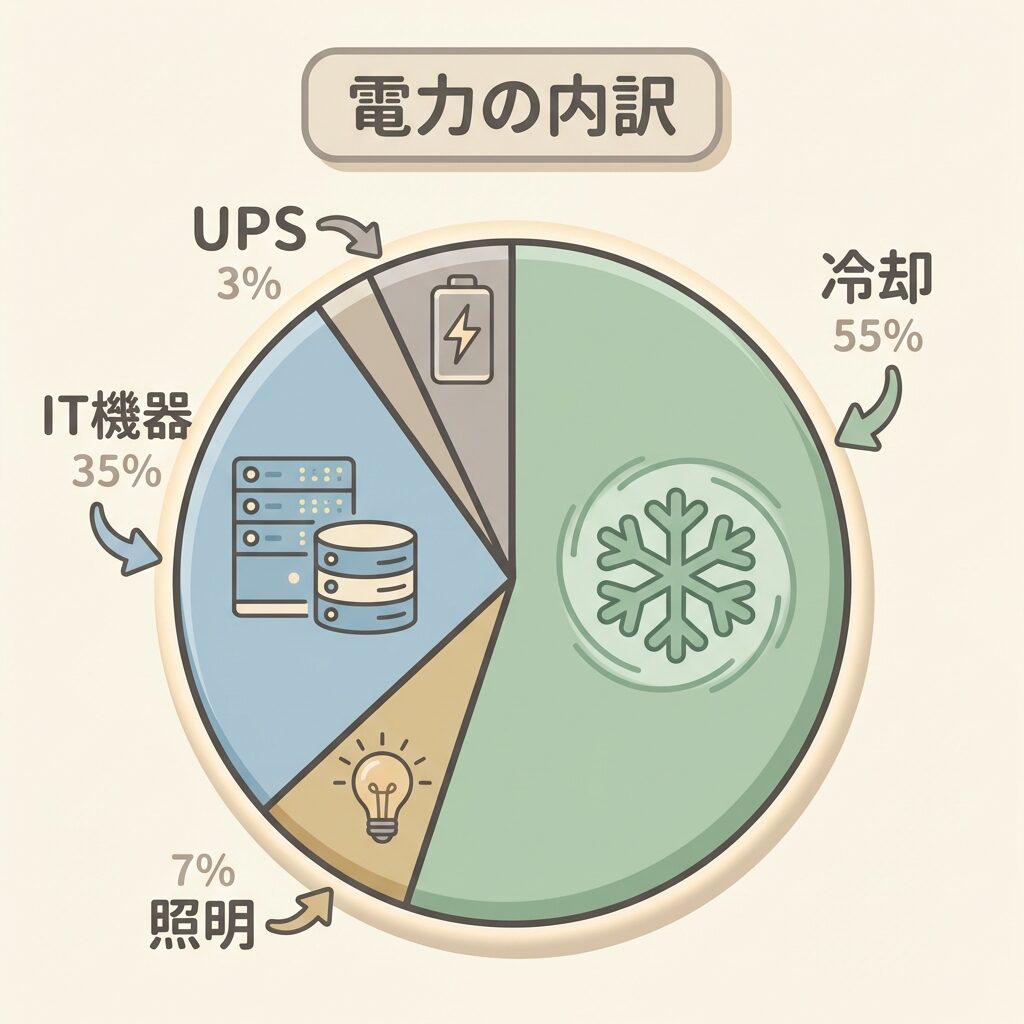

🌡️ オーバーヘッドの大部分は「冷却」

施設オーバーヘッドのなかで、最も大きな割合を占めるのが「冷却」です。一般的なデータセンターでは、オーバーヘッドの約40〜60%が冷却に消費されています。つまり、PUEを改善する最も効果的な方法は、冷却にかかる電力を減らすことなのです。

これがAI時代に重要になる理由は、前回の記事で解説した通り。GPUサーバーの消費電力と発熱が従来の10倍以上になったことで、冷却にかかるオーバーヘッドが爆増するリスクがあるのです。言い換えれば、AI時代のPUE改善とは、ほぼイコール「冷却効率の改善」と言えます。

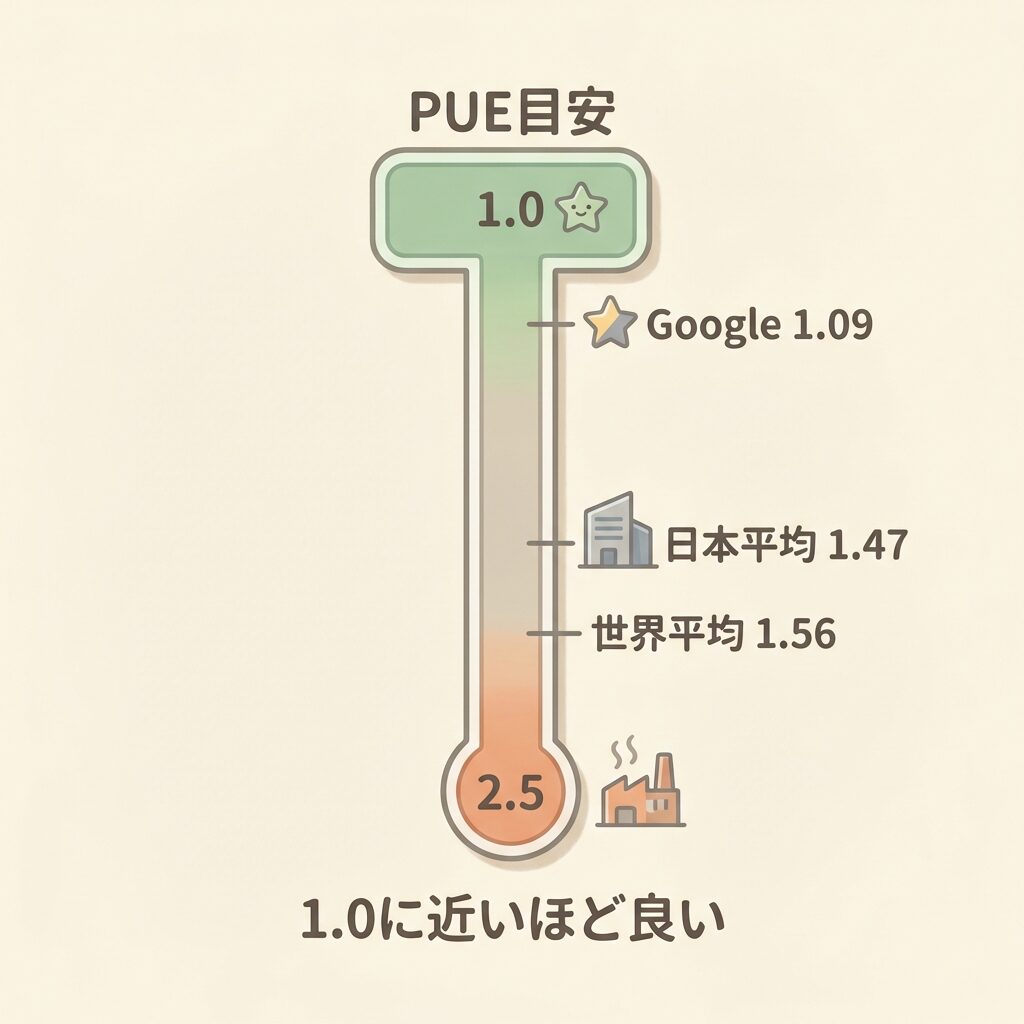

PUEの目安 ── 「良い」「普通」「悪い」はどのくらい?

📊 業界平均は1.56 ── 5年間ほぼ横ばい

Uptime Instituteが毎年実施する世界調査(2024年版)によると、データセンターの業界平均PUEは1.56です。注目すべきは、この数値が5年間ほぼ横ばいで推移しているという事実です(出典:Uptime Institute Global Data Center Survey 2024)。

一方、Googleは全世界のデータセンター全体でPUE 1.09を達成しています。これは業界平均と比較して、IT機器1単位あたりの間接電力消費が約84%少ないことを意味します(出典:Google Data Centers)。

| 分類 | PUE目安 | 意味 |

|---|---|---|

| 理想値 | 1.0 | すべての電力がIT機器に使われている状態(理論上の下限値) |

| 世界トップクラス | 1.04〜1.10 | Google Ohio拠点(1.04)、KDDI液浸冷却実証(1.05)など |

| Google全体平均 | 1.09 | 間接電力はわずか約9%。業界平均の84%少ない |

| AI対応DC(優良) | 1.1〜1.3 | 液冷技術を活用した先進的な施設 |

| 日本の新設DC平均(2014年度以降) | 1.47 | 経済産業省の調査結果 |

| 業界平均(世界) | 1.56 | Uptime Institute 2024年調査。5年間横ばい |

| 老朽化したDC | 1.8〜2.5 | IT機器と同量以上の電力が冷却・照明に消費されている状態 |

出典:Google Data Centers、Uptime Institute 2024、経済産業省 工場等判断基準WG(2025年6月)

💴 PUEが0.1変わると、いくら違うのか?

「1.56と1.09の差は0.47」──数字だけ見ると小さく感じるかもしれません。しかし、大規模データセンターではこのわずかな差が巨大なコスト差になります。

たとえば、IT機器の消費電力が100MWの大規模データセンターを考えてみましょう。PUEが1.56なら施設全体で156MWの電力が必要です。PUEが1.09なら109MWで済みます。その差は47MW。仮に電力単価を15円/kWhとすると、年間の差額は約62億円にもなります。

PUEの「0.1の差」は「年間で億単位の電力コストの差」に直結します。AI時代にGPUの消費電力が爆増している今、PUE改善は「環境のため」という建前ではなく、「事業の存続」に関わる経営課題なのです。

PUEを改善するには? ── 3つのアプローチ

PUEの計算式を思い出してください。PUEを下げる(=改善する)には、分子(全体の電力)を小さくするか、分母(IT機器の電力)の比率を高める必要があります。具体的には3つのアプローチがあります。

❄️ アプローチ①:冷却効率を上げる(最も効果が大きい)

PUE改善に最も大きなインパクトを持つのが冷却です。空冷から液冷への移行が代表例です。KDDIの実証実験では、液浸冷却によりPUE 1.05を達成し、空冷と比べて冷却電力を94%削減しています(出典:経済産業省 METI Journal)。

また、富士通・Supermicro・ニデックの3社は2025年にPUE改善のための協業を発表し、水冷技術を組み合わせたシステムでエネルギー効率40%向上を目指しています(出典:ニデック公式)。

⚡ アプローチ②:配電ロスを減らす

UPS(無停電電源装置)や変圧器では、電力を変換する際にロスが発生します。このロスを減らすことでもPUEは改善します。高効率UPSの採用や、直流給電(DC給電)方式への移行が注目されています。

🏗️ アプローチ③:立地と設計を工夫する

Googleがフィンランド(ハミナ)のデータセンターで海水冷却を活用しているように、冷涼な気候や自然の冷却源を活用できる立地を選ぶことで、冷却にかかる電力を大幅に削減できます。日本でも北海道に新設AIデータセンターが集まりつつあるのは、この理由が大きいのです。

【完全図解】GPUサーバーとは?AIサーバーとの違いを初心者向けにやさしく解説 →

GPUサーバー1台で電気ストーブ8台分の発熱。なぜ冷却効率がここまで重要なのかを構造から理解できます。

なぜ今、PUEが「再注目」されているのか?

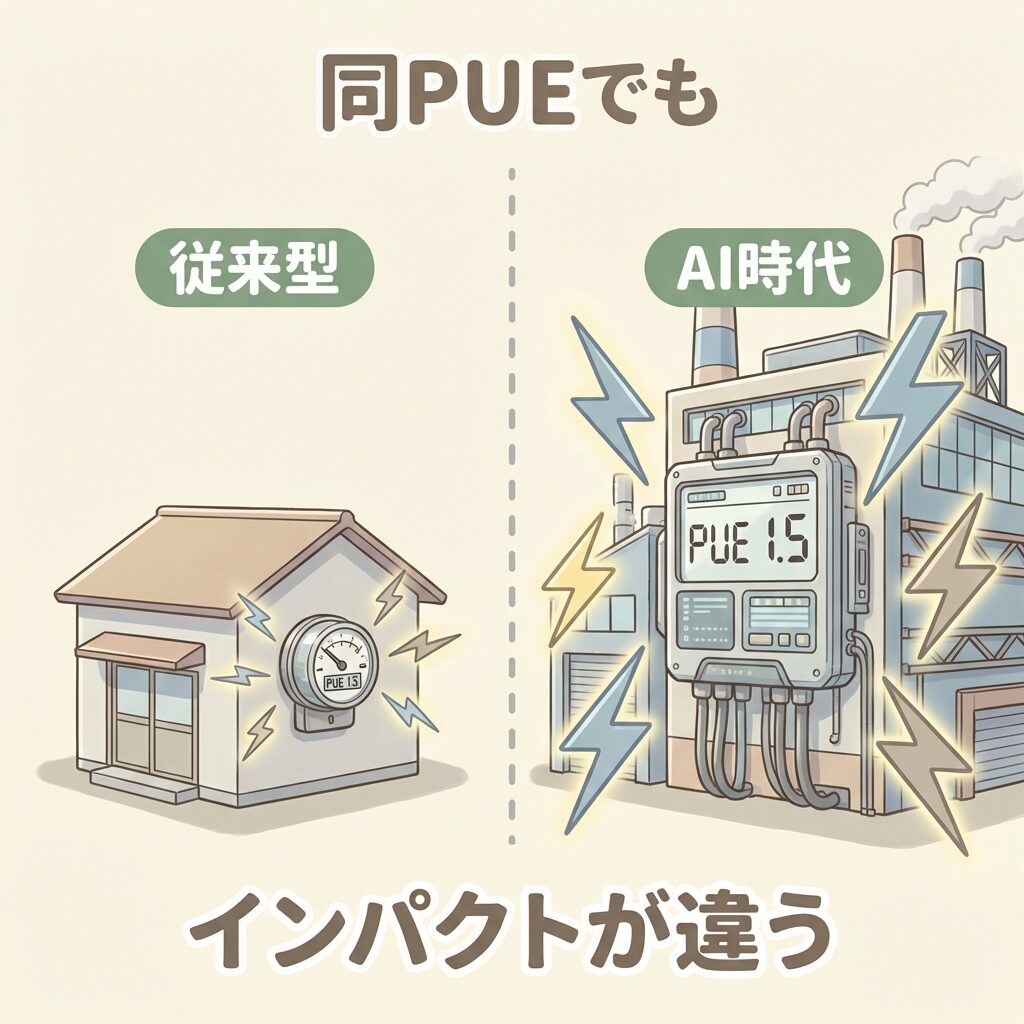

🔥 GPU時代の「電力密度の爆増」がPUEを経営課題にした

PUEは2007年に提唱された「古い指標」です。業界平均が5年間横ばいという事実を見ると、「もうPUEは改善しきったのでは?」と思うかもしれません。

しかし、AI時代に入ってPUEの重要性はむしろ急上昇しています。その理由は明快です。GPUサーバーの消費電力が従来の10倍以上に跳ね上がったことで、PUEの「0.1の差」が意味するコストの絶対額が桁違いに大きくなったのです。

たとえを使いましょう。PUEが「税率」だとすると、従来型データセンターは「月収10万円に対する税金」でした。GPUデータセンターは「月収1,000万円に対する税金」。同じ税率でも、払う額は100倍違います。だから今、PUEの改善がこれまで以上に切実な問題になっているのです。

従来型DC(PUE 1.5)

IT電力:10MW

施設全体:15MW

オーバーヘッド:5MW

「税金」は5MW。痛いけど許容範囲。

AI対応DC(PUE 1.5)

IT電力:100MW

施設全体:150MW

オーバーヘッド:50MW

「税金」が50MW。これは大型火力発電所の数十%分に相当。無視できない。

🇯🇵 日本の制度も動き出した ── 2030年までにPUE 1.4以下

日本でもPUEへの制度的な注目が高まっています。2022年、省エネ法(省エネ・非化石転換法)のベンチマーク制度にデータセンター業が追加されました。事業者は2030年度までに平均PUE 1.4以下を目指すことが求められています。さらに、2029年度以降に新設されるデータセンターは、稼働後2年以内にPUE 1.3以下を達成する必要があります(出典:東京都産業労働局資料(2025年6月))。

PUEは「古い指標」ではありません。AI時代にIT機器の電力が桁違いに増えたことで、PUEの小さな差が持つ意味(=コスト・環境負荷)が爆発的に大きくなっています。さらに日本では制度化も進み、PUEは「知っておくと良い指標」から「知らないと事業に支障がある指標」になりつつあります。

PUEだけでは語れない理由 ── 3つの限界と補完指標

ここまで読むと「PUEが低ければすべてOK」と思えるかもしれません。しかし、PUEには無視できない限界があります。PUEを正しく使うためにも、この限界を理解しておきましょう。

⚠️ 限界① ── IT機器自体の効率は見えない

PUEは「IT機器以外のオーバーヘッドがどれだけ少ないか」を測る指標であり、IT機器自体が電力を効率よく使っているかは見えません。極端な例ですが、古いサーバーが大量の電力を消費しながらほとんど何もしていなくても、冷却効率が良ければPUEは良い数字になってしまいます(出典:環境省 IT機器グリーン化評価指標)。

⚠️ 限界② ── 水の消費量は反映されない

冷却を水冷に切り替えるとPUEは改善しますが、その分大量の水を消費します。PUEだけを追い求めると、電力は節約できても水資源を浪費する可能性があります。この盲点を補うのがWUE(Water Usage Effectiveness:水使用効率)です。

⚠️ 限界③ ── CO2排出量も見えない

PUEは「電力の効率」を測りますが、その電力が石炭火力で作られたのか、再生可能エネルギーで作られたのかは区別しません。PUEが同じ1.2でも、CO2排出量はまったく異なり得ます。これを補うのがCUE(Carbon Usage Effectiveness:炭素使用効率)です。

| 指標 | 正式名称 | 何を測るか | PUEとの関係 |

|---|---|---|---|

| PUE | Power Usage Effectiveness | 電力の使い方の効率 | 基本指標 |

| WUE | Water Usage Effectiveness | 水の消費量の効率 | PUEが見えない「水」を補完 |

| CUE | Carbon Usage Effectiveness | CO2排出量の効率 | PUEが見えない「炭素」を補完 |

「PUEが低い = 環境にやさしいデータセンター」とは限りません。PUEが低くても、大量の水を使っていたり、化石燃料由来の電力を使っていれば、環境負荷は高くなり得ます。PUEは「電力効率の入口指標」であり、それだけで全体を判断すべきではないのです。PUE・WUE・CUEの3つを合わせて見ることが重要です(出典:Data Center Dynamics)。

PUE改善に関わる日本企業 ── 投資家が知るべき関連プレイヤー

PUE改善の本質は「冷却効率の向上」と「配電ロスの削減」です。この2つの領域で技術力を持つ日本企業を、役割ごとに整理しました。

💧 液冷・空調技術 ── PUE改善の最前線

ダイキン工業(東証プライム・6367)は、データセンター向け高効率空調の世界的メーカーです。AI対応データセンターの冷却需要増加で注目されています。

ニデック(東証プライム・6594)は、2025年に富士通・Supermicroと協業し、水冷技術によるPUE改善に取り組んでいます。液冷用CDU(冷却液分配ユニット)の開発で存在感を高めています。さらに2026年3月には、第一実業・カンネツと液冷インフラの迅速な実装に向けたアライアンスを発表しています(出典:PR TIMES)。

三桜工業(東証プライム・6584)は、自動車向けの配管技術をデータセンター冷却に転用し注目を集めています。カンネツはサーバー冷却装置の国内トップシェアメーカーです。新晃工業(東証プライム・6458)はセントラル空調機器で国内シェア約4割を持ち、データセンター向け空調にも注力しています。

⚡ 電力効率化 ── 配電ロスを減らす企業

富士通(東証プライム・6702)は、40年のスーパーコンピューター向け水冷技術の実績を持ち、水冷ハードウェアと監視制御ソフトウェアの両方を提供できる数少ない企業です。

富士電機(東証プライム・6504)はUPS(無停電電源装置)の大手メーカーとして、データセンターの配電ロス低減に貢献しています。日東工業(東証プライム・6651)もデータセンター向け配電盤・電力設備を手がけています。

🏗️ DC建設・運用 ── PUE目標を実現する事業者

NTTグループ(NTTデータ、NTTコミュニケーションズ、NTTファシリティーズ)は、データセンターの設計・建設・運用を一貫して手がける国内最大手です。ソフトバンクは北海道苫小牧に大規模AIデータセンターを建設し、再生可能エネルギー100%の活用を目指しています。

PUE改善は「冷却」「配電」「建設」の3つの産業領域にまたがるテーマです。日本の省エネ法では2030年までに事業者平均PUE 1.4以下、新設DCはPUE 1.3以下が求められます。この制度的な追い風は、上記の冷却・電力設備企業にとって長期的かつ構造的な需要を生み出します。「AIの進化→GPU電力増大→PUE改善圧力→冷却・配電設備の需要拡大」という因果の連鎖を、投資判断のフレームワークとしてお使いください。

なお、個別銘柄の投資推奨ではありません。投資判断はご自身の責任でお願いします。

よくある誤解を整理する

❌ 誤解と ✅ 実際

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「PUEが低い = 環境にやさしい」 | PUEは電力効率のみを測る指標。水の消費量やCO2排出量は反映されない。WUE・CUEと合わせて見る必要がある。 |

| 「PUE 1.0は実現可能」 | PUE 1.0は「冷却・照明・UPS等に電力ゼロ」を意味し、物理的に不可能。1.0は理論上の下限値。 |

| 「業界平均が1.56で改善が止まっている」 | 平均値は古い施設に引きずられている。新設のハイパースケールDCは1.1〜1.3を達成しており、施設間の格差が拡大している。 |

| 「PUEはもう古い指標」 | GPU時代にIT電力が桁違いに増えたことで、PUEの0.1の差が持つ金額的インパクトが激増。日本では省エネ法の指標にも採用されている。 |

| 「PUEの数字はどこも同じ方法で計算している」 | 測定方法や範囲にばらつきがある。季節変動、測定頻度、IT負荷率によって値が変わるため、単純比較には注意が必要。 |

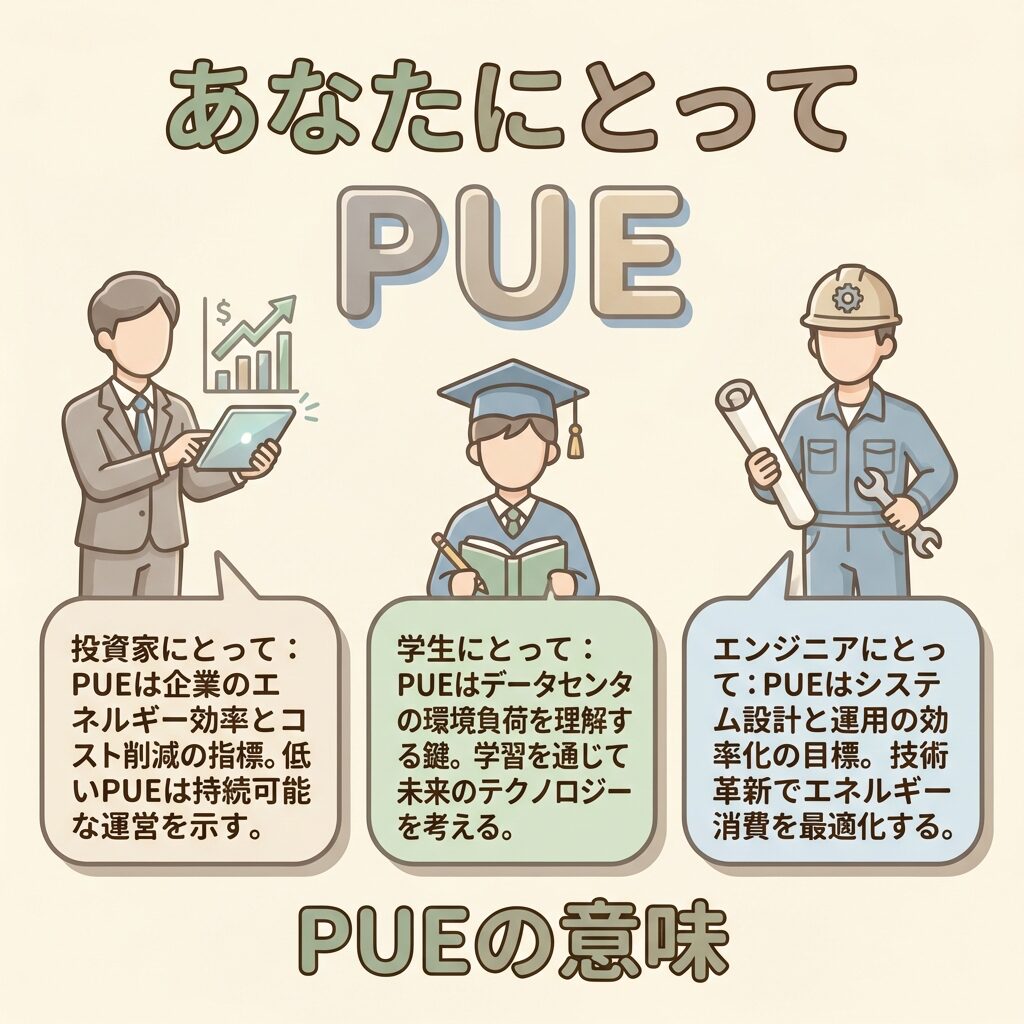

あなたにとっての意味 ── 投資家・学生・技術者の視点

📈 投資家の方へ:

PUEは「冷却・電力設備企業の需要を理解するための構造的な指標」です。PUE改善圧力が強まるほど、液冷設備(ニデック、三桜工業、カンネツ)、空調(ダイキン、新晃工業)、配電(富士電機、日東工業)への需要が増大します。GPU世代の進化に伴う因果の連鎖として捉えてください。

🎓 学生の方へ:

PUEの理解は「データセンターのエネルギー工学」の入口です。冷却工学、熱力学、流体力学、電力変換──PUEを改善するために必要な知識は、機械・電気系の学問そのものです。「AI=情報系」という先入観を壊す指標でもあります。

🔧 技術者の方へ:

PUEを改善できるのは、冷却設備、空調、配管、受変電を実務で扱える技術者だけです。PUE 1.4以下の制度目標は、あなたの専門性に対する「国家レベルの需要」を意味しています。

まとめ:PUEの全体像

① PUEとは:データセンター全体の消費電力 ÷ IT機器の消費電力。1.0に近いほど効率的。

② 目安:業界平均1.56(Uptime Institute 2024)、Google 1.09、日本の新設DC平均1.47。

③ 改善のカギは冷却:オーバーヘッドの大部分を冷却が占める。空冷→液冷の移行が最も大きなインパクト。

④ AI時代に再注目:GPU電力が10倍以上に増えたことで、PUEの0.1の差が持つ金額インパクトが桁違いに。

⑤ PUEだけでは不十分:水の消費(WUE)、CO2排出(CUE)は見えない。3指標を合わせて判断する必要がある。

⑥ 日本の制度:省エネ法で2030年度までに事業者平均PUE 1.4以下、2029年度以降の新設DCはPUE 1.3以下が目標。

⑦ 関連企業:冷却(ダイキン、ニデック、三桜工業、カンネツ、新晃工業)、配電(富士電機、日東工業)、DC運用(NTT、ソフトバンク)が恩恵を受ける構造。

結局こういうことです。PUEとは「データセンターが電力をどれだけムダなく使えているか」を測る指標です。AI時代にGPUの消費電力が爆増したことで、PUEの「小さな差」が意味するコストと環境負荷が桁違いに大きくなりました。PUEは電力効率の「入口」であり、ここを押さえることでAIインフラの構造全体が見えてくるのです。

❓ よくある質問(FAQ)

📖 【完全図解】AIデータセンターとは?従来型との違いと構造を解説 →

この記事は上記ロードマップの一部です。AIデータセンターの全体像から学びたい方はこちらからどうぞ。

📚 次に読むべき記事

GPU→発熱→液冷→電力→PUEという因果の連鎖の全体像を理解するピラー記事です。

PUE改善が重要になる原因であるGPUサーバーの構成と消費電力を理解できます。

1ラック120kWの電力密度がデータセンター設計を根本から変える理由を解説。

PUE改善の最大の鍵である冷却技術の違いを深掘りする記事です。

🗺️ 学習ロードマップ上の位置づけ

PUEとは?(この記事)

空冷 vs 液冷(冷却技術の比較)── 公開準備中

AIデータセンターの電力問題 ── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント