- 「高密度データセンター」ってニュースで見るけど、何が「高密度」なの?

- 普通のデータセンターにGPUサーバーを入れればAI対応できるのでは?

- 「電力密度」「床耐荷重」と言われてもピンとこない

- 新設と改修、どっちが現実的なの?

- AI対応のデータセンターを選ぶとき、何を基準にすればいいのかわからない

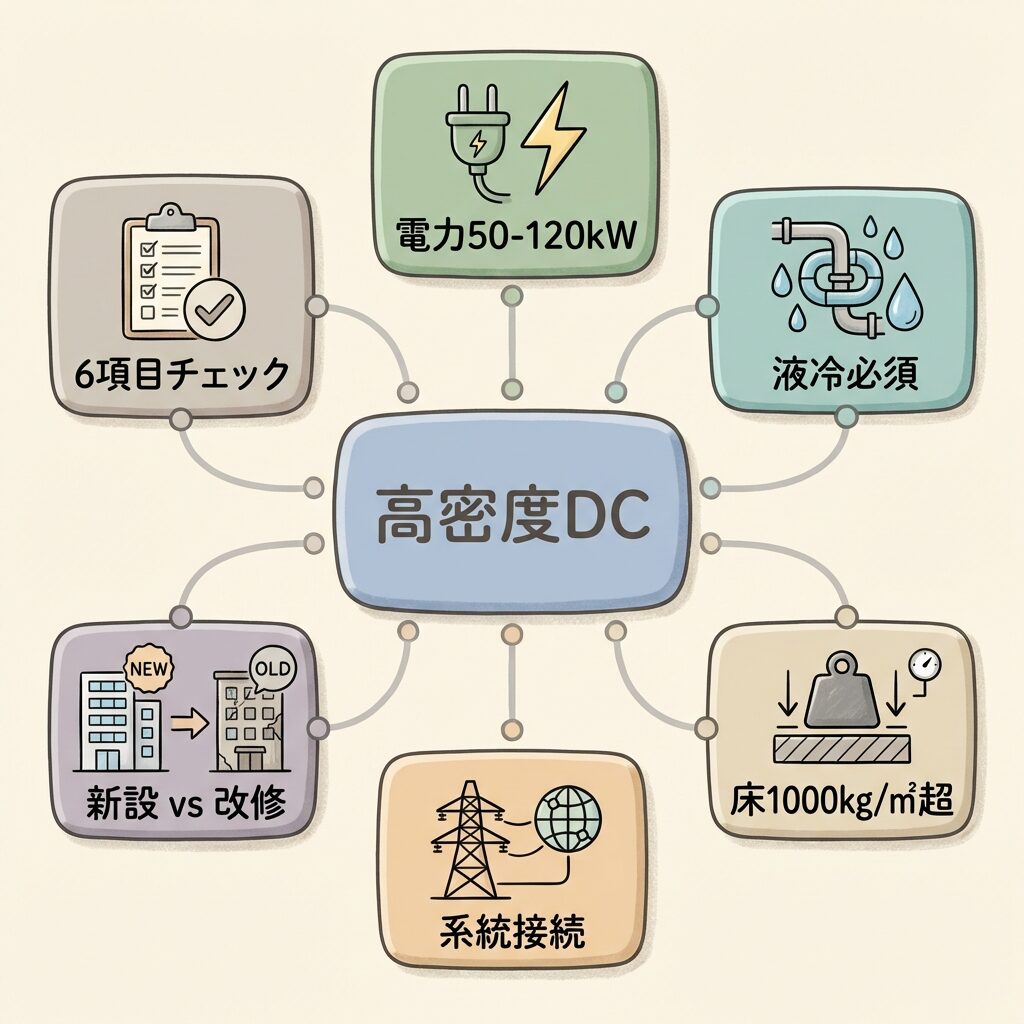

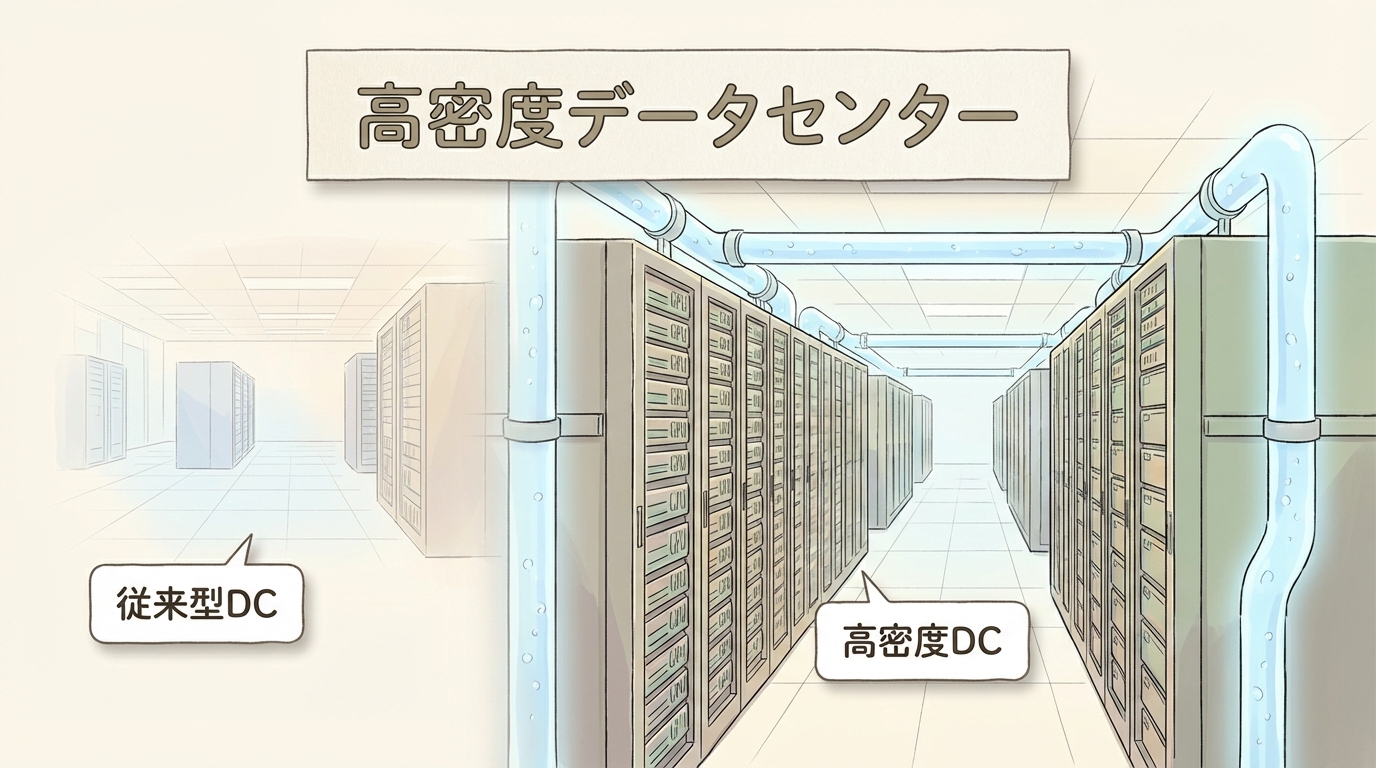

- 「高密度」とは何を意味するのか──定義と数字の目安

- 低密度DCと高密度DCの4要素比較(電力・冷却・ネットワーク・物理構造)

- 既存DCがAI対応できない「4つの壁」

- 新設 vs 改修のメリット・デメリット比較

- AI対応DCを選ぶための6項目チェックリスト

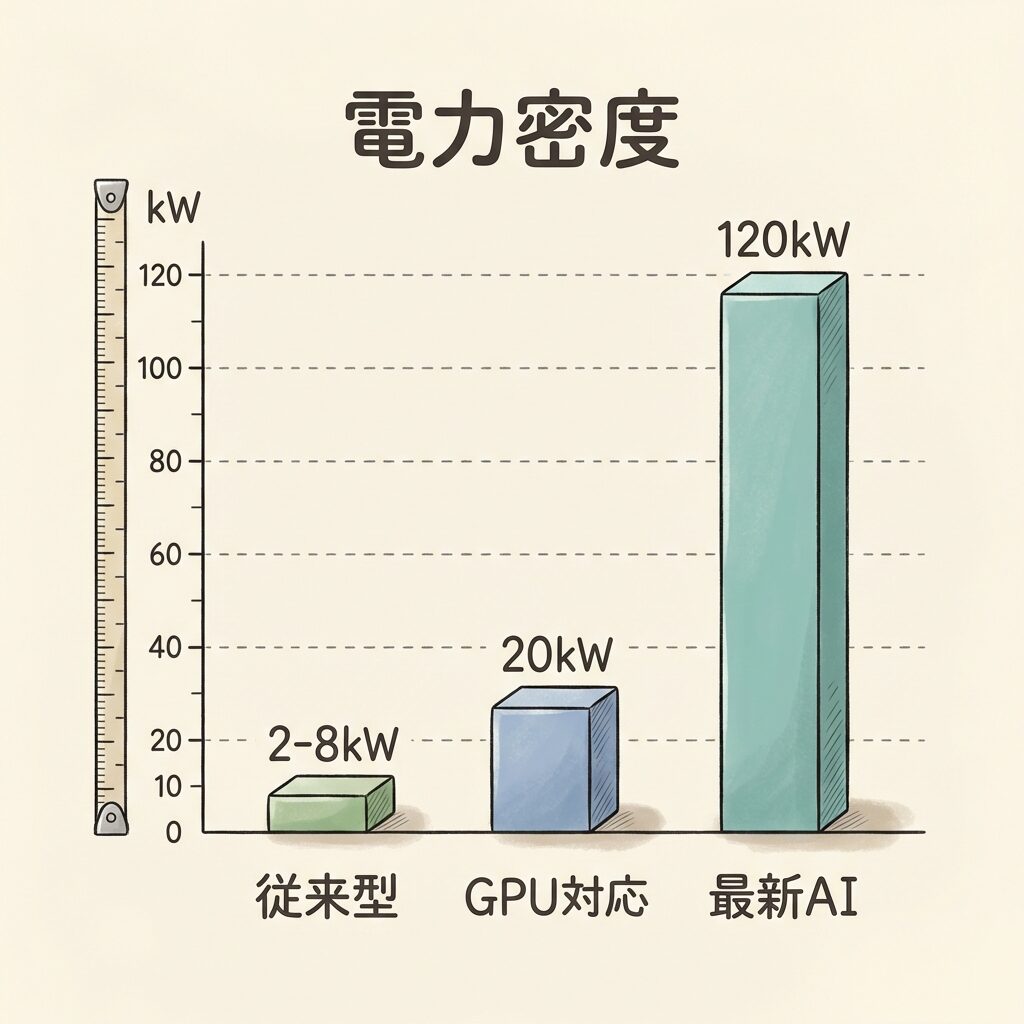

高密度データセンターとは、1ラックあたりの電力密度が20kW以上の、GPUサーバーなど高消費電力機器の運用に対応したデータセンターのことです。従来型DCのラック電力密度は2〜8kW程度。AIデータセンターではこれが50〜120kW、次世代では600kW超に達します。この「桁違い」に対応するには、電力設備・冷却方式・床耐荷重・ネットワークの4要素すべてを刷新する必要があり、既存のDCに「GPUを入れるだけ」では対応できません。だから高密度データセンターの新設ラッシュが世界中で起きているのです。この記事では、「高密度」の意味を数字で理解し、既存DCの限界と、AI対応DCの選び方までを一気に整理します。

これまでのロードマップ記事で、GPUサーバー、GPUラック、PUE、電力問題、冷却技術を個別に学んできました。この記事は、それらの知識を「データセンター選び」という実践的な視点でつなぐ回です。「結局、AIをやるにはどんなDCが必要なの?」という疑問に、ここで決着をつけましょう。

「高密度データセンター」とは? ── 定義と数字を押さえる

🏭 一言でいうと「ラック1本あたりの電力密度が高いDC」

高密度データセンターとは、1ラックあたりの電力密度(kW)が従来型よりも大幅に高い、高消費電力機器の運用に対応したデータセンターのことです。

「密度」と聞くと「サーバーをぎゅうぎゅうに詰め込む」イメージを持つかもしれませんが、本質は違います。高密度の「密度」が指しているのは電力密度──つまり「同じ床面積(ラック1本分のスペース)に、どれだけの電力を投入できるか」です。

電力密度は「マンション1戸あたりの契約電力(アンペア数)」に似ています。一般家庭は30〜60Aで十分ですが、業務用の厨房やサーバールームなら200A以上必要ですよね。同じ「1戸」でも、中で何をするかによって必要な電力がまったく違う。データセンターも同じで、中に入る機器がGPUサーバーに変わった瞬間、必要な電力が桁違いに増えるのです。

📊 電力密度で見る「低密度」「中密度」「高密度」の分類

NTTPCコミュニケーションズの解説によれば、一般的なデータセンターの電力容量は1ラックあたり2kVA〜8kVA程度です(出典:NTTPCコミュニケーションズ)。GPUサーバーの格納には20kVA以上が必要とされています。

| 分類 | ラック電力密度 | 主な用途 | 代表的な機器 |

|---|---|---|---|

| 低密度 | 2〜8kW | Web/メール/DB/クラウド | CPUサーバー(220W/台) |

| 中密度 | 8〜20kW | HPC/一部GPU処理 | CPUサーバー高密度 / 旧世代GPU |

| 高密度 | 20〜120kW | AI学習・推論 | GPUサーバー(10kW/台) |

| 超高密度 | 120kW〜600kW+ | 大規模AI/次世代GPU | GB200 NVL72 / Vera Rubin |

サーバーラック1本に供給できる最大電力(kW)のこと。この値が大きいほど「高密度」。データセンターの世代・対応能力を一目で判断できる最重要指標です。

「高密度データセンター」とは、ラック電力密度20kW以上を支えられるDCのこと。AI時代のGPUサーバーを収容するには、最低でもこのラインが必要です。そしてNVIDIAの最新GPUラック(GB200 NVL72)は120kW。「高密度」の中でもさらに桁が上がり続けているのが現状です。

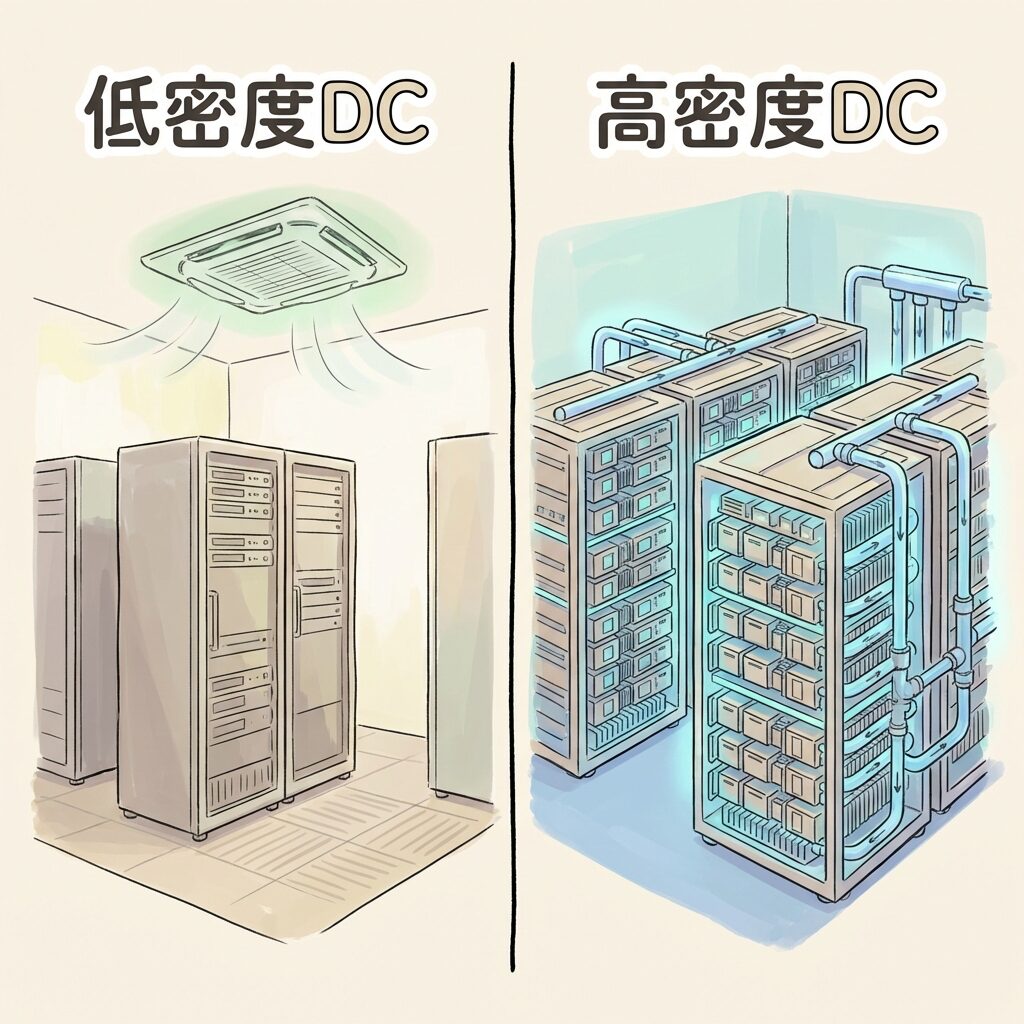

低密度DCと高密度DC ── 4要素の決定的な差

「高密度」は単に「電力が多い」だけの話ではありません。電力密度が上がると、それに連動して冷却・ネットワーク・物理構造のすべてが変わります。4つの要素を並べて比較することで、「なぜ普通のDCでは足りないのか」が腹落ちするはずです。

📊 要件一覧マトリクス ── 低密度DC vs 高密度DC

| 比較要素 | 🏢 低密度DC(従来型) | 🏭 高密度DC(AI対応) |

|---|---|---|

| ⚡ 電力 | ラック2〜8kW 一般的な受変電設備で対応 施設全体で数MW〜数十MW |

ラック50〜120kW 特別高圧受電・専用変電所レベル 施設全体で数百MW〜GW級 |

| ❄️ 冷却 | 空冷(エアコン方式)で十分 ラック20kWが空冷の限界 PUE 1.4〜1.8 |

液冷(DLC)が必須 空冷との7:3ハイブリッド PUE 1.03〜1.2 |

| 🌐 ネットワーク | 数Gbps〜数十Gbps Ethernet(TCP/IP) サーバー間通信は軽量 |

数百Gbps〜Tbps級 InfiniBand / NVLink GPU間の大量データ交換が常時発生 |

| 🏗️ 物理構造 | 床耐荷重 500〜700kg/㎡ ラック重量 200〜500kg ケーブル 数十本/ラック |

床耐荷重 1,000〜2,000kg/㎡ ラック重量 約1.3トン(軽自動車級) ケーブル 200本以上/ラック |

出典:電力容量は NTTPCコミュニケーションズ、冷却限界は IIJ、床耐荷重は Burrtec、ケーブル本数は Introl

「低密度DCにGPUサーバーを入れれば高密度になる」と思われがちですが、それは「一般家庭に業務用エアコン10台を設置する」ようなものです。ブレーカーが落ちるか、配線が耐えられません。電力容量・冷却能力・床耐荷重という「建物の根幹」が対応していないと、高密度化は物理的に不可能なのです。

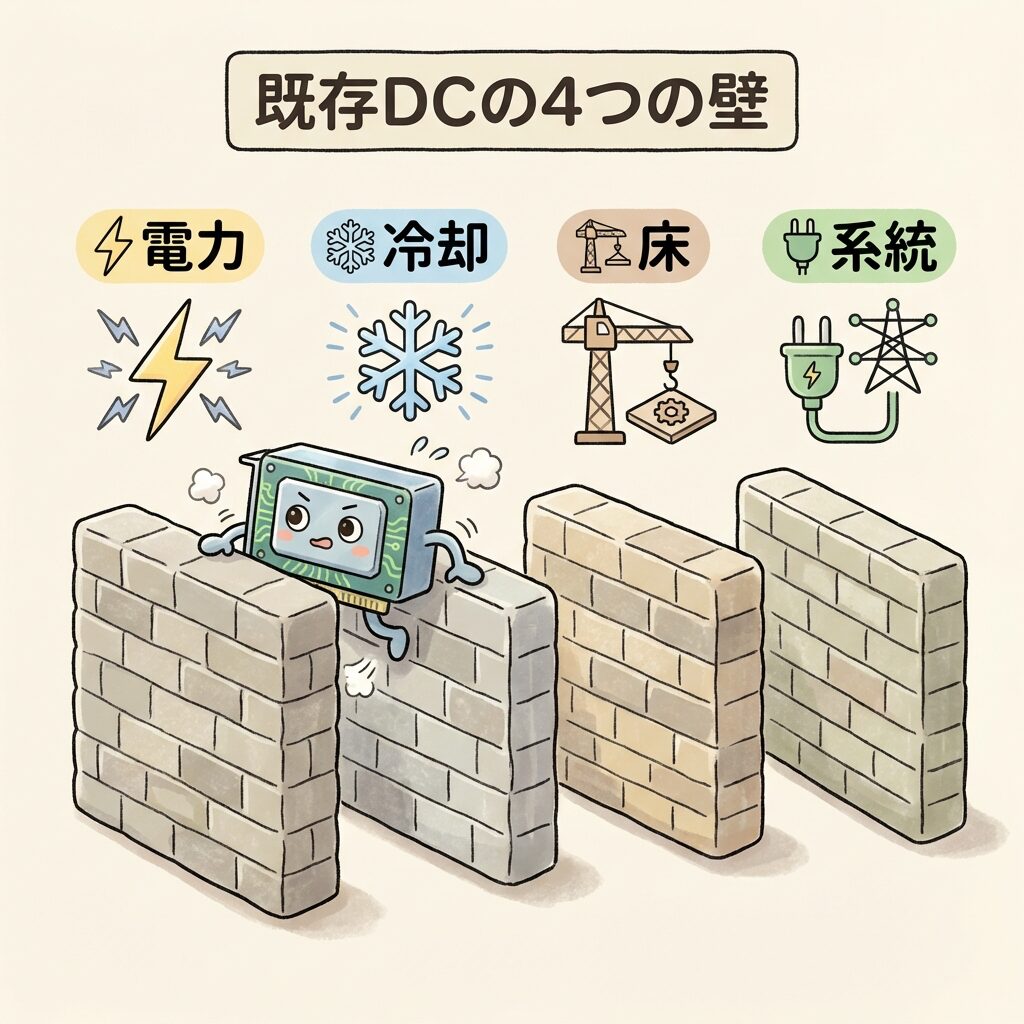

既存データセンターの「4つの壁」── なぜ改修だけでは足りないのか

「わざわざ新しいDCを建てなくても、既存のDCを改修すればいいのでは?」──これは最も多い疑問です。しかし現実には、既存DCがAI対応するには4つの物理的な壁が立ちはだかります。

🧱 壁①:電力設備の限界

従来型DCは1ラック2〜8kVAを前提に受変電設備が設計されています。ラック100本のフロアなら、設備全体で200〜800kVA程度の容量です。ここにGPUラックを100本入れようとすると必要電力は12,000kW(12MW)。従来の15〜60倍です。ブレーカーの容量、電力ケーブルの太さ、変圧器の容量──すべてが足りません。「コンセントを増やす」レベルではなく、建物に引き込む電力インフラそのものを作り替える必要があります。

🧱 壁②:冷却システムの限界

日本の既存DCの9割以上が空冷方式です。空冷で対処できるのはラックあたり約20kWが上限(出典:IIJ)。GPUラックの50〜120kWには物理的に追いつけません。液冷に移行するには、冷却液を循環させる配管設備、サーバールームの防水処理、CDU(冷却液分配ユニット)の設置など、建物構造を根本から変える改修が必要です。

🧱 壁③:床耐荷重の限界

従来型DCの床耐荷重は500〜700kg/㎡程度です。しかしGPUラック(GB200 NVL72)は1本で約1.3トン。液冷設備の重量も加わるため、AI対応DCには1,000〜2,000kg/㎡の床耐荷重が求められます(出典:Burrtec)。既存の建物では床が文字通り「耐えられない」のです。

🧱 壁④:系統接続(送電網への接続)の限界

数百MW〜GW級の電力を必要とするAIデータセンターは、既存の送電網では電力を十分に引き込めないケースが増えています。日本では特に千葉県印西市などで新規の電力接続に最長10年以上かかるケースも報告されています(出典:経済産業省)。

既存DCにGPUラックを入れようとするのは、「築30年の木造住宅に、業務用オーブン10台と大型冷凍庫を設置する」ようなものです。電気の契約変更(電力)、排気ダクトの大改修(冷却)、床の補強工事(床耐荷重)、電線の引き直し(系統接続)が必要。それなら新しいビルを建てたほうが早い──というのが、AIデータセンター新設ラッシュの構造です。

新設 vs 改修 ── どちらが現実的か?

4つの壁を見ると「改修は無理」と思えますが、実はすべてのケースで新設が正解とは限りません。改修にも、部分的なAI対応という現実的な選択肢があります。両者の特徴を整理しましょう。

✅ メリット

・初期投資が新設より低い

・既存の立地・ネットワーク環境を活用できる

・段階的なAI対応が可能(一部区画のみ高密度化)

・事業継続性を維持しながら移行できる

⚠️ デメリット

・電力・冷却・床耐荷重に上限がある

・液冷配管や防水処理の工事中はサーバー停止が発生

・将来のさらなる高密度化への対応が難しい

・結果的に「改修+新設」の二重投資になるリスク

✅ メリット

・最新のGPUラック(120kW〜600kW)に最初から対応

・液冷+空冷のハイブリッド設計を最適化できる

・床耐荷重・配管・電力設備を一体設計できる

・将来世代への拡張余地を確保しやすい

⚠️ デメリット

・建設コストが数百億〜数千億円規模

・建設に2〜3年以上、系統接続にさらに数年

・用地の確保が困難(特に東京圏)

・人手不足・資材高騰で建設コストが上昇中

🔀 現実解は「ハイブリッドアプローチ」

実際の業界では、新設と改修の二者択一ではなく、両方を組み合わせるアプローチが広がっています。

ASCII.jpの解説では、「古いデータセンターでも、一部にGPUサーバー向けの専用区画を設けて、ラックあたり20kVA程度の電力供給を可能にしているケースも出てきている」と報じています(出典:ASCII.jp)。

つまり、既存DCの一部区画を20kVA対応に改修して「当座のGPU処理をまかなう」一方で、本格的なAI学習には50kW以上の高密度新設DCを並行して建設する──この二段構えが、リードタイムとコストのバランスを取る現実解になっているのです。

IIJの白井DC3期棟のように、新設時に「水冷Ready設計」(液冷設備を後から追加できる設計)にしておくことも、将来の拡張に有効な戦略です(出典:IIJ)。

「新設か改修か」ではなく、「今の需要は改修で対応し、将来の需要は新設で確保する」という二段構えが現実解。そして新設する場合は、将来のGPU世代交代(120kW→600kW)を見据えた「拡張余地のある設計」を最初から入れておくことが重要です。

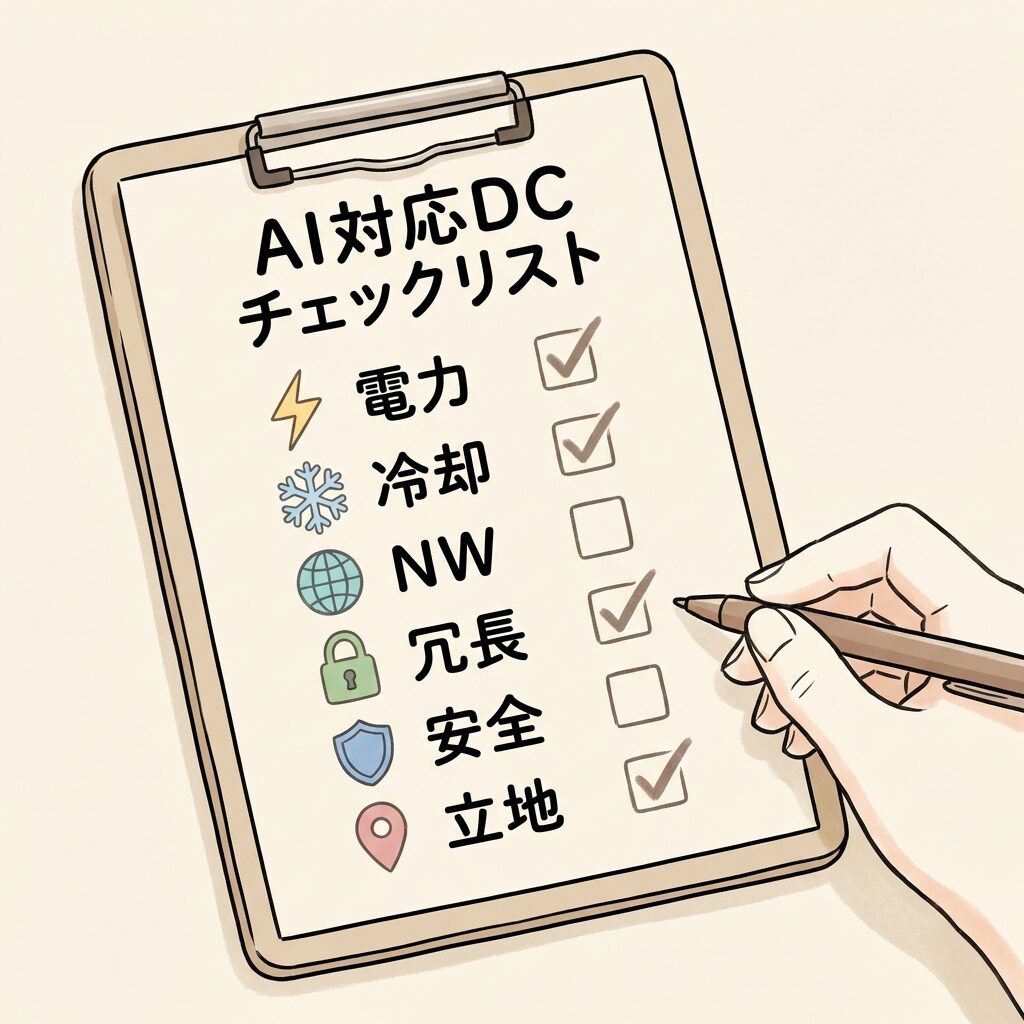

AI対応DCの選び方 ── 6項目チェックリスト

「結局、AI対応のデータセンターを選ぶときに何を見ればいいの?」──この疑問に答えるために、NTTPCコミュニケーションズが提示している6つの選定ポイント(出典:NTTPCコミュニケーションズ)を基に、チェックリストを作りました。

✅ AI対応データセンター チェックリスト

あなたにとっての意味 ── 投資家・学生・技術者の視点

投資家:高密度DC建設ラッシュは、GPU銘柄だけでなく電力設備(富士電機)、冷却(ニデック、三桜工業、カンネツ、ダイキン)、ラック(日東工業)、送電ケーブル(フジクラ、古河電工)、DC建設(大成建設、NTTファシリティーズ)に広い産業機会を生んでいます。「高密度化」は1つの銘柄ではなくサプライチェーン全体の投資テーマです。

学生:高密度DCの「4つの壁」を見てください。電力、冷却、構造、系統接続──すべて電気・機械・建築・土木の知識が必要です。AI時代の最前線は、情報系ではなく「物理インフラを設計できる人材」が最も不足しています。

技術者:受変電設備の設計、液冷配管の施工、床耐荷重の構造計算、CDUの運用保守──高密度DCの「4つの壁」を突破できるのは現場を知る技術者だけです。あなたの専門知識への需要は、GPUの世代交代のたびに構造的に拡大しています。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「高密度=サーバーを詰め込むこと」 | 高密度の本質は「電力密度」。同じラック本数でも、中の機器がGPUに変わるだけでラック電力が10〜60倍に跳ね上がる。 |

| 「既存DCにGPUを入れればAI対応できる」 | 電力・冷却・床耐荷重・系統接続の4つすべてが足りないのが現実。改修より新築のほうが合理的なケースが多い。 |

| 「高密度DCは新設しかない」 | 一部区画を20kVA対応に改修する「段階的アプローチ」も現実解。ただし50kW超の本格AI対応には新設が基本。 |

| 「クラウドを使えばDCは不要」 | クラウドもDC上で動いている。大規模AI学習では長期的なコストでオンプレミス(自社GPUサーバー+DC)が有利になるケースが多い。 |

| 「高密度DCは海外の話で日本は関係ない」 | 日本でもソフトバンク(苫小牧)、NTT(京阪奈)など大規模AIデータセンターの建設が加速。系統接続問題は日本固有の深刻な課題。 |

まとめ:高密度データセンターの全体像

① 高密度DCとは:ラック電力密度20kW以上の、GPUサーバーなど高消費電力機器に対応したDC。従来の2〜8kWとは桁が違う。

② 4要素が連鎖して変わる:電力密度が上がると → 発熱が激増 → 冷却方式が変わる → 建物ごと変わる。1つだけの対応では不十分。

③ 既存DCの4つの壁:電力設備(15〜60倍不足)、冷却(空冷20kWが限界)、床耐荷重(500kg/㎡では不足)、系統接続(接続に10年以上のケースも)。

④ 新設 vs 改修:改修は「当座の部分対応」に有効。本格AI対応(50kW超)は新設が基本。両方を組み合わせる「二段構え」が現実解。

⑤ DC選びの6項目:電力容量、冷却性能、ネットワーク速度、冗長性、安全性、立地。この6つを総合的にチェック。

⑥ 将来への備え:GPU世代交代(120kW→600kW)が確実に来る。新設時は「液冷Ready設計」「拡張余地」を最初から入れておくことが重要。

結局こういうことです。「高密度データセンター」とは、単に電力が多いDCではありません。電力・冷却・床耐荷重・系統接続の4要素すべてを、GPUサーバーの桁違いの要求に合わせて刷新した施設です。AI時代に「普通のDC」では足りない理由は、GPU1枚の消費電力が1,000Wに達し、ラック1本が120kWを超えるという物理的な事実にあります。この「高密度化」の波を理解することが、AIインフラの構造を理解する鍵なのです。

❓ よくある質問(FAQ)

📚 次に読むべき記事

高密度化の「原因」であるGPUラック1本120kWの衝撃を詳しく解説。

高密度DCに液冷が必須な理由を、空冷20kWの壁から解説。

高密度化がもたらす電力問題の全体像。IEA予測と日本の系統接続制約。

高密度DCの「中に何が入っているか」を5層構造で俯瞰する統合記事。

🗺️ 学習ロードマップ上の位置づけ

高密度データセンターとは?(この記事)

HBM(高帯域幅メモリ)とは?── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント