「AIデータセンターの電力消費が爆増している」──こんなニュース、最近よく目にしますよね。でも、こんなふうに感じていませんか?

- 「AIが電気を食う」のはわかるけど、なぜ食うのか仕組みがわからない

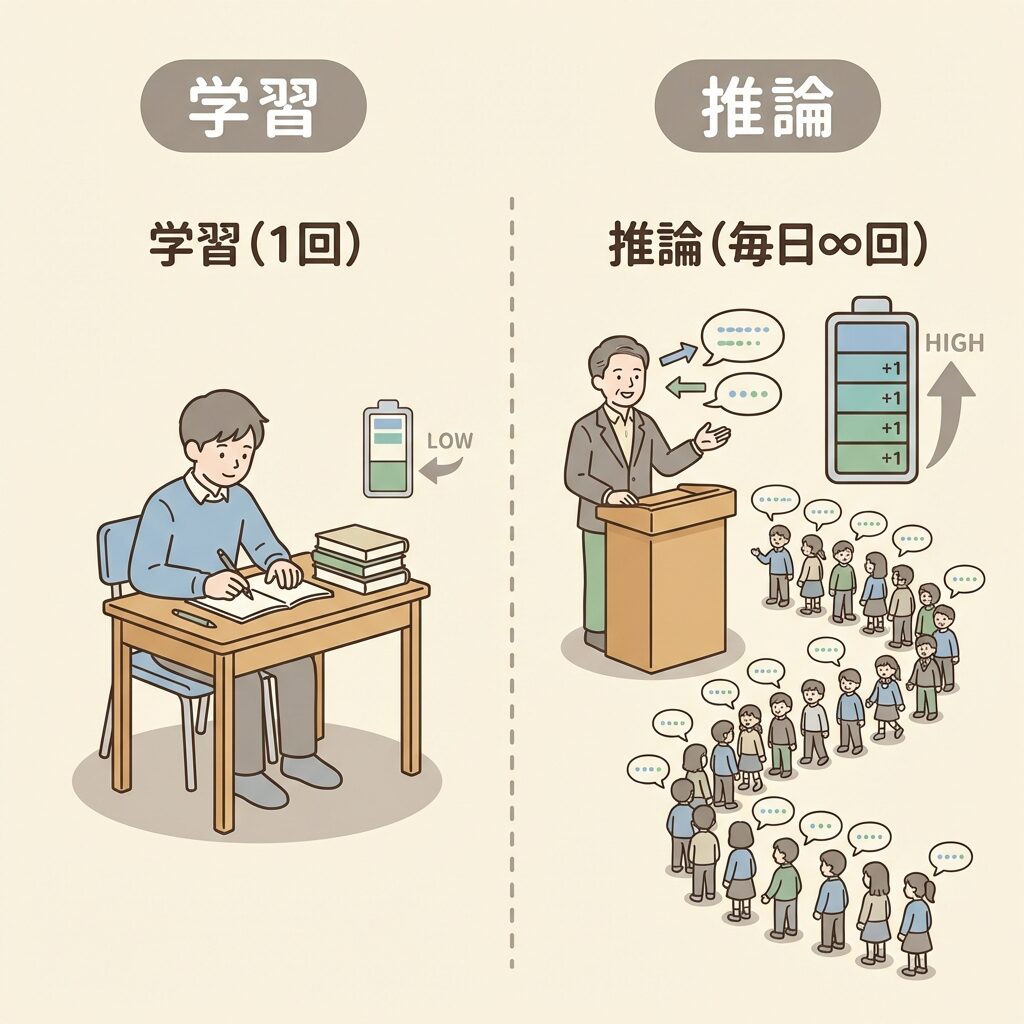

- トレーニングと推論、どっちが電力を使うの?

- サーバーの電力だけじゃなく、冷却や電源でも電力を使うってどういうこと?

- 「2030年に倍増」と聞くけど、日本にはどう影響するの?

- AIが電力を食う3つの構造的理由

- トレーニングと推論の電力消費の違いと比率

- サーバー電力+冷却+電源設備の内訳と全体像

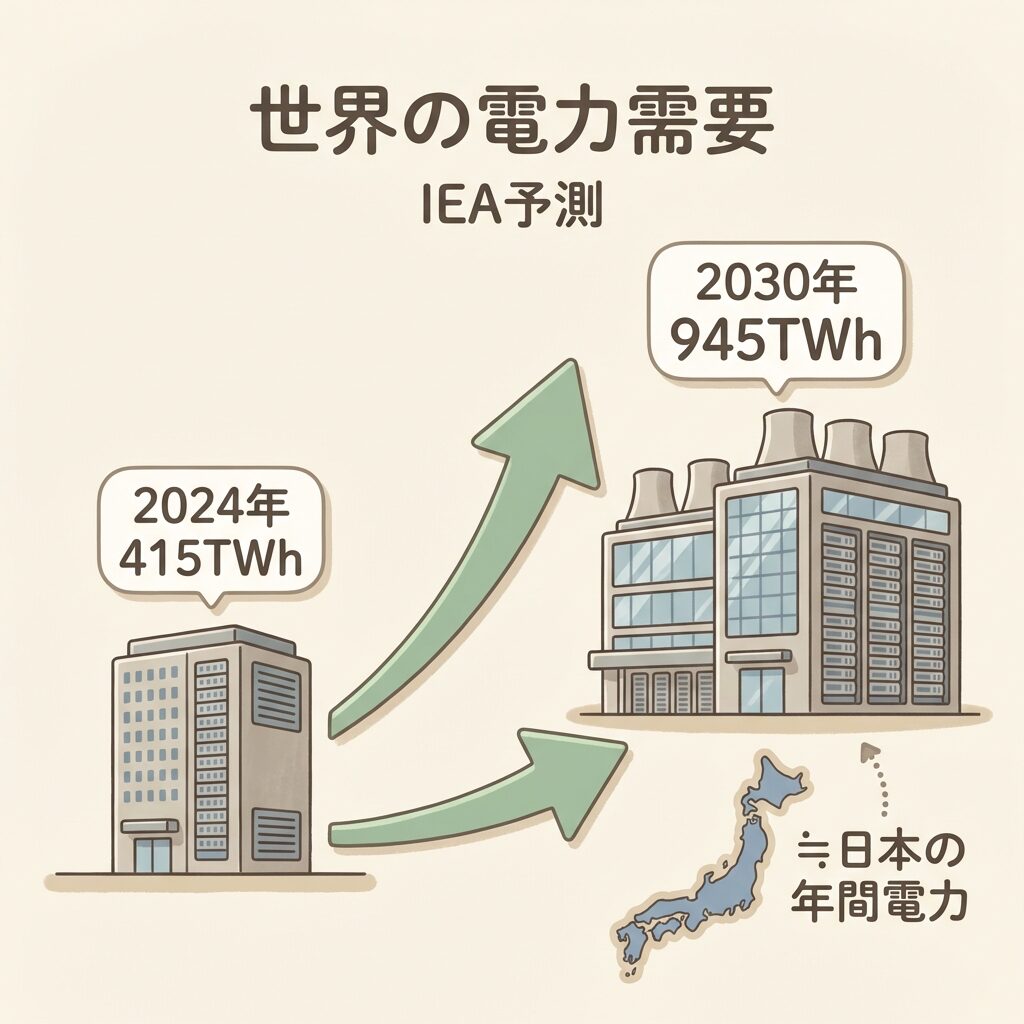

- IEA予測に基づく世界と日本の電力需要見通し

- この変化が投資家・学生・技術者に何を意味するか

AIデータセンターが大量の電力を消費する理由は、①GPUの消費電力が従来CPUの10倍以上であること、②AIの「推論」が24時間365日世界中で稼働し続けること、③サーバーだけでなく冷却・電源設備にも電力が必要なことの3つです。IEAの予測によると、世界のデータセンター電力消費は2024年の約415TWhから2030年には約945TWhへ倍増します。これは現在の日本全体の年間電力消費量をわずかに上回る規模です。「AIの電力問題」はソフトウェアの話ではなく、発電所・送電網・冷却設備という物理インフラの問題であり、社会全体に影響を及ぼすテーマなのです。

この記事では、「AIデータセンターの電力問題」を断片的なニュースではなく、なぜ電力を食うのか → どこで電力を使っているのか → 世界と日本でどれだけ増えるのかという構造で、初心者でもわかるように整理します。

AIはなぜ電力を食うのか? ── 3つの構造的理由

「AIが電気を食う」と一口に言いますが、その理由は曖昧に語られがちです。ここでは構造的に3つの理由を整理します。

🧠 理由① ── GPUという「電力の怪物」

AIの計算処理を担うGPU(画像処理装置)は、従来のCPUとはまったく異なるレベルの電力を消費します。NVIDIAの最新GPU「B200」の消費電力は1枚あたり約1,000W──電気ストーブ1台分です。これがGPUサーバー1台に8枚搭載されると、サーバー1台だけで約10kW(一般家庭3世帯分)を消費します。

なぜGPUはこれほど電力を使うのか? それは、AIの計算が「超並列処理」だからです。1万個以上のコアを同時にフル稼働させて、何兆回もの計算を繰り返す。これはCPUの「数十個のコアで順番に処理する」方式とは根本的に消費電力のスケールが違います。

身近な例えで言えば、CPUは「1人のベテランシェフが複雑な料理を作る」、GPUは「数千人の調理スタッフが同じおにぎりを一斉に握る」。後者は仕事量は膨大ですが、それだけ電力も膨大に必要になるのです。

🔄 理由② ── 「推論」が24時間365日止まらない

AI処理には「トレーニング(学習)」と「推論」の2種類がありますが、電力消費のインパクトという意味では、実は推論のほうが総量として圧倒的に大きいのです(詳しくは次のセクションで解説します)。

ChatGPTに1回質問するだけで約2.9Whの電力を消費します。これはGoogle検索1回(約0.3Wh)の約10倍です(出典:日本経済新聞)。そしてChatGPTは現在、1日あたり25億件以上のリクエストを処理しています。この「少量×膨大な回数」が、推論の電力消費を爆増させている構造です。

❄️ 理由③ ── サーバー以外にも電力が必要

見落とされがちですが、データセンターではサーバー(IT機器)の電力以外にも冷却・電源変換・照明・セキュリティなどの「施設オーバーヘッド」に大量の電力を使います。前回の記事で解説したPUEの話です。

たとえば業界平均のPUE 1.56の場合、IT機器が100MWの電力を使えば、施設全体では156MWが必要──つまりIT電力の56%にあたる電力が冷却や電源設備に消費されているのです。GPUの消費電力が10倍になれば、この「オーバーヘッド」も連動して増大します。

トレーニングと推論 ── 「教える電力」と「使う電力」の違い

AI処理の電力消費を理解するうえで、最も重要な区分が「トレーニング(学習)」と「推論(インファレンス)」の違いです。多くの方が「トレーニングのほうが電力を食う」と思いがちですが、実はそう単純ではありません。

トレーニング(学習)

何をするか:大量のデータを使って、AIモデルに「知識」を教え込む作業。

特徴:数千台のGPUを数週間〜数ヶ月フル稼働。1回の学習で膨大な電力を消費。

例え:何百冊もの教科書を読んで知識を身につける段階。

電力例:GPT-3の学習に約1,287MWh(一般家庭約430世帯の年間消費量相当)

推論(インファレンス)

何をするか:学習済みのモデルを使って、ユーザーの質問に回答したり画像を生成する作業。

特徴:1回あたりの消費電力は小さいが、24時間365日、世界中で膨大な回数実行される。

例え:身につけた知識を使って毎日テストに答え続ける段階。

電力例:ChatGPT 1回の質問に約2.9Wh × 1日25億回以上

📊 電力消費の「総量」では推論が圧倒的

1回のトレーニングにかかる電力は確かに膨大です。しかし、トレーニングは「1回やって終わり(またはモデル更新のたびに実施)」。一方、推論はモデルが公開されている限り、毎秒毎秒、世界中で止まることなく実行され続けます。

南カリフォルニア大学の分析によれば、AIモデルの生涯エネルギー消費のうち、推論が最大90%を占めると推計されています(出典:USC AI Beat)。

~10%

出典:USC AI Beat推計を基に構成

「AIの電力問題=学習コストの問題」と思われがちですが、本当のインパクトは推論にあります。ChatGPTを使う人が増えるほど、画像生成AIが普及するほど、推論の電力消費は加速度的に増えていきます。「学習は1回だが、推論は永遠に続く」──ここがポイントです。

サーバーだけじゃない ── データセンター電力消費の全体像

「AIが電力を食う」と聞くと、サーバー(GPU)の電力だけを想像しがちですが、データセンターの電力消費は3つの大きな層から構成されています。

🏭 データセンター電力消費の3層構造

※割合はPUEや施設の設計により変動。上記はPUE 1.5前後の一般的な目安。

ここで重要なのは、GPU(第1層)の電力が増えると、冷却(第2層)と電源変換(第3層)の電力も連動して増えるという点です。GPUの消費電力が10倍になれば、発熱量も10倍。それを冷やすための冷却電力も大幅に増加します。

つまり、AIの電力消費は「GPU単体の電力」だけでは語れません。GPU電力 × PUE倍率 = 施設全体の電力消費。この掛け算の構造が、AIデータセンターの電力需要を爆増させている本当の理由です。

「サーバー電力 + 冷却電力 + 電源ロス = データセンター全体の電力」。この3層構造を理解すれば、PUEの意味も、液冷技術の重要性も、すべてがつながります。

世界で何が起きているか ── IEA予測:2030年に倍増

🌍 データセンターの電力消費は「日本1国分」を超える

国際エネルギー機関(IEA)は2025年4月に公表した報告書「Energy and AI」で、世界のデータセンター電力消費の見通しを発表しました。その数字は衝撃的です。

| 年 | 世界のDC電力消費 | 世界の電力消費に占める割合 | 身近な比較 |

|---|---|---|---|

| 2024年 | 約415TWh | 約1.5% | フランスの年間電力消費量に匹敵 |

| 2030年 | 約945TWh | 約3% | 日本の年間電力消費量を上回る |

出典:IEA「Energy and AI」(2025年4月)

2024年から2030年にかけて、データセンターの電力消費は年率約15%で増加します。これは世界全体の電力需要の成長率の4倍以上のペースです(出典:IEA)。

2030年の予測値である945TWhは、現在の日本の年間電力消費量(約860〜900TWh)をわずかに上回る規模です(出典:日本原子力産業協会)。世界中のデータセンターが「もう1つの日本」分の電力を使う時代が来るのです。

🏴 増加をけん引するのは米国と中国

IEAによると、この増加の約80%は米国と中国が占めます。米国は2024年時点で世界のデータセンター電力消費の約44%を占めており、GoogleやMicrosoft、Amazonなどのハイパースケーラーが巨大なAIデータセンターを次々と建設しています。

日本で何が起きているか ── 国内の電力需要見通し

🇯🇵 日本のDC電力需要は2034年に3倍へ

日本でもデータセンターの電力需要は急増しています。資源エネルギー庁の資料によると、国内のデータセンター容量は2022年時点で約2GWでしたが、2030年頃には約5GWへ拡大する見通しです(出典:資源エネルギー庁「電力需要について」(2024年6月))。

Wood Mackenzieの分析では、さらに踏み込んで、日本のデータセンター由来の最大電力需要は2034年に6.6〜7.7GWに達し、国内総電力需要の約4%を占めると予測されています(出典:Wood Mackenzie(2025年8月))。2024年レベルから約3倍の増加です。

世界(IEA予測)

2024年:約415TWh

2030年:約945TWh

増加率:約2.3倍

年率成長:約15%

米国+中国で増加の約80%

日本

2022年:約2GW(DC容量)

2030年:約5GW(見通し)

2034年:約6.6〜7.7GW

増加率:約3倍(2034年)

東京圏・関西圏に集中

⚡ 日本固有の課題:系統接続の「壁」

日本では電力需要の増加そのものだけでなく、電力を引き込むための系統接続(送電網への接続)が最大のボトルネックになっています。千葉県印西市などのデータセンター集積地では、新規の電力接続に最長10年以上かかるケースも報告されています。

経済産業省は2025年に省エネ法を強化し、データセンターにPUE目標を義務化しました。また、第7次エネルギー基本計画ではデータセンターの電力需要を明確な変動要因として位置づけ、対応を進めています(出典:エネルギー基本計画(2025年2月))。

なぜこれほど急に増えたのか ── 因果の連鎖で理解する

断片的なニュースを読んでいると「AIの電力問題」は唐突に降ってきたように見えますが、実はすべて1本の因果の連鎖でつながっています。

GPT-3は1,750億パラメータ、GPT-4は推定1兆超。モデルが大きくなるほど、必要な計算量が指数的に増加。

大規模計算に耐えるため、数千〜数万台のGPUが必要に。GPU1枚の消費電力も世代ごとに増加(400W→700W→1,000W)。

GPUサーバー1台で10kW、ラック1本で120kW。従来の10〜60倍の電力密度に。

発熱が10倍以上になり、空冷では間に合わない。液冷が必須に。冷却にかかる電力も急増。

IT電力×PUE倍率で施設全体の電力が決まる。数百MW〜GW級のデータセンターが世界中で建設ラッシュに。

電力を確保できる場所が限られる。系統接続の制約、電力不足リスク。AIの進化速度をインフラが制約する時代へ。

AIの電力問題は「突然降ってきた問題」ではなく、AIモデルの大規模化 → GPU電力増大 → 冷却電力増大 → 施設全体の電力爆増 → 電力インフラの制約という因果の連鎖で必然的に生じたものです。この連鎖を理解すれば、「次にどこがボトルネックになるか」も見えてきます。

よくある誤解を整理する

| ❌ よくある誤解 | ✅ 実際はこう |

|---|---|

| 「AIの電力問題=学習コストの問題」 | AIモデルの生涯電力消費の約90%は推論(日常利用)が占める。「使う電力」が本当のインパクト。 |

| 「サーバーの電力だけがAIの電力消費」 | 冷却・電源変換でさらに30〜60%の電力が加わる。PUE 1.5なら、IT電力の50%がオーバーヘッド。 |

| 「GPUの省電力化で解決するのでは?」 | GPU1基あたりの効率は改善しているが、AIモデルの大規模化が効率改善を上回るペースで進んでおり、総消費電力は増え続けている。 |

| 「電力問題はIT企業だけの問題」 | データセンターの電力需要は送電網、発電所、土地利用に影響し、周辺住民や他産業にも影響を及ぼす社会全体の問題。 |

| 「日本は海外ほど影響を受けない」 | 国内DC電力需要は2034年に3倍の見通し。系統接続制約はすでに日本で顕在化しており、印西では新規接続に10年以上かかるケースも。 |

あなたにとっての意味 ── 投資家・学生・技術者の視点

AIの電力需要が2030年に倍増するという見通しは、電力・冷却・送電インフラ企業への長期的かつ構造的な需要を意味します。GPU銘柄(NVIDIA等)だけでなく、電力会社、冷却設備メーカー(ダイキン、ニデック、三桜工業)、送電設備(古河電気工業、フジクラ)、データセンター建設(大成建設、NTTファシリティーズ)など、物理インフラ全体にまたがるサプライチェーンが投資テーマとなります。

「AIの電力問題」は、情報系だけでは解決できない課題です。電力工学、熱工学、流体力学、材料科学、都市計画──これらの知識がAIインフラの最前線で求められています。「AI=情報系の仕事」という思い込みを壊す最も強い根拠が、この電力問題なのです。

AIの電力問題を解決できるのは、発電・送電・受変電・冷却・配管の実務を知る技術者だけです。データセンターの電力需要が3倍になるということは、あなたの専門性に対する需要も3倍になるということ。「AIに仕事を奪われる」どころか、AIインフラを支える最も不足している人材があなたなのです。

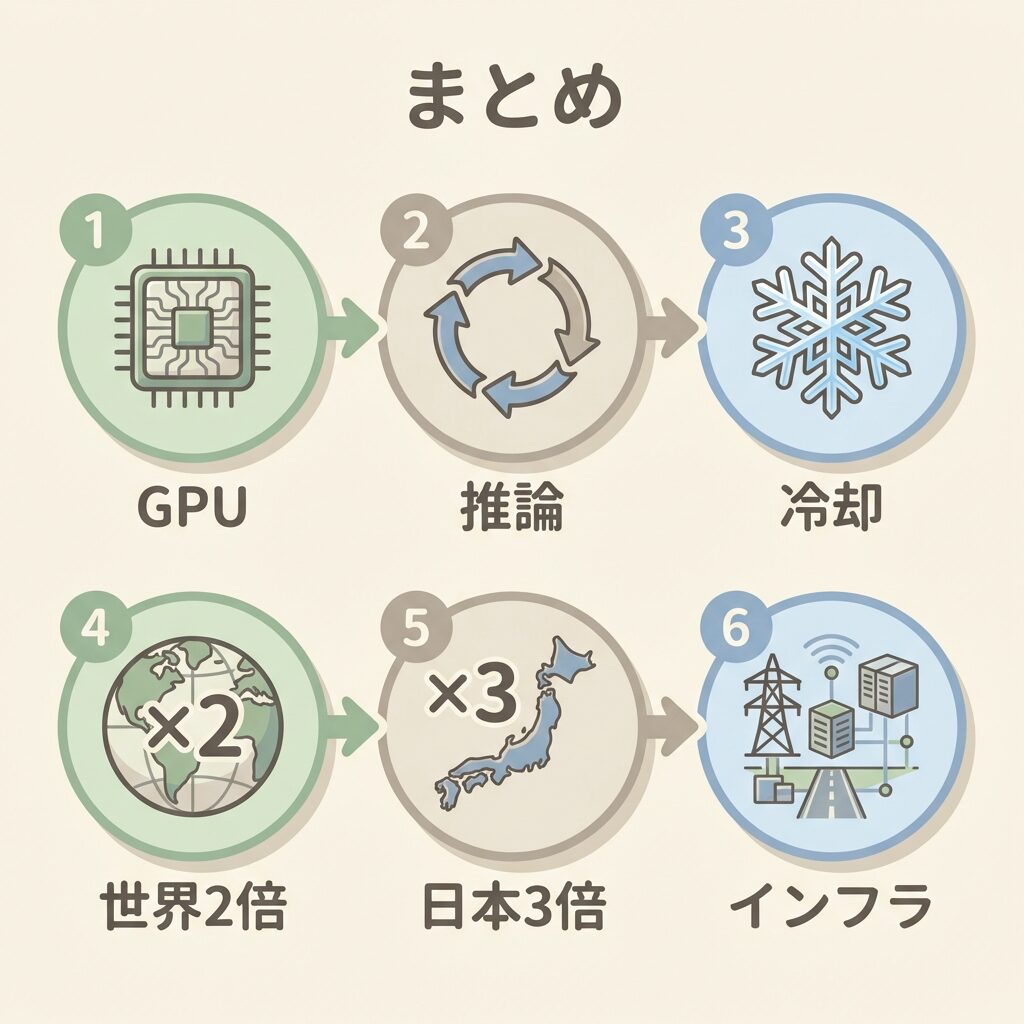

まとめ:AIデータセンターの電力問題の全体像

① AIが電力を食う3つの理由:GPUの消費電力が10倍以上、推論が24時間365日稼働、冷却・電源設備にも大量の電力が必要。

② トレーニング vs 推論:1回の学習は膨大だが、生涯電力の約90%は推論が占める。「使う電力」が本当のインパクト。

③ 電力消費の3層構造:IT機器(50〜65%)+冷却(25〜40%)+電源・その他(10〜15%)。GPU電力が増えると冷却も連動して増加。

④ 世界の見通し:IEA予測で2024年415TWh → 2030年945TWh(倍増)。日本の年間電力消費を上回る規模。

⑤ 日本の見通し:DC容量が2022年約2GW → 2030年約5GW。2034年には約6.6〜7.7GW(3倍)。系統接続が最大のボトルネック。

⑥ 因果の連鎖:AIモデル大規模化 → GPU電力増大 → 冷却電力増大 → 施設全体の電力爆増 → 電力インフラの制約。すべてつながっている。

結局こういうことです。AIの電力問題は「AIが賢くなりすぎた」という話ではありません。AIの計算を物理的に支えるための電力・冷却・送電インフラが追いついていないという、きわめてリアルな物理の問題です。そしてこの問題は、ソフトウェアの改善だけでは解決しません。発電所を建て、送電線を引き、冷却設備を設計する──それができる人と企業が、AI時代の成長を左右するのです。

❓ よくある質問(FAQ)

📚 次に読むべき記事

電力問題の「効率」を測る指標PUE。この記事とセットで読むと理解が深まります。

電力問題の原因であるGPUサーバー1台の構成と消費電力を知りたい方はこちら。

1ラック120kWの電力密度がなぜ問題なのかを構造から理解できます。

電力消費の第2層「冷却」を深掘りする記事です。

🗺️ 学習ロードマップ上の位置づけ

AIデータセンターの電力問題(この記事)

空冷 vs 液冷(冷却技術の比較)── 公開準備中

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント