「DRAMとHBMって、どう違うの?」——そんなふうに感じていませんか?

- HBMはDRAMの一種って聞いたけど、どこが違うの?

- 「帯域幅が広い」って具体的にどれくらい速いの?

- HBMのほうがすべてにおいて優れているの?

- なぜAIにはHBMが必要で、普通のDRAMではダメなの?

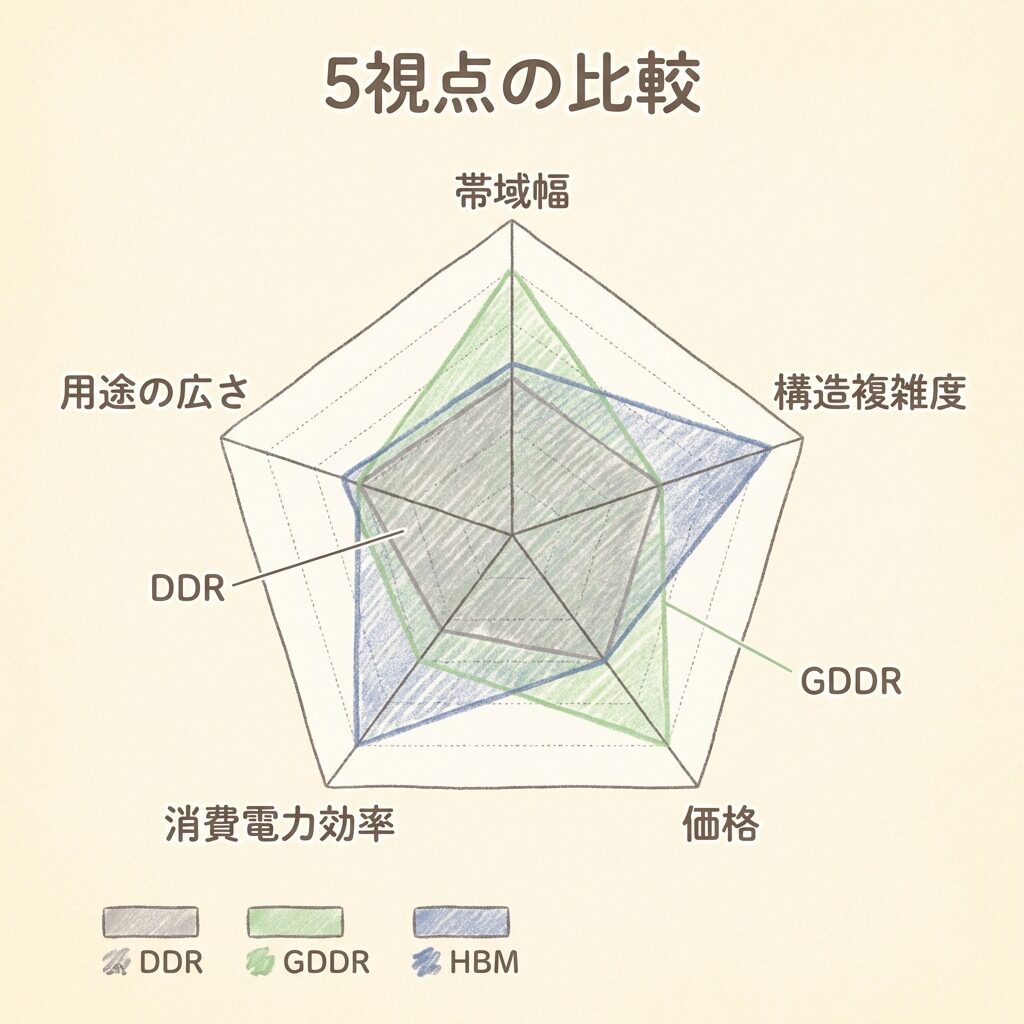

- DRAMとHBMの5つの比較視点(構造・帯域幅・消費電力・価格・用途)

- 「帯域幅が24倍」がどれだけすごいのか、たとえ話で理解

- HBMが優れている場面とDRAMで十分な場面の違い

- 学生・技術者それぞれにとっての意味

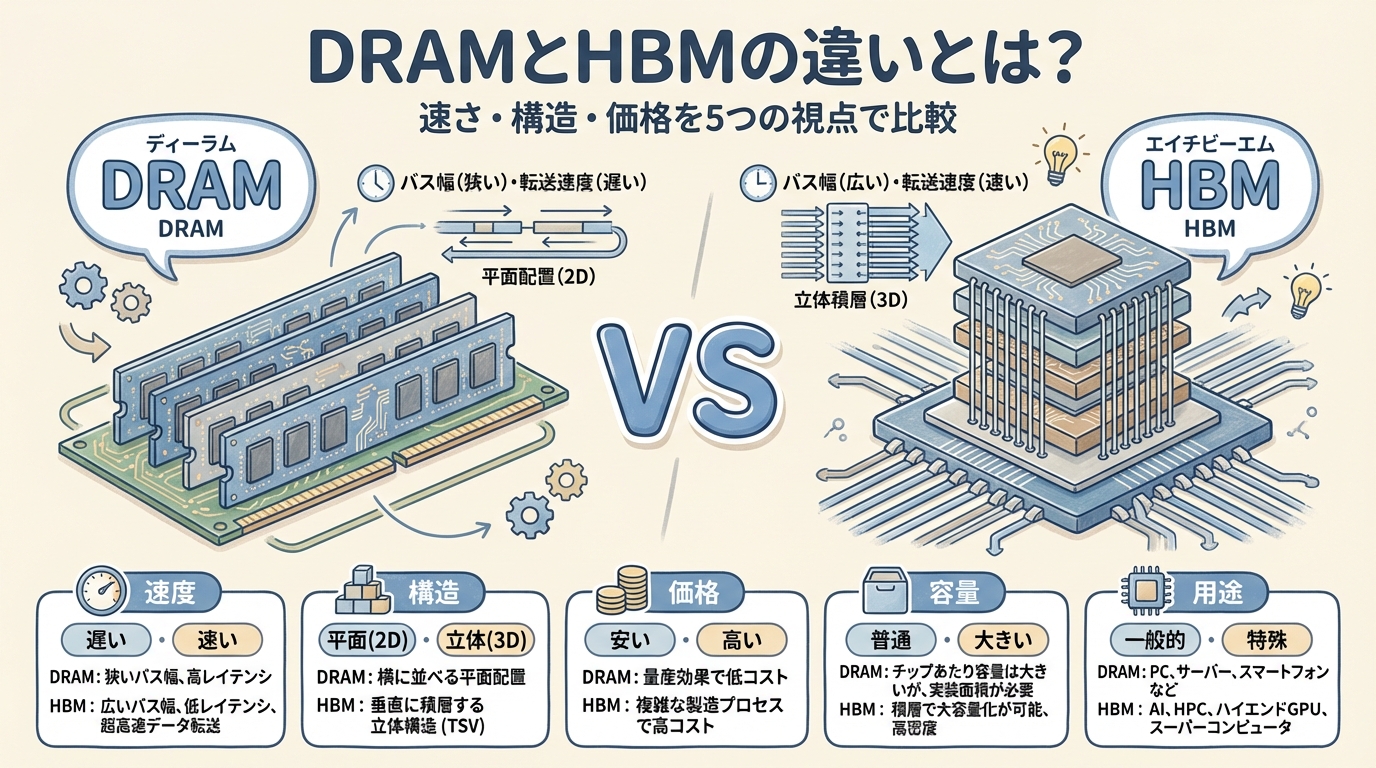

HBMはDRAMの「上位互換」ではありません。DRAMは安くて汎用的、HBMはAI専用の超高速・超高価なメモリです。両者の最大の違いは「構造」:DRAMが平面に並ぶのに対し、HBMは縦に積み重ねます。この差が帯域幅・電力・価格すべての違いを生んでいます。「どちらが優れているか」は用途によります——普通のPCにはDRAMで十分、AIアクセラレータにはHBM一択です。

まず「DRAM」とは何か? 1分で理解する

💾 DRAM = コンピュータが「今使うデータ」を置く作業台

DRAMとは Dynamic Random Access Memory(ダイナミック・ランダム・アクセス・メモリ) の略です。CPUやGPUが処理するデータを一時的に保存する「作業台」のようなものです。

DRAMは「料理人の手元にある調理台」です。冷蔵庫(ストレージ)から食材を取り出して置き、包丁(CPU/GPU)で切ります。調理台が広いほど一度に多くの食材を並べられる。DRAMはこの「調理台」の役割を担います。

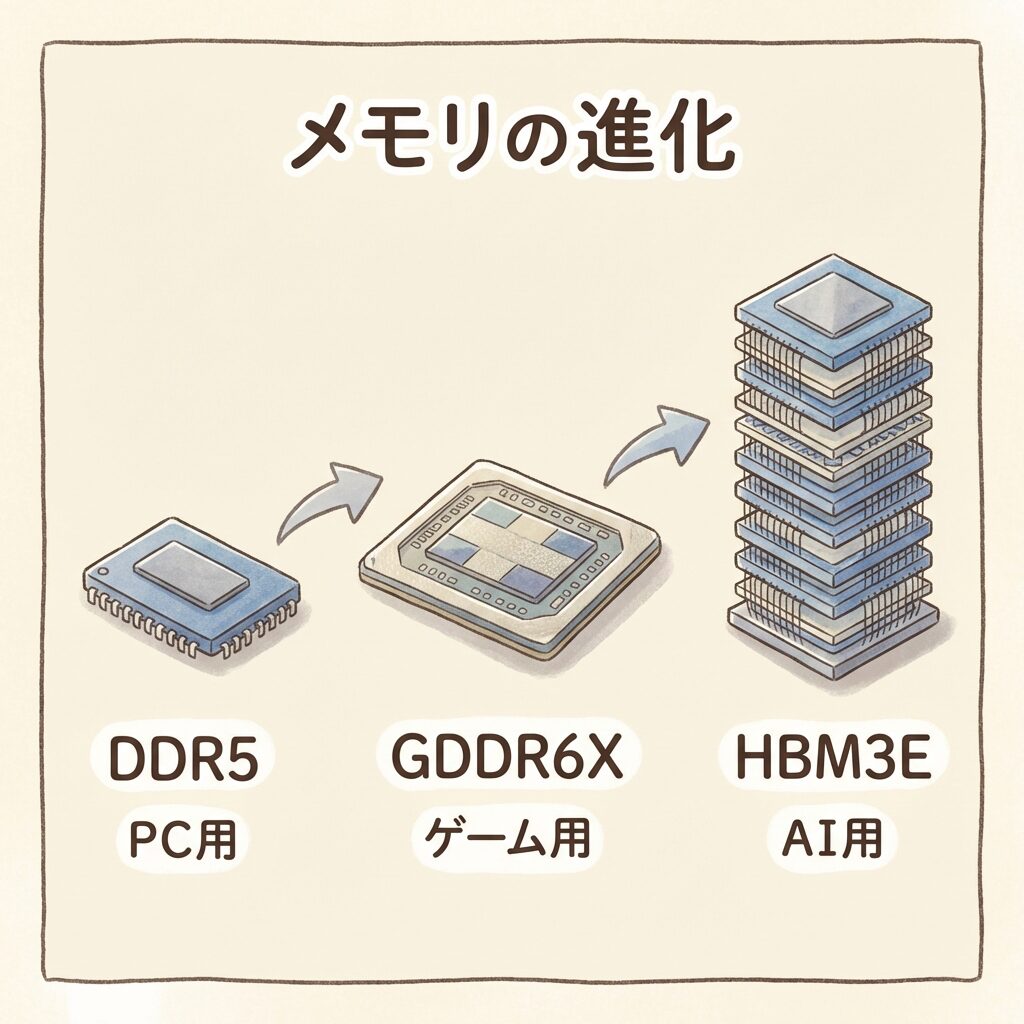

DRAMにはいくつかの種類があります。用途によって使い分けられています。

技術的には、HBMもDRAMを素材として使っています。しかし構造・用途・価格がまったく異なるため、業界では事実上「別物」として扱われます。この記事では「普通のDRAM(DDR/GDDR)」とHBMを比較します。

DRAMとHBMを比較する「5つの視点」

🗺️ 比較する前に「全体地図」を確認しよう

DRAMとHBMは、以下の5つの視点で比較するとその違いがはっきりと見えてきます。この地図を頭に入れてから各比較を読むと、より理解しやすくなります。

📖 【完全図解】HBMとは?GPUの隣にある「AI最重要メモリ」を初心者向けに解説 →

HBMの定義・仕組み・世代進化・市場構造まで詳しく解説したピラー記事です。この記事と合わせて読むと理解が深まります。

比較① 構造:「平屋」vs「超高層マンション」

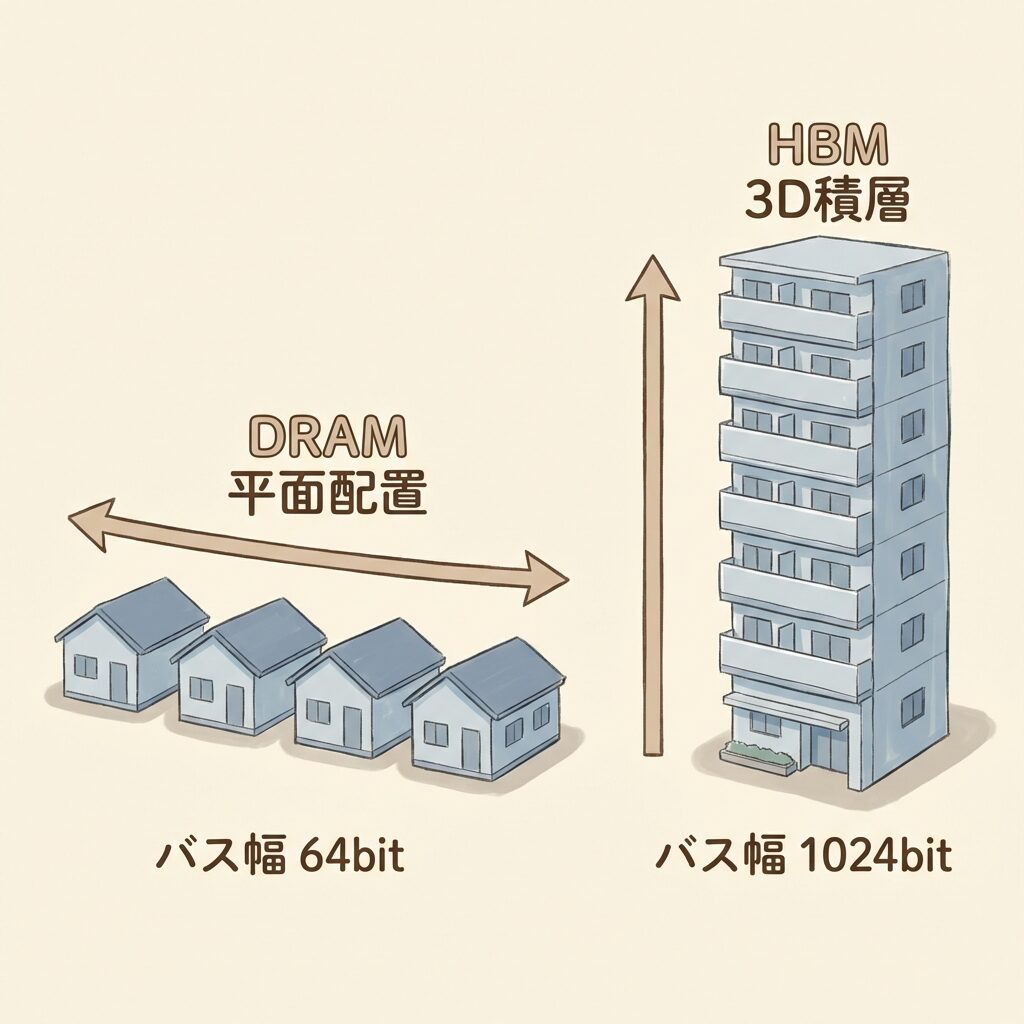

普通のDRAMは「平屋の家を横に並べた住宅地」です。土地(基板面積)をたくさん使います。HBMは「超高層マンション」。同じ土地に何十倍もの部屋(記憶容量)を詰め込めます。しかも、各階を縦に直接つなぐ「エレベーター(TSV)」があるので、データのやりとりが超高速です。

・基板上に広いスペースが必要

・バス幅:64〜384 bit

・チップ間の信号伝送距離が長い

・製造は比較的シンプル

▭

▭

▭

▭

▭

▭

▭

・省スペースで高密度を実現

・バス幅:1,024 bit以上

・TSV(貫通電極)で超短距離接続

・製造は高度な技術が必要

データが一度に通れる「車線数」のこと。64bitは1車線、1024bitは16車線のイメージ。車線が多いほど同じ時間に多くのデータを運べる。

比較② 帯域幅:DDR5の「24倍」の速さとは?

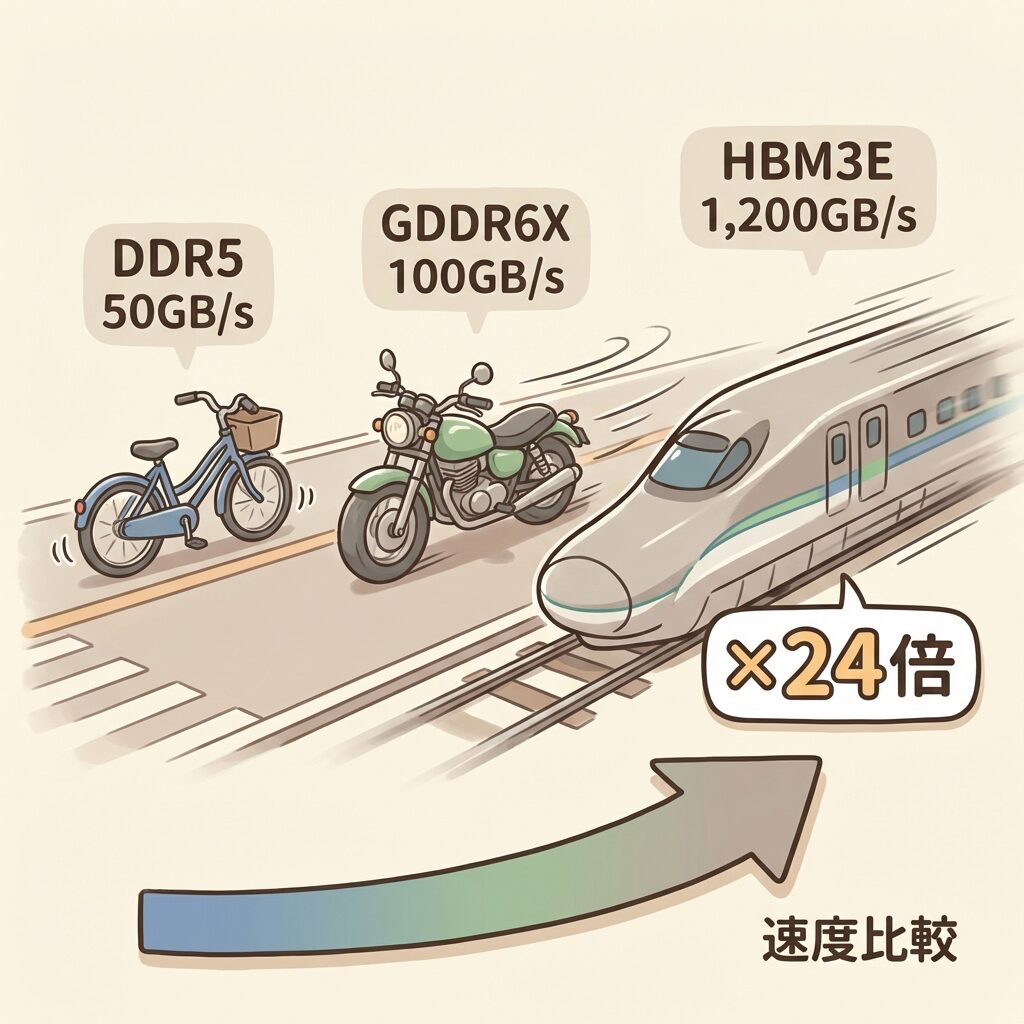

⚡ 数字で見ると、差の大きさが一目でわかる

(PCメモリ)

(ゲームGPU)

(AI GPU)

帯域幅の相対比較(DDR5を1とした場合)

DDR5が「自転車(時速20km)」で荷物を運ぶとしたら、HBM3Eは「新幹線(時速480km)」です。同じ1時間でも、運べる荷物の量がまったく違います。AIが大量のデータを処理するには、この「新幹線」級のスピードが必要なのです。

比較③④⑤:消費電力・価格・用途の違い

🔋 消費電力:HBMは「効率がいい」が「トータルは大きい」

普通のDRAM(GDDR6など)

- GPU本体から離れた場所に配置

- 信号の伝送距離が長い → 消費電力大

- 1GB/sあたりの消費電力:比較的高い

HBM

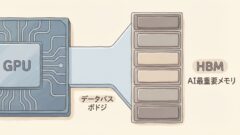

- GPUの隣に直接配置(インターポーザー)

- 信号の伝送距離が極めて短い → 効率的

- 1GB/sあたりの消費電力:GDDRより低い

HBMは「単位帯域幅あたりの消費電力」が少ない(効率的)ですが、HBMを搭載するH100/H200は1枚あたり700W以上の電力を消費します。これはHBMが効率的でも、GPU全体の演算量が桁違いに大きいためです。

💴 価格:HBMはDDR5の「数十倍」

8GB×1枚

GPU搭載分

1スタック

数十万円

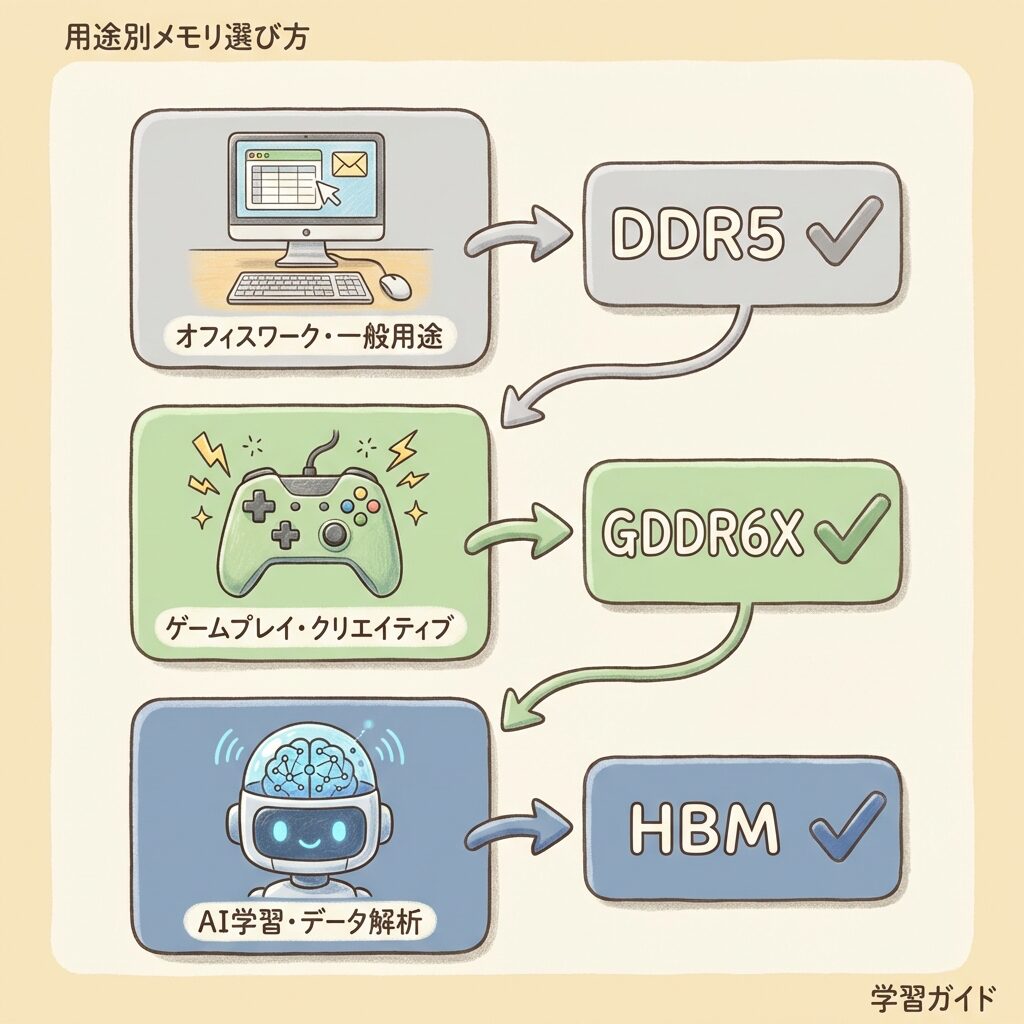

🎯 用途:「何に使うか」がすべてを決める

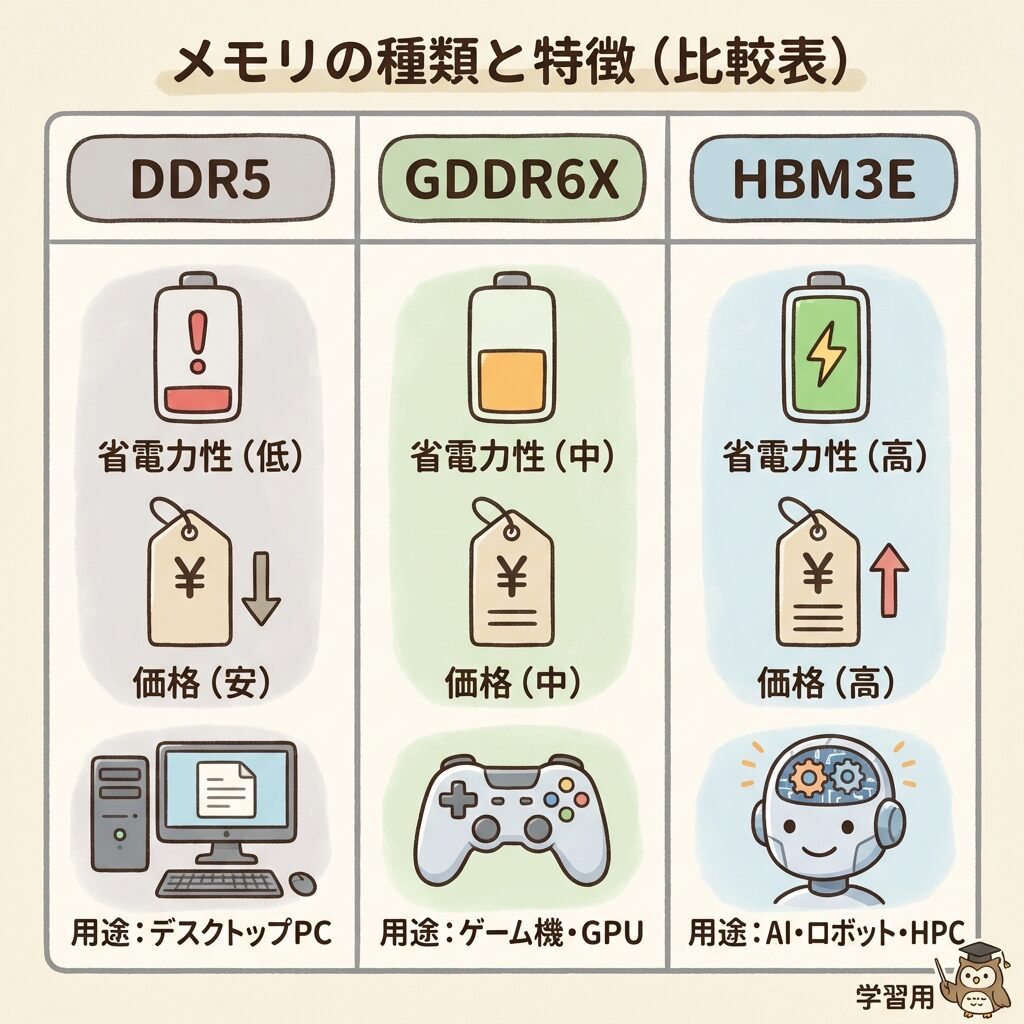

【保存版】5視点の全比較を一枚の表でまとめる

ここまで比較してきた5つの視点を、一枚の表に集約します。「DRAMとHBMの違いを人に説明したい」というときに役立ててください。

| 比較視点 | DDR5 (PCメモリ) |

GDDR6X (ゲームGPU) |

HBM3E (AI GPU) |

|---|---|---|---|

| ① 構造 | 平面(2D) | 平面(2D) | 3D積層(TSV) |

| ② 帯域幅 | 〜50 GB/s | 〜100 GB/s | 〜1,200 GB/s (DDR5の約24倍) |

| ③ 消費電力効率 | 標準的 | やや高い | 帯域幅あたりの 効率が高い |

| ④ 価格 | 低(数千円〜) | 中(数万円〜) | 非常に高 (数万〜数十万円/スタック) |

| ⑤ 用途 | PC・サーバー全般 | ゲーミングGPU | AIアクセラレータ スパコン専用 |

| 製造難度 | 低〜中 | 中 | 極めて高 (世界3社のみ量産可能) |

HBMは帯域幅で圧倒的に勝りますが、価格・製造難度でも圧倒的に高い。「HBMが最強」ではなく、「AI計算という超特定の用途に最適化された特殊メモリ」です。普通のPCにHBMを載せても意味はありません。

「どちらが優れているか」——答えは「用途による」

🎯 場面別:どのメモリを選ぶべきか

データベース・一般業務

映像編集・3Dゲーム

大規模推論・科学計算

HBMを普通のPCに載せても意味はありません。DRAMとHBMは「競合」ではなく「役割分担」です。DDR5は日常PCに最適、HBMはAI計算に特化——それぞれが「正しい場所で正しく使われる」ものです。高価なHBMをゲームPCに使っても、GDDR6Xと大差はありません。

学生・技術者にとって、この比較はどう役立つか

学生:「なぜDRAMを縦に積むと速くなるのか」という問いは、半導体物理・材料・製造プロセス・システム設計が交差する教育的な問いです。TSV・インターポーザー・2.5D/3D実装は、今後の半導体エンジニアが必ず直面する技術領域です。情報系だけでなく、電気・材料・機械系の学生にとってもキャリアに直結します。「DRAMとHBMの違いを説明できる」だけで、面接・研究発表での差別化になります。

技術者:AIシステムの設計・評価をするとき、「このタスクはメモリ帯域がボトルネックか、演算がボトルネックか」という視点が重要です。HBMの帯域幅(H100: 3.35TB/s、H200: 4.8TB/s)を知っていると、モデルのメモリ使用量と推論速度の関係を定量的に考えられます。「GPUを増やせば速くなる」という単純な発想から抜け出すための基礎知識です。

📖 【完全図解】HBMとは?GPUの隣にある「AI最重要メモリ」を初心者向けに解説 →

HBM1〜3Eの世代進化・SK Hynix独占の理由・市場構造まで詳しく解説。この記事の「続き」にあたる内容です。

❓ よくある質問(FAQ)

📚 次に読むべき記事

HBM1〜3Eの世代進化・製造メーカー3社の競争・市場構造まで詳しく解説。この比較記事の「深掘り版」です。

HBMを搭載したGPUが、なぜ大規模なデータセンターを必要とするのか。AIインフラ全体の構造を俯瞰できます。

HBMを積んだGPUが発する膨大な熱を、どうやって処理するのか。メモリの話の「次のステップ」です。

📩 記事の更新情報を受け取りたい方へ

新しい記事が公開されたら、Xアカウント @shirasusolo でお知らせします。AIインフラの構造を一緒に学んでいきましょう。

コメント